Știri

Știri din categoria Tehnologie & Știință

Samsung începe pe 30 aprilie distribuirea One UI 8.5 , o actualizare cu acoperire „record” de modele , ceea ce poate reduce fragmentarea software în ecosistemul companiei și poate accelera adoptarea noilor funcții pe o plajă mai largă de utilizatori, potrivit CNMO . Actualizarea One UI 8.5 (versiune stabilă) pornește din Coreea de Sud la 30 aprilie 2026, cu seria Galaxy S25 ca „prim val” de upgrade. Seria S26 vine preinstalată cu One UI 8.5, astfel că, în practică, S25 este prima generație care primește efectiv actualizarea prin distribuire ulterioară achiziției. Calendarul de distribuire: Coreea de Sud prima, apoi piețele externe Conform calendarului prezentat, extinderea către SUA și alte piețe externe este așteptată de la începutul lunii mai. Ritmul estimat de companie ar urma să fie: Seria S25 : 30 aprilie în Coreea de Sud; început de mai pe piețele externe; Z Fold 7 / Z Flip 7 : în aceeași perioadă sau imediat după; S24 și Z Fold 6 (și modele apropiate ca generație) : în prima parte a lunii mai , până la mijlocul lunii; S23, S22 și seriile A/M/F : finalizare în intervalul mai–iunie . Publicația notează că distribuirea la nivelul întregii game ar urma să se încheie înainte de pornirea, în acest an, a testelor pentru One UI 9. Ce aduce One UI 8.5: Android 16 și funcții noi, inclusiv AI în Bixby One UI 8.5 este bazat pe Android 16 și include schimbări de interfață și funcții noi. Printre noutăți se numără: Ambient Design , care introduce efecte de blur la nivel de sistem, cu impact asupra aspectului general; integrarea în Bixby a unor capabilități AI „bazate pe Perplexity”, pentru îmbunătățirea căutării și a răspunsurilor; Call Screening , cu identificare automată a apelurilor; Photo Assist , care permite editare de imagini prin introducere de text; Creative Studio , orientat către creație de conținut; Audio Eraser , pentru eliminarea zgomotului din audio, funcție care, potrivit informațiilor disponibile, poate fi folosită inclusiv în YouTube și aplicații sociale. Acoperire extinsă: de la flagship la modele de buget Un element central al actualizării este aria de compatibilitate , descrisă ca fiind la un nivel „record”: One UI 8.5 acoperă mai multe familii de produse, de la vârf de gamă la modele medii și entry-level, inclusiv seriile S, Z, Tab, A, M, F și XCover . Lista include, între altele, modele din intervalul S25 până la unele variante din S22 , mai multe generații de pliabile Fold/Flip, tablete și o selecție amplă din seriile A/M/F. [...]

Vodafone Business își extinde oferta pentru IMM-uri cu servicii de securitate cibernetică și „AI agentic”, bazate pe Google Cloud , în cadrul acordului de 1 miliard de dolari (aprox. 4,6 miliarde lei) semnat în 2024, potrivit Mobile World Live . Miza este una operațională: automatizarea interacțiunilor cu clienții și creșterea capacității de detectare și răspuns la atacuri, într-un context în care amenințările cibernetice pentru firmele mici sunt descrise ca tot mai frecvente și sofisticate. Securitate: serviciu MDR cu detecție și răspuns în timp real Vodafone Business va lansa un serviciu de „managed detection and response” (MDR – detecție și răspuns gestionate), activat de Google Security Operations, cu obiectivul de a identifica și atenua amenințările cibernetice în timp real. Debutul este programat în Germania, înaintea unei extinderi mai largi în Europa „mai târziu în acest an”, conform articolului. AI pentru relația cu clienții: „recepție virtuală” construită pe Gemini În paralel, operatorul a prezentat Vodafone Business AI Concierge, descris ca un „front desk” virtual cu AI agentic (adică un tip de inteligență artificială capabilă să execute sarcini în mod autonom, pe baza unui obiectiv), construit pe platforma Gemini a Google. Instrumentul este gândit să automatizeze interacțiuni precum gestionarea solicitărilor și programarea întâlnirilor, astfel încât companiile să poată menține relația cu clienții și în afara orelor de lucru. Fanan Henriques, director de produs și business internațional la Vodafone Business, a caracterizat soluția drept „una dintre primele integrări de telefonie cu Gemini”. AI Concierge ar urma să fie lansat inițial în Germania și Grecia. Context: acord pe 10 ani, semnat în 2024 Lansările fac parte dintr-un acord pe 10 ani, încheiat în octombrie 2024, prin care Vodafone și Google Cloud urmăresc accelerarea transformării digitale prin servicii de AI și cloud. Oliver Parker, vicepreședinte Google Cloud pentru AI generativ la nivel global, a susținut că IMM-urile sunt „adesea cele mai insuficient deservite” când vine vorba de tehnologie de ultimă generație, iar parteneriatul combină modelele Gemini și expertiza de securitate „de nivel enterprise” cu conectivitatea și baza de clienți a Vodafone. Henriques a adăugat că obiectivul este ca IMM-urile să poată începe să folosească AI „fără complexitate sau risc” și să facă AI avansată și sigură utilizabilă în activitatea de zi cu zi. [...]

Oppo intră mai agresiv în segmentul „open-ear” cu Enco Clip 2, mizând pe autonomie mare și procesare avansată pentru apeluri , un tip de produs care vizează utilizatorii ce vor să audă și mediul din jur, nu doar muzica, potrivit Gizmochina . Modelul va fi pus în vânzare în China din 24 aprilie, la un preț de 899 yuani (aprox. 120 dolari, adică ~550 lei), cu o ofertă limitată la 849 yuani. Ce aduce nou: design „open-ear” și greutate redusă Enco Clip 2 folosește un design tip „clip”, care se prinde pe ureche și nu intră în canalul auditiv, spre deosebire de căștile true wireless clasice. Fiecare cască are 5,2 grame, iar construcția include o placă adaptivă din titan „ultra-subțire”, despre care Oppo spune că ajută atât la fixare, cât și la durabilitate. Audio și apeluri: doi difuzoare, două DAC-uri și un cip pe 6 nm Pe partea de sunet, Oppo spune că produsul a fost dezvoltat împreună cu Dynaudio și folosește un sistem cu două difuzoare dinamice (11 mm + 9 mm). Compania indică și suport pentru un interval de frecvențe 20 Hz – 40 kHz, plus „audio spațial” pentru un efect mai imersiv. Pentru apeluri, Enco Clip 2 include: două convertoare digital-analog (DAC) pentru procesarea audio; un cip pe 6 nanometri, pe care Oppo îl descrie drept „primul din industrie” în această categorie și despre care afirmă că ridică puterea de calcul pentru reducerea zgomotului de până la 100 de ori; un sistem cu trei microfoane, procesare cu inteligență artificială și un senzor VPU pentru reducerea zgomotului în convorbiri. Autonomie, încărcare și conectivitate Oppo indică o autonomie de până la 9,5 ore cu o singură încărcare, iar cu carcasa de încărcare totalul ajunge la aproximativ 40 de ore. Carcasa are o baterie de 530 mAh și se încarcă prin USB-C în circa 80 de minute. La conectivitate, Enco Clip 2 vine cu Bluetooth 6.1, asociere cu două dispozitive și o rază de până la 10 metri. Sunt menționate codecurile audio SBC, AAC și LHDC. Un detaliu neobișnuit: Oppo afirmă că modelul suportă comenzi vocale Apple pentru control hands-free (redare, volum, apeluri). Căștile vor fi disponibile în două variante de culoare (High-Gloss Gold și Space Grey) și au certificare IP55 pentru rezistență la praf și apă. [...]

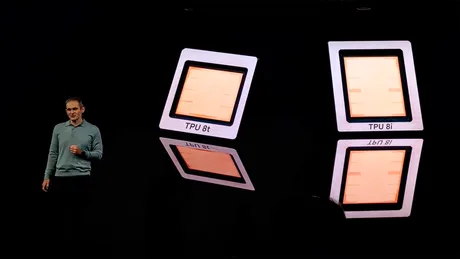

Google își mută accentul investițiilor de calcul pentru învățare automată către cloud , estimând că în 2026 „puțin peste jumătate” din investiția totală de compute pentru machine learning va merge către Google Cloud, pe fondul creșterii rapide a utilizării modelelor sale prin API și al cererii pentru „mii” de agenți AI în companii, potrivit Google Cloud . În mesajul publicat la Cloud Next 2026, CEO-ul Google și Alphabet, Sundar Pichai, spune că modelele „first-party” ale companiei procesează acum peste 16 miliarde de tokeni pe minut prin utilizare directă via API de către clienți, față de 10 miliarde în trimestrul anterior. Tokenii sunt unități de text folosite de modelele de inteligență artificială pentru a „citi” și „genera” conținut, iar volumul indică presiune în creștere pe infrastructura de calcul. De ce contează: capacitatea de calcul devine un diferențiator comercial Mesajul central este că Google încearcă să transforme cererea pentru agenți AI (programe care pot executa sarcini în mod autonom, pe baza unor obiective) într-un avantaj competitiv pentru Google Cloud, atât prin platforme de management, cât și prin infrastructură dedicată. Pichai descrie o schimbare de la întrebarea „putem construi un agent?” la „cum administrăm mii dintre ei?”, ceea ce mută discuția din zona de prototipuri în zona de operare la scară, cu cerințe de guvernanță (reguli și control), securitate și optimizare a costurilor. Platformă pentru „misiunea de control” a agenților Google spune că a introdus Gemini Enterprise Agent Platform , pe care o prezintă drept o platformă „full-stack” (adică acoperă mai multe straturi tehnice, de la integrare la operare) pentru a construi, scala, guverna și optimiza agenți. Compania leagă această direcție de performanța produsului Gemini Enterprise: în T1, numărul de utilizatori activi lunari plătitori ar fi crescut cu 40% față de trimestrul anterior. Securitate: soluții „agentice” și integrare cu Wiz Pe zona de securitate cibernetică, Google anunță o serie de soluții „agentice” pentru detecția amenințărilor, ca parte a unei platforme de securitate alimentate de AI care combină Threat Intelligence și Security Operations ale Google cu platforma de securitate cloud și AI a Wiz. Tot aici, compania menționează lansarea Wiz AI Application Protection Platform (AI-APP) , descrisă ca oferind protecție autonomă „de la cod la cloud și runtime” (adică inclusiv în faza de rulare a aplicațiilor), în medii multi-cloud, hibride și AI. Infrastructură: TPU-uri generația a 8-a, separate pentru antrenare și inferență Google introduce a opta generație de TPU (Tensor Processing Unit) , cipuri specializate pentru sarcini de inteligență artificială, cu o abordare în două variante: TPU 8t , optimizat pentru antrenare: poate scala până la 9.600 TPU și 2 petabytes de memorie partajată într-un singur „superpod”; ar oferi de trei ori puterea de procesare față de Ironwood și până la 2 ori mai multă performanță pe watt. TPU 8i , optimizat pentru inferență (rularea modelelor deja antrenate): conectează 1.152 TPU într-un singur pod, cu scopul de a reduce latența; are de trei ori mai mult SRAM „on-chip” și este poziționat pentru a rula „milioane de agenți” concomitent, „cost-eficient”. Google precizează că va oferi aceste TPU-uri clienților cloud, alături de o ofertă de instanțe cu GPU NVIDIA. „Customer zero”: utilizare internă ca argument de eficiență În același text, Pichai susține că Google folosește intern propriile tehnologii ca „customer zero” (primul client), inclusiv în dezvoltare software și operațiuni: 75% din codul nou la Google ar fi „generat de AI și aprobat de ingineri”, față de 50% în toamna trecută; un proiect de migrare de cod realizat de agenți și ingineri ar fi fost finalizat de șase ori mai repede decât era posibil cu un an în urmă doar cu ingineri; în securitate, agenții din centrul de operațiuni ar triaja automat zeci de mii de rapoarte neorganizate lunar, reducând timpul de atenuare a amenințărilor cu peste 90%; în operațiuni de marketing, utilizarea modelelor ar fi dus la un timp de execuție cu 70% mai rapid și o creștere a conversiilor cu 20% pentru lansarea Gemini în Chrome. Google indică faptul că va reveni cu noutăți la Google I/O, programat pe 19 mai. [...]

Google își accelerează infrastructura pentru „agenți” AI, iar utilizarea în rândul clienților Cloud crește rapid , potrivit Google Blog , care rezumă principalele noutăți prezentate la conferința Google Cloud Next ’26 . Compania spune că aproape 75% dintre clienții Google Cloud folosesc deja produsele sale de inteligență artificială, iar volumul de procesare prin API (interfață de programare) a urcat la peste 16 miliarde de „tokeni” pe minut, de la 10 miliarde în trimestrul anterior. Miza economică și operațională este că Google încearcă să transforme cererea pentru AI „agentic” (sisteme care pot executa sarcini în mod autonom, pe baza unui obiectiv) într-un consum mai mare de infrastructură și servicii cloud, într-un moment în care competiția între furnizori se duce tot mai mult pe capacitate de calcul, cost și guvernanță (control și reguli de utilizare) pentru aplicațiile AI. Ce indică datele de utilizare comunicate de Google În materialul de sinteză, Google oferă câteva repere despre amploarea utilizării: aproape 75% dintre clienții Google Cloud folosesc produse AI ale companiei; 330 de clienți Google Cloud au procesat fiecare „peste un trilion de tokeni” în ultimele 12 luni; modelele Google procesează „peste 16 miliarde de tokeni pe minut” prin utilizare directă via API de către clienți, față de „10 miliarde” în trimestrul anterior. „Tokenii” sunt unități de text (sau fragmente de text) folosite la procesarea limbajului de către modele AI; creșterea volumelor sugerează atât extinderea utilizării, cât și intensificarea încărcării pe infrastructură. Direcția anunțată: platformă pentru agenți și o nouă generație de TPU Google poziționează „transformarea către o întreprindere agentică” drept o evoluție inevitabilă pentru organizații și spune că la Cloud Next ’26 a prezentat „foaia de parcurs” pentru tranziție, cu două repere centrale: Gemini Enterprise Agent Platform , descrisă ca o platformă pentru a construi, scala, guverna și optimiza agenți autonomi; a opta generație de Tensor Processing Units (TPU) , cu „două cipuri specializate” și o abordare „dual-chip” pentru antrenare și inferență (rularea modelului pentru a produce răspunsuri). Materialul nu include detalii de preț, termene de disponibilitate sau specificații tehnice complete în pagina de sinteză, ci trimite către articole separate din colecție. Ce urmează și la ce să se uite companiile Din perspectiva utilizatorilor enterprise, mesajul principal este că Google împinge simultan pe două fronturi: instrumente „deasupra” (platforme pentru agenți, integrare cu datele și procesele) și capacitate „dedesubt” (cipuri și infrastructură de centre de date). Pentru companii, întrebările practice rămân legate de costul total al utilizării (consum de tokeni și calcul), controlul asupra agenților și integrarea cu datele interne — aspecte pe care Google le leagă de noua platformă și de infrastructura dedicată. [...]

Google își consolidează oferta pentru „agenți” AI în companii printr-o platformă unificată care combină dezvoltarea, guvernanța și optimizarea , potrivit Google Blog . Miza este una operațională: echipele tehnice ar urma să poată construi și scala agenți autonomi într-un singur „punct de lucru”, cu integrare în infrastructura Google Cloud și în capabilitățile sale de date și securitate. Platforma, prezentată ca un „one-stop-shop” pentru agenți, a fost anunțată la Google Cloud Next ’26 și aduce laolaltă serviciile de construire și ajustare (tuning) a modelelor din Vertex AI cu funcții noi pentru integrarea agenților, securitate și DevOps (practici și instrumente pentru dezvoltare și operare software). Google susține că Agent Platform este gândită să se adapteze nevoilor specifice ale fiecărei echipe. Ce include platforma și ce modele poate folosi Conform descrierii, Gemini Enterprise Agent Platform oferă acces la mai multe modele din portofoliul Google, inclusiv: Gemini 3.1 Pro; Gemini 3.1 Flash Image (Nano Banana 2); Lyria 3. În același timp, platforma suportă și modele ale Anthropic: Claude Opus, Sonnet și Haiku. Google nu detaliază în material condițiile comerciale sau diferențele de disponibilitate între modele. Integrarea cu Gemini Enterprise și implicația pentru utilizarea internă Google mai spune că Agent Platform se integrează cu aplicația Gemini Enterprise, descrisă drept „ușa de intrare” pentru AI pentru fiecare angajat. În practică, mesajul indică o arhitectură în care dezvoltarea și guvernanța agenților rămân la echipele tehnice, iar accesul la capabilități AI pentru utilizatorii din companie este centralizat prin aplicația enterprise. Materialul nu oferă exemple de implementări, termene de disponibilitate pe piețe sau indicatori de performanță, astfel că impactul concret pentru clienți (costuri, productivitate, reducerea timpului de livrare) nu poate fi cuantificat din informațiile publicate. [...]

Apple ar putea repoziționa iPhone 18 „vanilla” ca model de cost , cu dotări reduse și o lansare mutată în primăvară, într-o încercare de a ține sub control scumpirile de componente și de a evita fie creșterea prețurilor, fie comprimarea marjelor, potrivit Zonă IT . Presiunea vine din scumpirea unor componente esențiale, precum memoria RAM și stocarea, iar Apple ar căuta o cale de mijloc: un iPhone mai ieftin de produs, fără să riște o scădere a vânzărilor prin scumpiri directe și fără să absoarbă costurile în detrimentul profitabilității. Semnalul din 2026: iPhone 17 revine la aluminiu Publicația notează că primul pas ar fi fost deja făcut odată cu seria iPhone 17, care a revenit la carcasă din aluminiu, după ce Apple ar fi concluzionat că aliajul din titan nu este necesar nici măcar pentru un telefon premium. Consecințele menționate: un aspect mai voluminos și mai puțin elegant, o ramă mai ușor de deteriorat la cădere și reclamații ale utilizatorilor privind decolorarea sau tocirea prematură a finisajului. Ce s-ar schimba la calendarul de lansare pentru iPhone 18 Conform unor „surse apropiate companiei americane” citate de Zonă IT, iPhone 18 „vanilla” ar urma să fie prezentat simultan cu iPhone 18e, în primăvara viitoare. Asta ar însemna că, la lansarea din toamnă, ar rămâne doar modelele: iPhone 18 Pro iPhone 18 Pro Max iPhone Fold În acest scenariu, opțiunea „cea mai ieftină” din gama de telefoane premium ar dispărea din fereastra de toamnă. Unde ar putea tăia Apple din costuri: cip și memorie Potrivit detaliilor atribuite unui informator chinez „cu legături pe lanțul de aprovizionare cu componente Apple”, iPhone 18 ar putea primi: un chipset realizat pe un proces de fabricație mai vechi; specificații inferioare la puterea de procesare; memorie mai puțină sau cipuri de memorie mai lente (nu este precizat care variantă). Ideea centrală a acestor informații este că iPhone 18 „vanilla” ar ajunge mai apropiat ca poziționare de varianta „e”, nu invers. Ce rămâne neschimbat pentru segmentul premium Zonă IT indică faptul că iPhone 18 Pro și Pro Max ar urma să păstreze un nivel al dotărilor comparabil cu seria actuală de iPhone, cu îmbunătățiri punctuale la procesor. Informațiile despre iPhone 18 rămân, însă, la nivel de surse și presupuneri, fără confirmare oficială din partea Apple. [...]

Google Cloud pariază 750 de milioane de dolari (aprox. 3,45 miliarde lei) pe consultanți ca să-și crească cota în cloud , finanțând direct firmele care decid, în practică, ce platformă ajunge să fie folosită în marile implementări de „agentic AI” (agenți software care execută sarcini în mod autonom), potrivit The Next Web . Fondul, anunțat la Cloud Next 2026 , este prezentat drept cea mai mare investiție unică într-un program de parteneri făcută de un „hiperscaler” (furnizor global de infrastructură cloud la scară foarte mare). Mesajul din spatele sumei: competiția pentru AI în companii se mută de la vânzarea de infrastructură la finanțarea integratorilor și consultanților care proiectează și livrează efectiv soluțiile. Ce finanțează Google și de ce contează economic Google precizează că fondul nu este un vehicul de capital de risc, ci un mix de: credite, co-investiții, subvenții pentru instruire, bugete de „go-to-market” (sprijin comercial pentru vânzare și lansare). Miza este să încurajeze marile firme de consultanță să construiască agenți pe platforma Google, nu pe Microsoft Azure sau AWS. Argumentul economic invocat în material: pentru fiecare 1 dolar cheltuit de un client pe Google Cloud, partenerii pot încasa până la 7,05 dolari din servicii, ceea ce transformă consultanții din canal de distribuție în multiplicator de venituri. În același context, Google indică o extindere accelerată a ecosistemului: peste 2.900 de parteneri de servicii, o creștere de 400% a noilor intrări în ultimul an și un avans de 250% al veniturilor influențate de parteneri. Cine sunt partenerii vizați și ce angajamente apar în articol Textul enumeră o serie de angajamente și inițiative ale marilor consultanți: Accenture : a construit peste 450 de agenți pe Google Cloud și își extinde practica Gemini pe verticale de industrie. Deloitte : descrie investiția ca fiind „cea mai mare de până acum” într-o singură platformă cloud AI și spune că a implementat peste 100 de agenți pentru clienți enterprise. KPMG : angajament de 100 milioane dolari (aprox. 460 milioane lei) pentru soluții de agentic AI pe Google Cloud. PwC : colaborare de 400 milioane dolari (aprox. 1,84 miliarde lei) axată pe agenți pentru securitate și conformitate. NTT DATA : alocă 5.000 de ingineri pentru dezvoltarea de agenți pe Google Cloud. Cognizant și NTT DATA: lucrează la suite de agenți pe industrii (manufactură, servicii financiare, sănătate). Separat, Vista Equity Partners anunță un parteneriat pentru integrarea platformei de agenți Google în companiile din portofoliul său, ceea ce ar deschide accesul către zeci de firme de software de talie medie, fiecare putând deveni un canal de distribuție pentru agenți bazați pe Gemini. Schimbare operațională: partenerii sunt recompensați pentru „agenți”, nu pentru migrare Google își restructurează și programul de parteneri, introducând niveluri (Select, Premier, Diamond) care leagă beneficiile și sprijinul de co-vânzare de volumul implementărilor de agenți, nu de indicatorii tradiționali ai consumului de cloud. Intenția declarată: partenerii să fie măsurați și recompensați pentru livrarea de agenți, nu pentru migrarea de sarcini în cloud. Context competitiv: aceeași „piață” de consultanți este curtată de toți Materialul plasează fondul într-o competiție în care Microsoft, OpenAI și Anthropic urmăresc aceiași integratori. Sunt menționate: o inițiativă de parteneri a Microsoft anunțată cu o zi înainte de Cloud Next; programul „Frontier Alliances” al OpenAI (februarie 2026) cu McKinsey, BCG și Accenture; angajamentul Anthropic de 100 milioane dolari (aprox. 460 milioane lei) pentru Claude Partner Network și o inițiativă separată de 200 milioane dolari (aprox. 920 milioane lei) cu capital privat. Articolul subliniază că firmele de consultanță nu sunt exclusive (de exemplu, Accenture este partener principal simultan pentru Google, OpenAI și Microsoft). În această logică, cei 750 milioane dolari nu cumpără exclusivitate, ci „prioritate”: când o companie mare cere un agent pentru un proces (de pildă, lanț de aprovizionare), recomandarea implicită să fie platforma Google, nu alternativele din Azure sau AWS. De ce Google vede aici o pârghie pentru „decalajul” din cloud The Next Web notează că Google Cloud are aproximativ 11% din piața de infrastructură cloud, în spatele AWS (31%) și Azure (25%). Deși Google Cloud ar fi crescut cu 48% în trimestrul al patrulea din 2025, diferența rămâne semnificativă. În paralel, Google indică planuri de investiții (capital expenditure) de 175–185 miliarde dolari (aprox. 805–851 miliarde lei) pentru 2026. În acest tablou, fondul de 750 milioane dolari este mic ca pondere, dar țintește o altă constrângere: nu infrastructura, ci „capitalul uman” (competențele și capacitatea de livrare) necesar ca infrastructura să se transforme în implementări reale la clienți. Publicația ridică, totuși, întrebarea-cheie: dacă suma este suficientă pentru a schimba echilibrul, în condițiile avantajelor structurale ale Microsoft (distribuția enterprise prin Office 365) și ale AWS (dominanta în aplicații cloud-native). [...]

Huawei pregătește extinderea funcțiilor AI din Celia pe Mate 90 , iar miza este una operațională: telefonul ar urma să vină cu mai multe instrumente „mai inteligente și mai sigure” integrate direct în sistem, potrivit Huawei Central . Seria Pura 90 a fost lansată cu HarmonyOS 6.1, o versiune descrisă ca aducând schimbări „interactive” și ajustări fine față de edițiile x.0. În paralel, un zvon publicat de tipsterul Weibo indică faptul că seria Huawei Mate 90 ar urma să fie livrată cu HarmonyOS 7.0 preinstalat și să deblocheze un set mai amplu de funcții AI. Ce se schimbă, concret: accent pe aplicația Celia Conform informațiilor din material, noile funcții ar urma să apară în aplicația Celia, unde Huawei pare să „rafineze” asistentul virtual pentru a crește eficiența utilizării și a-l transforma într-un „companion AI” mai capabil. Publicația notează că tipsterul nu a oferit alte detalii despre aceste noutăți, astfel că amploarea și calendarul rămân neconfirmate. Ce poate face azi „Celia AI companion”, ca reper Huawei Central trece în revistă funcții deja asociate cu Celia pe modelele Pura 90, care conturează direcția de utilizare „în timp real”, pe baza conținutului de pe ecran: Smart To-Do : identifică informații afișate în aplicații și permite adăugarea lor în lista de sarcini sau calendar; poate recunoaște activ ecranul. Asistent de călătorie : recunoaște informații dintr-o aplicație și oferă planificare rută, estimare timp, interogare informații despre zboruri și comandă de transport „dintr-un click”. Global To-Do List : înregistrează și organizează automat sarcini; permite acces rapid la conținut, timp, locație. Smart Reading Companion : identifică ce citește utilizatorul și oferă colectare, ghidare pentru articole lungi, rezumat și generare de „hartă mentală”; poate interoga și rezuma informații relevante pentru textul selectat. Topic Recommendation : recomandă discuții/teme conexe pe baza conținutului citit. Global Celia : adaugă un buton vocal Celia în scenariile de mai sus, cu apăsare sau apăsare lungă pentru comandă vocală. În lipsa unor specificații suplimentare, singura concluzie fermă din material este direcția: Mate 90 ar urma să ducă mai departe această integrare a asistentului în fluxurile zilnice (liste, calendar, călătorii, citire), cu promisiunea unor funcții mai „reale”, mai „inteligente” și mai „sigure”, dar fără detalii tehnice sau o confirmare oficială. [...]

Google își separă noile TPU-uri pentru antrenare și inferență, o schimbare care poate reduce consumul de energie în centrele de date, dar fără garanții că economiile se vor vedea în prețurile plătite de clienți , potrivit Android Authority . La Cloud Next 2026, compania a anunțat a opta generație de Tensor Processing Units (TPU) pentru centrele sale de date, împărțită în două familii: TPU 8t pentru antrenarea modelelor de inteligență artificială și TPU 8i pentru inferență (rularea efectivă a modelelor, adică generarea de răspunsuri și predicții pe baza a ceea ce au învățat). Miza operațională este folosirea de hardware diferit pentru sarcini cu cerințe diferite, în locul unei abordări „un singur cip pentru toate”. De ce contează separarea: energie, răcire și costuri de operare Google susține că această separare răspunde diferențelor de consum și putere de calcul dintre antrenare și inferență. În practică, compania spune că abordarea poate reduce consumul de energie al centrelor de date, ceea ce ar însemna atât costuri operaționale mai mici, cât și un impact de mediu redus. Publicația notează și un efect colateral invocat în text: dacă inferența devine mai eficientă energetic, utilizarea unor servicii precum Gemini ar putea necesita mai puțină apă pentru răcirea centrelor de date (mențiune formulată ca speranță, nu ca angajament ferm). Context tehnic, pe scurt: de ce antrenarea „cere” alt hardware decât inferența Android Authority explică diferența prin natura celor două procese: Antrenarea rețelelor neuronale este intensă: folosește memorie cu lățime mare de bandă și clustere mari de procesoare, deoarece presupune actualizarea a miliarde de parametri în fiecare secundă. Include „propagarea inversă a erorilor” (backpropagation), adică bucle repetate de feedback prin care modelul este optimizat pe setul de antrenament. Inferența este, în general, mai puțin solicitantă și poate rula pe hardware mai puțin capabil, cu consum mai mic de memorie. Concluzia operațională a sursei: folosirea aceluiași hardware pentru ambele tipuri de sarcini poate duce la costuri mai mari, ceea ce ridică „costul efectiv” al inferenței. Întrebarea rămasă: cine păstrează beneficiul economic Deși Google pune accent pe beneficiile de mediu ale TPU-urilor dedicate inferenței, Android Authority spune că nu a văzut promisiuni explicite privind reducerea costurilor pentru clienți. Rămâne de văzut dacă economiile din eficiență vor fi transferate către consumatori sau vor rămâne la companie și partenerii săi. În același context, sursa amintește că Google a mai avut TPU v5e (unde „e” ar veni de la eficiență) pentru operațiuni la scară mai mică, iar TPU 8i ar părea o adaptare pentru scară mare. În paralel, Amazon urmărește o direcție similară cu AWS Inferentia. [...]

DJI avertizează că blocarea de către FCC a autorizărilor pentru echipamente noi îi poate tăia accesul la piața americană pentru până la 25 de lansări în 2026 și ar putea genera pierderi de peste 1,5 miliarde de dolari (aprox. 6,9 miliarde lei) , potrivit DroneDJ . Miza nu este doar comercială: fără autorizări, produsele nu pot fi introduse legal pe piață, iar efectele se propagă către utilizatori instituționali și companii care depind de echipamentele DJI. Ce spune DJI în instanță și de unde vin pierderile estimate Într-o depunere la Curtea de Apel a SUA pentru Circuitul 9 , DJI oferă, potrivit articolului, cea mai detaliată estimare de până acum a impactului financiar după ce FCC a inclus produsele companiei pe „Covered List” la finalul anului trecut. Lista blochează autorizările pentru echipamente noi considerate risc de securitate națională, ceea ce, în practică, închide calea pentru multe lansări viitoare în SUA. DJI își cuantifică pierderile potențiale astfel: aprox. 700 milioane dolari (aprox. 3,2 miliarde lei) din autorizări FCC „puse deoparte” pentru 14 produse DJI existente ; aprox. 860 milioane dolari (aprox. 4,0 miliarde lei) dacă nu poate lansa până la 25 de produse noi (drone și produse non-drone) planificate pentru SUA în 2026. Totalul indicat în document ajunge la aprox. 1,56 miliarde dolari (aprox. 7,2 miliarde lei) în pierderi potențiale în acest an. Impact operațional: efecte invocate asupra utilizatorilor instituționali DJI susține că efectele nu se limitează la companie. Conform depunerii citate, sunt afectate și organizații care folosesc echipamente DJI și nu mai pot cumpăra produse nou aprobate, inclusiv: departamente de poliție și pompieri; utilități și alte entități comerciale. Compania argumentează că dronele sunt folosite de „first responders” pentru a îmbunătăți timpii de intervenție, a reduce costurile și a lua decizii mai bune în timp real în operațiuni de salvare, incendii și incidente de siguranță publică. În energie și utilități, DJI spune că aeronavele sunt utilizate la inspecții de infrastructură critică, reducând riscurile pentru lucrători. Cum a început disputa și ce cere DJI acum Cazul pornește, potrivit articolului, de la 22 decembrie 2025 , când FCC și-a actualizat „Covered List” pentru a include sisteme aeriene fără pilot fabricate în străinătate și componente critice. Deși măsura nu a vizat doar DJI, compania ar fi fost lovită mai puternic din cauza poziției dominante pe piața americană. DJI a dat în judecată FCC în februarie, cerând anularea deciziei, susținând că autoritatea nu a identificat o amenințare specifică legată de produsele DJI și că firma nu a avut o șansă echitabilă de a răspunde. În cea mai recentă depunere, DJI răspunde argumentului guvernului că apelul ar trebui respins ca prematur, pe motiv că există încă o cerere de reconsiderare în analiză la FCC. Poziția DJI, redată în articol, este că interdicția produce efecte deja și ar trebui tratată ca „acțiune finală” a agenției, deoarece „interzice imediat” comercializarea și importul produselor , fără pași suplimentari. Compania mai avertizează că acceptarea abordării FCC ar crea un precedent prin care un regulator ar putea interzice produse și amâna la nesfârșit revizuirea internă, evitând controlul instanței. Ca alternativă la respingerea dosarului, DJI cere instanței suspendarea cauzei pentru șase luni , nu închiderea ei, pentru a păstra posibilitatea de a continua lupta în instanță dacă FCC nu acționează. Ce urmează Curtea de Apel a Circuitului 9 trebuie să decidă dacă respinge cazul , îl pune în așteptare sau permite ca acțiunea să meargă mai departe. DroneDJ notează că, dacă restricțiile rămân, cumpărătorii americani ar putea vedea în continuare mai puține lansări DJI , concurență redusă și posibile creșteri de preț pe piața dronelor. [...]

Google mizează pe accelerarea „agenților” AI și separă hardware-ul pe două direcții: inferență rapidă și antrenare la scară mare , prin lansarea a două cipuri TPU dedicate, potrivit Google Cloud . TPU-urile (Tensor Processing Units) sunt procesoare specializate pentru sarcini de inteligență artificială. În contextul „erei agentice”, Google descrie agenții AI ca sisteme care pot „raționa, planifica și executa” fluxuri de lucru în mai mulți pași, în numele utilizatorului, ceea ce ridică cerințele de performanță și infrastructură. Ce aduce fiecare cip: TPU 8i pentru viteză, TPU 8t pentru antrenare Google prezintă două cipuri cu roluri distincte: TPU 8i este proiectat „în mod specific” pentru ca agenții AI să finalizeze foarte repede sarcini, cu obiectivul declarat de a susține o experiență bună pentru utilizator (adică răspunsuri rapide în utilizare). TPU 8t este „optimizat pentru antrenare” și este poziționat ca soluție pentru rularea „celor mai complexe modele” pe „un singur” bazin masiv de memorie (o arhitectură care urmărește să reducă fragmentarea și complexitatea antrenării distribuite). De ce contează: infrastructura devine diferențiator operațional pentru AI „agentic” Mesajul central este că aceste cipuri sunt parte dintr-o infrastructură „full-stack” construită pentru AI, care include rețelistică, centre de date și operațiuni eficiente energetic. Google susține că, împreună, acestea formează „motorul” care ar permite aducerea AI-ului agentic „către mase”, cu accent pe capacitatea de a livra sisteme „foarte receptive” (adică cu latență redusă și răspuns rapid). Google nu oferă în acest material cifre de performanță, prețuri sau termene de disponibilitate comercială, astfel că impactul concret în costuri și adopție rămâne de evaluat pe măsură ce apar detalii tehnice și oferte în platforma cloud. [...]