Știri

Știri din categoria Inteligență artificială

Huawei pregătește extinderea funcțiilor AI din Celia pe Mate 90, iar miza este una operațională: telefonul ar urma să vină cu mai multe instrumente „mai inteligente și mai sigure” integrate direct în sistem, potrivit Huawei Central.

Seria Pura 90 a fost lansată cu HarmonyOS 6.1, o versiune descrisă ca aducând schimbări „interactive” și ajustări fine față de edițiile x.0. În paralel, un zvon publicat de tipsterul Weibo

indică faptul că seria Huawei Mate 90 ar urma să fie livrată cu HarmonyOS 7.0 preinstalat și să deblocheze un set mai amplu de funcții AI.Conform informațiilor din material, noile funcții ar urma să apară în aplicația Celia, unde Huawei pare să „rafineze” asistentul virtual pentru a crește eficiența utilizării și a-l transforma într-un „companion AI” mai capabil. Publicația notează că tipsterul nu a oferit alte detalii despre aceste noutăți, astfel că amploarea și calendarul rămân neconfirmate.

Huawei Central trece în revistă funcții deja asociate cu Celia pe modelele Pura 90, care conturează direcția de utilizare „în timp real”, pe baza conținutului de pe ecran:

În lipsa unor specificații suplimentare, singura concluzie fermă din material este direcția: Mate 90 ar urma să ducă mai departe această integrare a asistentului în fluxurile zilnice (liste, calendar, călătorii, citire), cu promisiunea unor funcții mai „reale”, mai „inteligente” și mai „sigure”, dar fără detalii tehnice sau o confirmare oficială.

Recomandate

Google își consolidează oferta pentru „agenți” AI în companii printr-o platformă unificată care combină dezvoltarea, guvernanța și optimizarea , potrivit Google Blog . Miza este una operațională: echipele tehnice ar urma să poată construi și scala agenți autonomi într-un singur „punct de lucru”, cu integrare în infrastructura Google Cloud și în capabilitățile sale de date și securitate. Platforma, prezentată ca un „one-stop-shop” pentru agenți, a fost anunțată la Google Cloud Next ’26 și aduce laolaltă serviciile de construire și ajustare (tuning) a modelelor din Vertex AI cu funcții noi pentru integrarea agenților, securitate și DevOps (practici și instrumente pentru dezvoltare și operare software). Google susține că Agent Platform este gândită să se adapteze nevoilor specifice ale fiecărei echipe. Ce include platforma și ce modele poate folosi Conform descrierii, Gemini Enterprise Agent Platform oferă acces la mai multe modele din portofoliul Google, inclusiv: Gemini 3.1 Pro; Gemini 3.1 Flash Image (Nano Banana 2); Lyria 3. În același timp, platforma suportă și modele ale Anthropic: Claude Opus, Sonnet și Haiku. Google nu detaliază în material condițiile comerciale sau diferențele de disponibilitate între modele. Integrarea cu Gemini Enterprise și implicația pentru utilizarea internă Google mai spune că Agent Platform se integrează cu aplicația Gemini Enterprise, descrisă drept „ușa de intrare” pentru AI pentru fiecare angajat. În practică, mesajul indică o arhitectură în care dezvoltarea și guvernanța agenților rămân la echipele tehnice, iar accesul la capabilități AI pentru utilizatorii din companie este centralizat prin aplicația enterprise. Materialul nu oferă exemple de implementări, termene de disponibilitate pe piețe sau indicatori de performanță, astfel că impactul concret pentru clienți (costuri, productivitate, reducerea timpului de livrare) nu poate fi cuantificat din informațiile publicate. [...]

Google Cloud pariază 750 de milioane de dolari (aprox. 3,45 miliarde lei) pe consultanți ca să-și crească cota în cloud , finanțând direct firmele care decid, în practică, ce platformă ajunge să fie folosită în marile implementări de „agentic AI” (agenți software care execută sarcini în mod autonom), potrivit The Next Web . Fondul, anunțat la Cloud Next 2026 , este prezentat drept cea mai mare investiție unică într-un program de parteneri făcută de un „hiperscaler” (furnizor global de infrastructură cloud la scară foarte mare). Mesajul din spatele sumei: competiția pentru AI în companii se mută de la vânzarea de infrastructură la finanțarea integratorilor și consultanților care proiectează și livrează efectiv soluțiile. Ce finanțează Google și de ce contează economic Google precizează că fondul nu este un vehicul de capital de risc, ci un mix de: credite, co-investiții, subvenții pentru instruire, bugete de „go-to-market” (sprijin comercial pentru vânzare și lansare). Miza este să încurajeze marile firme de consultanță să construiască agenți pe platforma Google, nu pe Microsoft Azure sau AWS. Argumentul economic invocat în material: pentru fiecare 1 dolar cheltuit de un client pe Google Cloud, partenerii pot încasa până la 7,05 dolari din servicii, ceea ce transformă consultanții din canal de distribuție în multiplicator de venituri. În același context, Google indică o extindere accelerată a ecosistemului: peste 2.900 de parteneri de servicii, o creștere de 400% a noilor intrări în ultimul an și un avans de 250% al veniturilor influențate de parteneri. Cine sunt partenerii vizați și ce angajamente apar în articol Textul enumeră o serie de angajamente și inițiative ale marilor consultanți: Accenture : a construit peste 450 de agenți pe Google Cloud și își extinde practica Gemini pe verticale de industrie. Deloitte : descrie investiția ca fiind „cea mai mare de până acum” într-o singură platformă cloud AI și spune că a implementat peste 100 de agenți pentru clienți enterprise. KPMG : angajament de 100 milioane dolari (aprox. 460 milioane lei) pentru soluții de agentic AI pe Google Cloud. PwC : colaborare de 400 milioane dolari (aprox. 1,84 miliarde lei) axată pe agenți pentru securitate și conformitate. NTT DATA : alocă 5.000 de ingineri pentru dezvoltarea de agenți pe Google Cloud. Cognizant și NTT DATA: lucrează la suite de agenți pe industrii (manufactură, servicii financiare, sănătate). Separat, Vista Equity Partners anunță un parteneriat pentru integrarea platformei de agenți Google în companiile din portofoliul său, ceea ce ar deschide accesul către zeci de firme de software de talie medie, fiecare putând deveni un canal de distribuție pentru agenți bazați pe Gemini. Schimbare operațională: partenerii sunt recompensați pentru „agenți”, nu pentru migrare Google își restructurează și programul de parteneri, introducând niveluri (Select, Premier, Diamond) care leagă beneficiile și sprijinul de co-vânzare de volumul implementărilor de agenți, nu de indicatorii tradiționali ai consumului de cloud. Intenția declarată: partenerii să fie măsurați și recompensați pentru livrarea de agenți, nu pentru migrarea de sarcini în cloud. Context competitiv: aceeași „piață” de consultanți este curtată de toți Materialul plasează fondul într-o competiție în care Microsoft, OpenAI și Anthropic urmăresc aceiași integratori. Sunt menționate: o inițiativă de parteneri a Microsoft anunțată cu o zi înainte de Cloud Next; programul „Frontier Alliances” al OpenAI (februarie 2026) cu McKinsey, BCG și Accenture; angajamentul Anthropic de 100 milioane dolari (aprox. 460 milioane lei) pentru Claude Partner Network și o inițiativă separată de 200 milioane dolari (aprox. 920 milioane lei) cu capital privat. Articolul subliniază că firmele de consultanță nu sunt exclusive (de exemplu, Accenture este partener principal simultan pentru Google, OpenAI și Microsoft). În această logică, cei 750 milioane dolari nu cumpără exclusivitate, ci „prioritate”: când o companie mare cere un agent pentru un proces (de pildă, lanț de aprovizionare), recomandarea implicită să fie platforma Google, nu alternativele din Azure sau AWS. De ce Google vede aici o pârghie pentru „decalajul” din cloud The Next Web notează că Google Cloud are aproximativ 11% din piața de infrastructură cloud, în spatele AWS (31%) și Azure (25%). Deși Google Cloud ar fi crescut cu 48% în trimestrul al patrulea din 2025, diferența rămâne semnificativă. În paralel, Google indică planuri de investiții (capital expenditure) de 175–185 miliarde dolari (aprox. 805–851 miliarde lei) pentru 2026. În acest tablou, fondul de 750 milioane dolari este mic ca pondere, dar țintește o altă constrângere: nu infrastructura, ci „capitalul uman” (competențele și capacitatea de livrare) necesar ca infrastructura să se transforme în implementări reale la clienți. Publicația ridică, totuși, întrebarea-cheie: dacă suma este suficientă pentru a schimba echilibrul, în condițiile avantajelor structurale ale Microsoft (distribuția enterprise prin Office 365) și ale AWS (dominanta în aplicații cloud-native). [...]

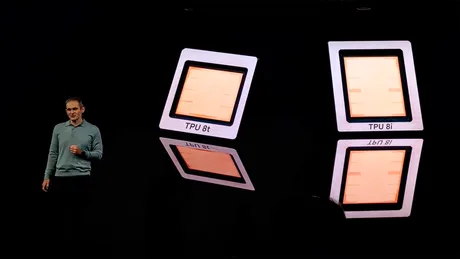

Google își separă noile TPU-uri pentru antrenare și inferență, o schimbare care poate reduce consumul de energie în centrele de date, dar fără garanții că economiile se vor vedea în prețurile plătite de clienți , potrivit Android Authority . La Cloud Next 2026, compania a anunțat a opta generație de Tensor Processing Units (TPU) pentru centrele sale de date, împărțită în două familii: TPU 8t pentru antrenarea modelelor de inteligență artificială și TPU 8i pentru inferență (rularea efectivă a modelelor, adică generarea de răspunsuri și predicții pe baza a ceea ce au învățat). Miza operațională este folosirea de hardware diferit pentru sarcini cu cerințe diferite, în locul unei abordări „un singur cip pentru toate”. De ce contează separarea: energie, răcire și costuri de operare Google susține că această separare răspunde diferențelor de consum și putere de calcul dintre antrenare și inferență. În practică, compania spune că abordarea poate reduce consumul de energie al centrelor de date, ceea ce ar însemna atât costuri operaționale mai mici, cât și un impact de mediu redus. Publicația notează și un efect colateral invocat în text: dacă inferența devine mai eficientă energetic, utilizarea unor servicii precum Gemini ar putea necesita mai puțină apă pentru răcirea centrelor de date (mențiune formulată ca speranță, nu ca angajament ferm). Context tehnic, pe scurt: de ce antrenarea „cere” alt hardware decât inferența Android Authority explică diferența prin natura celor două procese: Antrenarea rețelelor neuronale este intensă: folosește memorie cu lățime mare de bandă și clustere mari de procesoare, deoarece presupune actualizarea a miliarde de parametri în fiecare secundă. Include „propagarea inversă a erorilor” (backpropagation), adică bucle repetate de feedback prin care modelul este optimizat pe setul de antrenament. Inferența este, în general, mai puțin solicitantă și poate rula pe hardware mai puțin capabil, cu consum mai mic de memorie. Concluzia operațională a sursei: folosirea aceluiași hardware pentru ambele tipuri de sarcini poate duce la costuri mai mari, ceea ce ridică „costul efectiv” al inferenței. Întrebarea rămasă: cine păstrează beneficiul economic Deși Google pune accent pe beneficiile de mediu ale TPU-urilor dedicate inferenței, Android Authority spune că nu a văzut promisiuni explicite privind reducerea costurilor pentru clienți. Rămâne de văzut dacă economiile din eficiență vor fi transferate către consumatori sau vor rămâne la companie și partenerii săi. În același context, sursa amintește că Google a mai avut TPU v5e (unde „e” ar veni de la eficiență) pentru operațiuni la scară mai mică, iar TPU 8i ar părea o adaptare pentru scară mare. În paralel, Amazon urmărește o direcție similară cu AWS Inferentia. [...]

România rămâne la coada Europei la utilizarea inteligenței artificiale, cu implicații directe pentru productivitate și competitivitate , în condițiile în care doar 18% dintre persoane spun că au folosit instrumente AI în ultimele trei luni, arată o analiză preluată de Economedia , pe baza datelor Eurostat și IAB UK, citate de Visual Capitalist . Diferențele între state sunt mari și conturează o separare între nordul continentului, unde folosirea AI a devenit uzuală, și sud-estul Europei, unde nivelurile rămân semnificativ mai scăzute. Nordul Europei trage media în sus În fruntea clasamentului este Norvegia, cu 56,3% dintre respondenți care declară că au folosit AI în ultimele trei luni. În grupul țărilor cu adopție ridicată apar și: Danemarca: 48,4% Elveția: 47% Estonia: 46,6% Malta: 46,5% Finlanda: 46,3% Irlanda: 44,9% Țările de Jos: 44,7% Sudul și estul Europei, mult sub lideri. România, ultima În Europa de Sud și Sud-Est, utilizarea raportată este considerabil mai redusă: Italia este la aproximativ 20%, Turcia la 19%, iar România rămâne ultima, cu 18%. În același timp, analiza indică diferențe mari chiar în interiorul aceleiași regiuni: Grecia și Cipru sunt la aproximativ 44%, iar Malta ajunge la 47%. Economiile mari nu domină adopția AI Datele arată că mărimea economiei nu se traduce automat într-o utilizare mai mare a inteligenței artificiale. Germania și Regatul Unit sunt la aproximativ o treime din populație, iar Franța și Spania se află în zona de mijloc, cu 30–40%. Tinerii accelerează utilizarea Analiza semnalează și o diferență generațională: în Marea Britanie, deși media generală este de 34%, în rândul tinerilor de 15–24 de ani aproximativ un sfert folosesc zilnic instrumente AI, ceea ce sugerează că avansul viitor al adopției poate veni din schimbarea generațiilor. (Analiza originală este publicată de Visual Capitalist: Visual Capitalist .) [...]

Apple pregătește o schimbare operațională majoră pentru Siri, trecând de la comenzi punctuale la conversații continue și integrare între aplicații , potrivit TechRadar . Miza este ca asistentul să poată păstra contextul și să execute sarcini în mai mulți pași, într-un mod mai apropiat de experiența oferită de ChatGPT și alte instrumente de inteligență artificială conversațională. Apple ar urma să prezinte noua versiune la Worldwide Developers Conference (WWDC), care se deschide pe 8 iunie, iar schimbările sunt asociate cu iOS 27 , conform materialului. Ce se schimbă în utilizarea Siri Cea mai vizibilă modificare ar fi modul de interacțiune: în loc de solicitări izolate („setează un timer”, „care e vremea”), Siri ar urma să permită dialoguri cu întrebări de continuare și solicitări combinate în aceeași sesiune. Practic, asistentul ar „ține minte” firul conversației, astfel încât utilizatorul să nu fie nevoit să reia cererea de la zero de fiecare dată. TechRadar notează că această direcție aliniază Siri la așteptările formate deja de utilizatori în interacțiunea cu chatboți precum ChatGPT. Integrare între aplicații și folosirea „contextului personal” Dincolo de interfață, schimbarea cu impact practic este extinderea funcționării „peste” aplicații și servicii. Siri ar urma să poată folosi context personal și informația de pe ecran pentru a duce la capăt sarcini în mai mulți pași, inclusiv prin referințe la mesaje, e-mailuri și alte date. Un exemplu de utilizare descris în articol: Siri ar putea analiza o conversație, extrage un detaliu relevant și apoi acționa pe baza lui, fără instrucțiuni separate pentru fiecare etapă. Interfață nouă și experiență de tip „chat” Publicația mai scrie că Apple ar muta Siri din modul tradițional de afișare pe tot ecranul către o prezență mai integrată, inclusiv în Dynamic Island pe iPhone-urile mai noi, unde asistentul s-ar extinde la activare. În paralel, ar exista indicii despre o aplicație dedicată Siri, cu istoric de conversații și o prezentare familiară utilizatorilor de chatboți, deși transformarea principală ar fi „sub capotă”, în capabilitățile de procesare și integrare. Ce tehnologie ar putea sta în spate TechRadar menționează că Apple ar miza pe capabilități de tip „model lingvistic mare” (LLM – sisteme antrenate pe volume mari de text pentru a genera și înțelege limbaj), cu suport din partea modelelor Gemini ale Google . În acest scenariu, întrebări care înainte necesitau căutare pe web sau un chatbot separat ar putea fi rezolvate direct de Siri. De ce contează pentru piață și utilizatori Schimbarea vine pe fondul percepției că Apple a rămas în urmă în zona de inteligență artificială conversațională, în timp ce competitori au avansat cu sisteme generative. Articolul subliniază și o diferență de strategie: Apple ar integra aceste capabilități direct în Siri, nu ca parte a brandului Apple Intelligence. Rămâne de văzut cât de completă va fi implementarea la momentul prezentării și ce funcții vor fi disponibile efectiv odată cu iOS 27, întrucât informațiile descrise se bazează pe detalii „scăpate” și pe relatări din piață, nu pe specificații confirmate oficial. [...]

Meta testează în WhatsApp o funcție de rezumare cu inteligență artificială care procesează mesajele într-un mediu izolat , o abordare menită să reducă riscurile de confidențialitate atunci când utilizatorii cer sinteze ale mai multor conversații necitite, potrivit WinFuture . Funcția vizează în special utilizatorii care participă în multe grupuri active și se confruntă cu „avalansa” de mesaje după perioade mai lungi în care nu au folosit telefonul. În loc să deschidă fiecare chat pe rând pentru o privire de ansamblu, utilizatorii ar urma să poată genera dintr-un singur loc un rezumat al mai multor discuții. Cum ar funcționa rezumarea direct din inbox Noutatea ar apărea în inbox atunci când este activ filtrul pentru mesaje necitite. În acel context, WhatsApp ar afișa un buton dedicat, iar apăsarea lui ar genera un „rezumat compact” al discuțiilor ratate, pentru mai multe chat-uri simultan. Până acum, conform descrierii, utilizatorii trebuie să intre în fiecare conversație în parte pentru a solicita o sinteză, ceea ce face procesul mai lent când există multe mesaje necitite. Miza: confidențialitatea, prin „Private Processing” Potrivit informațiilor citate de publicație din WABetaInfo , funcția este în testare pentru Android și iOS și folosește o tehnologie numită „Private Processing”, gândită să păstreze confidențialitatea comunicării. Implementarea se bazează pe „ Trusted Execution Environments ” (TEE) – zone izolate, la nivel de hardware, în interiorul procesorului, folosite pentru procesarea sigură a datelor sensibile. WinFuture notează câteva elemente-cheie ale arhitecturii descrise: procesarea are loc într-un mediu izolat; transferul datelor către sistemul de inteligență artificială se face prin canale securizate care „ascund identitatea” utilizatorilor; mesajele ar urma să fie șterse imediat după procesare; conținutul nu ar fi folosit pentru antrenarea modelelor; Meta și WhatsApp nu ar avea acces la conținutul conversațiilor rezumate. Publicația mai menționează că firme independente de securitate, precum NCC Group, au verificat deja arhitectura pentru fiabilitate. Limitări și disponibilitate Un posibil minus, potrivit sursei, este că în conversații foarte complexe rezumatul automat poate pierde nuanțe sau context, ceea ce înseamnă că utilizatorul ajunge să se bazeze pe interpretarea software-ului. Nu este clar când va fi disponibilă funcția pentru toți utilizatorii. Instrumentul ar urma să fie opțional și ar necesita activare explicită din setările aplicației. [...]