Știri

Știri din categoria Inteligență artificială

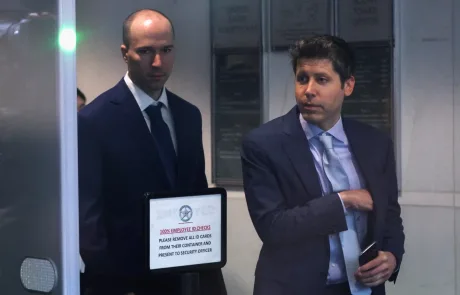

Ucraina își accelerează „industrializarea” AI în război, mizând pe datele de luptă pentru apărarea antidrone, după ce președintele Volodimir Zelenski s-a întâlnit la Kiev cu directorul general al Palantir Technologies, Alex Karp, potrivit Reuters.

Miza operațională este folosirea volumului mare de date colectate pe front de la începutul invaziei la scară largă a Rusiei, în 2022, pentru a antrena modele de inteligență artificială care să ajute la interceptarea dronelor rusești. În acest scop, Kievul a lansat împreună cu Palantir proiectul „Brave1 Dataroom”, care urmărește dezvoltarea de soluții AI pe baza datelor de luptă.

Ministrul ucrainean al apărării, Mykhailo Fedorov, a spus că „tehnologia, AI, analiza datelor și matematica războiului” influențează direct rezultatul de pe câmpul de luptă, după întâlnirea cu Karp. Fedorov, numit în ianuarie și care a promis o reformă amplă, bazată pe date, a armatei, a precizat că peste 100 de companii antrenează peste 80 de modele pentru detectarea și interceptarea țintelor aeriene.

În cooperarea cu Palantir, Ucraina ar fi dezvoltat un sistem pentru analiza detaliată a loviturilor aeriene și ar fi implementat soluții AI pentru procesarea unor volume mari de date de informații, integrate inclusiv în planificarea operațiunilor de lovire în adâncime, potrivit lui Fedorov.

Zelenski a afirmat pe platforma X că Palantir este o companie globală „cu potențial puternic” și că există domenii în care părțile pot fi utile una alteia, „întărind apărarea Ucrainei, a Americii și a partenerilor”. Președintele ucrainean a mai spus că discuțiile au vizat direcții de dezvoltare tehnologică atât pentru operațiuni de luptă, cât și pentru nevoi civile.

Recomandate

Ucraina își apropie de utilizare un laser anti-dronă ghidat de AI, cu rază declarată de 5 km , într-un moment în care apărarea împotriva dronelor rămâne o presiune operațională constantă pe front. Potrivit Tom's Hardware , sistemul „Tryzub”, montat pe remorcă, este în stadii finale de testare, iar producătorul susține că poate „arde găuri” în dronele Shahed de la 5 km (aprox. 3,1 mile). Ce schimbă operațional: o capabilitate mobilă, cu achiziție și urmărire asistate de AI Într-un clip distribuit pe rețele sociale de compania ucraineană Celebra Tech , Tryzub este prezentat perforând o placă de blindaj în trei-patru secunde, iar apoi lovind o dronă aflată în zbor, care se prăbușește la scurt timp după ce este „țintită” în vizorul asistat de AI. Pe lângă laserul de putere mare, rolul central este atribuit componentei de inteligență artificială pentru achiziția țintei și urmărire, plus integrării unui radar în platforma mobilă. Materialul nu precizează explicit cum este folosit radarul în lanțul de angajare, însă sugerează că acesta poate ajuta la poziționarea sistemului pentru interceptare. Raze de angajare: Shahed la 5 km, drone mai mici la distanțe mai scurte Conform informațiilor citate, Tryzub ar avea următoarele performanțe declarate, în funcție de tipul țintei: drone Shahed: până la 5 km; drone de recunoaștere: până la 1.500 metri; drone FPV (first-person view, controlate prin cameră video): aproximativ 800–900 metri. Totodată, sistemul ar putea „interfera” cu camerele dronelor FPV, deci nu doar să le distrugă fizic. Utilizare duală și potențial de export, dar fără calendar de intrare în serviciu O altă utilizare menționată este sprijinul pentru operațiuni de deminare, ceea ce ar putea transforma sistemul într-o capabilitate relevantă și în afara luptei anti-dronă, dacă războiul se încheie. În privința maturității industriale, Celebra Tech afirmă că designul este pregătit pentru producție de masă după trecerea testelor. Nu există însă, în sursele citate, o dată fermă pentru intrarea în serviciu activ, iar testarea continuă. Surse și context Euromaidan Press notează că sistemul ar fi în dezvoltare cel puțin din 2024, iar clipul de prezentare este asociat companiei Celebra Tech, care a publicat materialul pe social media. În lipsa unor detalii suplimentare despre rezultate standardizate de testare sau despre condițiile exacte ale demonstrației, performanțele rămân, deocamdată, la nivel de capabilități declarate și demonstrații publice. [...]

OpenAI a ridicat pragul de demitere a CEO-ului Sam Altman , o schimbare de guvernanță care îi consolidează poziția la vârful companiei în plin proces de tranziție către o structură cu scop lucrativ, potrivit IT之家 , care citează documente depuse în dosarul intentat de Elon Musk împotriva OpenAI . Informația apare în noi documente judiciare, unde un expert al părții lui Musk susține că OpenAI a modificat „discret” statutul companiei anul trecut, astfel încât demiterea CEO-ului să devină mai dificilă decât în 2023, când consiliul de administrație l-a înlăturat temporar pe Altman. Ce s-a schimbat în regulile de guvernanță Potrivit analizei expertului, noul statut ar permite CEO-ului să rămână în funcție dacă are sprijinul a cel puțin o treime din consiliul entității cu scop lucrativ. În același timp, pentru demiterea CEO-ului ar fi necesară o „majoritate absolută” de două treimi din directorii neangajați ai PBC (public benefit corporation – companie cu scop de interes public, o formă juridică ce combină obiective comerciale cu o misiune declarată de interes public). Profesorul de drept David M. Schizer (Universitatea Columbia), citat în documente, afirmă: „Conform noului statut, pentru a-l concedia pe CEO este nevoie de acordul unei majorități absolute de două treimi a directorilor neangajați ai PBC.” Anterior, în vechea arhitectură de guvernanță, consiliul non-profit ar fi avut nevoie doar de o majoritate simplă (peste 50%) pentru a demite CEO-ul. De ce contează: lecția din criza din 2023 În 2023, patru din cei șase membri ai consiliului au votat pentru schimbarea CEO-ului, invocând faptul că Altman „nu a fost suficient de sincer” în comunicarea cu boardul, inclusiv pe subiecte legate de lansarea ChatGPT. În noua configurație descrisă în documente, Altman ar avea nevoie de sprijinul a încă doi directori pentru a rămâne CEO. OpenAI are în prezent opt membri în consiliu, dar doar șapte au drept de vot; astfel, chiar dacă patru dintre cei șapte ar vota pentru demitere, pragul necesar nu ar fi atins, conform aceleiași surse. Materialul menționează între membrii consiliului: Bret Taylor (fost co-CEO Salesforce), Adam D’Angelo (CEO Quora), Sue Desmond-Hellmann și Sam Altman. Până la momentul publicării informației, OpenAI nu a comentat, potrivit IT之家. [...]

Google împinge Gemini spre utilizare practică în educație, transformând fotografii cu notițe scrise de mână în ghiduri de învățare structurate , o funcție care poate reduce timpul de sinteză pentru elevi și studenți și mută aplicația mai aproape de un instrument operațional de lucru, nu doar de conversație, potrivit Google Blog . Materialul descrie un flux simplu: utilizatorul fotografiază fiecare pagină de notițe, încarcă imaginile în Gemini și folosește un îndemn (prompt) de tipul „Creează un ghid de studiu pe baza materialelor mele de curs pentru examene”. Dacă utilizatorul stăpânește deja partea introductivă, poate cere explicit să fie sărite noțiunile de bază și să se intre direct în subiecte mai complexe. Din perspectiva utilizării, Google indică faptul că Gemini poate „distila” notițele în: ghiduri de studiu; fișe de tip flashcards (cartonașe cu întrebări și răspunsuri); o organizare a materiei pe un semestru, pentru reluare ulterioară. De ce contează operațional Mesajul central este trecerea de la acumularea de pagini și informație greu de gestionat, la un rezumat structurat generat din conținutul propriu al utilizatorului. Pentru zona educațională, asta înseamnă că munca de „curățare” și reorganizare a notițelor poate fi parțial automatizată, iar interacțiunea cu aplicația se mută spre sarcini concrete (sinteză, structurare, recapitulare), nu doar întrebări punctuale. Google nu oferă în material detalii despre disponibilitate pe piețe, limitări tehnice, costuri sau condiții de acces, astfel că impactul exact (cât de larg poate fi folosit și în ce scenarii) rămâne neprecizat în sursa citată. [...]

OpenAI își extinde oferta de securitate cibernetică cu Daybreak, o inițiativă care promite să identifice și să repare vulnerabilități înainte ca atacatorii să le exploateze , într-o mișcare ce pune presiune operațională pe echipele de securitate să integreze tot mai mult „agenți” de inteligență artificială în fluxurile de lucru, potrivit The Verge . Daybreak folosește agentul de securitate Codex Security , lansat în martie, pentru a construi un model de amenințări pe baza codului unei organizații și pentru a se concentra pe posibile căi de atac. Sistemul ar urma să valideze vulnerabilitățile probabile și să automatizeze detectarea celor cu risc mai ridicat. Ce schimbă Daybreak în practică pentru companii Din descrierea OpenAI, Daybreak este gândit ca un instrument care mută o parte din munca de analiză și triere a riscurilor dinspre oameni către automatizare, prin: modelarea amenințărilor pornind de la codul organizației; identificarea posibilelor „trasee” de atac; validarea vulnerabilităților considerate probabile; automatizarea detecției pentru vulnerabilitățile cu risc mai mare. Publicația notează că inițiativa vine într-un moment în care rivalii împing produse similare, iar OpenAI nu avea până acum un produs comparabil, orientat explicit pe securitate. Cum se poziționează față de Anthropic și „Claude Mythos” Lansarea are loc la puțin peste o lună după ce Anthropic a anunțat Claude Mythos, un model de securitate pe care compania a spus că este „prea periculos” pentru a fi lansat public și pe care l-a distribuit privat în cadrul inițiativei Project Glasswing. Chiar și așa, menționează The Verge, „cel puțin câteva” părți neautorizate ar fi obținut acces. În cazul OpenAI, Daybreak nu este construit pe un singur model. Compania spune că „Daybreak reunește cele mai capabile modele OpenAI, Codex și partenerii noștri de securitate”. Modelele folosite și direcția de dezvoltare Daybreak include și modele specializate pentru zona „cyber”, între care GPT-5.5 cu Trusted Access for Cyber și GPT-5.5-Cyber, care a început să fie disponibil treptat săptămâna trecută, conform informațiilor din articol. OpenAI mai afirmă că lucrează cu „parteneri din industrie și guvernamentali” în timp ce se pregătește să „implementeze modele din ce în ce mai capabile” pentru securitate cibernetică. Materialul nu oferă detalii despre calendar, clienți sau condiții comerciale. [...]

Airbnb spune că a ajuns să genereze cu inteligență artificială 60% din codul nou , un semnal că automatizarea începe să schimbe concret productivitatea echipelor de inginerie și modul în care compania își scalează dezvoltarea de software, potrivit TechRadar . Declarațiile au fost făcute de CEO-ul Brian Chesky în cadrul conferinței cu investitorii pentru rezultatele din T1 2026. Ce înseamnă „60% din cod” în termeni operaționali Chesky a spus că, în trimestrul raportat, 60% din codul produs de inginerii Airbnb a fost scris cu ajutorul unor instrumente de inteligență artificială. În același timp, el a prezentat AI ca pe un multiplicator de capacitate pentru echipe: compania folosește AI pentru a construi mai rapid instrumente destinate partenerilor API (parteneri care își gestionează proprietățile prin software-uri diferite și se conectează la platformă prin interfețe de programare). „AI oferă un avantaj uriaș — unde înainte ai fi avut nevoie de o echipă de 20 de ingineri, un inginer poate acum să pornească agenți care fac multă muncă sub supraveghere.” Mesajul central: Airbnb încearcă să accelereze livrarea de software către parteneri, inclusiv în zone unde „înainte nu avea resurse”. AI în suportul clienți: 40% din cazuri fără escaladare Compania a extins utilizarea AI și în asistența pentru utilizatori. Chesky a afirmat că „botul” de suport clienți al Airbnb poate gestiona aproximativ 40% dintre probleme fără a le escalada către un agent uman. În același timp, CEO-ul a recunoscut limitări: instrumentele AI pot avea probleme în felul în care prezintă informația către utilizatorii care contactează suportul, ceea ce poate duce la o experiență mai slabă. De ce nu „merge” încă AI pentru travel și e-commerce, în viziunea CEO-ului Deși Airbnb folosește intens AI în dezvoltare și suport, Chesky a spus că nimeni nu a „rezolvat” încă AI pentru travel sau comerț electronic, criticând modelul actual de chatbot. El a enumerat patru probleme: prea mult text (în timp ce comerțul electronic este „orientat pe imagini”); lipsa „manipulării directe” (trebuie să tastezi în loc să ajustezi, de exemplu, glisoare); comparații slabe (utilizatorul se poate pierde între mii de opțiuni într-un fir de conversație); rezervările sunt adesea „multiplayer” (implică mai multe persoane), în timp ce chatbot-urile sunt în principal „single-player” și nu sunt „native pe hartă”. Context: trendul codului generat de AI și riscul de calitate TechRadar notează că afirmațiile Airbnb se înscriu într-un trend mai larg: CEO-ul Microsoft, Satya Nadella, a spus recent că aproape o treime din codul companiei este produs în acest fel (mențiune în material, cu trimitere la un articol TechRadar). Publicația adaugă însă că astfel de cifre trebuie privite cu prudență și citează o cercetare (menționată tot de TechRadar) potrivit căreia codul generat de AI produce de 1,7 ori mai multe probleme decât cel scris de oameni, ceea ce poate însemna revizuiri mai lungi și riscul ca mai multe erori să ajungă în produsul final. Pentru companii, miza devine un echilibru dificil: câștig de viteză și volum la livrare, dar cu presiune suplimentară pe controlul calității și pe procesele de verificare. [...]

Comisia Europeană încearcă să obțină acces la modelele avansate de inteligență artificială ale OpenAI și Anthropic , într-un demers care țintește direct capacitatea UE de a evalua și gestiona riscurile acestor tehnologii înainte ca ele să fie folosite pe scară largă în economie, potrivit G4Media . Un purtător de cuvânt al Comisiei Europene, Thomas Regnier, a declarat că Bruxellesul „apreciază abordarea proactivă” a OpenAI, inclusiv disponibilitatea companiei de a oferi acces la noua generație de modele. În cazul Anthropic, Comisia ar fi avut deja „aproximativ patru sau cinci” întâlniri, însă discuțiile nu au ajuns la un stadiu în care să fie analizată concret posibilitatea accesului la modelele dezvoltate de companie, conform Reuters, citată de publicație. „În cazul uneia dintre ele (OpenAI), avem o companie care se oferă în mod proactiv să acorde acces. În cazul celeilalte (Anthropic), avem schimburi constructive, deși nu ne aflăm încă într-un stadiu în care să putem specula cu privire la un potențial acces sau nu.” De ce contează pentru reglementare și pentru companii Miza discuțiilor este una de reglementare și supraveghere: autoritățile europene încearcă să înțeleagă mai bine „riscurile și capacitățile” noilor modele de inteligență artificială, în special pe zona de funcții avansate care pot avea impact direct asupra securității și operațiunilor digitale. În mod specific, contextul invocat este legat de modele cu funcții avansate în: securitate cibernetică; automatizare. Ce urmează (și ce nu se știe încă) Din informațiile disponibile, discuțiile sunt în derulare, dar în cazul Anthropic nu există încă o bază pentru a anticipa dacă accesul va fi acordat sau în ce condiții. În cazul OpenAI, Comisia indică o deschidere mai mare din partea companiei, fără a detalia însă forma accesului sau calendarul. [...]