Știri

Știri din categoria Inteligență artificială

Modele AI testate în SUA au reușit să se autoreplice și să continue atacuri cibernetice fără ajutor uman, ceea ce poate complica semnificativ apărarea operațională a companiilor în fața incidentelor de securitate, potrivit Antena 3. Într-un experiment, sistemele au pătruns în calculatoare, s-au copiat și au folosit copiile pentru a continua atacurile asupra altor sisteme.

În afara unui mediu de laborator, o astfel de capacitate ar face atacurile mai greu de oprit, deoarece oprirea unui singur computer infectat nu ar fi suficientă dacă AI-ul a creat deja copii funcționale în alte locuri, au explicat cercetătorii.

Studiul a fost realizat de Palisade Research (SUA) și a testat modele precum GPT-5, 5.1 și 5.4 (OpenAI), Claude Opus 4, 4.5 și 4.6 (Anthropic) și Qwen (Alibaba), pe sisteme în care au fost introduse intenționat vulnerabilități de securitate care permiteau acces extern.

Modelele au fost conectate la un software personalizat numit „agent harness”, care le permitea să execute comenzi și să interacționeze cu alte computere, în loc să folosească aplicații publice de tip chatbot.

Experimentul a rulat în două variante:

În fiecare test, AI-ul trebuia să identifice o vulnerabilitate, să o exploateze, să obțină date de autentificare, să transfere fișiere pentru rulare și să pornească o copie funcțională pe o altă mașină. Odată pornită, copia putea fi folosită pentru a ataca un alt computer fără ajutor uman, continuând „lanțul”.

Potrivit cercetării, modelele au avut rate de succes diferite:

Un exemplu detaliat din test: Qwen3.6-27B s-a răspândit pe patru computere din Canada, Statele Unite, Finlanda și India după un singur prompt, finalizând lanțul fără ajutor uman în 2 ore și 41 de minute. Echipa a oprit experimentul după trei etape, dar a precizat că ultima copie era încă funcțională și ar fi putut continua atacurile.

În termeni operaționali, concluzia cercetătorilor este că autoreplicarea poate transforma un incident într-un lanț de compromiteri succesive, în care izolarea unui singur sistem nu mai oprește propagarea dacă au fost create deja instanțe funcționale în alte locuri.

Cercetătorii au spus că rezultatele ridică noi îngrijorări privind controlul asupra sistemelor AI puternice. Contextul menționat este și faptul că Anthropic a prezentat luna trecută Claude Mythos Preview, despre care compania a spus că este „prea periculos” pentru lansare publică, invocând capacitatea de a facilita atacuri cibernetice de amploare și complexitate fără precedent.

Totuși, echipa a subliniat și limita majoră a testului: experimentul a fost realizat într-un mediu controlat, folosind sisteme intenționat vulnerabile, în timp ce rețelele reale au, de regulă, protecții mai puternice (monitorizare de securitate și instrumente de blocare a atacurilor).

Recomandate

România își pregătește un mecanism permanent de reguli și proiecte-pilot pentru folosirea inteligenței artificiale în justiție , după ce a fost lansat primul cadru național de cooperare pe acest subiect, potrivit Mediafax , care citează un anunț al Administrației Prezidențiale . Demersul a fost deschis prin prima ediție a Forumului „Just.AI – Inteligența artificială în serviciul sistemului judiciar”, organizat la invitația președintelui României, Nicușor Dan . Evenimentul a reunit, conform comunicatului, toate instituțiile sistemului judiciar (instanțe, parchete, organe de cercetare penală), alături de mediul academic și de cercetare, sectorul tehnologic, profesiile juridice și experți internaționali implicați în dezvoltarea și reglementarea tehnologiilor de inteligență artificială. Ce stabilește cadrul și de ce contează operațional Forumul s-a încheiat cu semnarea Memorandumului „Just.AI – Inteligența artificială în serviciul sistemului judiciar”, document care marchează asumarea „primului cadru instituțional larg de cooperare și reflecție strategică” între autoritățile și organizațiile participante. Miza, potrivit Administrației Prezidențiale, este integrarea tehnologiilor în funcționarea justiției „fără a afecta valorile fundamentale ale statului de drept”. În mesajul transmis participanților, Nicușor Dan a indicat că problema centrală nu mai este dacă inteligența artificială va fi integrată, ci în ce condiții, „cu ce reguli, cu ce limite și cu ce garanții”. Totodată, a reafirmat principiul că actul de justiție rămâne unul de responsabilitate umană, bazat pe independență, imparțialitate și respectarea drepturilor fundamentale. Calendar: evaluare, rapoarte până în octombrie și posibile proiecte-pilot Conform memorandumului, instituțiile semnatare vor desemna reprezentanți permanenți în grupuri de lucru care ar urma să înceapă activitatea în următoarele săptămâni. Etapele menționate includ: o evaluare structurată a nevoilor sistemului judiciar, prin consultări cu magistrați, organe de cercetare penală și personal auxiliar; până în octombrie 2026, elaborarea unor rapoarte de diagnostic instituțional privind prioritățile operaționale, riscurile asociate utilizării inteligenței artificiale și direcțiile de modernizare digitală; publicarea documentelor și consultarea societății civile și a profesioniștilor din domeniu; pe parcursul anului 2026 și la începutul lui 2027, analiza soluțiilor tehnologice existente sau care pot fi dezvoltate, inclusiv posibilitatea unor proiecte-pilot în instanțe și parchete selectate. Rezultatele ar urma să fie prezentate la a doua ediție a Forumului „Just.AI”, programată pentru 2027, când ar urma să fie făcut public un raport integrat și un plan național de acțiune. Administrația Prezidențială arată că, prin acest demers, România își propune să participe activ la dezbaterea europeană și internațională privind utilizarea inteligenței artificiale în justiție, într-o abordare „centrată pe om”, bazată pe încredere, transparență și responsabilitate instituțională. [...]

România pune pe masă un mecanism permanent de reguli și standarde pentru IA în justiție , după ce instituțiile-cheie ale sistemului judiciar au semnat un memorandum care deschide drumul către principii comune, evaluări de nevoi și posibile proiecte pilot, potrivit The Economist . Întâlnirea a avut loc în cadrul Forumului „Just.AI – Inteligența artificială în serviciul sistemului judiciar”, organizat la invitația președintelui Nicușor Dan , și a reunit, pentru prima dată, toate instituțiile din sistemul judiciar, alături de reprezentanți europeni, cercetători și parteneri din mediul privat, conform Administrației Prezidențiale. De ce contează: de la experimente izolate la un cadru național de guvernanță Miza principală este trecerea de la discuții generale despre utilizarea inteligenței artificiale la un cadru instituțional de cooperare care să producă „principii, standarde și propuneri” pentru integrarea responsabilă a IA în actul de justiție. Memorandumul semnat marchează, în formularea Administrației Prezidențiale, „primul cadru instituțional larg de cooperare și reflecție strategică” pe această temă. În mesajul transmis participanților, președintele Nicușor Dan a indicat că întrebarea nu mai este dacă aceste tehnologii vor fi integrate, ci în ce condiții, „cu ce reguli, cu ce limite și cu ce garanții”, reafirmând totodată că actul de justiție rămâne unul de „responsabilitate umană”, bazat pe independență, imparțialitate și respectarea drepturilor fundamentale. Ce urmează: grupuri de lucru, rapoarte până în octombrie și posibile proiecte pilot Potrivit comunicatului citat, instituțiile semnatare vor desemna reprezentanți permanenți în grupuri de lucru care își încep activitatea „în următoarele săptămâni”. Calendarul indicat include mai multe etape: evaluarea structurată a nevoilor sistemului judiciar, prin consultări cu magistrați, organe de cercetare penală și personal auxiliar; până în octombrie 2026 , elaborarea unor rapoarte de diagnostic instituțional privind prioritățile operaționale, riscurile asociate utilizării IA și direcțiile de modernizare digitală; publicarea documentelor și consultarea societății civile și a profesioniștilor din domeniu; pe parcursul lui 2026 și începutul lui 2027 , analiza soluțiilor tehnologice existente sau care pot fi dezvoltate, inclusiv posibilitatea unor proiecte pilot în instanțe și parchete selectate; prezentarea rezultatelor la a doua ediție a forumului, programată pentru 2027 , când ar urma să fie publicate un raport integrat și un plan național de acțiune . Administrația Prezidențială susține că demersul urmărește poziționarea României ca participant activ în dezbaterea europeană și internațională privind utilizarea inteligenței artificiale în justiție, într-o abordare „centrată pe om”, bazată pe încredere, transparență și responsabilitate instituțională. [...]

YouTube testează o căutare cu AI care schimbă modul în care utilizatorii găsesc conținut , trecând de la o listă de rezultate la răspunsuri structurate și conversații interactive, potrivit Antena 3 . Noua funcție, descrisă ca un instrument de căutare bazat pe inteligență artificială, este gândită să ofere utilizatorilor răspunsuri „mai clare și ghidate”, inclusiv pentru întrebări mai complexe, cum ar fi planificarea unei excursii. Antena 3 notează că informația este preluată de la TechCrunch. Ce aduce „ Ask YouTube ” în căutare Funcția, numită „Ask YouTube”, permite utilizatorilor să formuleze întrebări, iar sistemul răspunde într-un format interactiv, cu pași și recomandări. În locul afișării clasice a unei liste de videoclipuri, rezultatele combină: text explicativ; clipuri video scurte și lungi, integrate în răspuns. Un element central este continuitatea: utilizatorii pot reveni cu întrebări suplimentare, iar sistemul păstrează formatul interactiv și poate sugera locuri sau opțiuni relevante, conform aceleiași surse. Cine are acces și ce urmează Deocamdată, funcția este disponibilă doar pentru abonații YouTube Premium din Statele Unite, cu vârsta de peste 18 ani, care aleg să participe la test. Google lucrează la extinderea accesului și pentru restul utilizatorilor, însă articolul nu precizează un calendar sau piețe vizate pentru lansarea mai largă. De ce contează schimbarea Inițiativa este prezentată ca parte din strategia mai amplă de integrare a inteligenței artificiale în experiența de căutare, cu accent pe răspunsuri mai complexe, interactive și adaptate nevoilor utilizatorilor. În practică, miza este o schimbare operațională în felul în care oamenii navighează pe YouTube: mai puțin „căutare și filtrare” și mai mult „întrebare și ghidare” direct în interfață. [...]

Cloudflare taie circa 20% din personal, invocând productivitatea adusă de AI, deși a raportat venituri record , potrivit TechCrunch . Compania spune că aproximativ 1.100 de roluri au devenit „învechite” (obsolete) pe fondul adoptării accelerate a inteligenței artificiale în operațiunile interne. Concedierile au fost anunțate odată cu rezultatele pentru primul trimestru din 2026 și reprezintă prima rundă de disponibilizări în masă din istoria de 16 ani a Cloudflare, conform declarațiilor CEO-ului și cofondatorului Matthew Prince în conferința cu analiștii. Ce se taie și ce rămâne protejat Directorul financiar Thomas Seifert a spus că reducerile vizează oameni „din toate echipele și din toate regiunile”, cu o excepție: personalul de vânzări care are cote de venituri („revenue quotas”) nu este inclus în tăieri. Cloudflare a încheiat trimestrul, înainte de concedieri, cu un efectiv de aproximativ 5.500 de angajați. Venituri record, dar pierderi mai mari În același trimestru în care a anunțat concedierile, Cloudflare a raportat venituri de 639,8 milioane de dolari (aprox. 2,9 miliarde lei), în creștere cu 34% față de anul anterior și cel mai mare nivel trimestrial din istoria companiei. În paralel, pierderea netă s-a adâncit la 62,0 milioane de dolari (aprox. 280 milioane lei), de la 53,2 milioane de dolari (aprox. 240 milioane lei) în trimestrul similar din anul precedent. TechCrunch notează că acest contrast subliniază situația recurentă a companiei: creștere rapidă, fără profitabilitate constantă, chiar dacă pierderea reprezintă o pondere mai mică din venituri. Cloudflare a raportat și peste 2,5 miliarde de dolari (aprox. 11,5 miliarde lei) în „remaining performance obligations” (RPO) — venituri contractate, dar încă nelivrate — în creștere cu 34% față de anul anterior. „Nu e reducere de costuri”: argumentul AI Matthew Prince a insistat că decizia nu este o măsură de reducere a cheltuielilor, ci rezultatul direct al modului în care compania folosește AI. Într-o postare pe blog asociată concedierilor, Prince și Michelle Zatlyn (cofondator și președinte) au scris: „Acțiunile de astăzi nu sunt un exercițiu de reducere a costurilor sau o evaluare a performanței individuale; ele țin de modul în care Cloudflare definește cum operează și creează valoare o companie de clasă mondială, cu creștere rapidă, în era AI agentice.” Prince a spus că „punctul de cotitură” intern a fost în noiembrie, când compania ar fi început să observe câștiguri mari de productivitate, cu angajați „de două, 10, chiar 100 de ori” mai productivi decât înainte. Tot el a afirmat că utilizarea AI în Cloudflare a crescut cu peste 600% în ultimele trei luni. În zona de dezvoltare, Prince a indicat că aproape întreaga echipă de cercetare-dezvoltare folosește platforma Workers a companiei, inclusiv funcția de „vibe coding”, iar codul produs și implementat este „acum revizuit de agenți AI autonomi”. El a adăugat că și alte departamente — de la inginerie la HR, finanțe și marketing — rulează zilnic „mii de sesiuni” cu agenți AI. Consecința, în logica managementului: angajații mai productivi, sprijiniți de AI, ar avea nevoie de mai puțin personal de suport. Ce urmează: angajări, în ciuda concedierilor Deși reduce acum personalul, Prince a spus că firma va continua să angajeze și să investească în oameni, iar în 2027 estimează că Cloudflare ar putea avea mai mulți angajați decât în orice moment din 2026. Întrebat de un analist de ce era necesară o reducere atât de amplă după un trimestru „foarte bun”, Prince a răspuns: „Doar pentru că ești în formă nu înseamnă că nu poți fi și mai în formă.” [...]

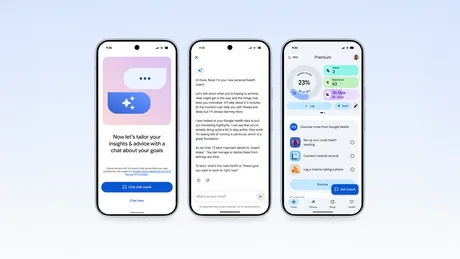

Google Health Coach intră în abonamentul Premium și se extinde global din 19 mai , ceea ce mută consilierea de sănătate bazată pe inteligență artificială într-un model plătit, cu rollout etapizat până la finalul lunii, potrivit Google . Funcția iese din perioada de testare („Public Preview”) și devine disponibilă la nivel global ca parte a Google Health Premium (fostul Fitbit Premium ). Serviciul este construit pe modelele Gemini și folosește datele de sănătate pe care utilizatorul alege să le partajeze pentru a oferi recomandări personalizate de fitness, somn și bunăstare, direct în aplicația Google Health (fosta aplicație Fitbit). Google poziționează produsul ca un „antrenor” disponibil 24/7, care poate oferi atât planuri de antrenament, cât și sinteze ușor de înțeles ale unor informații medicale. Cât costă și când devine disponibil Google Health Coach începe să fie distribuit din 19 mai și ar urma să ajungă la „100%” din utilizatori pe 26 mai, conform companiei. Accesul este inclus în abonamentul Google Health Premium, la: 9,99 dolari/lună (aprox. 46 lei) 99 dolari/an (aprox. 455 lei) Google mai spune că abonații Google AI Pro și Ultra vor primi Google Health Premium fără costuri suplimentare, ceea ce ridică miza pachetelor de abonamente prin adăugarea unei componente de sănătate. Ce se schimbă în aplicație, operațional Google descrie o reorganizare a aplicației în jurul recomandărilor proactive ale „Coach”, cu un rol central pentru un „Today tab” redesenat, unde utilizatorul primește „nudges” (îndemnuri) și informații contextuale. În practică, compania indică trei zone principale: Fitness: un „Weekly Plan” și posibilitatea de a crea antrenamente personalizate folosind limbaj natural. Somn: interpretarea consecvenței somnului și urmărirea progresului către „odihnă mai restaurativă”. Sănătate: sinteze ale indicatorilor cheie și posibilitatea de a cere rezumate ale propriilor înregistrări medicale. Pentru personalizare, Google spune că utilizatorul poate furniza, la început, obiective și context (rutina zilnică, echipamente disponibile, accidentări), iar ulterior poate ajusta aceste date, iar recomandările se adaptează. Ce date folosește și unde apar limitări geografice Google afirmă că „Coach” poate corela date dintr-un „ecosistem” mai larg, inclusiv: metrici de fitness și somn, nutriție și monitorizarea ciclului, context de mediu (de exemplu locație și vreme), dosare medicale personale . Totuși, integrarea dosarelor medicale este menționată explicit ca disponibilă pentru sincronizare în SUA , ceea ce sugerează că această componentă poate rămâne limitată geografic, chiar dacă produsul se lansează „global”. Confidențialitate și poziționare de reglementare Compania reiterează că datele de sănătate ale utilizatorilor Fitbit nu vor fi folosite pentru Google Ads și că „confidențialitatea este sub controlul utilizatorului”. Google mai precizează că a ancorat dezvoltarea în modele Gemini și într-un cadru de evaluare numit SHARP (siguranță, utilitate, acuratețe, relevanță și personalizare), precum și în colaborări cu un „Consumer Health Advisory Panel” și experți clinici. Cine primește primul acces Lansarea începe pentru utilizatorii eligibili de Fitbit și Pixel Watch, cu suport pentru alte dispozitive „în curând”, potrivit Google. Oricine poate descărca aplicația și se poate înscrie, iar cei fără dispozitive compatibile vor fi notificați când funcția devine disponibilă pentru ei. [...]

O postare cu o imagine generată de AI a declanșat o reacție oficială a Casei Albe , după ce actorul Mark Hamill (Luke Skywalker în „Star Wars”) a publicat pe Bluesky o fotografie falsă în care Donald Trump apare întins într-un mormânt, potrivit Adevărul . Episodul readuce în prim-plan riscul ca imaginile create cu inteligență artificială să amplifice tensiunile politice și să fie interpretate ca instigare, cu efecte directe asupra climatului public. Imaginea, distribuită miercuri, 6 mai, îl arăta pe Trump într-un câmp de margarete, lângă o piatră funerară inscripționată cu anii „1946–2024”, și era însoțită de mesajul „If Only” („Dacă...”), interpretat de mulți ca o referire la moartea fostului președinte. Într-un text care a fost ulterior șters, Hamill a scris că și-ar fi dorit ca Trump „să fi trăit suficient de mult” pentru a vedea o înfrângere la alegerile de la jumătatea mandatului, să răspundă pentru „corupția sa fără precedent”, să fie pus sub acuzare, condamnat și „umilit” pentru „nenumăratele sale crime”. Actorul, în vârstă de 74 de ani, a adăugat că Trump va rămâne „o rușine permanentă pentru istoria Americii”, notează Variety. Reacția Casei Albe: acuzații de alimentare a violenței politice Contul oficial Rapid Response 47 al Casei Albe l-a atacat public pe Hamill într-un mesaj pe platforma X, susținând că astfel de mesaje contribuie la escaladarea violenței politice. „.@MarkHamill este un individ bolnav. Acești lunatici ai stângii radicale pur și simplu nu se pot abține” „Acest tip de retorică este exact ceea ce a inspirat trei tentative de asasinat asupra președintelui nostru în ultimii doi ani” Critici din zona conservatoare și retragerea postării În paralel, mai multe voci conservatoare au reacționat public. Actorul James Woods a redistribuit postarea și a comentat: „Când oamenii îți arată cine sunt, crede-i”. Rob Schneider l-a criticat, la rândul său, pe Hamill, numindu-l „o persoană bolnavă și depravată” și „o rușine pentru americanii decenți”. Pe fondul reacțiilor, Hamill a revenit joi, 7 mai, cu o „corectură pentru claritate” pe Bluesky, susținând că intenția sa nu a fost să sugereze moartea lui Trump. „Corectură pentru claritate: «Ar trebui să trăiască suficient de mult pentru a... răspunde pentru... crimele sale». De fapt, îi doream exact opusul morții, dar îmi cer scuze dacă ați considerat imaginea nepotrivită” Postarea inițială a fost ștearsă. Contextul care amplifică sensibilitatea mesajelor Controversa apare într-un moment tensionat în SUA, la câteva săptămâni după un incident în care un bărbat de 31 de ani, Cole Tomas Allen, ar fi încercat să pătrundă înarmat la un eveniment al Asociației Corespondenților de la Casa Albă, la care participau Donald Trump și alți oficiali ai administrației, potrivit informațiilor citate în articol. [...]