Știri

Știri din categoria Inteligență artificială

Administrația Trump transmite un semnal de detensionare în disputa cu Anthropic, ceea ce poate redeschide accesul companiei la contracte de apărare și la piața federală de AI, potrivit Adevărul, care citează relatările Reuters.

Declarațiile vin după ce, la începutul anului, instituțiile federale au fost obligate să înceteze colaborarea cu Anthropic, iar Departamentul Apărării (Pentagonul) a inclus compania pe lista entităților considerate risc pentru lanțul de aprovizionare, notează Reuters, citată de News.ro. În acest context, Donald Trump a spus că Anthropic „își revine” și a lăsat deschisă posibilitatea unei colaborări viitoare cu Pentagonul.

Într-un interviu pentru CNBC, Trump a afirmat că reprezentanții companiei „au avut discuții foarte bune” la Washington și că firma „își revine”, adăugând că un acord cu Pentagonul nu este exclus. Pentru o companie de inteligență artificială, o schimbare de ton la nivelul administrației poate însemna, practic, reluarea accesului la proiecte sensibile și bugete mari, în special pe zona de securitate cibernetică.

Anthropic a transmis că discuțiile cu administrația s-au concentrat pe:

Anthropic a contestat în instanță decizia de includere pe lista de risc, iar directorul general Dario Amodei s-a întâlnit recent cu oficiali de la Casa Albă pentru a detensiona relația. Casa Albă a descris discuțiile drept „productive și constructive”.

Tensiunile au apărut după ce Anthropic a cerut garanții că tehnologia sa nu va fi folosită pentru supravegherea cetățenilor americani sau pentru operarea de arme autonome. Potrivit sursei, interdicția Pentagonului blochează utilizarea instrumentelor AI ale companiei în Departamentul Apărării, cu excepții limitate pentru situații de securitate națională.

Separat, la începutul acestei luni, o curte federală de apel din Washington a refuzat să suspende temporar includerea Anthropic pe lista de risc, un rezultat favorabil administrației în litigiul aflat în derulare.

Deși mesajul lui Trump este cel mai explicit de până acum privind o posibilă apropiere, situația rămâne condiționată de cadrul administrativ și de procesul în curs. În paralel, compania a prezentat Mythos, un model AI avansat capabil să identifice vulnerabilități cibernetice; versiunea de test nu va fi disponibilă publicului, iar Anthropic a lansat Project Glasswing, un program de testare privată pentru instituții și companii mari.

Recomandate

Băncile europene ar putea primi în zilele următoare acces la modelul IA „Mythos”, dar implementarea vine cu riscuri de securitate cibernetică și cu presiune din partea autorităților de reglementare pentru controale mai stricte, potrivit Agerpres , care citează informații Reuters. Extinderea accesului la „Mythos”, modelul de inteligență artificială al start-up-ului american Anthropic , ar urma să vizeze bănci din Europa și Marea Britanie, într-un moment în care instituțiile financiare încearcă să țină pasul cu rivalii din SUA, care au primit deja acces inițial la tehnologie. Ce se știe despre calendar și condițiile de acces Surse apropiate dosarului au indicat că accesul pentru băncile europene ar putea fi acordat „în câteva zile”, însă o altă estimare menționează că implementarea ar putea dura „zile sau săptămâni”. Procesul include verificări pentru a se asigura că modelul este implementat în siguranță, potrivit uneia dintre surse. Bloomberg a relatat anterior că Anthropic va oferi în curând acces la „Mythos” pentru instituții financiare din Marea Britanie. De ce contează: avertismente pe zona de securitate și atenție sporită a regulatorilor Experți în securitate cibernetică avertizează că „Mythos” ridică provocări importante pentru industria bancară și pentru sistemele tehnologice existente, context în care au apărut avertismente din partea organismelor de reglementare și a decidenților prezenți la reuniunea de primăvară a Fondului Monetar Internațional. Pe fondul acestor preocupări, autoritățile de reglementare se grăbesc să evalueze riscurile de securitate cibernetică asociate noului model de inteligență artificială, în timp ce băncile încearcă să recupereze decalajul față de instituțiile care au intrat mai devreme în testare. Cine are deja acces și cum s-a făcut selecția Anthropic a oferit inițial acces la „Mythos” partenerilor din inițiativa „Project Glasswing” și altor aproximativ 40 de organizații care dezvoltă sau întrețin infrastructură software critică. Dintre bănci, JPMorgan Chase (parte din inițiativa Glasswing) este singura instituție despre care Anthropic a spus public că are acces la „Mythos”. În același timp, Bank of America a fost în Glasswing încă de la început și a testat intern tehnologia, potrivit unei surse citate. Presiune pentru „teren de joc” egal în industrie Joachim Nagel, președintele Bundesbank (Banca Centrală a Germaniei), a cerut ca toate instituțiile să aibă acces la „Mythos” pentru a asigura condiții concurențiale echitabile și pentru a evita utilizarea abuzivă a modelului. [...]

Sam Altman acuză că Anthropic folosește „marketing bazat pe frică” pentru a justifica accesul restrâns la modelul său de securitate cibernetică Mythos , într-un nou episod al rivalității dintre cele două laboratoare, potrivit TechCrunch . Anthropic a anunțat Mythos la începutul lunii și l-a pus la dispoziția unui grup restrâns de clienți din zona enterprise. Compania susține că modelul ar fi „prea puternic” pentru a fi lansat public, invocând riscul ca infractorii cibernetici să îl transforme într-o armă. Critici ai acestei poziționări au spus că retorica este exagerată. Într-o apariție la podcastul „Core Memory”, Altman a sugerat că această abordare ar fi o modalitate de a păstra inteligența artificială în mâinile unui cerc mic și exclusiv. „Există oameni în lume care, pentru mult timp, au vrut să păstreze IA în mâinile unui grup mai mic de oameni. Poți justifica asta în multe feluri diferite.” Altman a mers mai departe cu o comparație menită să ilustreze mecanismul comercial din spatele mesajului, descriindu-l drept „marketing incredibil” să pretinzi că ai construit „o bombă” și apoi să vinzi „un adăpost anti-bombă” extrem de scump. De ce contează: controlul accesului devine argument comercial Miza nu este doar schimbul de replici dintre competitori, ci modul în care „siguranța” și riscul de abuz sunt folosite pentru a stabili cine primește acces la modele avansate și în ce condiții. În cazul Mythos, justificarea pentru distribuția limitată este tocmai potențiala utilizare malițioasă, iar Altman atacă direct această logică, sugerând că poate funcționa și ca instrument de poziționare și vânzare către clienți mari. Context: „frica” ca instrument recurent în industria IA TechCrunch notează că „marketingul bazat pe frică” nu este o invenție a Anthropic și că o parte semnificativă a industriei a folosit, în timp, tactici de alarmare și hiperbolă pentru a-și prezenta produsele ca fiind foarte puternice. Publicația amintește, totodată, că retorica despre riscuri extreme ale IA nu a venit doar de la activiști, ci și de la cei care vând această tehnologie publicului — inclusiv Altman. [...]

John Ternus , viitorul CEO al Apple, a început deja să reconfigureze operațiunile interne ale companiei printr-o „platformă nouă de AI”, cu obiectivul de a accelera dezvoltarea produselor și de a îmbunătăți calitatea dispozitivelor , potrivit 9to5Mac , care citează un raport Bloomberg. Schimbarea descrisă vizează în primul rând zona de inginerie hardware: conform lui Mark Gurman (Bloomberg), Ternus ar fi reorganizat, la începutul lunii, structura organizației de inginerie hardware „în jurul” unei noi platforme de inteligență artificială. Miza, așa cum este prezentată în raport, este una operațională: reducerea timpilor de dezvoltare și creșterea calității, prin folosirea AI în procese interne, nu doar în produse. Ce se știe concret și ce rămâne neclar Din informațiile publicate nu rezultă detalii tehnice despre ce este această „platformă nouă de AI” sau cum funcționează, iar 9to5Mac notează explicit lipsa de informații despre implementare. Totuși, raportul indică intenția de a extinde rapid utilizarea AI „în întreaga companie” pentru îmbunătățirea operațiunilor, iar debutul din divizia hardware ar fi doar primul pas. Context: AI ca instrument intern, nu doar funcție pentru utilizatori Materialul amintește că Gurman a relatat anterior că Apple se bazează semnificativ pe Anthropic pentru diverse componente ale dezvoltării de produse, însă, în rest, au existat puține informații publice despre modul în care Apple implementează AI în interiorul organizației. În acest cadru, reorganizarea condusă de Ternus sugerează o accelerare a folosirii AI ca instrument de productivitate și control al calității în lanțul de dezvoltare. De ce contează pentru business Dacă direcția se confirmă, integrarea AI în operațiuni poate deveni un factor direct de eficiență: cicluri de dezvoltare mai scurte și o calitate mai bună pot influența costurile, ritmul lansărilor și, implicit, competitivitatea. Deocamdată, impactul exact nu poate fi cuantificat din datele disponibile, deoarece nu sunt publicate detalii despre capabilități, calendar sau arii precise de implementare. [...]

Google își mobilizează conducerea și resursele interne pentru a recupera decalajul față de Anthropic la „agenți” de programare , potrivit TechRadar , care relatează despre un memo intern atribuit cofondatorului Sergey Brin și despre formarea unui „strike team” dedicat îmbunătățirii capabilităților Gemini în „agentic execution” (execuție autonomă de sarcini, în special scriere și finalizare de cod). Miza este una operațională: dacă Gemini rămâne în urmă la agenți care pot produce „cod final”, Google riscă să piardă viteză în dezvoltarea internă de software și, pe termen mai lung, în cursa pentru automatizarea muncii de cercetare în AI. „Strike team” pentru agenți de cod: presiune pe Gemini Conform unui reportaj The Information, citat de TechRadar, Google ar fi creat o echipă specială („strike team”) pentru a contracara progresul Anthropic și al agentului său Claude Code . În memo-ul menționat, Brin le-ar fi transmis inginerilor și cercetătorilor AI că Google trebuie să reducă rapid diferența: „Pentru a câștiga sprintul final, trebuie să reducem urgent decalajul în execuția agentică și să transformăm modelele noastre în dezvoltatori principali” ai codului final. Aceeași relatare susține că Sergey Brin și Koray Kavukcuoglu, director tehnologic la Google DeepMind, ar fi implicați direct în acest efort, semnalând importanța proiectului la nivelul conducerii. De ce e posibil să nu ajungă la public Direcția pare să fie, în primul rând, îmbunătățirea capacității Gemini de a lucra cu codul intern al Google. Asta ar crește performanța instrumentelor folosite de inginerii și cercetătorii companiei, însă ar reduce șansele ca rezultatul să fie lansat rapid ca produs public: dacă un agent este antrenat pe cod proprietar, publicarea lui devine dificilă. TechRadar notează totuși că instrumentele interne îmbunătățite „ar putea teoretic” să ajute ulterior la construirea unor modele mai bune care să poată fi lansate public. Context: „AI takeoff” și automatizarea cercetării Dincolo de competiția directă cu Anthropic, The Information (citat de TechRadar) indică un obiectiv mai ambițios: „AI takeoff”, adică sisteme AI capabile să se îmbunătățească. În această logică, un agent avansat de programare, combinat cu AI care rezolvă probleme de matematică și rulează experimente, ar putea automatiza la scară mare munca cercetătorilor și inginerilor AI. În acest moment, rămâne neclar dacă rezultatele „strike team”-ului vor fi vizibile în produse pentru utilizatorii externi sau vor rămâne, cel puțin inițial, un avantaj strict intern. [...]

Amazon își securizează pe 10 ani cererea de calcul pentru AI printr-un acord care poate duce investiția în Anthropic la 33 mld. dolari (aprox. 151 mld. lei), în schimbul unui angajament de peste 100 mld. dolari (aprox. 460 mld. lei) cheltuieli cloud pe AWS, potrivit The Next Web . Amazon a convenit să investească „până la” 25 mld. dolari în Anthropic, compania din spatele modelelor Claude, însă structura tranzacției arată că nu este vorba de un cec integral: 5 mld. dolari sunt investiți imediat, iar până la 20 mld. dolari sunt condiționați de atingerea unor obiective comerciale. Suma se adaugă celor 8 mld. dolari pe care Amazon îi angajase deja din 2023, ceea ce ridică investiția potențială totală la circa 33 mld. dolari (aprox. 152 mld. lei). În paralel, Anthropic își asumă un angajament de peste 100 mld. dolari pentru AWS pe următorul deceniu, dar publicația precizează că acesta este un „angajament de achiziție” (procurement pledge), nu o plată în avans: compania se obligă să cumpere capacitate de calcul, cipuri personalizate pentru AI și servicii de infrastructură de la Amazon. Practic, Amazon finanțează Anthropic, iar Anthropic direcționează o parte semnificativă din acești bani către infrastructura Amazon. De ce contează: AWS își blindează cererea și împinge Trainium în centrul AI-ului „frontieră” Miza operațională a acordului este capacitatea de calcul și, implicit, controlul lanțului de aprovizionare pentru antrenarea și rularea modelelor. În centrul înțelegerii se află Trainium, linia de cipuri dezvoltată intern de Amazon ca alternativă la GPU-urile Nvidia pentru antrenare și inferență (rularea modelelor). Acordul acoperă Trainium2, viitorul Trainium3 și Trainium4 (încă nelansat), plus „zeci de milioane” de nuclee CPU Graviton. Anthropic obține până la 5 gigawați de capacitate pentru a antrena și a rula Claude. Amazon afirmă că o capacitate semnificativă Trainium2 intră în funcțiune în trimestrul al doilea din 2026, iar până la finalul anului ar urma să fie disponibil aproape 1 gigawatt combinat Trainium2 și Trainium3. Context: creșterea Anthropic și consolidarea distribuției prin AWS Acordul vine pe fondul unei cereri în creștere rapide, pe care Anthropic o leagă de evoluția veniturilor: compania a ajuns la venituri anualizate de 30 mld. dolari, de la aproximativ 9 mld. dolari la final de 2025. Parteneriatul se adâncește și pe distribuție: clienții AWS vor putea accesa „întreaga Claude Platform” (interfața nativă a Anthropic) direct din conturile lor AWS, fără acreditări sau facturare separate. Este un pas peste disponibilitatea Claude prin Amazon Bedrock, „piața” de AI gestionat a Amazon. În același timp, Claude rămâne, potrivit sursei, singurul model „frontieră” disponibil pe toate cele trei mari platforme cloud: AWS Bedrock, Google Cloud Vertex AI și Microsoft Azure Foundry. Raportul de forțe: Amazon devine partenerul principal de infrastructură The Next Web notează că structura este similară cu un acord de acum două luni, când Amazon ar fi investit 50 mld. dolari în OpenAI în cadrul unui angajament comparabil de 100 mld. dolari pentru cloud. În cazul Anthropic, acordul cu AWS „surclasează” o înțelegere separată din noiembrie 2025, când Microsoft a investit până la 5 mld. dolari în Anthropic, iar compania s-a angajat să cumpere 30 mld. dolari capacitate de calcul pe Azure. Noua înțelegere cu AWS „stabilește ferm Amazon” ca partenerul principal de infrastructură al Anthropic, potrivit articolului. Evaluarea folosită pentru investiția inițială este cea mai recentă evaluare a Anthropic, de 380 mld. dolari. Publicația mai menționează că fonduri de capital de risc ar fi oferit finanțare la evaluări de 800 mld. dolari sau mai mult înaintea unei posibile listări, însă nu a fost anunțată o astfel de rundă. [...]

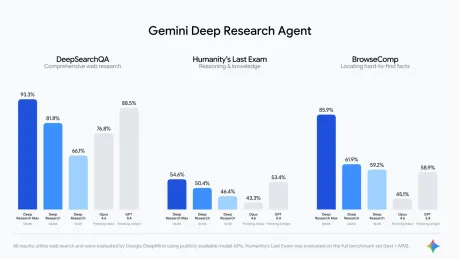

Google își mută agentul de „cercetare” spre fluxuri de lucru enterprise, permițând conectarea la date proprietare și generarea nativă de grafice odată cu lansarea Deep Research și Deep Research Max , construite pe modelul Gemini 3.1 Pro , potrivit IT之家 . Noile versiuni marchează o schimbare de poziționare: de la un instrument orientat în principal spre rezumate și căutare, la o componentă de bază pentru procese de lucru în companii, cu accent pe acces la surse de date specializate și pe livrarea rezultatelor în formate vizuale „gata de folosit”. Două moduri de utilizare: interactiv vs. „în fundal” Conform descrierii citate de publicație dintr-o postare Google din 21 aprilie, Deep Research este gândit pentru scenarii interactive, unde contează echilibrul între viteză și eficiență. Deep Research Max vizează fluxuri de lucru asincrone, rulate în fundal, precum generarea de rapoarte detaliate de tip due diligence (analiză aprofundată înaintea unei decizii de investiție sau achiziție), unde obiectivul este „cea mai mare acoperire” și calitatea maximă a sintezei. Pentru varianta Max, Google indică utilizarea unei „capacități extinse de calcul în timpul testării” (test-time compute), pentru raționare iterativă, căutare și rafinare. Conectare la surse de date proprietare prin MCP Elementul cu impact operațional direct este extinderea surselor de date pe care agentul le poate folosi. Ambele versiuni, bazate pe Gemini 3.1 Pro, pot: căuta pe web; accesa orice server MCP la distanță (MCP este un mecanism de conectare la servicii/surse externe, menționat în material ca modalitate de integrare sigură); folosi fișiere încărcate de utilizator; conecta spații de stocare de fișiere deja legate. Prin MCP, utilizatorii pot conecta agentul, „în siguranță”, la fluxuri profesionale de date — de exemplu date financiare sau de piață — astfel încât acesta să poată naviga baze de date specializate, nu doar să funcționeze ca un motor de căutare pe internet. Ieșiri vizuale și control mai bun al procesului Pe partea de rezultate, agentul poate genera nativ grafice și infografice de calitate, pentru vizualizarea dinamică a datelor complexe, potrivit informațiilor preluate de IT之家. La nivel de control și transparență, sunt menționate funcții precum planificare colaborativă, un set extins de instrumente, o bază de cercetare multimodală și ieșire în timp real (streaming). Utilizatorii pot revizui, ghida și optimiza planul de cercetare înainte de execuție și pot combina instrumente precum Google Search, servere MCP la distanță și execuție de cod. [...]