Știri

Știri din categoria Inteligență artificială

OpenAI marchează 10 ani de existență, după ce a transformat radical industria tehnologică prin lansarea ChatGPT, însă întrebarea rămâne dacă organizația și-a îndeplinit promisiunea inițială de a dezvolta o inteligență artificială generală care să „beneficieze întreaga umanitate”.

Fondată la finalul anului 2015 ca organizație non-profit, OpenAI a fost creată de un grup de lideri din tehnologie, printre care Sam Altman, Elon Musk, Ilya Sutskever, Greg Brockman, Wojciech Zaremba și John Schulman, beneficiind de finanțare importantă din partea lui Peter Thiel, Reid Hoffman și a unor companii precum Microsoft și Amazon Web Services. Obiectivul declarat al inițiativei a fost dezvoltarea unei inteligențe artificiale care să aducă beneficii întregii umanități.

Lansarea ChatGPT, în noiembrie 2022, a reprezentat punctul de inflexiune. Instrumentul a popularizat inteligența artificială generativă la scară globală și a determinat o reașezare rapidă a strategiilor în marile companii tehnologice. Susținut financiar și strategic de Microsoft, OpenAI a devenit un actor central în integrarea modelelor AI în produse comerciale.

Reacția competiției a fost rapidă. Google, de exemplu, a accelerat reorganizarea echipelor interne pentru a recupera decalajul în domeniul AI generative, într-un context în care ChatGPT a devenit cel mai popular chatbot de pe piață.

În doar un deceniu, OpenAI a trecut de la statutul de laborator de cercetare la o companie profund integrată în ecosistemul tehnologic global. Modelele sale stau la baza unor produse utilizate zilnic de milioane de oameni și companii.

În ultimii ani, relația cu Microsoft a evoluat, iar apropierea de alte grupuri din industrie, precum Oracle, indică o tendință de diversificare și consolidare a independenței strategice.

Obiectivul declarat – dezvoltarea unei inteligențe artificiale generale care să aducă beneficii întregii umanități – rămâne ambițios și încă nerealizat. Deși progresele tehnologice sunt evidente, dezbaterea privind impactul social, etic și economic al acestor sisteme este mai intensă ca oricând.

La zece ani de la înființare, OpenAI nu mai este un experiment idealist, ci un actor dominant într-o industrie aflată în plină expansiune. Rămâne însă de văzut dacă evoluția sa va confirma promisiunea fondatoare sau va redefini sensul acesteia într-un peisaj tehnologic tot mai competitiv.

Recomandate

OpenAI își fixează ca obiectiv să împiedice concentrarea „puterii tehnologice” în mâinile câtorva actori și să ducă instrumente de tip AGI (inteligență artificială generală) către cât mai mulți oameni, potrivit unei postări semnate de CEO-ul Sam Altman și relatate de IT之家 . Mesajul conturează o direcție cu implicații de reglementare și guvernanță: deciziile-cheie despre AI ar trebui să fie luate prin procese „democratice” și pe baze de echitate, nu doar în interiorul laboratoarelor de AI. Altman susține că AI poate produce transformări mai mari decât cele aduse de motorul cu aburi sau electricitate, dar avertizează că acest rezultat „nu este inevitabil”. În viziunea lui, viitorul poate arăta fie ca o lume în care câteva companii care controlează „superinteligența” acumulează putere, fie ca una în care tehnologia este mai descentralizată și ajunge la public. Cele cinci principii enunțate de Altman OpenAI își leagă misiunea de ideea că AGI trebuie să „beneficieze întreaga umanitate” și formulează cinci principii: Democratizare : compania spune că va rezista scenariului în care tehnologia concentrează puterea la un număr mic de persoane/organizații. Nu e vorba doar de acces la utilizare, ci și de faptul că deciziile importante despre AI ar trebui stabilite prin proceduri democratice și principii de echitate, nu exclusiv de laboratoare. Împuternicire (empowerment) : AI ar trebui să ajute utilizatorii să-și atingă obiectivele și să realizeze sarcini tot mai valoroase. OpenAI afirmă că va oferi autonomie largă utilizatorilor, dar cu responsabilitatea de a construi și implementa AI astfel încât să minimizeze daunele (de la riscuri „catastrofale” la efecte locale și impact social „coroziv”). Prosperitate împărtășită : Altman spune că, pentru ca beneficiile să fie distribuite larg, guvernele ar putea avea nevoie să ia în calcul noi modele economice , iar industria să construiască infrastructură AI la scară mare și să dezvolte tehnologii care să reducă semnificativ costurile. Reziliență : OpenAI anticipează apariția de riscuri noi și spune că va colabora cu companii, guverne și societatea civilă, inclusiv pe teme precum biosecuritatea și securitatea cibernetică. Altman afirmă că niciun laborator nu poate asigura singur un „viitor bun” și dă exemplul modelelor suficient de puternice care ar putea facilita crearea de noi agenți patogeni, ceea ce ar necesita măsuri defensive la nivel de societate. Adaptabilitate : compania ar urma să-și ajusteze strategia pe măsură ce apar informații noi și să fie transparentă când își schimbă principiile operaționale. Altman indică posibilitatea unor compromisuri între „împuternicire” și „reziliență” în anumite perioade. Ce înseamnă, practic, pentru piață și autorități Dincolo de declarația de principii, mesajul introduce explicit ideea că guvernanța AI nu ar trebui să rămână exclusiv la nivelul companiilor care dezvoltă modelele. Accentul pus pe „democratizare”, pe colaborarea cu guverne și instituții internaționale și pe posibile „noi modele economice” sugerează o discuție mai amplă despre cum se distribuie accesul la capacități avansate de calcul și cine decide regulile de utilizare. Altman mai spune că OpenAI va continua strategia de „implementare iterativă” (lansări treptate), pentru ca societatea să se poată adapta gradual la fiecare nou nivel de capabilități, și că în anumite momente ar putea fi necesară coordonarea cu guverne, organisme internaționale și alte proiecte AGI înainte de a continua dezvoltarea, după rezolvarea problemelor serioase de aliniere, siguranță sau impact social. [...]

Cazul Tumbler Ridge pune presiune pe reglementare, după ce OpenAI a ales să nu alerteze poliția deși propriile sisteme au semnalat un risc : Sam Altman a transmis o scrisoare de scuze comunității din British Columbia, iar compania spune că și-a schimbat intern pragurile de raportare, însă măsurile rămân voluntare, într-un context în care Canada nu are o obligație legală pentru firmele de AI de a raporta amenințări identificate pe platformele lor, potrivit The Next Web . Altman afirmă în scrisoare că îi pare „profund rău” că OpenAI nu a alertat autoritățile cu privire la un cont blocat în iunie 2025, după ce sistemele companiei l-au semnalat. Scrisoarea este datată 23 aprilie și a fost făcută publică o zi mai târziu, la 72 de zile după atacul armat din 10 februarie din Tumbler Ridge, descris drept cel mai grav atac armat într-o școală din Canada din 1989 încoace. Ce a știut OpenAI și de ce nu a raportat Conform relatării, detecția automată a OpenAI a semnalat în iunie 2025 contul de ChatGPT al lui Jesse Van Rootselaar, atunci în vârstă de 18 ani. Aproximativ o duzină de angajați au revizuit conversațiile, care descriau scenarii cu violență armată, iar o parte dintre ei au recomandat contactarea poliției canadiene. Conducerea a respins recomandarea, invocând un „prag mai ridicat” pentru raportarea amenințărilor credibile și iminente; contul a fost închis, iar conversațiile au fost păstrate intern. Poliția nu a fost contactată. Atacul a avut loc opt luni mai târziu. Potrivit articolului, opt persoane au fost ucise și 27 rănite; autorul s-a sinucis la școală. OpenAI nu l-a mai detectat după ce acesta și-a făcut un al doilea cont, până când Poliția Călare Regală Canadiană (RCMP) a făcut public numele. Publicația notează că The Wall Street Journal a relatat prima dată disputa internă privind decizia de a nu raporta. Scrisoarea de scuze: fără angajamente concrete În scrisoarea adresată comunității, Altman spune că se gândește la cei afectați și reafirmă un angajament general de a lucra cu guvernele pentru a preveni tragedii similare. În același timp, materialul subliniază că scrisoarea nu include: angajamente de politică publică sau operaționale detaliate; o descriere a schimbărilor pe care OpenAI le-ar face; recunoașterea faptului că angajați au recomandat raportarea și au fost contraziși de conducere. Premierul provinciei British Columbia, David Eby, a numit scuzele „necesare”, dar „grosolan insuficiente” raportat la impactul asupra familiilor. Primarul din Tumbler Ridge, Darryl Krakowka, a confirmat primirea scrisorii și a cerut „grijă și considerație” pentru comunitate în perioada de doliu. Ce spune OpenAI că a schimbat și de ce contează pentru reglementare Angajamentele de politică au venit separat, într-o scrisoare a vicepreședintei pentru politici globale a OpenAI, Ann O’Leary, către miniștri federali canadieni. Compania afirmă că: a coborât pragul de raportare, astfel încât un utilizator nu mai trebuie să discute explicit „ținta, mijloacele și momentul” pentru ca un caz să fie trimis către forțele de ordine; a implicat experți în sănătate mintală și comportament pentru evaluarea cazurilor semnalate; a stabilit un punct de contact direct cu RCMP. O’Leary susține că, în baza politicilor actualizate, interacțiunile lui Van Rootselaar „ar fi fost trimise poliției” dacă ar fi fost descoperite astăzi. Totuși, articolul insistă asupra limitării-cheie: schimbările sunt voluntare, nu sunt obligatorii prin lege și pot fi inversate. „Golul” legal din Canada și ce urmează Potrivit sursei, Canada nu are în prezent o lege care să oblige companiile de inteligență artificială să raporteze amenințări identificate prin platformele lor, iar guvernul federal nu a introdus încă una. Ministrul canadian al AI, Evan Solomon, a spus că angajamentele OpenAI „nu merg suficient de departe”. În paralel, miniștri federali din mai multe portofolii au avut întâlniri cu reprezentanți OpenAI după ce guvernul a convocat conducerea companiei la finalul lunii februarie. Un grup de lucru comun între Innovation, Science and Economic Development Canada și Public Safety Canada analizează protocoale de raportare pentru siguranța AI, cu recomandări preliminare așteptate până în vara lui 2026. Miza, în lectura The Next Web, este una de reglementare și responsabilitate: în lipsa unui standard extern, deciziile de a raporta sau nu rămân la latitudinea companiilor, chiar și atunci când sistemele lor semnalizează potențiale riscuri grave. [...]

Procesul dintre Elon Musk și Sam Altman riscă să complice planurile OpenAI de listare și să pună sub presiune modelul său de guvernanță, într-un moment în care compania este așteptată să iasă pe bursă la o evaluare de circa 1.000 de miliarde de dolari, potrivit The Guardian . Dosarul intră în judecată săptămâna aceasta, la un tribunal federal din Oakland, California, iar miza depășește conflictul personal: poate influența direcția „boom”-ului din inteligența artificială. Musk a dat în judecată OpenAI și pe directorul general Sam Altman în 2024, susținând că a fost încălcat acordul de fondare al organizației. OpenAI a fost creată în 2015 ca organizație non-profit, cu o misiune publicată la finalul acelui an, care afirma că scopul este avansarea „inteligenței digitale” în beneficiul umanității, fără constrângerea generării unui randament financiar. Ce cere Musk și de ce contează pentru listarea OpenAI În esență, Musk afirmă că Altman a încălcat înțelegerea inițială prin restructurarea OpenAI și transformarea unei părți semnificative într-o entitate orientată spre profit. De cealaltă parte, Altman și OpenAI susțin că Musk, care a părăsit compania în 2018 pe fondul unor dispute interne și între timp a lansat un rival în zona de inteligență artificială, acționează din frustrare. Pentru OpenAI, procesul are o miză directă, financiară și de guvernanță. Publicația notează că firma este așteptată să se listeze mai târziu în acest an la o evaluare de aproximativ 1.000 de miliarde de dolari, iar Musk cere inclusiv măsuri care ar putea afecta această traiectorie. Concret, Musk solicită o serie de remedii, între care: înlăturarea lui Sam Altman și a președintelui OpenAI, Greg Brockman; despăgubiri de peste 134 de miliarde de dolari (aprox. 603 miliarde lei), despre care Musk spune că ar fi redistribuite către brațul non-profit al OpenAI; inversarea restructurării către o entitate cu scop lucrativ, ceea ce ar complica planurile de listare. Calendarul procesului și actorii-cheie Selecția juraților începe luni, la tribunalul federal din Oakland, sub coordonarea judecătoarei Yvonne Gonzalez Rogers. Procesul este estimat să dureze două până la trei săptămâni. În instanță ar urma să apară nume grele din Silicon Valley. Pe lista celor așteptați să depună mărturie se află inclusiv Satya Nadella, directorul general al Microsoft, companie cu care OpenAI a încheiat acorduri pe care Musk le descrie drept parte a „monetizării” ulterioare. Cum se apără OpenAI: donație, nu investiție Potrivit materialului, Musk susține că a contribuit cu aproximativ 38 de milioane de dolari (aprox. 171 milioane lei) și că, după ce compania a beneficiat de bani și a avansat tehnologic, ar fi „schimbat narațiunea” către acorduri profitabile și afiliere cu entități comerciale. OpenAI respinge acuzațiile și afirmă că Musk ar fi fost de acord încă din 2017 că înființarea unei entități cu scop lucrativ era un pas necesar. Compania contestă și ideea că finanțarea lui Musk ar fi fost o investiție, susținând că a fost o donație deductibilă fiscal către organizația non-profit și că nu îi conferă drepturi de proprietate în OpenAI. Ce urmează: un test pentru guvernanța companiilor de IA Dincolo de detaliile personale și de corespondența internă care ar urma să fie discutată în instanță (emailuri, mesaje și însemnări), procesul pune în prim-plan o problemă cu impact de piață: cât de stabil este modelul de guvernanță al unei companii de inteligență artificială care pornește ca non-profit, atrage capital masiv și ajunge să opereze prin structuri comerciale. În funcție de deciziile instanței și de eventualele remedii impuse, OpenAI ar putea fi nevoită să-și apere mai agresiv arhitectura corporativă și planurile de listare, într-un moment în care investitorii și regulatorii urmăresc tot mai atent cum sunt controlate și monetizate tehnologiile de IA. [...]

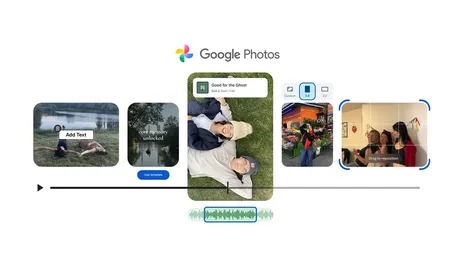

Google mută retușul facial direct în Google Photos , reducând nevoia de aplicații terțe și schimbând așteptările privind „autenticitatea” imaginilor distribuite, potrivit Zonait . Actualizarea adaugă în meniul de editare instrumente bazate pe inteligență artificială pentru ajustări rapide ale trăsăturilor faciale, o zonă unde Google Photos „rămăsese” în urma opțiunilor populare din TikTok sau Instagram. Miza operațională pentru Google este păstrarea utilizatorilor în propria aplicație: dacă fotografiile ajung să fie exportate în alte platforme pentru editare, compania pierde timp de utilizare și, implicit, controlul asupra experienței. Ce se schimbă în editarea din Google Photos Google spune că noile opțiuni sunt gândite pentru „mici îmbunătățiri”, astfel încât fotografiile să reflecte cum se simt utilizatorii în momentul respectiv. În practică, instrumentele vizează intervenții estetice care pot altera percepția asupra unei imagini, mai ales când fotografia este partajată cu persoane care nu cunosc subiectul. Lista de instrumente menționată în material include: Heal (corectarea unor zone/imperfecțiuni) Smooth (netezirea pielii) Under eyes (zona de sub ochi) Irises (irisul ochilor) Teeth (dinți) Eyebrows (sprâncene) Lips (buze) Fiecare instrument are un control al intensității, iar utilizatorul poate selecta o față din imagine și aplica ajustarea la nivelul dorit. Implementare: întâi pe Android , procesare pe serverele Google Funcțiile sunt implementate treptat, începând cu aplicația de Android. Un detaliu important este că procesarea ar urma să fie făcută pe serverele Google, ceea ce înseamnă că nu este necesar un telefon „sofisticat” pentru a rula aceste editări. Condițiile minime menționate sunt Android 9.0 și 4 GB RAM. Pentru iPhone, Google nu indică un calendar, însă materialul notează că opțiunile ar putea ajunge „destul de curând”, având în vedere importanța utilizatorilor iOS pentru companie. [...]

Inteligența artificială mută presiunea de pe „numărul de joburi” pe „conținutul joburilor” , iar companiile care o adoptă ajung să automatizeze sarcini, nu să elimine profesii întregi, susține CEO-ul Nvidia, Jensen Huang , într-o intervenție citată de Economedia . Mesajul are relevanță economică directă: dacă AI crește productivitatea, cererea se poate muta către competențe noi, nu neapărat către mai puțini angajați. Huang a făcut declarațiile la Stanford Graduate School of Business, în contextul unei discuții mai largi despre temerile legate de impactul AI asupra pieței muncii, potrivit Fortune (sursă citată de Economedia). În opinia lui, „narațiunea” conform căreia AI distruge locuri de muncă este greșită și contraproductivă, pentru că tehnologia schimbă activitățile zilnice, dar nu „elimină pur și simplu” joburile. Exemplul radiologilor: automatizare a sarcinilor, creștere a cererii Pentru a-și susține argumentul, CEO-ul Nvidia a invocat radiologia. În 2016, informaticianul Geoffrey Hinton estima că radiologii vor fi înlocuiți de AI, pe fondul progreselor în analiza imaginilor medicale. Huang spune că, la aproape un deceniu distanță, predicția s-a confirmat doar parțial: AI a ajuns să asiste practic fiecare investigație, însă numărul radiologilor a crescut. Cheia, în explicația lui, este diferența dintre „sarcinile” unui job și „scopul” lui. În radiologie, rolul nu se reduce la interpretarea imaginilor, ci include diagnosticarea și colaborarea cu pacienții și cu alți medici. Cu AI, radiologii pot procesa mai multe cazuri și trata mai mulți pacienți, ceea ce poate alimenta cererea pentru specialiști. Potrivit estimărilor citate, domeniul radiologiei ar urma să crească cu aproximativ 25% până în 2055. România: adopție încă limitată, dar presiune pe competențe În România, impactul AI asupra locurilor de muncă este descris ca moderat, pe fondul unei implementări încă limitate în companii. Un sondaj eJobs menționat de Economedia arată că 8 din 10 angajatori nu se așteaptă ca AI să reducă volumul de recrutare în următorii doi ani, însă anticipează schimbări în competențele cerute candidaților. În același timp, articolul notează că, deși AI începe să automatizeze sarcini repetitive și să crească productivitatea, majoritatea companiilor nu au integrat încă tehnologia la nivel strategic. Concedieri în tech: eficientizare și finanțarea investițiilor în AI În contrast cu mesajul că profesiile nu dispar, Economedia amintește că mari companii tech au început concedieri. Meta Platforms ar urma să reducă 10% din personal (aproximativ 8.000 de angajați) în luna mai, în încercarea de a-și eficientiza operațiunile și de a finanța investiții masive în inteligența artificială. Pentru piața muncii, concluzia practică din aceste exemple este că AI tinde să redistribuie munca: automatizează activități, ridică așteptările de productivitate și mută competiția către calificări, chiar dacă, în unele sectoare, poate coexista cu creșterea cererii de specialiști. [...]

Anthropic a urcat la o evaluare de aproximativ 1 trilion de dolari (aprox. 4,6 trilioane lei) în tranzacții pe piața secundară , un nivel care o plasează peste OpenAI și arată cât de repede se pot repoziționa așteptările investitorilor în AI, potrivit Mobilissimo . Evaluarea este indicată de platforme precum Forge Global și reflectă tranzacții între investitori pe piețe private, nu o cotație oficială de bursă. Anthropic nu este listată, iar interesul ridicat se traduce prin încercări ale investitorilor de a cumpăra acțiuni de la angajați sau investitori timpurii, într-un context cu puțini vânzători. Ce alimentează saltul de evaluare Creșterea este pusă pe seama cererii foarte mari pentru acțiunile companiei, susținută de interesul pentru produsele sale de inteligență artificială, în special asistentul de programare Claude. În unele cazuri, ofertele ar depăși chiar 1,1 trilioane de dolari (aprox. 5,1 trilioane lei), iar tranzacțiile s-ar închide rapid din cauza disponibilității reduse de acțiuni la vânzare. Un element important de context: în urmă cu doar trei luni, Anthropic era evaluată la aproximativ 380 de miliarde de dolari (aprox. 1,7 trilioane lei) după o rundă de finanțare. Potrivit unor investitori citați în material, pe lângă performanțele companiei, contribuie și fenomenul FOMO („teama de a rata oportunitatea”), care poate împinge prețurile în sus chiar și „indiferent de preț”. Efectul asupra competiției cu OpenAI În paralel, interesul pentru acțiunile OpenAI ar fi scăzut, iar unele tranzacții s-ar fi realizat sub evaluarea anterioară, menționată la circa 852 de miliarde de dolari (aprox. 3,9 trilioane lei). Schimbarea de sentiment sugerează o competiție mai dură în sectorul AI, în care percepția investitorilor poate muta rapid „clasamentul” companiilor, chiar și fără schimbări fundamentale majore. Materialul are ca sursă secundară Business Insider, menționat de Mobilissimo. [...]