Știri

Știri din categoria Inteligență artificială

Google mută retușul facial direct în Google Photos, reducând nevoia de aplicații terțe și schimbând așteptările privind „autenticitatea” imaginilor distribuite, potrivit Zonait.

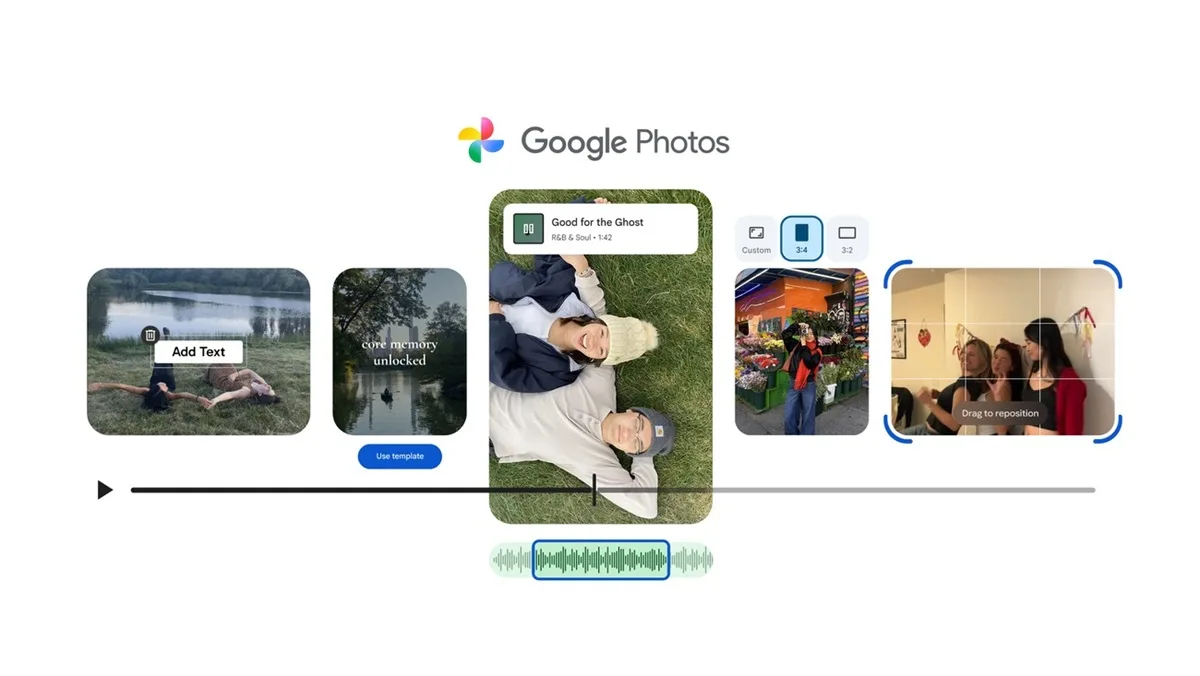

Actualizarea adaugă în meniul de editare instrumente bazate pe inteligență artificială pentru ajustări rapide ale trăsăturilor faciale, o zonă unde Google Photos „rămăsese” în urma opțiunilor populare din TikTok sau Instagram. Miza operațională pentru Google este păstrarea utilizatorilor în propria aplicație: dacă fotografiile ajung să fie exportate în alte platforme pentru editare, compania pierde timp de utilizare și, implicit, controlul asupra experienței.

Google spune că noile opțiuni sunt gândite pentru „mici îmbunătățiri”, astfel încât fotografiile să reflecte cum se simt utilizatorii în momentul respectiv. În practică, instrumentele vizează intervenții estetice care pot altera percepția asupra unei imagini, mai ales când fotografia este partajată cu persoane care nu cunosc subiectul.

Lista de instrumente menționată în material include:

Fiecare instrument are un control al intensității, iar utilizatorul poate selecta o față din imagine și aplica ajustarea la nivelul dorit.

Funcțiile sunt implementate treptat, începând cu aplicația de Android. Un detaliu important este că procesarea ar urma să fie făcută pe serverele Google, ceea ce înseamnă că nu este necesar un telefon „sofisticat” pentru a rula aceste editări.

Condițiile minime menționate sunt Android 9.0 și 4 GB RAM. Pentru iPhone, Google nu indică un calendar, însă materialul notează că opțiunile ar putea ajunge „destul de curând”, având în vedere importanța utilizatorilor iOS pentru companie.

Recomandate

Google mută masiv munca de programare către IA, iar inginerii ajung să supervizeze codul : în prezent, 75% din codul scris pentru propriile produse este generat de inteligența artificială, potrivit Profit . Schimbarea contează operațional pentru o companie care dezvoltă la scară globală, pentru că redefinește rolul echipelor tehnice și ritmul de livrare al produselor. În acest model, inginerii software care nu mai scriu efectiv cod au rolul de a superviza codul produs de IA, pe măsură ce tehnologia „devine din ce în ce mai bună la programare”, notează publicația. Un exemplu invocat de CEO-ul Google, Sundar Pichai , indică impactul asupra vitezei de execuție: o migrare de cod „deosebit de complexă”, realizată cu „agenți” (instrumente software bazate pe IA care execută sarcini) și ingineri lucrând împreună, ar fi fost finalizată de șase ori mai repede decât era posibil cu un an în urmă, când procesul se baza doar pe ingineri. „Recent, o migrare de cod deosebit de complexă, realizată de agenți și ingineri care au lucrat împreună, a fost finalizată de șase ori mai repede decât era posibil acum un an doar cu ingineri”, spune Sundar Pichai. Ce se schimbă în practică Din informațiile prezentate, tranziția are două efecte directe în organizație: o parte semnificativă din scrierea codului este transferată către IA (75% din total, conform Google); rolul inginerilor se mută spre control, verificare și coordonare a codului generat automat, nu doar spre implementare manuală. Articolul nu oferă detalii despre ce produse sau ce tipuri de proiecte sunt incluse în acest procent și nici despre modul în care Google măsoară „codul scris” de IA, astfel că amploarea exactă pe echipe și arii rămâne neprecizată în materialul citat. [...]

Google își condiționează o investiție totală de până la 40 mld. dolari (aprox. 184 mld. lei) în Anthropic de ținte de performanță , într-o mișcare care ar putea consolida finanțarea pe termen lung a unuia dintre cei mai importanți dezvoltatori de inteligență artificială, potrivit Mediafax . Google ar urma să investească imediat 10 miliarde de dolari (aprox. 46 mld. lei) în Anthropic, iar alte 30 de miliarde de dolari (aprox. 138 mld. lei) ar putea fi alocate ulterior, dacă startup-ul îndeplinește anumite obiective de performanță. Anthropic a transmis că angajamentul de 10 miliarde de dolari este făcut la o evaluare de 350 de miliarde de dolari, aceeași ca într-o rundă de finanțare din februarie, fără a include fondurile atrase recent, potrivit Bloomberg. Cum arată pachetul de finanțare și condițiile Conform informațiilor prezentate, structura finanțării are două componente: 10 miliarde de dolari investiție „acum”, la evaluarea menționată; încă 30 de miliarde de dolari , condiționate de atingerea unor obiective de performanță (detaliile acestor obiective nu sunt precizate în material). În paralel, Anthropic a atras recent încă 5 miliarde de dolari de la Amazon și „ar putea primi” alte 20 de miliarde de dolari în viitor, potrivit aceleiași surse. De ce contează: capitalul se mută spre produse AI cu tracțiune comercială Anthropic a crescut rapid, în special datorită produsului Claude Code , descris ca un instrument de inteligență artificială care îi ajută pe programatori să lucreze mai eficient. În acest context, condiționarea unei părți mari din investiție de indicatori de performanță sugerează o orientare mai strictă către rezultate măsurabile, nu doar către promisiuni tehnologice. Compania a fost fondată în 2021 de Dario Amodei , fost cercetător la Google, și ia în calcul o posibilă listare la bursă. [...]

Cipurile TPU ale Google au ajuns la 121 exaflopși, o miză directă pentru costul și viteza rulării modelelor AI : potrivit Google Cloud , cea mai nouă generație de Tensor Processing Units (TPU) poate procesa 121 exaflopși putere de calcul și vine cu o lățime de bandă dublă față de generațiile anterioare, într-un moment în care sarcinile de lucru pentru inteligență artificială devin tot mai „grele”. TPU-urile sunt cipuri specializate, proiectate „pentru un singur job”: efectuarea de calcule matematice la scară foarte mare, necesare pentru antrenarea și rularea modelelor AI. Google spune că le-a proiectat „de la zero” în urmă cu mai bine de un deceniu, tocmai pentru a rula astfel de modele. De ce contează pentru companii: performanță mai mare pe infrastructură dedicată AI În practică, creșterea de putere de calcul și de lățime de bandă are impact operațional: poate reduce timpii de procesare pentru sarcini AI și poate susține modele mai mari sau mai multe cereri simultane, în funcție de modul în care sunt folosite aceste resurse în infrastructură. Google își poziționează TPU-urile ca infrastructură din spatele produselor sale de zi cu zi, subliniind că aceste cipuri sunt construite pentru a accelera calculele care stau la baza funcționării modelelor AI. Ce a comunicat concret Google Din informațiile publicate, elementele tehnice punctuale sunt: TPU = „Tensor Processing Unit”, cip personalizat pentru calcule matematice la scară mare; proiectate de Google de peste un deceniu pentru rularea modelelor AI; cea mai nouă generație: 121 exaflopși și lățime de bandă dublă față de generațiile anterioare. Materialul include și un video explicativ despre modul în care funcționează TPU-urile, fără alte detalii financiare sau de disponibilitate comercială în textul extras. [...]

Inteligența artificială mută presiunea de pe „numărul de joburi” pe „conținutul joburilor” , iar companiile care o adoptă ajung să automatizeze sarcini, nu să elimine profesii întregi, susține CEO-ul Nvidia, Jensen Huang , într-o intervenție citată de Economedia . Mesajul are relevanță economică directă: dacă AI crește productivitatea, cererea se poate muta către competențe noi, nu neapărat către mai puțini angajați. Huang a făcut declarațiile la Stanford Graduate School of Business, în contextul unei discuții mai largi despre temerile legate de impactul AI asupra pieței muncii, potrivit Fortune (sursă citată de Economedia). În opinia lui, „narațiunea” conform căreia AI distruge locuri de muncă este greșită și contraproductivă, pentru că tehnologia schimbă activitățile zilnice, dar nu „elimină pur și simplu” joburile. Exemplul radiologilor: automatizare a sarcinilor, creștere a cererii Pentru a-și susține argumentul, CEO-ul Nvidia a invocat radiologia. În 2016, informaticianul Geoffrey Hinton estima că radiologii vor fi înlocuiți de AI, pe fondul progreselor în analiza imaginilor medicale. Huang spune că, la aproape un deceniu distanță, predicția s-a confirmat doar parțial: AI a ajuns să asiste practic fiecare investigație, însă numărul radiologilor a crescut. Cheia, în explicația lui, este diferența dintre „sarcinile” unui job și „scopul” lui. În radiologie, rolul nu se reduce la interpretarea imaginilor, ci include diagnosticarea și colaborarea cu pacienții și cu alți medici. Cu AI, radiologii pot procesa mai multe cazuri și trata mai mulți pacienți, ceea ce poate alimenta cererea pentru specialiști. Potrivit estimărilor citate, domeniul radiologiei ar urma să crească cu aproximativ 25% până în 2055. România: adopție încă limitată, dar presiune pe competențe În România, impactul AI asupra locurilor de muncă este descris ca moderat, pe fondul unei implementări încă limitate în companii. Un sondaj eJobs menționat de Economedia arată că 8 din 10 angajatori nu se așteaptă ca AI să reducă volumul de recrutare în următorii doi ani, însă anticipează schimbări în competențele cerute candidaților. În același timp, articolul notează că, deși AI începe să automatizeze sarcini repetitive și să crească productivitatea, majoritatea companiilor nu au integrat încă tehnologia la nivel strategic. Concedieri în tech: eficientizare și finanțarea investițiilor în AI În contrast cu mesajul că profesiile nu dispar, Economedia amintește că mari companii tech au început concedieri. Meta Platforms ar urma să reducă 10% din personal (aproximativ 8.000 de angajați) în luna mai, în încercarea de a-și eficientiza operațiunile și de a finanța investiții masive în inteligența artificială. Pentru piața muncii, concluzia practică din aceste exemple este că AI tinde să redistribuie munca: automatizează activități, ridică așteptările de productivitate și mută competiția către calificări, chiar dacă, în unele sectoare, poate coexista cu creșterea cererii de specialiști. [...]

Administrația SUA spune că analizează măsuri de răspundere după ce a acuzat entități din China că desfășoară operațiuni „la scară industrială” pentru a copia sisteme avansate de inteligență artificială dezvoltate în Statele Unite, potrivit news.ro . Miza pentru companiile americane de profil este una operațională și de securitate: protejarea informațiilor proprietare și a mecanismelor de siguranță ale modelelor. Acuzațiile au fost formulate de Michael Kratsios , principalul consilier pentru știință și tehnologie al președintelui, care a susținut că aceste operațiuni ar implica extragerea sistematică de informații și replicarea modelelor americane. „Nu este nimic inovator în a copia în mod organizat inovațiile industriei americane.” Cum ar funcționa copierea: conturi proxy, „ jailbreaking ” și „distilare” Oficialii americani afirmă că aceste campanii ar fi derulate în principal de entități cu baza în China și ar folosi zeci de mii de conturi proxy, precum și tehnici de ocolire a restricțiilor („jailbreaking”) pentru a accesa informații proprietare despre modelele de inteligență artificială. În acest context este menționat și procesul numit „distilare”, adică antrenarea unor modele mai mici pe baza unor sisteme mai mari și mai performante. Deși practica poate avea utilizări legitime, autoritățile americane avertizează că folosirea neautorizată poate afecta securitatea și integritatea modelelor. De ce contează pentru industrie: produse mai ieftine, dar cu riscuri de siguranță Kratsios a susținut că astfel de metode nu pot reproduce complet performanța sistemelor originale, însă pot permite dezvoltarea unor produse mai ieftine, care pot părea comparabile în anumite teste. În același timp, aceste modele ar putea elimina protocoale de siguranță sau mecanisme menite să asigure neutralitatea și acuratețea informațiilor. Ce urmează: informarea companiilor și opțiuni de contracarare Administrația americană intenționează să informeze companiile americane din domeniul inteligenței artificiale despre aceste practici, inclusiv despre tacticile și actorii implicați, și spune că explorează o gamă largă de măsuri pentru a contracara astfel de activități. În material nu sunt detaliate, deocamdată, ce măsuri concrete ar putea fi adoptate sau un calendar. [...]

Parteneriatul Apple–Google intră în faza operațională: Siri va rula pe Gemini , iar mutarea poate schimba rapid capabilitățile „Apple Intelligence” încă din acest an, cu implicații directe asupra infrastructurii cloud folosite de Apple, potrivit GSMArena . Confirmarea vine de la Google, făcută pe scenă la conferința Cloud Next 2026 din Las Vegas. Thomas Kurian, șeful Google Cloud, a spus că Google colaborează cu Apple „ca furnizor cloud preferat” pentru a dezvolta „următoarea generație de Apple Foundation Models” bazate pe tehnologia Gemini, iar aceste modele „vor alimenta viitoare funcții Apple Intelligence, inclusiv un Siri mai personalizat, care va veni mai târziu în acest an”. Ce se știe despre calendar Informația completează confirmarea anterioară a Apple, care anunțase încă din ianuarie că modelele Gemini vor sta la baza următoarei evoluții Apple Intelligence. Potrivit publicației, Apple ar urma să prezinte noutățile în iunie, la Worldwide Developers Conference (WWDC) , iar lansarea către utilizatori este așteptată în toamnă, odată cu iOS 27 și iPadOS 27. De ce contează: unde va rula, de fapt, AI-ul Rămâne neclar dacă modelele Gemini folosite de Apple vor rula pe serverele Google sau prin Apple Private Cloud Compute (infrastructura proprie Apple pentru procesare în cloud cu accent pe confidențialitate). Această decizie are consecințe practice pentru: dependența operațională de un furnizor extern de cloud (Google) versus rulare în cloud-ul Apple; controlul asupra datelor și procesării , în funcție de arhitectura aleasă; viteza de livrare și scalarea funcțiilor de inteligență artificială în ecosistemul Apple. Context: Siri a fost întârziat din cauza acurateții Siri „revizuit” era inițial așteptat anul trecut, apoi a fost amânat pentru această primăvară, însă Apple ar fi întâmpinat probleme de acuratețe. Clarificările privind implementarea și detaliile tehnice sunt așteptate la începutul lui iunie, odată cu WWDC. [...]