Știri

Știri din categoria Inteligență artificială

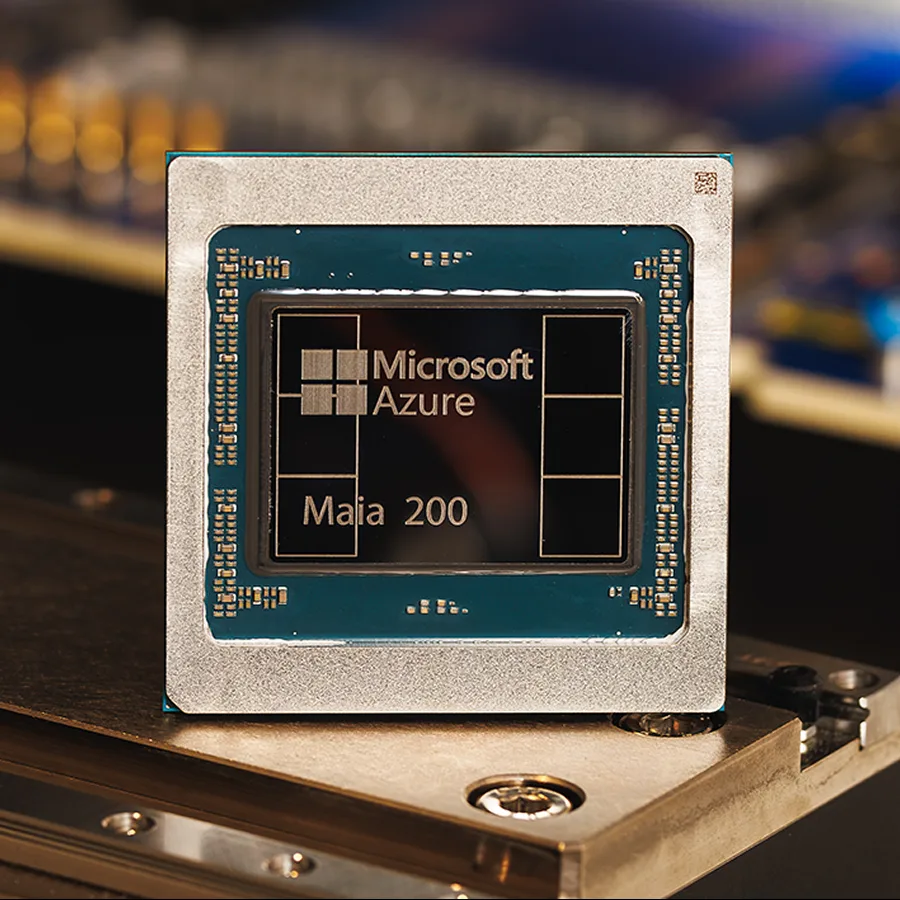

Microsoft a anunțat oficial lansarea cipului Maia 200, o unitate de procesare AI de ultimă generație proiectată pentru sarcini masive de inferență, relatează Windows Central. Cipul este dezvoltat pe tehnologia de 3 nm de la TSMC și este destinat în special pentru a reduce costurile operaționale ale modelelor de limbaj de mari dimensiuni (LLM), precum GPT-5.2, prin scăderea semnificativă a costului per-token.

Microsoft susține că Maia 200 este cel mai performant cip dezvoltat vreodată intern de un hyperscaler și depășește performanțele competitorilor direcți: are de trei ori mai multă performanță FP4 decât Trainium 3 de la Amazon și performanțe FP8 superioare TPU-urilor de generația a șaptea de la Google. Compania afirmă că noul cip oferă un randament cu 30% mai mare per dolar față de hardware-ul de ultimă generație utilizat anterior în infrastructura proprie.

Această lansare vine pe fondul speculațiilor privind o distanțare tot mai clară a Microsoft față de OpenAI, în direcția dezvoltării propriei autonomii tehnologice. De altfel, CEO-ul Microsoft AI, Mustafa Suleyman, a sugerat anterior că viitorul AI va aparține doar marilor jucători care își pot permite dezvoltarea hardware-ului și modelelor proprii, pe fondul costurilor operaționale uriașe.

În același timp, lansarea Maia 200 ar putea ajuta direct OpenAI, care se estimează că va înregistra pierderi de până la 14 miliarde de dolari în 2026. Modelul de cost actual al funcționării ChatGPT și al altor aplicații LLM se bazează pe un consum energetic ridicat și resurse de calcul costisitoare – în special în faza de inferență, atunci când AI generează răspunsuri în timp real. Maia 200 este construit tocmai pentru a eficientiza această parte, iar Microsoft susține că cipul va fi integrat în Microsoft Foundry și Copilot, dar și în fluxurile operaționale ale OpenAI.

Pentru companii precum OpenAI, care oferă acces masiv la servicii de tip chatbot și generatoare de conținut, inferența devine o cheltuială permanentă majoră. Microsoft afirmă că Maia 200 a fost optimizat special pentru acest proces și poate aduce economii semnificative prin reducerea costului per-token. Cu alte cuvinte, AI-ul nu doar că va funcționa mai rapid, dar și mai ieftin.

„Maia 200 face parte din infrastructura noastră AI eterogenă și va deservi mai multe modele, inclusiv GPT-5.2, oferind un avantaj clar de cost pentru Foundry și Microsoft 365 Copilot”, a transmis Microsoft, conform Windows Central.

Lansarea Maia 200 vine într-un moment critic pentru industrie. Pe măsură ce modelele devin tot mai complexe și mai costisitoare de operat, presiunea pe rentabilitate este uriașă. OpenAI, de exemplu, se află în centrul unui „foc financiar” care ar putea atinge 14 miliarde de dolari în pierderi doar în acest an, potrivit sursei citate.

Este de așteptat ca și alți jucători din industrie să urmeze exemplul Microsoft, accelerând dezvoltarea de cipuri personalizate, pentru a reduce dependența de furnizori precum Nvidia și pentru a controla mai bine costurile și performanța.

Dacă promisiunile privind Maia 200 se confirmă, Microsoft nu doar că va consolida poziția sa în infrastructura AI globală, ci ar putea redefini complet calculul economic din spatele modelelor AI – ceea ce ar putea însemna diferența între profit și pierdere pentru companii ca OpenAI.

Recomandate

Pentagonul își diversifică furnizorii de AI pentru rețele secrete , semnând acorduri cu șapte companii tehnologice și lăsând în afara listei Anthropic , pe fondul unei dispute legate de mecanismele de siguranță pentru utilizarea militară a inteligenței artificiale, potrivit Agerpres . Decizia are o miză operațională și de gestionare a riscului: integrarea unor „capacități avansate” de AI în rețele clasificate, în timp ce Pentagonul încearcă să evite blocaje de aprovizionare și o dependență prea mare de un singur furnizor, conform comunicatului citat de Reuters. Cine sunt furnizorii selectați și ce urmează să livreze Cele șapte companii cu care Departamentul american al Apărării a ajuns la acorduri sunt: SpaceX, OpenAI, Google, Nvidia, Reflection, Microsoft și Amazon. Unele dintre ele colaborau deja cu Pentagonul. Aceste soluții urmează să fie integrate în rețele cu „niveluri de impact 6 și 7”, o clasificare care se referă la efectele pe care compromiterea confidențialității, integrității sau disponibilității sistemelor informatice le-ar avea asupra securității naționale. De ce lipsește Anthropic din listă Comunicatul exclude Anthropic, companie aflată într-o dispută cu Pentagonul privind mecanismele de siguranță pentru utilizarea militară a AI. În același timp, sursa citată arată că există rezerve interne față de renunțarea la Anthropic: unii angajați ai departamentului, foști oficiali și furnizori de tehnologie care lucrează îndeaproape cu armata americană au declarat pentru Reuters că instrumentele firmei ar fi „mai bune decât alternativele”, deși s-a ordonat eliminarea lor în următoarele șase luni. Directorul pentru tehnologie al Departamentului Apărării, Emil Michael, a declarat pentru CNBC că Anthropic reprezintă în continuare un risc pentru lanțul de aprovizionare. Unde va fi folosită AI în armată Extinderea serviciilor de AI vizează utilizări precum: planificare; logistică; selectarea țintelor; alte activități operaționale, cu obiectivul de a simplifica și accelera operațiunile, potrivit comunicatului preluat de Reuters. [...]

Elon Musk a admis că xAI a folosit modele OpenAI pentru a antrena Grok , o recunoaștere care împinge în prim-plan „zona gri” a industriei AI privind distilarea modelelor și riscurile de încălcare a proprietății intelectuale, potrivit G4Media . Declarația a fost făcută într-un proces din California , în timpul unei audieri în care Musk a fost întrebat despre practicile de antrenare a modelelor de inteligență artificială. Discuția s-a concentrat pe „distilare” – o metodă prin care un model mai mare și mai performant este folosit pentru a antrena unul mai mic, transferându-i din capabilități. Întrebat direct dacă xAI a folosit tehnologia OpenAI în acest mod, Musk a evitat inițial un răspuns tranșant, spunând că „în general, toate companiile de AI” recurg la astfel de practici. Presat să clarifice, el a răspuns: „Parțial”. De ce contează: distilarea, între practică uzuală și dispută de proprietate intelectuală Distilarea este descrisă ca fiind larg utilizată în industrie, mai ales pentru a obține versiuni mai eficiente și mai accesibile ale unor sisteme complexe. În același timp, metoda a devenit controversată pe fondul disputelor legate de proprietatea intelectuală și de respectarea termenilor de utilizare. În acest context, articolul menționează mai multe poziții și reacții din industrie: Anthropic și OpenAI au atras atenția asupra riscurilor ca distilarea să fie folosită pentru a replica performanțele unor modele concurente fără a parcurge întregul proces de dezvoltare. Unele firme din China au fost acuzate că folosesc astfel de metode pentru a reduce costurile și timpul de dezvoltare. Google a anunțat măsuri pentru a limita ceea ce numește „atacuri de distilare”, pe care le consideră o posibilă formă de încălcare a proprietății intelectuale. Reprezentanții Anthropic au spus, într-o analiză publicată anterior, că distilarea este în esență o metodă legitimă și frecvent folosită pentru optimizarea modelelor proprii, dar care poate fi exploatată pentru avantaje competitive „discutabile”. Ce susține Musk Ulterior, Musk a spus că este „o practică standard” ca modelele de inteligență artificială să fie validate sau îmbunătățite cu ajutorul altor sisteme similare. Declarațiile vin pe fondul intensificării competiției în AI, într-un moment în care delimitarea dintre inovație, colaborare și utilizare controversată a tehnologiei devine tot mai dificilă, mai notează articolul. [...]

Elon Musk a recunoscut în instanță că xAI a folosit „distilarea” pe modele OpenAI pentru a antrena Grok , o practică ce poate eroda avantajul competitiv al laboratoarelor care investesc masiv în infrastructură de calcul și care, în același timp, ridică mizele privind aplicarea termenilor de utilizare ai modelelor, potrivit TechCrunch . Mărturia a fost dată joi, într-o instanță federală din California, în procesul în care Musk dă în judecată OpenAI , pe CEO-ul Sam Altman și pe Greg Brockman. Întrebat dacă xAI a folosit tehnici de distilare pe modele OpenAI pentru a antrena Grok, Musk a spus că este o practică generală în industrie, iar când i s-a cerut să confirme dacă răspunsul este „da”, a răspuns: „Parțial”. De ce contează: distilarea reduce bariera de cost și apasă pe regulile de utilizare Distilarea (în contextul modelelor de inteligență artificială) este o metodă prin care un model nou este antrenat să reproducă comportamentul unuia mai performant, prin interogări sistematice ale chatboturilor sau ale interfețelor de programare (API) puse la dispoziție public. Miza economică este că astfel pot fi obținute modele „aproape la fel de capabile” la costuri mai mici, subminând avantajul construit de jucătorii mari prin investiții în capacitate de calcul. TechCrunch notează că nu este clar dacă distilarea este explicit ilegală; mai degrabă, ar putea încălca termenii de utilizare impuși de companii pentru produsele lor. Reacția industriei: încercări de a bloca interogările „suspecte” În paralel, OpenAI, Anthropic și Google ar fi lansat, prin Frontier Model Forum, o inițiativă de schimb de informații despre cum pot fi combătute încercările de distilare, în special din China. Abordarea descrisă se bazează pe identificarea și prevenirea interogărilor în masă care pot „cartografia” comportamentul intern al modelelor. OpenAI nu a răspuns solicitării de comentariu privind declarația lui Musk, la momentul publicării articolului. Context din proces: poziționarea xAI în cursa globală În aceeași mărturie, Musk a fost întrebat despre o afirmație făcută vara trecută, potrivit căreia xAI ar urma să depășească în curând orice companie, cu excepția Google. El a clasat furnizorii de top astfel: Anthropic pe primul loc, urmată de OpenAI, Google și modele chinezești cu cod deschis, caracterizând xAI drept o companie mult mai mică, cu „câteva sute” de angajați. [...]

Procesul dintre Elon Musk și Sam Altman riscă să complice traseul OpenAI către o listare și să amplifice presiunea juridică asupra modelului său hibrid (nonprofit–profit), într-un moment în care compania este descrisă ca fiind „pregătită” pentru un IPO, potrivit Al Jazeera . Într-un proces federal din California , Musk – cofondator OpenAI – a depus mărturie pentru a doua zi, susținând că Altman a „trădat” promisiunile inițiale de a păstra organizația ca nonprofit „dedicată beneficiului umanității”. Litigiul pornește de la înființarea OpenAI în 2015 ca nonprofit și transformarea ulterioară într-o structură orientată spre profit. Musk a declarat în fața juraților că și-a pierdut încrederea că Altman va menține misiunea nonprofit și a spus că, spre finalul lui 2022, se temea că Altman încerca să „fure caritatea”, afirmând că „s-a dovedit a fi adevărat”. Altman a fost prezent în sală, dar nu a depus mărturie, conform relatării. Miza economică: IPO și modelul de finanțare Avocații OpenAI au respins acuzațiile și au susținut că nu a existat niciodată un angajament de a rămâne nonprofit. Compania afirmă că a creat o componentă cu scop lucrativ pentru a finanța nevoile mari de putere de calcul și pentru a atrage talente. În același timp, OpenAI ar fi „pregătită” pentru o ofertă publică inițială care ar putea evalua compania la 1.000 de miliarde de dolari, potrivit Reuters, citată de Al Jazeera. În acest context, disputa privind guvernanța și misiunea inițială poate deveni un factor de risc reputațional și juridic, cu potențiale efecte asupra investitorilor și structurii de control. Ce cere Musk în instanță Musk a investit aproximativ 38 de milioane de dolari (aprox. 174 milioane lei) în OpenAI între 2015 și 2017 și a părăsit organizația în 2018. În proces, el solicită: 150 de miliarde de dolari (aprox. 690 miliarde lei) despăgubiri de la OpenAI și Microsoft , cu orice sumă acordată direcționată către brațul caritabil al OpenAI; obligarea OpenAI să revină la statutul de nonprofit; înlăturarea lui Sam Altman și a cofondatorului Greg Brockman din conducere. Musk a mai susținut că organizația a fost „capturată” și a descris o ofertă de a investi, venită din partea lui Altman, ca părând „ca o mită”. Apărarea OpenAI: competiția cu xAI Echipa juridică a OpenAI afirmă că acțiunea lui Musk urmărește să submineze compania în favoarea propriei sale inițiative, xAI. OpenAI, organizată acum ca „public benefit corporation” (o formă corporativă care combină obiective comerciale cu o misiune de interes public), susține că demersul este alimentat de competiție și notează că xAI este în urma OpenAI la adopția de către utilizatori. Context suplimentar despre proces apare într-un material anterior al publicației, „stand for a second day”, disponibil aici: Al Jazeera . [...]

OpenAI își schimbă strategia de infrastructură și se îndepărtează de ideea de a deține centre de date „ Stargate ”, preferând să închirieze pe termen lung capacitate de calcul , o mutare care reduce nevoia de investiții directe, dar tensionează relațiile cu partenerii și ridică semne de întrebare privind predictibilitatea companiei, potrivit Tom's Hardware . În forma inițială, Stargate a fost prezentat la începutul lui 2025 ca un joint venture cu Oracle și SoftBank, cu o țintă de investiții de 500 de miliarde de dolari (aprox. 2.250 miliarde lei) în centre de date pentru inteligență artificială în SUA. După „mai mult de un an” de dificultăți și neînțelegeri, OpenAI ar fi renunțat, în practică, la ideea de a deține infrastructură alături de parteneri și ar fi trecut la acorduri mai flexibile, bazate pe furnizori terți și închiriere de capacitate, conform Financial Times. De ce contează: mai puțin capital blocat, dar mai mult risc de execuție și încredere Schimbarea are o logică financiară pentru o companie care „arde numerar” și care ar fi ratat în ultimele luni ținte interne de venituri, notează materialul. În același timp, repoziționarea a produs „haos” în rândul partenerilor și a pus sub semnul întrebării fiabilitatea OpenAI, în condițiile în care raportul citat susține că startup-ul a „abandonat în practică” joint venture-ul, în favoarea unor acorduri bilaterale mari (inclusiv cu Oracle). O persoană implicată în proiect ar fi spus că OpenAI a „tras pe linie moartă centrele de date proprii”, iar compania ar fi admis că Stargate este doar un „termen umbrelă” pentru strategia sa de capacitate de calcul. Efecte colaterale: proiecte puse pe pauză și parteneri nemulțumiți Incertitudinile ar fi afectat și proiecte din afara SUA. Guvernul britanic a semnat un acord cu OpenAI și alți parteneri pentru construirea unui centru de date în Marea Britanie, însă OpenAI l-a pus „pe hold” la începutul acestei luni, invocând „reglementări restrictive” și „costuri ridicate ale energiei”. Ministrul britanic pentru IA, Kanishka Narayan, a declarat pentru Financial Times că singurul lucru care s-a schimbat față de momentul angajamentelor ar fi fost „mediul de finanțare pentru OpenAI”. În paralel, unele părți implicate ar fi rămas cu sentimentul că au fost „dezamăgite și induse în eroare”, pe fondul deciziei Microsoft de a interveni în unele proiecte pe care OpenAI le-ar fi abandonat. O sursă citată de publicație a punctat că „banii nu sunt nelimitați”, iar o alta a spus că ar prefera Microsoft ca „chiriaș”, pentru că „este mai solvabil”. În lipsa unor detalii suplimentare în material despre calendarul noilor acorduri sau despre ce proiecte vor continua efectiv sub „umbrela” Stargate, rămâne de urmărit cum va arăta, concret, mixul de furnizori și contracte prin care OpenAI își va asigura capacitatea de calcul în perioada următoare. [...]

OpenAI își extinde distribuția în cloud dincolo de Microsoft , după ce modelele sale vor fi disponibile pentru prima dată în Amazon Bedrock , mișcare care poate schimba opțiunile de achiziție și integrare pentru companiile care folosesc servicii AWS, potrivit TechRadar . Parteneriatul vine la o zi după ce OpenAI a anunțat că Microsoft nu mai este partenerul său exclusiv de cloud, deși rămâne „partener prioritar”. În noul aranjament, clienții Amazon Bedrock vor putea accesa modele GPT și alte modele asociate, iar agentul Codex va putea fi integrat în medii AWS. Ce se schimbă pentru clienții AWS: OpenAI intră direct în Bedrock Integrarea pune modelele OpenAI „lângă” alte opțiuni deja disponibile în Bedrock, inclusiv de la Anthropic, Meta, Mistral, Cohere și Amazon, plus „alți furnizori de top”, conform informațiilor din material. TechRadar notează că pachetul include și „cel mai bun model de frontieră” al OpenAI, GPT‑5.5. Odată cu disponibilitatea în Bedrock, companiile păstrează accesul la funcții tipice de utilizare enterprise din AWS, precum: controale de acces IAM (gestionarea identităților și permisiunilor), rețelistică privată, criptare, „guardrails” (mecanisme de limitare și control al comportamentului modelelor), jurnalizare prin AWS CloudTrail. Codex, disponibil în ecosistemul AWS, dar deocamdată în „limited preview” Amazon evidențiază integrarea Codex și menționează că produsul are patru milioane de utilizatori săptămânali. Potrivit articolului, Codex este disponibil prin Codex CLI, aplicația desktop Codex și extensia pentru Visual Studio Code. Atât Codex în Bedrock, cât și disponibilitatea modelelor OpenAI și a Amazon Bedrock Managed Agents alimentați de OpenAI sunt, deocamdată, în regim de „limited preview” (acces limitat), ceea ce indică o lansare etapizată, nu o disponibilitate generală imediată. Context: un acord pe termen lung și investiții majore în infrastructură Dezvoltarea vine la câteva săptămâni după ce Amazon a anunțat un „parteneriat strategic multianual” cu OpenAI, care ar include o investiție de 50 miliarde dolari (aprox. 230 miliarde lei) în companie, conform TechRadar. În cadrul acelui acord, OpenAI ar urma să consume 2 GW de capacitate Trainium (cipuri/acceleratoare AWS pentru antrenarea modelelor) prin infrastructura AWS, iar cele două companii ar urma să dezvolte împreună modele personalizate pentru aplicațiile orientate către clienți ale Amazon. TechRadar mai menționează că acordul pe opt ani ar fi o extindere a unei înțelegeri anterioare, „în valoare combinată” de 138 miliarde dolari (aprox. 635 miliarde lei). AWS descrie acest pas drept „începutul unei colaborări mai profunde”, iar eliminarea exclusivității cu Microsoft poate deschide calea pentru extinderi similare și cu alți furnizori de cloud. [...]