Știri

Știri din categoria Inteligență artificială

Anthropic își extinde Claude pe Mac cu un pachet de conectori și fluxuri de lucru pentru firme mici, mizând pe integrarea directă în aplicațiile uzuale de contabilitate, plăți și productivitate, potrivit 9to5Mac.

Noua ofertă, numită „Claude for Small Business”, este descrisă de companie drept „un pachet de conectori și fluxuri de lucru gata de rulat care îl pune pe Claude în interiorul instrumentelor de care depind afacerile mici”. Soluția rulează în aplicația Claude pentru desktop, ceea ce înseamnă că utilizatorii de Mac pot folosi pachetul direct din aplicația instalată pe computer.

Miza este reducerea muncii repetitive prin conectarea asistentului AI la instrumentele deja folosite în activitatea curentă. Anthropic spune că instalarea se face printr-un „toggle” (o opțiune de activare), care „îl pune pe Claude la treabă” în aplicațiile existente.

Lista de servicii menționate ca fiind integrate include:

Din aceste aplicații, Claude ar putea ajuta la sarcini precum planificarea statelor de plată, închiderea lunii, derularea unei campanii de vânzări sau urmărirea facturilor neîncasate, conform descrierii Anthropic.

Anthropic publică detalii despre conectorii compatibili pe pagina de soluții „Claude for Small Business” (link în material). Separat, compania pune la dispoziție și un curs gratuit de „AI fluency” (alfabetizare în utilizarea AI), destinat proprietarilor de afaceri mici: 14 lecții și „peste o oră de video”, potrivit aceleiași surse.

Pentru detalii suplimentare despre pachet, Anthropic indică și o pagină dedicată de anunț (link în material).

Recomandate

Inteligența artificială ajunge în centrul discuțiilor Trump–Xi, dar un acord concret rămâne improbabil , pe fondul neîncrederii și al rivalității tehnologice care apasă agenda summitului de la Beijing, potrivit Reuters . Miza este mai degrabă una de „gestionare a riscului” decât de cooperare: doi oficiali americani familiarizați cu pregătirile au spus că președintele SUA, Donald Trump, va pune AI în prim-planul discuțiilor cu liderul chinez Xi Jinping, o premieră care reflectă greutatea strategică a tehnologiei, însă angajamente substanțiale sunt puțin probabile. De ce contează: presiune pentru un „canal de comunicare” pe AI Vizita are loc în contextul în care competiția SUA–China pe AI se intensifică, iar unii observatori o compară cu o cursă a înarmării de tip Război Rece. Presiunea pentru dialog a crescut după lansarea modelului Mythos de către Anthropic, pe care analiștii îl descriu drept un factor care ridică miza pentru ambele părți. Oficiali de la Casa Albă au recunoscut că sisteme AI de ultimă generație precum Mythos fac „esențial” un canal de comunicare cu China, pentru a evita conflicte care ar putea apărea din implementarea acestor tehnologii. IDC China avertizează că excluderea companiilor chineze de la accesul timpuriu la Mythos riscă să adâncească un „decalaj generațional” în capabilitățile de apărare bazate pe AI între China și Occident. Ce ar putea fi pe masă: linie directă și „garduri de protecție” Analiștii citați de Reuters indică drept opțiuni: o linie directă „fără vină” (hotline) pentru semnalarea incidentelor suspectate a fi generate de AI; „garduri de protecție” pentru modele AI de vârf (frontieră), sau angajamente de reducere a activităților malițioase facilitate de AI, într-o logică similară Acordului SUA–China din 2015 privind securitatea cibernetică. Kwan Yee Ng, responsabil de guvernanță internațională AI la consultanța de siguranță AI Concordia AI din Beijing, a spus că un semnal pozitiv de la summit ar putea schimba dificultatea tot mai mare de a obține implicarea directă a unor figuri occidentale de rang înalt în dialogul cu China pe AI. El a amintit că există deja o linie directă militară, dar oficiali americani s-au plâns că partea chineză „adesea nu a răspuns”. Chipuri, controale și suspiciuni: terenul care blochează înțelegerile Reuters notează că delegația lui Trump îi include pe Jensen Huang , CEO Nvidia, și pe Michael Kratsios, consilier de top al Casei Albe pe politici tehnologice, ceea ce sugerează că discuțiile ar putea atinge atât AI, cât și cipurile H200 ale Nvidia. În paralel, China ar fi propus SUA un mecanism formal de dialog pe AI condus de secretarul Trezoreriei, Scott Bessent, și de vice-ministrul chinez al finanțelor, Liao Min, potrivit unei surse informate asupra demersului. The Wall Street Journal a relatat anterior despre acest dialog. Totuși, așteptările rămân reduse, inclusiv pentru că instituțiile vizate nu sunt specializate în AI, iar administrația Trump abia recent s-a orientat către evaluări de siguranță pentru modelele AI avansate. Pe fondul rivalității, legislatori americani împing „noi limite ample” privind accesul Chinei la lanțurile de aprovizionare cu semiconductori, chiar dacă administrația Trump relaxează unele restricții la exportul de cipuri avansate către China. Reuters scrie că proiectul MATCH Act a stârnit proteste la Beijing și ar putea apărea în discuțiile de la summit, alături de controalele existente la export. Reva Goujon, strateg geopolitic la Rhodium Group, a descris momentul drept o „fereastră crucială” pentru ca Beijingul să încerce să obțină un angajament american de a opri proiectul. În același timp, restricțiile SUA asupra vânzărilor de echipamente pentru cipuri continuă să afecteze efortul Chinei de autosuficiență, într-un moment în care fabricile interne au dificultăți în a crește producția. Reuters mai notează că lipsa de putere de calcul a forțat, în ultimele luni, multe modele AI chineze să raționalizeze accesul utilizatorilor. Tensiunile sunt amplificate și de acuzațiile Casei Albe privind furt „la scară industrială” al proprietății intelectuale a laboratoarelor americane de AI. Într-un articol recent, revista-fanion a Partidului Comunist Chinez a susținut că măsurile occidentale în domeniul AI au depășit restricțiile țintite și au devenit o „blocadă sistematică de ecosistem” împotriva Chinei. În acest context, Reuters îl citează pe Ng: „Când o parte vede AI ca pe un risc de proliferare care trebuie ținut sub control, iar cealaltă vede controlul ca pe un atac asupra unei tehnologii de uz general, devine foarte dificil să găsești un teren comun.” Ce urmează Chiar dacă AI intră pentru prima dată în centrul unui summit Trump–Xi, semnalele din pregătiri indică mai degrabă discuții despre mecanisme de reducere a riscurilor (comunicare, reguli de bază) decât angajamente ferme. În lipsa unui progres pe dosarele care alimentează neîncrederea — controale pe cipuri, acces la lanțuri de aprovizionare și acuzații de furt de proprietate intelectuală — spațiul pentru un acord substanțial rămâne limitat. [...]

OpenAI își extinde oferta de securitate cibernetică cu Daybreak, o inițiativă care promite să identifice și să repare vulnerabilități înainte ca atacatorii să le exploateze , într-o mișcare ce pune presiune operațională pe echipele de securitate să integreze tot mai mult „agenți” de inteligență artificială în fluxurile de lucru, potrivit The Verge . Daybreak folosește agentul de securitate Codex Security , lansat în martie, pentru a construi un model de amenințări pe baza codului unei organizații și pentru a se concentra pe posibile căi de atac. Sistemul ar urma să valideze vulnerabilitățile probabile și să automatizeze detectarea celor cu risc mai ridicat. Ce schimbă Daybreak în practică pentru companii Din descrierea OpenAI, Daybreak este gândit ca un instrument care mută o parte din munca de analiză și triere a riscurilor dinspre oameni către automatizare, prin: modelarea amenințărilor pornind de la codul organizației; identificarea posibilelor „trasee” de atac; validarea vulnerabilităților considerate probabile; automatizarea detecției pentru vulnerabilitățile cu risc mai mare. Publicația notează că inițiativa vine într-un moment în care rivalii împing produse similare, iar OpenAI nu avea până acum un produs comparabil, orientat explicit pe securitate. Cum se poziționează față de Anthropic și „Claude Mythos” Lansarea are loc la puțin peste o lună după ce Anthropic a anunțat Claude Mythos, un model de securitate pe care compania a spus că este „prea periculos” pentru a fi lansat public și pe care l-a distribuit privat în cadrul inițiativei Project Glasswing. Chiar și așa, menționează The Verge, „cel puțin câteva” părți neautorizate ar fi obținut acces. În cazul OpenAI, Daybreak nu este construit pe un singur model. Compania spune că „Daybreak reunește cele mai capabile modele OpenAI, Codex și partenerii noștri de securitate”. Modelele folosite și direcția de dezvoltare Daybreak include și modele specializate pentru zona „cyber”, între care GPT-5.5 cu Trusted Access for Cyber și GPT-5.5-Cyber, care a început să fie disponibil treptat săptămâna trecută, conform informațiilor din articol. OpenAI mai afirmă că lucrează cu „parteneri din industrie și guvernamentali” în timp ce se pregătește să „implementeze modele din ce în ce mai capabile” pentru securitate cibernetică. Materialul nu oferă detalii despre calendar, clienți sau condiții comerciale. [...]

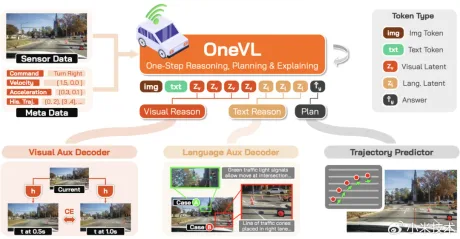

Xiaomi a publicat și a făcut open-source framework-ul OneVL pentru raționament „în spațiul latent”, mizând pe o accelerare a dezvoltării modelelor pentru conducere autonomă prin unificarea, într-o singură arhitectură, a modelelor VLA (vision-language-action, adică modele care leagă percepția vizuală și limbajul de acțiuni) și a „modelului lumii” (o reprezentare internă a mediului), potrivit IT之家 . Declarațiile îi aparțin lui Lei Jun , fondator, președinte și CEO Xiaomi, care susține că OneVL este primul din industrie care face această unificare prin inferență în spațiul latent. Miza practică a anunțului este una operațională: Xiaomi încearcă să reducă barierele de intrare pentru cercetare și implementare, punând la dispoziție atât greutățile modelului (parametrii antrenați), cât și codul de antrenare și inferență. În același timp, compania își poziționează soluția ca o alternativă mai eficientă la abordări de tip „chain-of-thought” (CoT, raționament în pași expliciți), printr-o variantă „latent CoT” (raționament comprimat în reprezentări interne, fără pași textualizați). Ce susține Xiaomi că aduce OneVL Conform descrierii din material, OneVL urmărește să combine mai multe direcții tehnice într-un singur cadru: unificarea VLA, a „modelului lumii” și a inferenței în spațiul latent; creșterea vitezei și a preciziei, pe baza unei capacități de raționament pe care Xiaomi o compară cu cea a unui „XLA model” (termen folosit în textul sursă, fără detalii suplimentare în articol); performanțe care, potrivit afirmațiilor companiei, depășesc „CoT explicit” la precizie și se aliniază ca viteză cu predicția de tip „doar răspunsul” („only-answer”). Lei Jun mai afirmă că OneVL „ridică plafonul” performanței pentru metodele de raționament latent pe mai multe benchmark-uri uzuale de inferență și planificare, fără ca articolul să includă valori numerice sau numele acelor teste. Ce a fost publicat: raport tehnic, pagină de proiect, cod Xiaomi a publicat resursele asociate proiectului, inclusiv documentație și cod: raport tehnic: https://arxiv.org/abs/2604.18486 pagina proiectului: https://xiaomi-embodied-intelligence.github.io/OneVL cod open-source: https://github.com/xiaomi-research/onevl În mesajul citat de IT之家 , Lei Jun spune că invită dezvoltatori și cercetători din întreaga lume să exploreze „mai multe posibilități” pentru modelele mari dedicate conducerii autonome, în contextul în care compania a ales să publice integral modelul și instrumentele de lucru. [...]

Apple s-a alăturat Google în contestarea măsurilor UE care ar forța Android să se deschidă mai mult către servicii rivale de inteligență artificială , avertizând că propunerile Comisiei Europene pot crea riscuri de „confidențialitate, securitate și siguranță”, potrivit 9to5Mac . Miza este una de reglementare: Comisia Europeană a propus luna trecută un set de măsuri pentru a ajuta Google să se conformeze Digital Markets Act (DMA) – regulamentul UE care impune obligații platformelor digitale considerate „gatekeeperi” (controlori de acces). Printre propuneri se află modificări care ar oferi serviciilor AI concurente acces mai bun la anumite capabilități din Android, astfel încât acestea să poată interacționa cu aplicațiile instalate pentru sarcini precum trimiterea de e-mailuri, comandarea de mâncare sau partajarea de fotografii. Ce contestă Apple și de ce contează Apple a transmis Comisiei Europene un punct de vedere critic față de aceste măsuri, susținând că, dacă vor fi confirmate, ar genera „riscuri profunde” pentru confidențialitatea utilizatorilor, securitate și siguranță, dar și pentru „integritatea și performanța” dispozitivelor, conform Reuters , citată de publicație. În argumentația citată, Apple leagă riscurile de specificul sistemelor AI, pe care le descrie ca fiind într-o evoluție rapidă, cu „capabilități, comportamente și vectori de amenințare” încă imprevizibili. „Măsurile propuse ridică preocupări urgente și serioase. Dacă vor fi confirmate, ar crea riscuri profunde pentru confidențialitatea, securitatea și siguranța utilizatorilor, precum și pentru integritatea și performanța dispozitivului”, a transmis Apple în documentul depus. „Aceste riscuri sunt deosebit de acute în contextul sistemelor AI aflate într-o evoluție rapidă, ale căror capabilități, comportamente și vectori de amenințare rămân imprevizibili”, a mai spus compania. Apple ar fi susținut, de asemenea, că Executivul european încearcă să reproiecteze Android pe baza a „mai puțin de trei luni de muncă”, înlocuind decizii luate de inginerii Google de-a lungul anilor de dezvoltare a sistemului de operare, potrivit aceleiași relatări. Context: ce a propus Comisia și care este calendarul Propunerile Comisiei urmăresc, potrivit comisarului european pentru concurență Teresa Ribera, să ofere „mai multă alegere” utilizatorilor Android în privința serviciilor AI pe care le folosesc și le integrează în telefon. Google a criticat inițiativa ca fiind o „intervenție nejustificată” care ar submina „protecții critice de confidențialitate și securitate” pentru utilizatorii europeni, conform unei relatări anterioare Reuters . Comisia Europeană a acordat terților termen până la 13 mai pentru a trimite feedback, iar decizia finală este așteptată în iulie, când instituția ar urma să stabilească dacă planul Google este conform cu DMA. Pentru context despre regulament, publicația are și un ghid dedicat: DMA . [...]

Apple caută să deschidă App Store pentru aplicații cu „agenți” AI, dar fără să slăbească filtrul de securitate și fără să-și submineze propriile reguli care interzic aplicațiilor să scrie cod și să creeze alte aplicații direct pe iPhone și iPad, potrivit AppleInsider . Miza este una operațională și de control al riscului: procesul de evaluare (review) din App Store este construit ca să verifice aplicațiile înainte de publicare și să reducă expunerea utilizatorilor la pericole precum programe malițioase (malware). În cazul aplicațiilor care pot genera cod sau chiar alte aplicații după ce au trecut de review, Apple nu ar mai putea inspecta în avans ce se produce efectiv pe dispozitiv. De ce „agenții” AI intră în conflict cu regulile App Store Apple ar avea discuții interne despre cum ar putea integra în App Store aplicații care folosesc „agenți” AI (sisteme capabile să execute sarcini mai complexe, în lanț), fără să încalce ghidurile existente. Publicația notează că Apple acceptă folosirea AI pentru a produce aplicații, însă are dificultăți când aplicațiile în sine folosesc AI într-un mod care poate încălca regulile magazinului. Un punct sensibil este „ vibe coding ” – folosirea AI pentru a scrie cod și a crea programe. AppleInsider arată că Apple a blocat până acum aplicații cu capabilități de acest tip, deoarece ghidurile App Store interzic aplicațiilor să „codeze” și să producă alte aplicații direct pe iPhone și iPad. Riscul de securitate și riscul comercial merg în paralel Problema nu este doar teoretică. Dacă o aplicație de „agentic coding” trece de review și apoi generează cod care poate fi folosit pentru malware, acel rezultat nu ar fi fost inspectabil de Apple înainte, tocmai pentru că este creat ulterior, pe dispozitiv. În plus, AppleInsider notează și un risc de venituri: dacă aceste aplicații pot crea „alte aplicații” pentru utilizator, ele ar putea reduce nevoia de a cumpăra aplicații separate din App Store, ceea ce ar pune presiune pe modelul economic al magazinului. Ce soluții ar lua în calcul Apple Compania ar încerca să „reconcilieze” problema prin proiectarea unui sistem care să oblige aplicațiile să respecte standarde de confidențialitate și securitate. O astfel de abordare ar limita însă aplicațiile mai elaborate, cu acces extins în sistem – AppleInsider dă ca exemplu că nu ar exista software de tip „OpenClaw”, cu „acoperire” masivă în întregul sistem al utilizatorului. Pe scurt, Apple ar căuta o cale de mijloc: să permită monetizarea popularității acestor aplicații, dar să reducă riscul ca ele să afecteze ecosistemul. Context: WWDC și deschiderea către modele AI terțe WWDC din iunie este așteptată să includă „mult conținut” legat de AI, însă nu este clar dacă această direcție va include și schimbări pentru App Store. Separat, AppleInsider menționează un alt efort: posibilitatea ca utilizatorii să aleagă modele AI terțe care să ruleze pe iPhone, ca alternativă la Apple Intelligence. În prezent, ChatGPT este deja integrat astfel încât unele funcții Apple Intelligence (inclusiv interogări Siri) să poată rula prin el, iar zvonurile indică suport pentru mai multe modele în generația „27” a sistemelor de operare Apple. Diferența față de dilema App Store: modelele care ar primi acces mai profund în iOS și macOS ar urma să fie aprobate de Apple și supuse unei verificări mai stricte, iar acestea „nu vor avea capacitatea de a scrie cod”, potrivit materialului. [...]

Google integrează în Gboard o dictare AI capabilă să schimbe limba în aceeași propoziție , o funcție care poate reduce fricțiunea pentru utilizatorii bilingvi și poate pune presiune pe aplicațiile terțe de dictare, prin promisiuni explicite de confidențialitate, potrivit IT Home . Funcția, numită Rambler , a fost prezentată la evenimentul „Android Show: I/O Edition 2026” și este integrată direct în tastatura Google Gboard. Ca și alte instrumente de dictare, Rambler poate elimina cuvinte de umplutură („ăă”, „ăhm”) și poate interpreta corecții făcute pe loc în aceeași frază (de tipul „ne vedem la 3… ăă, la 2”), fără să piardă sensul. De ce contează: „code switching” direct în tastatură, în toate aplicațiile Google spune că Rambler folosește un model multilingv bazat pe Gemini și suportă „code switching” – adică trecerea între limbi în cadrul aceleiași propoziții, cu păstrarea contextului. Pentru utilizatori, miza este operațională: dictarea funcționează la nivel de tastatură, deci poate fi folosită „în toate aplicațiile”, nu doar într-un serviciu separat. Compania afirmă că Gboard va indica explicit când Rambler rulează, pentru a evita confuziile privind activarea dictării. Confidențialitate: fără stocarea înregistrărilor, procesare pe dispozitiv și în cloud Pe fondul sensibilității legate de datele vocale, Google susține că funcția „nu stochează nicio înregistrare audio”, folosind sunetul doar pentru transcriere. Ben Greenwood, responsabil pentru Android Core Experiences, a declarat că soluția combină procesare pe dispozitiv și în cloud și că Google a investit „mulți ani” pentru a se asigura că funcția este „sigură și prietenoasă cu confidențialitatea”, în contextul comparației cu aplicațiile terțe de dictare. Disponibilitate: întâi pe Samsung Galaxy și Google Pixel, apoi extindere pe Android Lansarea inițială este programată pentru vară și va fi limitată la telefoane Samsung Galaxy și Google Pixel, urmând ca ulterior să fie extinsă către alte dispozitive Android. Google nu a oferit în materialul citat un calendar detaliat pentru extindere. [...]