Știri

Știri din categoria Inteligență artificială

Marile lanțuri de restaurante testează chatboți AI ca instrument operațional, nu ca înlocuitor de personal, iar miza imediată este reducerea timpilor de lucru și standardizarea execuției în unități cu rotație mare de angajați, potrivit Antena 3.

Tehnologia începe să fie introdusă în bucătării și în zona de preluare a comenzilor pentru a sprijini angajații și a eficientiza procesarea, într-un moment în care companiile caută automatizare în operațiuni și o viteză mai bună de servire.

Starbucks testează în mai multe locații un asistent virtual bazat pe inteligență artificială, „Green Dot Assist”, menit să îi ajute pe angajați și să accelereze procesarea comenzilor. Tehnologia a fost anunțată în 2025 și ar urma să fie extinsă treptat în rețeaua companiei în cursul acestui an, potrivit Fortune, citată de Antena 3.

Compania spune că asistentul AI:

Într-o declarație pentru CNBC, Deb Hall Lefevre, la momentul respectiv director de tehnologie al Starbucks, a prezentat instrumentul ca pe o soluție de simplificare a operațiunilor și de sprijin pentru angajați.

„Este doar un alt exemplu al modului în care tehnologia inovatoare vine în sprijinul partenerilor noștri și ne ajută să simplificăm operațiunile, să le facem munca puțin mai ușoară — poate chiar puțin mai plăcută — astfel încât să poată face ceea ce știu ei mai bine.”

Starbucks a prezentat tehnologia la evenimentul Leadership Experience de anul trecut, în același context în care a anunțat și planuri de extindere a rolului de manager adjunct în „majoritatea magazinelor operate de companie din SUA”, cu aproximativ 90% dintre posturile de management ocupate intern.

Adoptarea AI în restaurante nu este limitată la Starbucks. Antena 3 notează câteva mișcări relevante din piață:

Logan Reich, analist la RBC Capital, a declarat pentru Fortune că introducerea unui chatbot AI nu ar crește semnificativ veniturile, însă poate accelera instruirea și integrarea angajaților, mai ales într-un context în care promovările interne sunt frecvente.

Separat, Gadjo Sevilla, analist senior AI și tehnologie la eMarketer, spune că asocierea implementării AI cu anunțarea unor oportunități de management transmite angajaților mesajul că tehnologia nu este gândită ca să le înlocuiască joburile.

„Ceea ce încearcă să arate este că adoptarea AI poate funcționa împreună cu personalul existent pe termen lung. Nu înlocuiește locuri de muncă, ci le îmbunătățește.”

Extinderea la scară mare vine cu riscuri tipice implementărilor AI. Reich avertizează că, pentru Starbucks, un punct critic va fi ca chatbotul să fie precis și să nu creeze probleme suplimentare în operare.

Sevilla atrage atenția și asupra riscurilor de securitate și a întreruperilor de funcționare, inclusiv în situațiile în care sunt folosite instrumente externe infrastructurii proprii. În acest context, modul în care Starbucks integrează AI în sistemele de vânzare ar putea deveni un reper pentru restul industriei.

„Acesta va fi un test de referință pentru integrarea AI la această scară.”

Recomandate

Groq ar încerca să strângă 650 milioane de dolari (aprox. 3,0 miliarde lei) pentru a-și finanța extinderea pe piața de „inference cloud”. Potrivit TechCrunch , startupul de cipuri pentru inteligență artificială caută bani noi de la investitorii existenți, pe fondul unei repoziționări către un model de afaceri de tip „neocloud” axat pe rularea (inferența) aplicațiilor AI. Informația este atribuită unor surse citate de Axios, care susțin că Groq se bazează în această direcție pe propriul cip și pe propriile sisteme hardware. „Inferența” este etapa de procesare care are loc după ce utilizatorul introduce un prompt, iar TechCrunch notează că, în prezent, cererea pentru inferență este mai mare în industrie decât cea pentru antrenarea modelelor. De ce contează runda: finanțare pentru capacitate, nu doar pentru cercetare Miza economică a rundei este legată de scalarea unei infrastructuri de cloud specializate pentru inferență, un segment unde costurile operaționale și de capital (hardware, centre de date, sisteme) pot crește rapid. În acest context, Groq ar încerca să-și asigure resursele pentru a susține aplicații „însetate” de inferență, folosite de dezvoltatori și companii. Context: acordul „nu chiar achiziție” cu Nvidia TechCrunch reamintește că, în decembrie, Groq a încheiat cu Nvidia un acord descris ca „not-acqui-hire” (o tranzacție care nu este o achiziție completă, dar implică transfer de oameni-cheie și acces la tehnologie). Valoarea raportată a acordului a fost de 20 miliarde de dolari (aprox. 92 miliarde lei) și a inclus plecarea unor angajați seniori către Nvidia, precum și licențierea tehnologiei hardware a Groq către gigantul de cipuri. Publicația notează că tranzacția a fost favorabilă investitorilor Groq, care ar fi fost plătiți în numerar, în condițiile în care, dacă ar fi fost o achiziție integrală, ar fi reprezentat cea mai mare cumpărare făcută vreodată de Nvidia, potrivit Axios. Cine conduce acum și cum ar fi „asigurată” runda Noua direcție este condusă, potrivit TechCrunch, de CEO-ul interimar Adam Winter și de CFO-ul Matt Eng. În plus, Axios afirmă că o parte din finanțare ar fi, „într-un fel”, garantată: investitorii Disruptive și Infinitium ar fi acceptat să completeze runda dacă alți investitori existenți nu își exercită drepturile pro-rata (adică nu participă proporțional pentru a-și menține ponderea). [...]

Diferențele de „diplomație corporativă” dintre Nvidia și AMD în China devin un factor de piață în contextul în care exporturile americane de cipuri pentru inteligență artificială sunt tot mai restrânse, iar Beijingul împinge accelerat către autosuficiență, potrivit Reuters . În timp ce Jensen Huang (Nvidia) a atras atenția publicului la Beijing, pozând pentru fotografii și apărând în spațiul public, Lisa Su (AMD) a avut o vizită mai discretă în China, concentrată pe întâlniri cu clienți și parteneri și pe un eveniment pentru dezvoltatori. Contrastul, notează Reuters, reflectă două stiluri diferite de abordare a celei mai sensibile piețe de hardware pentru inteligență artificială din punct de vedere politic. De ce contează: accesul la piață se joacă și în registru geopolitic Pentru Nvidia, miza în China a fost puternic lovită de controalele de export ale SUA. Huang declara anul trecut că cota de piață a Nvidia în China scăzuse la 50% de la 95% din cauza restricțiilor; între timp, el spune că aceasta a ajuns „efectiv la zero”, pe fondul presiunii Beijingului pentru cipuri avansate produse local. Huang estimase anterior că piața chineză de cipuri pentru inteligență artificială ar valora 50 miliarde dolari (aprox. 230 miliarde lei) anul acesta. În cazul AMD, Reuters citează date IDC potrivit cărora compania are 4% din piața chineză de cipuri pentru inteligență artificială. Diferența este că AMD are mai multe „rute” comerciale către China decât acceleratoarele AI (segmentul-cheie pentru Nvidia), inclusiv: procesoare (CPU), plăci grafice pentru consumatori (GPU), chipseturi pentru inteligență artificială, circuite programabile de tip FPGA (circuite integrate programabile). Analistul-șef Omdia, Lian Jye Su, spune că această diversitate poate ajuta AMD pe măsură ce utilizarea inteligenței artificiale se extinde dincolo de antrenarea modelelor mari către utilizări mai largi în companii. Semnale politice: întâlnirea cu vicepremierul vs. tăcerea la nivel înalt Un element cu greutate, în lectura Reuters, este diferența de tratament la nivel oficial. Lisa Su a avut o întâlnire anunțată public cu vicepremierul chinez He Lifeng, care a transmis că Beijingul „primește cu bun venit” companii precum AMD pentru a „valorifica oportunitățile” și a aprofunda cooperarea. În schimb, nu a existat o întâlnire comparabilă, la nivel înalt, pentru Jensen Huang, aflat la Beijing în jurul summitului dintre Xi Jinping și președintele SUA, Donald Trump, din 14-15 mai, potrivit Reuters. Absența a ieșit în evidență cu atât mai mult cu cât Huang a fost vocal în a susține că restricțiile SUA riscă să cedeze piața chineză rivalilor locali, precum Huawei. Un consilier al unor directori de multinaționale (citat de Reuters sub protecția anonimatului) apreciază că abordarea „cu profil mai jos” a Lisei Su este mai potrivită în mediul geopolitic actual, în care politizarea relațiilor comerciale SUA–China și volatilitatea sentimentului public cresc riscurile de reputație pentru șefii din industria cipurilor. AMD: China rămâne relevantă, dar intrarea pe „ecosistem” e dificilă Lisa Su a spus săptămâna trecută că China generează aproximativ 20% din veniturile AMD și rămâne importantă pentru PC-uri, gaming și unele segmente de centre de date. În paralel, AMD încearcă să câștige teren prin ROCm, pachetul său software open-source pentru calcul accelerat, promovat dezvoltatorilor chinezi într-un moment în care multe companii caută alternative la ecosistemul CUDA al Nvidia, deoarece cele mai avansate cipuri Nvidia sunt greu de obținut. Totuși, Reuters notează limitele: ecosistemul software al AMD este mai puțin matur decât al Nvidia, iar controalele de export ale SUA restricționează și AMD în vânzarea celor mai avansate cipuri pentru inteligență artificială către China. O sursă familiarizată cu operațiunile AMD din China a declarat că AMD a vândut anul trecut un număr semnificativ de cipuri AI către Alibaba, dar compania chineză ar fi trebuit să aloce resurse importante de inginerie pentru depanare și adaptare, din cauza slăbiciunilor ecosistemului software AMD. AMD și Alibaba nu au răspuns solicitărilor de comentarii, potrivit Reuters. Ce urmează: Taiwan, investiții și o competiție care se mută pe mai multe fronturi Cei doi CEO urmează să se reîntâlnească în Taiwan, la Computex , săptămâna viitoare, într-un moment în care ambele companii au prezentat în ultima perioadă planuri mari de investiții în Taiwan, unde se află TSMC , cel mai mare producător de cipuri pe bază de contract din lume. În acest context, diferențele de strategie în China par să se accentueze: Nvidia rămâne prinsă în ecuația geopolitică a exporturilor, iar AMD încearcă să profite de ferestre mai înguste, inclusiv prin software și printr-un portofoliu mai divers de produse permise. [...]

Google începe să mute Gemini din zona de „chatbot” spre automatizare persistentă , odată cu lansarea Gemini Spark pentru abonații Google AI Ultra din SUA, o funcție care rulează în fundal și poate continua sarcini chiar și când telefonul este blocat sau laptopul este închis, potrivit Android Authority . Gemini Spark este prezentat ca un „agent” de inteligență artificială care acționează în numele utilizatorului, dar „sub controlul” acestuia, și rulează 24/7. Funcția apare ca un tab dedicat în experiența web Gemini, alături de chatul standard. Ce se schimbă operațional: de la răspunsuri la execuție de sarcini Diferența centrală față de utilizarea obișnuită a Gemini este accentul pe automatizare. În loc să se limiteze la răspunsuri și generare de conținut, Spark este gândit să „facă” efectiv lucruri în ecosistemul Google, reducând trecerile între aplicații. Concret, Spark se poate conecta la aplicații din Google Workspace (Gmail, Calendar, Drive, Docs, Sheets și Slides) și poate gestiona sarcini precum: programarea de întâlniri și administrarea invitațiilor; căutarea în e-mailuri; rezumarea conversațiilor; crearea de documente, foi de calcul și prezentări; organizarea fișierelor și a conținutului. De ce poate rula când dispozitivul e „oprit”: procesare în cloud Google spune că Spark folosește mașini virtuale în cloud care rulează pe Gemini 3.5, astfel încât sarcinile pot continua chiar dacă utilizatorul își închide laptopul sau își blochează telefonul. Această procesare în fundal este o parte importantă din poziționarea produsului: un asistent digital „persistent”, nu un instrument deschis doar la nevoie. Pe lângă Workspace, Spark primește acces și la servicii conectate, funcții de „Personal Intelligence”, site-uri unde utilizatorul este autentificat și instrumente de browser la distanță care pot interacționa cu pagini web. În unele situații, Spark poate naviga pe site-uri, completa informații și executa acțiuni fără ca utilizatorul să parcurgă manual fiecare pas. Disponibilitate: funcție exclusivă, deocamdată, pentru SUA În acest moment, Gemini Spark este disponibil doar pentru abonații Google AI Ultra din SUA, la câteva zile după ce a fost anunțat la Google I/O 2026. Publicația notează că, dacă lansarea decurge fără probleme, Spark ar putea deveni modelul pentru direcția în care se dezvoltă Gemini în continuare. [...]

Șeful Mistral avertizează că Europa riscă să rămână fără „suveranitate” în AI dacă dezbaterea publică se mută spre „dezarmarea” inteligenței artificiale, într-un moment în care competiția globală se accelerează, potrivit Gizmodo . CEO-ul Mistral, Arthur Mensch, a respins apelul recent al Papei Leon al XIV-lea ca AI să fie „dezarmată”, argumentând că Europa nu își permite să rămână în urma giganților tehnologici americani în cursa pentru modele avansate. Declarațiile au fost făcute în discuții cu jurnaliști, în contextul întrebărilor despre poziția Papei, relatează Reuters, citată de publicație. „Suntem cu toții pentru pace, dar dacă te uiți la rivalii și adversarii noștri din lume, ei folosesc inteligența artificială… Atât timp cât avem adversari care amenință, și ei amenință, avem nevoie să avem propriile noastre capacități.” Investiții și contracte: Mistral își întărește infrastructura în Europa Ieșirea publică a lui Mensch vine în același timp cu o accelerare operațională a companiei. Mistral a anunțat construirea unui nou centru de date de 10 megawați în apropiere de Paris și a semnat noi acorduri cu Airbus și BMW. Obiectivul este poziționarea ca alternativă europeană la rivali americani precum OpenAI, Google, Anthropic și Microsoft. Dimensiunea de reglementare: „suveranitatea tehnologică” intră pe agenda UE În paralel, discuția despre independența tehnologică a Europei capătă formă politică și administrativă. Articolul notează că Franța a anunțat anterior că va renunța la platforme americane de videoconferință precum Microsoft Teams și Zoom, urmând să folosească platforma franceză Visio. Totodată, Franța a semnat un acord pentru ca forțele sale armate să utilizeze modelele și software-ul Mistral. La nivel european, Comisia Europeană ar lucra la o inițiativă legislativă pentru promovarea „suveranității tehnologice” în blocul comunitar, pachet care ar urma să fie prezentat pe 3 iunie, potrivit informațiilor citate de Gizmodo. De ce contează: AI devine argument de securitate, nu doar de piață Mistral și o parte din executivii săi leagă explicit dezvoltarea unor modele tot mai avansate (inclusiv AGI – „inteligență artificială generală”, adică sisteme capabile să rezolve o gamă largă de sarcini la nivel uman) de securitatea geopolitică. Co-fondatorul și cercetătorul-șef Guillaume Lample a spus, potrivit The Wall Street Journal (citat de Gizmodo), că accesul Europei la astfel de modele va deveni critic și a invocat inclusiv potențiale beneficii științifice majore, precum progrese în tratarea cancerului, care ar putea fi inaccesibile dacă Europa nu își dezvoltă propriile capacități. În contrapunct, Papa Leon al XIV-lea a abordat AI într-o enciclică recentă, „Magnifica Humanitas”, menționând riscuri precum deepfake-urile, „companionii” AI, impactul asupra pieței muncii și utilizarea în război. „În era inteligenței artificiale, când demnitatea umană este amenințată de noi forme de dezumanizare, este datoria noastră presantă să rămânem profund umani.” În ansamblu, miza se mută de la o dezbatere morală despre limitarea tehnologiei la o dispută de politică industrială: cine controlează infrastructura, modelele și accesul la capabilități avansate, într-o Europă care încearcă să reducă dependența de furnizori americani. [...]

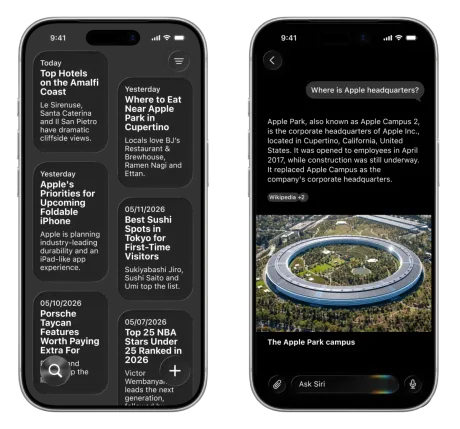

Apple pregătește o integrare Siri-IA la scară de masă în iOS 27 , mizând pe parteneri externi pentru „inteligență” și pe distribuția uriașă a ecosistemului său, potrivit unei analize TechCrunch , bazată pe randări și informații publicate de Bloomberg înainte de WWDC din iunie. Imaginile, realizate de Bloomberg pe baza unor surse, indică faptul că Siri ar urma să fie „țesută” mai adânc în sistemul de operare, cu o interfață care apare din Dynamic Island (zona neagră, în formă de pastilă, din partea de sus a ecranului iPhone). În iOS 27, apăsarea butonului pentru Siri ar declanșa o animație și răspunsuri afișate în acest spațiu, un mod gândit pentru întrebări rapide, similar utilizării actuale. Căutarea de tip Spotlight devine poarta principală către Siri „nouă” O schimbare operațională importantă ar fi un nou mod care aduce „căutarea cu Siri” în gestul deja familiar utilizatorilor: glisarea în jos pentru Spotlight Search (funcția integrată de căutare în telefon și pe web). Gestul ar rămâne același, dar rezultatele ar urma să fie generate de o versiune Siri cu un model refăcut, care „folosește sub capotă” tehnologia de inteligență artificială Gemini de la Google, conform TechCrunch. În această interfață, utilizatorii ar putea, între altele: să caute informații și să lanseze aplicații; să înceapă mesaje; să verifice vremea; să adauge evenimente în calendar; să caute în notițe; să declanșeze „scurtături” (automatizări) din aplicații, cu rezultate afișate ca text formatat, în carduri care apar tot din Dynamic Island, potrivit Bloomberg. Apple ar pregăti și o aplicație Siri separată, în stil „chatbot” Pe lângă integrarea în iOS, Bloomberg mai susține că Apple ar urma să lanseze și o aplicație Siri de sine stătătoare, concepută să concureze direct cu chatboți precum ChatGPT, Claude sau Gemini. Aceasta ar include istoricul conversațiilor și ar permite încărcarea de documente și fotografii, nu doar interacțiune prin text. De ce contează: Apple mizează pe parteneri și pe distribuție, nu pe „construit de la zero” Analiza compară strategia Apple din IA cu parteneriatul său de „miliarde de dolari” cu Google pentru motorul de căutare implicit pe iPhone: în loc să construiască totul intern, compania ar combina tehnologie de la parteneri (pentru capabilități cerute „acum” de utilizatori) cu dezvoltarea propriilor modele, inclusiv „IA locală” care rulează pe dispozitiv, nu în cloud — o direcție care susține poziționarea Apple pe confidențialitate. Miza este amplificată de distribuție: TechCrunch notează că ChatGPT ar avea 900 de milioane de utilizatori activi săptămânal, în timp ce baza instalată Apple (toate dispozitivele, nu doar iPhone) este estimată la 2,5 miliarde. În acest context, integrarea IA direct în iOS ar putea aduce rapid astfel de funcții către utilizatori care nu folosesc încă instrumente IA separate. Notă: informațiile despre interfață și funcții provin din randări și relatări bazate pe surse, publicate de Bloomberg înainte de WWDC; Apple nu a confirmat oficial detaliile în materialul citat. [...]

Visa a făcut o investiție (sumă nedezvăluită) în Replit, iar cele două companii testează integrarea plăților direct în platformă , astfel încât dezvoltatorii și agenții lor de inteligență artificială să poată încasa bani de la clienți fără să iasă din mediul Replit, potrivit TechCrunch . Miza operațională este construirea unei infrastructuri pentru „plăți agentice” – scenariul în care agenți de inteligență artificială cumpără și vând în numele utilizatorilor – într-un mod verificabil și acceptat de rețelele de plăți. Visa spune că peste 1.000 dintre angajații săi folosesc deja Replit pentru prototipare și dezvoltare, un detaliu care sugerează o utilizare internă suficient de matură pentru a justifica un parteneriat mai strâns. Ce vor să integreze Visa și Replit și în ce stadiu sunt proiectele Cele două companii analizează cum pot fi folosite în Replit produse Visa care țintesc plăți asistate de inteligență artificială, inclusiv: Visa Intelligent Commerce , descris ca o suită pentru plăți „alimentate de inteligență artificială”; Visa Trusted Agent Protocol , un sistem prin care agenții de inteligență artificială se pot identifica „în siguranță” prin partajarea unor informații precum intenția și detalii relevante despre client, astfel încât plățile inițiate de agenți să poată fi verificate și considerate de încredere. Publicația precizează că toate aceste inițiative sunt în fază exploratorie , iar companiile nu au anunțat formal produse comune . Context: cursa pentru „plăți agentice” se accelerează Investiția Visa este prezentată ca parte dintr-o competiție mai largă pentru a controla infrastructura viitoarelor tranzacții inițiate de agenți. În același registru, TechCrunch amintește că Robinhood vrea ca utilizatorii să folosească agenți pentru tranzacționare, iar Google lucrează la agenți pentru cumpărături. Replit împinge și pe zona enterprise: contracte de până la 200.000 de dolari fără vânzător Separat de parteneriatul cu Visa, Replit lansează acces enterprise în regim self-service , care permite companiilor să semneze contracte de până la 200.000 de dolari (aprox. 920.000 lei) fără discuții cu un reprezentant de vânzări. Pachetul include funcții de conformitate și control, precum: SSO (single sign-on) – autentificare unică pentru acces la mai multe instrumente cu aceleași credențiale; jurnale de audit; permisiuni avansate. CEO-ul și fondatorul Replit, Amjad Masad , leagă intrarea Visa în acționariat de creșterea tracțiunii pe segmentul enterprise și de obiectivul companiei de a face programarea accesibilă „într-un mod sigur și robust”. Evaluări în creștere și retenție ridicată, potrivit companiei Pe fondul cererii pentru platforme de tip „vibe-coding”, TechCrunch notează că evaluările unor startup-uri precum Replit au urcat rapid: compania a ajuns la 3 miliarde de dolari (aprox. 13,8 miliarde lei) în septembrie anul trecut, iar în martie a ridicat 400 milioane de dolari (aprox. 1,84 miliarde lei) într-o rundă Series D condusă de Georgian Partners, la o evaluare de 9 miliarde de dolari (aprox. 41,4 miliarde lei) . La un eveniment StrictlyVC organizat de TechCrunch în San Francisco, Masad a spus că rata de plecare a clienților este foarte mică , iar retenția netă poate ajunge la 300% în unele cazuri, susținând că, odată ce companiile se obișnuiesc cu „întregul pachet Replit” (inclusiv medii dedicate unui singur client), tind să păstreze aplicațiile în platformă. [...]