Știri

Știri din categoria Inteligență artificială

Anthropic analizează adăugarea unei a patra surse de putere de calcul pentru AI, prin integrarea unor cipuri de inferență de la startup-ul britanic Fractile, într-o mișcare care ar putea reduce dependența de platformele dominante și ar diversifica opțiunile de infrastructură până în 2027, potrivit IT之家.

Informația este atribuită de publicație unui material The Information și indică faptul că discuțiile sunt încă într-un stadiu incipient. Planul vizat ar fi ca Fractile să devină „a patra” categorie de resurse de calcul pentru Anthropic, pe lângă NVIDIA GPU, Amazon Trainium și Google TPU, cu un obiectiv de implementare în 2027.

Pentru companiile care dezvoltă modele de inteligență artificială, accesul la capacitate de inferență (rularea efectivă a modelelor în producție) este un factor operațional și de cost major. Dacă Anthropic reușește să introducă o alternativă viabilă la GPU-urile NVIDIA și la cipurile proprietare ale marilor furnizori cloud, ar putea obține mai multă flexibilitate în aprovizionare și în negocierea costurilor de calcul.

IT之家 notează că Fractile folosește o arhitectură diferită de acceleratoarele AI uzuale (XPU), bazată pe „calcul analogic în memorie” (o abordare în care anumite operații sunt realizate direct în memorie, pentru a reduce transferurile de date). Compania susține că, la rularea „modelelor de top”, ar putea obține:

Aceste performanțe sunt prezentate ca afirmații ale companiei, fără detalii suplimentare în material privind metodologia sau condițiile de testare.

Fractile este descrisă ca un startup britanic de cipuri, iar IT之家 menționează că a primit anterior o investiție de la Pat Gelsinger, fost director general al Intel.

În acest moment, singura certitudine din informațiile disponibile este intenția exploratorie: negocierile sunt „la început”, iar ținta de implementare este 2027, ceea ce lasă loc pentru schimbări de plan, întârzieri sau renunțarea la proiect.

Recomandate

Pentagonul menține interdicția asupra Anthropic , dar tratează separat modelul AI Mythos , evaluat ca tehnologie cu implicații pentru securitatea națională, potrivit Profit . Distincția arată cum autoritățile americane separă riscul de „lanț de aprovizionare” asociat unei companii de utilitatea punctuală a unui model de inteligență artificială în zona de apărare și securitate cibernetică. Modelul Mythos este analizat separat deoarece ar avea capacități avansate de identificare și remediere a vulnerabilităților cibernetice. Directorul tehnologic al Pentagonului, Emil Michael, a spus că aceste capabilități obligă autoritățile să consolideze securitatea rețelelor guvernamentale. Ce înseamnă, practic, „interdicția” pentru Anthropic Deși Mythos e evaluat distinct, statutul Anthropic de „risc pentru securitate” rămâne în vigoare, pe fondul unui conflict deschis între companie și autoritățile americane privind utilizarea tehnologiei sale. Consecința operațională este directă pentru ecosistemul de furnizori ai armatei: firmele contractoare trebuie să certifice că nu folosesc modelele Claude (dezvoltate de Anthropic) în proiecte militare. Compania a dat în judecată administrația americană pentru a contesta decizia de clasificare, conform informațiilor din articol. Context: Pentagonul își extinde parteneriatele AI pentru rețele clasificate În paralel, Pentagonul a anunțat acorduri cu mai multe companii tehnologice majore — OpenAI, Google, Microsoft, Nvidia și Amazon Web Services — pentru implementarea soluțiilor de inteligență artificială în rețelele clasificate ale instituției. Pentru piață, mesajul este că accesul la contracte și implementări în zona de apărare depinde nu doar de performanța tehnologică, ci și de evaluările de risc privind furnizorul și lanțul de aprovizionare, care pot bloca utilizarea unor modele chiar și atunci când anumite componente sunt considerate relevante pentru securitatea națională. [...]

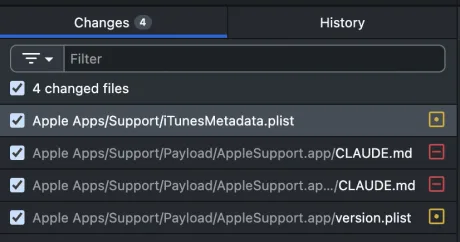

O actualizare a aplicației Apple Support a inclus din greșeală un fișier „Claude.md”, expunând indicii despre cum Apple folosește AI în dezvoltare și în arhitectura de suport , potrivit IT之家 . Incidentul, retras „de urgență” în 24 de ore, ridică o problemă operațională mai importantă decât „vibe coding”: cum mai arată controlul de calitate și revizia de cod când echipele se bazează pe asistenți AI și pe automatizări de livrare. Ce s-a întâmplat și unde a apărut fișierul Fișierul „Claude.md” a ajuns în pachetul de distribuție al aplicației Apple Support odată cu actualizarea la versiunea 5.13, livrată pe 1 mai. Descoperirea a fost semnalată de Aaron Perris, descris în material ca analist la MacRumors. Apple Support este aplicația oficială de asistență post-vânzare, folosită pentru chat cu specialiști, diagnosticare, programări la service și achiziția AppleCare. Ce indică „Claude.md” despre sistemul de suport: AI și oameni pe aceeași „bandă” Conținutul expus descrie o arhitectură de conversație în care Apple ar folosi un sistem cu două „backend-uri” (două componente de server): Juno AI pentru răspunsuri automate; Live Agents pentru preluarea de către operatori umani. Trecerea între cele două ar fi făcută printr-un strat de protocol, astfel încât „codul de deasupra” să nu știe dacă un mesaj vine de la om sau de la AI. În plus, modelul de mesaje ar avea trei roluri: „client” (utilizator), „agent” (operator Apple Support) și „assistant” (AI), procesate prin același flux, fără indicii explicite către utilizator despre cine răspunde, conform descrierii din material. Separat, sursa menționează și un modul „SAComponents”, prezentat ca o bibliotecă de componente de interfață (UI), fără logică de business, cu documentație DocC. De ce contează pentru companii: scăpări de livrare și guvernanță a codului în era AI Materialul pune accent pe faptul că nu fișierul în sine ar fi „marele secret”, ci faptul că un artefact intern a ajuns în producție , ceea ce sugerează o breșă în procesul de revizie și împachetare a aplicației. Discuția se leagă și de o controversă practică: dacă „Claude.md” (un fișier folosit, în general, pentru a instrui un asistent AI despre proiect: structură, reguli, pași de build, „capcane” de evitat) ar trebui: să fie păstrat în controlul versiunilor (ca documentație de proiect), sau să fie ignorat (de tip „configurație de mediu”, ținut local). Însă întrebarea operațională rămâne: cum a trecut fișierul din depozit/arbore de proiect în pachetul final publicat . Context: Apple și Anthropic , plus limitele concluziilor IT之家 notează că Bloomberg, prin Mark Gurman, ar fi indicat anterior că Apple rulează intern o versiune personalizată a modelului Claude pe serverele proprii, pentru a păstra datele în infrastructura companiei. Totodată, este citată și o poziție atribuită unui utilizator Hacker News care se prezintă drept fost angajat Apple: existența multor echipe izolate ar însemna că folosirea Claude într-un proiect nu dovedește automat o practică uniformă la nivelul întregii companii. Articolul mai menționează o statistică dintr-un sondaj pe 120.000 de dezvoltatori, potrivit căreia 92,6% folosesc cel puțin lunar un asistent AI de programare, ca argument că fenomenul este generalizat în industrie. Ce urmează Din informațiile prezentate nu reiese dacă Apple a comunicat public cauza exactă a includerii fișierului sau dacă a schimbat procedurile de livrare. Cert este că retragerea rapidă (în 24 de ore, conform materialului) limitează expunerea, dar nu elimină întrebarea de fond pentru organizațiile care dezvoltă software cu ajutorul AI: cine și cum mai face „review” eficient, astfel încât fișierele și instrucțiunile interne să nu ajungă în producție . [...]

Un mesaj atribuit lui Elon Musk, cu tentă de intimidare, riscă să devină probă-cheie în procesul OpenAI , după ce compania a cerut instanței să permită audierea lui Greg Brockman despre o comunicare prealabilă începerii procesului, potrivit Ars Technica . OpenAI susține, într-un document depus duminică la dosar, că Musk i-a scris președintelui OpenAI, Greg Brockman, cu două zile înainte de debutul procesului, pentru a „testa” interesul pentru o înțelegere. Brockman ar fi răspuns rapid, propunând ca „ambele părți” să renunțe la pretenții, însă Musk ar fi refuzat și ar fi escaladat tonul. În mesajul redat de OpenAI, Musk ar fi spus: „Până la finalul acestei săptămâni, tu și Sam veți fi cei mai urâți oameni din America. Dacă insistați, așa să fie.” De ce contează: excepția care poate face admisibilă o discuție de „settlement” În mod obișnuit, comunicările din negocieri de împăcare (settlement) nu sunt admisibile ca probe. Totuși, OpenAI invocă o excepție pe care instanța ar fi acceptat-o într-un litigiu anterior al lui Musk – procesul din 2022 în care a încercat să se retragă din achiziția Twitter. În acel schimb de mesaje, echipa juridică a lui Musk ar fi propus „renegocierea” prețului pentru a închide procesul, dar ar fi amenințat că „ar fi Al Treilea Război Mondial până la sfârșitul timpului, pe bune” pentru liderii Twitter și „moștenitorii” lor dacă Musk era forțat să cumpere compania la prețul stabilit (despre care Ars Technica amintește că a fost legat de o glumă cu „420”). OpenAI folosește acest precedent pentru a argumenta că și mesajul către Brockman ar trebui tratat ca probă relevantă privind motivațiile lui Musk. Impact procedural: Brockman ar putea depune mărturie despre mesaj Dacă judecătorul admite cererea OpenAI, Brockman ar putea depune mărturie despre mesaj atunci când va urca la bară, „probabil” chiar în ziua respectivă și a doua zi, potrivit publicației. OpenAI sugerează că mesajul ar putea arăta „adevăratele motive” ale lui Musk în acest litigiu. Cererea OpenAI este detaliată într-un document depus la dosar, disponibil aici: court filing . Context: Musk a încercat să închidă litigiul chiar înainte de proces Potrivit materialului, Musk a încercat să ajungă la o înțelegere „cu doar câteva zile” înainte de începerea procesului, în care el acuză că, sub conducerea lui Sam Altman, OpenAI și-ar fi abandonat misiunea de a funcționa ca organizație non-profit care dezvoltă inteligență artificială „în beneficiul umanității”. Procesul a început săptămâna trecută, iar Musk a fost primul martor. Ars Technica notează că el „s-a poticnit” de mai multe ori la audieri, inclusiv prin concesii, iritabilitate și retragerea unor afirmații privind riscurile existențiale ale IA, precum și prin recunoașterea unor limite de cunoaștere privind siguranța IA la propria companie, xAI. (Context suplimentar: Musk stumbled several times .) În acest cadru, admiterea mesajului către Brockman ar putea adăuga o nouă vulnerabilitate pentru Musk, în special dacă instanța acceptă argumentul OpenAI că discuția de „settlement” intră într-o excepție și poate fi folosită ca probă. [...]

Google extinde Circle to Search astfel încât să trimită automat către Google și adrese web, conținutul paginii și fișiere PDF , ceea ce poate schimba practic modul în care utilizatorii primesc răspunsuri generate cu inteligență artificială, dincolo de ce se vede în captura de ecran. Actualizarea apare în versiunea beta a aplicației Google și este în curs de distribuire, potrivit Android Authority . În cea mai recentă versiune beta a aplicației Google (v17.18.24), funcția „Search using your whole screen” a fost redenumită în „Ask about screen”. Dincolo de schimbarea de etichetă, noutatea este că, pe lângă captura de ecran atașată ca până acum, Google va folosi automat „context disponibil”, care poate include URL-ul, conținutul paginii și documente PDF, pentru a genera rezultate mai relevante în AI Mode (modul de răspunsuri asistate de AI din Google Search). Ce se schimbă operațional pentru utilizatori Funcția Circle to Search era limitată la ceea ce „vede” în ecran (practic, informația din captura de ecran). Actualizarea adaugă context suplimentar, fără pași manuali, ceea ce poate duce la răspunsuri mai bine ancorate în sursa reală a informației (pagina sau documentul), nu doar în fragmentul vizibil. Concret, în interfața nouă: caseta de căutare afișează „Ask about screen”; descrierea indică „Search with more context”; este precizat că „URL-ul, conținutul paginii și documente PDF” pot fi trimise automat către Google. Unde funcționează și când ajunge la toată lumea Publicația notează că a reușit să declanșeze încărcarea de URL-uri și PDF-uri folosind „Ask about screen” în Google Chrome și Files by Google, cu posibilitatea ca funcția să meargă și în alte aplicații. Distribuirea este în desfășurare pentru utilizatorii din canalul beta, iar așteptarea este ca schimbarea să ajungă în versiunea stabilă „în zilele și săptămânile următoare”, dacă testele sunt considerate satisfăcătoare. [...]

Un buget de 500 de milioane de dolari (aprox. 2,3 miliarde lei) este direcționat spre infrastructură și date pentru modele AI în biologie , într-un program pe cinci ani derulat de Chan Zuckerberg Biohub , inițiativă care mizează pe simularea celulelor umane pentru a grăbi descoperirea de tratamente, potrivit Mediafax . Proiectul este lansat de Mark Zuckerberg și Priscilla Chan și urmărește dezvoltarea tehnologiilor și a bazelor de date necesare construirii unor modele predictive ale celulelor. Miza operațională este ca simulările digitale să permită studierea proceselor biologice la o scară și o viteză greu de atins în laborator, cu efect direct asupra timpului necesar pentru cercetare și dezvoltare în medicină. Cum se împart banii și ce se finanțează Din totalul de 500 de milioane de dolari, aproximativ 400 de milioane vor fi investiți direct de Biohub, iar 100 de milioane vor fi puși la dispoziția cercetătorilor externi. Datele generate ar urma să fie oferite gratuit cercetătorilor din întreaga lume, pentru a accelera progresul în științele vieții. Inițiativa include parteneriate cu instituții de cercetare și companii tehnologice, iar Nvidia este menționată ca participant la dezvoltarea infrastructurii de calcul necesare. „Datele” rămân blocajul major Succesul proiectului depinde de volumul și calitatea datelor biologice disponibile, pe fondul faptului că modelele de inteligență artificială devin mai precise pe măsură ce sunt antrenate pe seturi de date mai extinse, notează materialul. „Avem nevoie de mult mai multe date decât există în prezent pentru a construi modele care să reflecte complexitatea biologiei”, a explicat Alex Rives, responsabil științific în cadrul Biohub. Context: competiția Big Tech pentru AI în medicină Inițiativa se înscrie într-o tendință mai largă, în care companii mari din tehnologie investesc în utilizarea AI în biologie și medicină. Sunt menționate Alphabet (prin divizia Isomorphic Labs) și Microsoft, care dezvoltă modele AI pentru descoperirea de medicamente și analiză biomedicală. În această logică, proiectul Biohub pariază pe un avantaj de infrastructură: dacă reușește să construiască baze de date și modele predictive suficient de robuste, ar putea reduce semnificativ durata dezvoltării tratamentelor, însă limita rămâne accesul la date biologice suficiente și relevante. [...]

Ministerul Afacerilor Interne mută interacțiunea cu cetățenii pentru noua carte electronică de identitate către un sistem de asistență conversațională bazat pe inteligență artificială , printr-un contract de 10,16 milioane de lei (fără TVA) atribuit companiei Dendrio Innovations , potrivit Profit . Miza operațională este reducerea presiunii pe canalele clasice de informare și automatizarea comunicării în contextul tranziției la noul document de identitate. Achiziția vizează furnizarea unui sistem IT de asistență conversațională (chatbot) care să automatizeze comunicarea cu cetățenii, folosind tehnologii de inteligență artificială. Contractul este finanțat din fonduri din Planul Național de Redresare și Reziliență (PNRR) și este parte dintr-un proiect de sprijinire a tranziției la noua carte electronică de identitate. Cum arată achiziția și ce înseamnă pentru implementare Valoarea contractului atribuit Dendrio Innovations este de 10,16 milioane de lei, fără TVA. Bugetul licitației fusese estimat la 13,01 milioane de lei, fără TVA, conform informațiilor publicate. În competiție au mai depus oferte: Atelier Decumanus Arctic Stream Wing Leading Edge asocierea Arlechin Total Distribution (lider) și Tara Interactive asocierea SQS Business Services (lider) și Seth Dynamics asocierea Costin Holding RMB (lider) și Amerilex De ce contează: digitalizarea „front-office”-ului către cetățeni Mutarea serviciului de informare către un chatbot bazat pe IA indică o schimbare de model în relația MAI cu publicul: de la răspunsuri preponderent umane, prin call-center sau ghișee, către un canal automatizat, disponibil permanent, care poate prelua întrebările repetitive legate de noua carte electronică de identitate. Materialul citat nu detaliază calendarul de implementare, funcționalitățile exacte sau modul în care va fi integrat chatbotul în infrastructura existentă a MAI, astfel că impactul concret asupra timpilor de răspuns și volumelor preluate rămâne de văzut. [...]