Știri

Știri din categoria Inteligență artificială

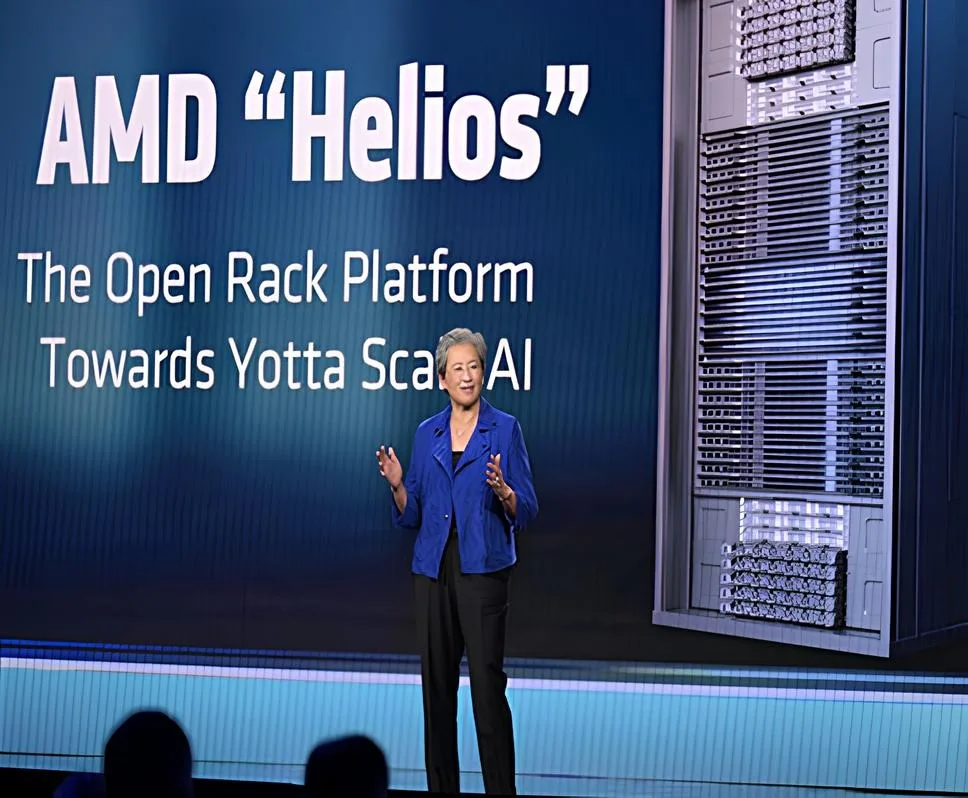

AMD și TCS vor construi în India o infrastructură AI de 200 MW bazată pe arhitectura „Helios”, potrivit comunicatului transmis de companie. Parteneriatul vizează dezvoltarea unei platforme de inteligență artificială la scară rack, destinată inițiativelor naționale de AI și așa-numitelor „fabrici de AI suverane”.

Colaborarea extinde relația strategică dintre AMD, specializată în computing de înaltă performanță, și Tata Consultancy Services (TCS), unul dintre cei mai mari furnizori globali de servicii IT. Prin subsidiara sa HyperVault AI Data Center Limited, înființată în 2025, TCS va contribui la proiectarea infrastructurii și la dezvoltarea centrelor de date pregătite pentru AI.

Arhitectura „Helios” este construită pe baza plăcilor AMD Instinct MI455X, a procesoarelor AMD EPYC „Venice”, a plăcilor de rețea AMD Pensando Vulcano și a ecosistemului software deschis ROCm. Platforma este concepută pentru antrenarea și rularea modelelor AI la scară mare, cu accent pe eficiență operațională și implementare rapidă în mediul enterprise.

Potrivit CEO-ului AMD, Lisa Su, tranziția de la proiecte pilot la implementări AI la scară largă necesită o nouă infrastructură de calcul, iar „Helios” oferă performanță și flexibilitate pe termen lung. La rândul său, CEO-ul TCS, K. Krithivasan, a declarat că inițiativa pune bazele primei infrastructuri AI din India alimentate de această arhitectură și consolidează rolul companiei în ecosistemul AI, de la infrastructură la soluții aplicate.

Planul include dezvoltarea unui centru de date cu o capacitate de până la 200 MW și colaborarea cu hyperscaleri și companii de AI pentru accelerarea extinderii infrastructurii digitale din India.

Recomandate

Procesul dintre Elon Musk și Sam Altman riscă să complice traseul OpenAI către o listare și să amplifice presiunea juridică asupra modelului său hibrid (nonprofit–profit), într-un moment în care compania este descrisă ca fiind „pregătită” pentru un IPO, potrivit Al Jazeera . Într-un proces federal din California , Musk – cofondator OpenAI – a depus mărturie pentru a doua zi, susținând că Altman a „trădat” promisiunile inițiale de a păstra organizația ca nonprofit „dedicată beneficiului umanității”. Litigiul pornește de la înființarea OpenAI în 2015 ca nonprofit și transformarea ulterioară într-o structură orientată spre profit. Musk a declarat în fața juraților că și-a pierdut încrederea că Altman va menține misiunea nonprofit și a spus că, spre finalul lui 2022, se temea că Altman încerca să „fure caritatea”, afirmând că „s-a dovedit a fi adevărat”. Altman a fost prezent în sală, dar nu a depus mărturie, conform relatării. Miza economică: IPO și modelul de finanțare Avocații OpenAI au respins acuzațiile și au susținut că nu a existat niciodată un angajament de a rămâne nonprofit. Compania afirmă că a creat o componentă cu scop lucrativ pentru a finanța nevoile mari de putere de calcul și pentru a atrage talente. În același timp, OpenAI ar fi „pregătită” pentru o ofertă publică inițială care ar putea evalua compania la 1.000 de miliarde de dolari, potrivit Reuters, citată de Al Jazeera. În acest context, disputa privind guvernanța și misiunea inițială poate deveni un factor de risc reputațional și juridic, cu potențiale efecte asupra investitorilor și structurii de control. Ce cere Musk în instanță Musk a investit aproximativ 38 de milioane de dolari (aprox. 174 milioane lei) în OpenAI între 2015 și 2017 și a părăsit organizația în 2018. În proces, el solicită: 150 de miliarde de dolari (aprox. 690 miliarde lei) despăgubiri de la OpenAI și Microsoft , cu orice sumă acordată direcționată către brațul caritabil al OpenAI; obligarea OpenAI să revină la statutul de nonprofit; înlăturarea lui Sam Altman și a cofondatorului Greg Brockman din conducere. Musk a mai susținut că organizația a fost „capturată” și a descris o ofertă de a investi, venită din partea lui Altman, ca părând „ca o mită”. Apărarea OpenAI: competiția cu xAI Echipa juridică a OpenAI afirmă că acțiunea lui Musk urmărește să submineze compania în favoarea propriei sale inițiative, xAI. OpenAI, organizată acum ca „public benefit corporation” (o formă corporativă care combină obiective comerciale cu o misiune de interes public), susține că demersul este alimentat de competiție și notează că xAI este în urma OpenAI la adopția de către utilizatori. Context suplimentar despre proces apare într-un material anterior al publicației, „stand for a second day”, disponibil aici: Al Jazeera . [...]

Google extinde utilizarea practică a Gemini prin generarea directă de fișiere descărcabile , o funcție care reduce pașii operaționali dintre „brainstorm” și livrabile precum documente, foi de calcul sau prezentări, potrivit Google Blog . Actualizarea permite ca, dintr-un simplu prompt în chat, Gemini să creeze fișiere gata de partajat în formate precum PDF, Microsoft Word și Excel, dar și fișiere Google Workspace (Docs, Sheets, Slides). Ideea centrală este eliminarea etapelor de copiere, lipire și reformatări între aplicații, astfel încât utilizatorii să poată trece mai rapid de la idei la un document final, fără să părăsească aplicația Gemini. Ce se schimbă în fluxul de lucru Google indică exemple de utilizare orientate spre productivitate: exportul unei propuneri de buget într-un fișier Microsoft Excel (.xlsx), transformarea unor idei disparate într-o schiță cu puncte-buletă sau condensarea unei colaborări lungi într-un PDF de o pagină ori într-un document Microsoft Word (.docx). Pentru majoritatea formatelor, fișierul poate fi descărcat direct pe dispozitiv sau exportat în Google Drive. Formate acceptate și disponibilitate Lista de formate suportate include: fișiere Workspace (Docs, Sheets, Slides); -.pdf; -.docx; -.xlsx; -.csv; LaTeX; text simplu (TXT); Rich Text Format (RTF); Markdown (MD). Funcția este disponibilă „pentru toți utilizatorii aplicației Gemini la nivel global”, conform aceleiași surse. Utilizarea este descrisă simplu: utilizatorul intră în Gemini și explică ce fișier are nevoie să fie generat. [...]

Google Photos va introduce vara aceasta o funcție care îți cataloghează automat hainele din fotografii și le transformă într-un „dulap digital” , cu opțiuni de filtrare, combinare în ținute și previzualizare „virtual try-on”, potrivit Google . Lansarea începe pe Android , urmând să ajungă ulterior și pe iOS, ceea ce mută aplicația din zona de stocare și organizare a imaginilor spre un instrument practic de planificare a ținutelor, bazat pe inteligență artificială . Ce face concret noua funcție și de ce contează operațional Funcția creează automat o colecție dedicată „wardrobe” (dulap) pe baza pieselor vestimentare care apar în biblioteca ta de fotografii. Practic, aplicația scanează imaginile și extrage articolele de îmbrăcăminte pe care le-ai purtat, apoi le organizează într-o structură ușor de parcurs. Din perspectiva utilizării de zi cu zi, noutatea este că utilizatorul nu mai pornește de la fotografii disparate, ci de la o „inventariere” a garderobei, generată automat, care poate reduce timpul de căutare și de planificare a ținutelor. Cum se folosește: filtrare, ținute și „probă” virtuală Google descrie trei utilizări principale: Filtrare pe categorii : poți vedea toate articolele la un loc sau poți intra pe o categorie (de exemplu bijuterii, topuri sau pantaloni) pentru a redescoperi piese „uitate” în dulap. Crearea de ținute : poți combina articolele pentru a construi outfituri, pe care le poți distribui prietenilor sau salva într-un „moodboard” (panou de inspirație) digital. Pot exista moodboard-uri separate pentru ocazii diferite, precum nunți de vară, o călătorie în Italia sau ținute de lucru. „Try it on” (probă virtuală) : selectezi piese individuale și folosești opțiunea „Try it on” pentru a vedea cum ar arăta o combinație înainte să te îmbraci. Când ajunge la utilizatori Funcția „wardrobe” va începe să fie disponibilă în această vară , mai întâi în Google Photos pe Android , apoi pe iOS , conform anunțului. Google nu oferă în material un calendar mai detaliat (date exacte) și nici informații despre disponibilitatea pe piețe sau condiții de acces. [...]

OpenAI își schimbă strategia de infrastructură și se îndepărtează de ideea de a deține centre de date „ Stargate ”, preferând să închirieze pe termen lung capacitate de calcul , o mutare care reduce nevoia de investiții directe, dar tensionează relațiile cu partenerii și ridică semne de întrebare privind predictibilitatea companiei, potrivit Tom's Hardware . În forma inițială, Stargate a fost prezentat la începutul lui 2025 ca un joint venture cu Oracle și SoftBank, cu o țintă de investiții de 500 de miliarde de dolari (aprox. 2.250 miliarde lei) în centre de date pentru inteligență artificială în SUA. După „mai mult de un an” de dificultăți și neînțelegeri, OpenAI ar fi renunțat, în practică, la ideea de a deține infrastructură alături de parteneri și ar fi trecut la acorduri mai flexibile, bazate pe furnizori terți și închiriere de capacitate, conform Financial Times. De ce contează: mai puțin capital blocat, dar mai mult risc de execuție și încredere Schimbarea are o logică financiară pentru o companie care „arde numerar” și care ar fi ratat în ultimele luni ținte interne de venituri, notează materialul. În același timp, repoziționarea a produs „haos” în rândul partenerilor și a pus sub semnul întrebării fiabilitatea OpenAI, în condițiile în care raportul citat susține că startup-ul a „abandonat în practică” joint venture-ul, în favoarea unor acorduri bilaterale mari (inclusiv cu Oracle). O persoană implicată în proiect ar fi spus că OpenAI a „tras pe linie moartă centrele de date proprii”, iar compania ar fi admis că Stargate este doar un „termen umbrelă” pentru strategia sa de capacitate de calcul. Efecte colaterale: proiecte puse pe pauză și parteneri nemulțumiți Incertitudinile ar fi afectat și proiecte din afara SUA. Guvernul britanic a semnat un acord cu OpenAI și alți parteneri pentru construirea unui centru de date în Marea Britanie, însă OpenAI l-a pus „pe hold” la începutul acestei luni, invocând „reglementări restrictive” și „costuri ridicate ale energiei”. Ministrul britanic pentru IA, Kanishka Narayan, a declarat pentru Financial Times că singurul lucru care s-a schimbat față de momentul angajamentelor ar fi fost „mediul de finanțare pentru OpenAI”. În paralel, unele părți implicate ar fi rămas cu sentimentul că au fost „dezamăgite și induse în eroare”, pe fondul deciziei Microsoft de a interveni în unele proiecte pe care OpenAI le-ar fi abandonat. O sursă citată de publicație a punctat că „banii nu sunt nelimitați”, iar o alta a spus că ar prefera Microsoft ca „chiriaș”, pentru că „este mai solvabil”. În lipsa unor detalii suplimentare în material despre calendarul noilor acorduri sau despre ce proiecte vor continua efectiv sub „umbrela” Stargate, rămâne de urmărit cum va arăta, concret, mixul de furnizori și contracte prin care OpenAI își va asigura capacitatea de calcul în perioada următoare. [...]

Alphabet își leagă creșterea din T1 2026 de monetizarea și eficientizarea AI , cu un avans de 19% la Search & Other Advertising și o accelerare puternică în Cloud, unde veniturile au urcat cu 63% și au depășit pentru prima dată 20 mld. dolari (aprox. 92 mld. lei), potrivit Google . Mesajul CEO-ului Sundar Pichai , publicat ca transcript editat al intervenției din apelul cu investitorii, pune accent pe faptul că investițiile în inteligență artificială și abordarea „full-stack” (de la infrastructură la modele și aplicații) „conduc performanța” în toate liniile majore de business. Din perspectivă economică, două elemente ies în față: ritmul de creștere al Cloud și încercarea de a ține sub control costurile și latența (timpul de răspuns) pe măsură ce AI este integrată în produse cu audiență masivă, precum Search. Cloud: creștere pe AI, contracte mari și backlog în salt Google indică o cerere ridicată pentru produse și infrastructură AI în Cloud. În T1 2026, veniturile Cloud au crescut cu 63% și au depășit 20 mld. dolari (aprox. 92 mld. lei), iar „backlog”-ul (valoarea contractelor semnate, dar încă neîncasate) „aproape s-a dublat” față de trimestrul anterior, la peste 460 mld. dolari (aprox. 2.116 mld. lei). Compania mai susține că soluțiile sale de AI pentru companii au devenit „principalul motor de creștere” pentru Cloud „pentru prima dată”, iar veniturile din produse construite pe modelele sale generative au crescut „aproape 800%” față de anul anterior. La nivel comercial, Google menționează: dublarea achiziției de clienți noi față de aceeași perioadă a anului trecut; dublarea numărului de contracte între 100 mil. și 1 mld. dolari (aprox. 460 mil.–4,6 mld. lei) față de anul anterior și semnarea „mai multor” contracte de peste 1 mld. dolari; depășirea angajamentelor inițiale de către clienți cu 45%, în accelerare față de trimestrul anterior. Pe produs, Google arată că Gemini Enterprise a crescut cu 40% trimestru la trimestru ca utilizatori activi lunari plătitori, iar vânzările prin parteneri au urcat de 9 ori față de anul anterior (atât ca „seats” vândute, cât și ca număr de parteneri care adoptă intern produsul). Search: mai mult AI, dar cu presiune pe cost și viteză În Search, compania spune că interogările sunt la un maxim istoric și că AI Overviews și AI Mode contribuie la creștere și la revenirea utilizatorilor. În același timp, Google insistă pe eficiență: afirmă că a redus latența Search cu peste 35% în ultimii cinci ani, iar după trecerea AI Overviews și AI Mode la Gemini 3 a redus costul răspunsurilor AI „de bază” cu peste 30%, prin îmbunătățiri de hardware și inginerie. Aceste detalii sunt relevante pentru modelul economic al Search: integrarea AI în pagina de rezultate tinde să crească consumul de calcul, iar controlul costurilor devine o condiție pentru a susține marje și investiții. Infrastructură și modele: TPU-uri noi și volum în creștere Google își leagă strategia de AI de infrastructură proprie (TPU-uri – procesoare specializate pentru AI) și de opțiuni multiple de calcul, inclusiv GPU-uri NVIDIA. Compania spune că va fi „printre primii” furnizori care vor oferi NVIDIA Vera Rubin NVL72, pe lângă instanțe bazate pe Blackwell și Hopper. La Cloud Next, Google a prezentat TPU-urile de generația a opta, cu două variante: TPU 8t (pentru antrenare) și TPU 8i (pentru inferență – rularea modelului pentru a genera răspunsuri). Potrivit companiei, TPU 8t are de trei ori puterea de procesare față de Ironwood și de două ori performanța, iar TPU 8i oferă cu 80% mai bună performanță per dolar decât generația anterioară. La nivel de utilizare, Google afirmă că modelele sale „first-party” procesează peste 16 miliarde de tokeni pe minut prin utilizare directă a API-urilor de către clienți (față de 10 miliarde în trimestrul anterior). În ultimele 12 luni, 330 de clienți Google Cloud ar fi procesat fiecare peste 1 trilion de tokeni, iar 35 au depășit pragul de 10 trilioane. Abonamente și YouTube: baza plătitoare crește Pe zona de consum, Google spune că a avut „cel mai puternic trimestru” pentru planurile sale de AI pentru consumatori, în principal datorită adopției aplicației Gemini. Numărul total de abonamente plătite a ajuns la 350 de milioane, cu YouTube și Google One ca principali contributori. Separat, compania notează că YouTube Music și Premium au avut în T1 cea mai mare creștere trimestrială a numărului de abonați (excluzând perioadele de probă), atât la nivel global, cât și în SUA, de la lansarea YouTube Premium în iunie 2018. Ce urmează Google indică drept repere apropiate evenimentele I/O, Brandcast și Google Marketing Live, unde ar urma să ofere mai multe detalii despre evoluțiile din Search și AI. În paralel, mesajul către investitori rămâne unul consecvent: creșterea vine din extinderea AI în produse și din monetizarea acesteia în Cloud, cu accent pe infrastructură și pe reducerea costurilor de operare pe măsură ce utilizarea se intensifică. [...]

LG Electronics discută cu Nvidia o posibilă cooperare pe centre de date AI, robotică și mobilitate , o combinație care ar putea împinge compania sud-coreeană mai adânc în lanțul de furnizori pentru infrastructura AI și ar extinde prezența Nvidia dincolo de zona industrială, potrivit The Next Web . LG a confirmat miercuri că poartă discuții cu Nvidia pentru colaborare în trei direcții: robotică, centre de date pentru inteligență artificială și mobilitate. Întâlnirea a avut loc după o vizită la sediul LG din Yeouido (Seul) a lui Madison Huang, director senior Nvidia pentru platforme de „AI fizic” (inteligență artificială integrată în roboți și sisteme autonome), alături de reprezentanți ai altor companii tehnologice sud-coreene; la discuții a participat și CEO-ul LG, Ryu Jae-cheol. Nu există, deocamdată, un acord formal. Discuțiile sunt descrise ca fiind exploratorii, fără produse, sume de investiții sau calendare confirmate. De ce contează: miza comercială imediată pare să fie centrele de date Deși componenta de robotică este cea mai vizibilă public, materialul indică faptul că discuțiile despre centre de date și mobilitate ar putea avea o relevanță comercială mai rapidă. În zona centrelor de date, LG și-a poziționat deja oferta ca furnizor de soluții de răcire și management termic (HVAC) pentru centre de date AI, pe fondul creșterii densității de putere a clusterelor de GPU, care face răcirea convențională tot mai dificilă. O eventuală colaborare cu Nvidia ar plasa LG ca furnizor hardware în ecosistemul Nvidia la nivel de infrastructură, completând stratul de calcul (compute) cu cel de răcire, fără a concura direct cu acesta. Robotică: LG are platformă proprie, Nvidia are „stack”-ul de dezvoltare La CES 2026, LG a prezentat CLOiD, un robot pentru acasă cu două brațe articulate (șapte grade de libertate pe braț) și câte cinci degete acționate individual la fiecare mână, parte din viziunea „Zero Labor Home”, în care roboții și electrocasnicele conectate preiau sarcini casnice. Robotul rulează pe platforma proprie LG, „Affectionate Intelligence”, orientată spre conștientizare contextuală, interacțiune naturală și învățare continuă din mediul de acasă. În schimb, Nvidia vine cu Isaac (platforma sa pentru robotică), care include simulare, modele pre-antrenate pentru manipulare, infrastructură de „geamăn digital” (digital twin) bazată pe Omniverse și calcul pe GPU optimizat pentru inferență în timp real. Integrarea ar putea scurta drumul de la prototip la producție, printr-un flux de dezvoltare–implementare deja validat în industrie. Pentru Nvidia, un partener precum LG ar însemna acces la scară de consum: distribuție de masă, o bază instalată globală de electrocasnice conectate prin ecosistemul ThinQ și un plan explicit de a aduce roboți în locuințe — un mediu bogat în date pentru antrenare (sarcini reale, variabilitate mare). Mobilitate: integrare posibilă între „experiența din cabină” și platforma de calcul Pe mobilitate, discuțiile ar putea lega platforma Nvidia DRIVE (folosită pe scară largă pentru calcul AI în vehicule autonome și semi-autonome) de activitatea LG din componente auto. Divizia LG produce sisteme de infotainment, camere, componente pentru vehicule electrice și soluții AI în mașină (inclusiv urmărirea privirii, afișaje adaptive și platforme generative multimodale). O colaborare ar putea integra stratul de experiență AI din cabină al LG cu platforma de calcul DRIVE a Nvidia. Context: „AI-ul fizic” trece de la teste controlate la parteneriate comerciale Materialul plasează discuțiile în tendința mai largă de accelerare a „AI-ului fizic”, adică trecerea de la modele rulate în cloud la sisteme care operează în lumea reală (roboți, vehicule, logistică). Sunt menționate, ca repere, un trial Siemens–Nvidia într-o fabrică din Erlangen și o rundă de finanțare de 110 milioane de dolari (aprox. 506 milioane lei) atrasă de Sereact pentru scalarea AI-ului care face roboții adaptabili. În acest moment, singura certitudine este existența discuțiilor și ariile vizate; dacă și când se va ajunge la un acord, precum și forma concretă (produse, investiții, termene), rămân neconfirmate. [...]