Știri

Știri din categoria Inteligență artificială

LG Electronics discută cu Nvidia o posibilă cooperare pe centre de date AI, robotică și mobilitate, o combinație care ar putea împinge compania sud-coreeană mai adânc în lanțul de furnizori pentru infrastructura AI și ar extinde prezența Nvidia dincolo de zona industrială, potrivit The Next Web.

LG a confirmat miercuri că poartă discuții cu Nvidia pentru colaborare în trei direcții: robotică, centre de date pentru inteligență artificială și mobilitate. Întâlnirea a avut loc după o vizită la sediul LG din Yeouido (Seul) a lui Madison Huang, director senior Nvidia pentru platforme de „AI fizic” (inteligență artificială integrată în roboți și sisteme autonome), alături de reprezentanți ai altor companii tehnologice sud-coreene; la discuții a participat și CEO-ul LG, Ryu Jae-cheol.

Nu există, deocamdată, un acord formal. Discuțiile sunt descrise ca fiind exploratorii, fără produse, sume de investiții sau calendare confirmate.

Deși componenta de robotică este cea mai vizibilă public, materialul indică faptul că discuțiile despre centre de date și mobilitate ar putea avea o relevanță comercială mai rapidă.

În zona centrelor de date, LG și-a poziționat deja oferta ca furnizor de soluții de răcire și management termic (HVAC) pentru centre de date AI, pe fondul creșterii densității de putere a clusterelor de GPU, care face răcirea convențională tot mai dificilă. O eventuală colaborare cu Nvidia ar plasa LG ca furnizor hardware în ecosistemul Nvidia la nivel de infrastructură, completând stratul de calcul (compute) cu cel de răcire, fără a concura direct cu acesta.

La CES 2026, LG a prezentat CLOiD, un robot pentru acasă cu două brațe articulate (șapte grade de libertate pe braț) și câte cinci degete acționate individual la fiecare mână, parte din viziunea „Zero Labor Home”, în care roboții și electrocasnicele conectate preiau sarcini casnice.

Robotul rulează pe platforma proprie LG, „Affectionate Intelligence”, orientată spre conștientizare contextuală, interacțiune naturală și învățare continuă din mediul de acasă. În schimb, Nvidia vine cu Isaac (platforma sa pentru robotică), care include simulare, modele pre-antrenate pentru manipulare, infrastructură de „geamăn digital” (digital twin) bazată pe Omniverse și calcul pe GPU optimizat pentru inferență în timp real. Integrarea ar putea scurta drumul de la prototip la producție, printr-un flux de dezvoltare–implementare deja validat în industrie.

Pentru Nvidia, un partener precum LG ar însemna acces la scară de consum: distribuție de masă, o bază instalată globală de electrocasnice conectate prin ecosistemul ThinQ și un plan explicit de a aduce roboți în locuințe — un mediu bogat în date pentru antrenare (sarcini reale, variabilitate mare).

Pe mobilitate, discuțiile ar putea lega platforma Nvidia DRIVE (folosită pe scară largă pentru calcul AI în vehicule autonome și semi-autonome) de activitatea LG din componente auto. Divizia LG produce sisteme de infotainment, camere, componente pentru vehicule electrice și soluții AI în mașină (inclusiv urmărirea privirii, afișaje adaptive și platforme generative multimodale). O colaborare ar putea integra stratul de experiență AI din cabină al LG cu platforma de calcul DRIVE a Nvidia.

Materialul plasează discuțiile în tendința mai largă de accelerare a „AI-ului fizic”, adică trecerea de la modele rulate în cloud la sisteme care operează în lumea reală (roboți, vehicule, logistică). Sunt menționate, ca repere, un trial Siemens–Nvidia într-o fabrică din Erlangen și o rundă de finanțare de 110 milioane de dolari (aprox. 506 milioane lei) atrasă de Sereact pentru scalarea AI-ului care face roboții adaptabili.

În acest moment, singura certitudine este existența discuțiilor și ariile vizate; dacă și când se va ajunge la un acord, precum și forma concretă (produse, investiții, termene), rămân neconfirmate.

Recomandate

Departamentul american al Apărării își extinde rapid accesul la instrumente de inteligență artificială pe rețele militare clasificate , după ce Amazon Web Services (AWS) , Microsoft și NVIDIA au semnat acorduri care permit Pentagonului utilizarea tehnologiilor lor „pentru utilizare operațională legală”, potrivit Engadget . Informația este relatată inițial de Bloomberg , care notează că, alături de cele trei companii, și Reflection AI a încheiat un acord similar. Pentagonul a transmis, într-o declarație citată de Bloomberg, că aceste acorduri „accelerează transformarea” către un model în care armata SUA devine o „forță de luptă AI-first” (orientată în primul rând către folosirea inteligenței artificiale). Ce se schimbă operațional: AI pe rețele clasificate Elementul cu impact direct este faptul că instrumentele de AI ale companiilor vor putea fi folosite pe rețele militare clasificate , ceea ce ridică miza față de utilizări comerciale sau administrative. Formularea „pentru utilizare operațională legală” indică un cadru de utilizare în interiorul regulilor și procedurilor militare, fără ca materialul citat să detalieze ce tipuri de aplicații vor fi implementate efectiv. Lista furnizorilor se lărgește; Anthropic rămâne în afara acordurilor Engadget arată că AWS, Microsoft și NVIDIA se alătură altor companii care au semnat acorduri similare cu Departamentul Apărării, între care xAI, OpenAI și Google. În acest context, Anthropic este prezentată drept singurul furnizor major de AI din SUA care nu are un acord funcțional cu Pentagonul. Materialul descrie și tensiunile dintre administrația Trump și Anthropic: în februarie, secretarul apărării Pete Hegseth ar fi amenințat că va eticheta compania drept „risc pentru lanțul de aprovizionare” dacă nu renunță la măsuri de protecție care împiedică folosirea chatbotului Claude pentru supraveghere în masă a americanilor sau în arme complet autonome. După refuzul companiei, președintele Trump a ordonat agențiilor federale să înceteze utilizarea produselor Anthropic în termen de șase luni, iar disputa a ajuns în instanță. Reacție publică: semnal de risc reputațional pentru furnizori Engadget notează că ritmul de adopție al AI în apărare și viteza cu care marile companii americane „se aliniază” pentru a vinde către administrația Trump ar trebui să fie un motiv de îngrijorare pentru cetățenii SUA. Ca indiciu al sensibilității publice, publicația citează date ale firmei de inteligență de piață Sensor Tower: OpenAI ar fi înregistrat o creștere cu 413% de la an la an a dezinstalărilor aplicației ChatGPT în februarie, după acordul companiei cu Departamentul Apărării. Ce urmează, pe baza informațiilor disponibile, este extinderea acestui tip de parteneriate în zona militară, cu o presiune tot mai mare pe furnizorii care nu acceptă condițiile Pentagonului și cu posibile costuri de imagine pentru cei care intră în astfel de acorduri. [...]

Blocajele de reglementare care țin pe loc livrările Nvidia H200 către China pot accelera transferul de cotă de piață către Huawei , într-o piață locală de cipuri pentru inteligență artificială estimată să ajungă la 67 miliarde dolari (aprox. 308 miliarde lei) până în 2030, potrivit unei analize Tom's Hardware , care citează un reportaj Financial Times și estimări Morgan Stanley. Potrivit Financial Times (link în sursă), Huawei este „pe drumul” de a capta cea mai mare cotă din piața chineză de cipuri AI chiar din acest an, pe fondul cererii în creștere din partea companiilor chineze pentru alternative interne la Nvidia. Contextul: operațiunile Nvidia din China, care ar fi reprezentat anterior până la 25% din veniturile diviziei de centre de date, sunt afectate de restricții la export și bariere de reglementare impuse atât de SUA, cât și de China, pe fondul tensiunilor comerciale și tehnologice. De ce s-au blocat livrările H200: cerințe contradictorii SUA–China Tom’s Hardware notează că Jensen Huang, CEO-ul Nvidia, a confirmat în martie 2026 că firma a primit licențe din SUA pentru a vinde cipuri AI H200 către China și că a repornit producția pentru a acoperi cererea. Totuși, deși compania ar fi obținut aprobarea SUA și comenzi de la clienți chinezi, livrările au întâmpinat obstacole, cu posibile întârzieri legate de reglementările chineze de import. Financial Times susține că Beijingul ar fi instruit companiile chineze de tehnologie să limiteze utilizarea cipurilor Nvidia la operațiunile lor din afara țării, în timp ce sprijină producția internă. În paralel, autoritățile americane cer ca toate cipurile Nvidia comandate de clienți chinezi să fie folosite doar în China. Rezultatul, potrivit materialului: un blocaj la nivelul procedurilor vamale pentru H200, pe fondul acestor cerințe care se bat cap în cap. Pariul Huawei: „inference” și clustere, nu performanță brută Deși cipurile Nvidia rămân mai avansate, Huawei ar urmări o strategie diferită: țintește segmentul de „inference” (calculul folosit de modelele AI pentru a genera răspunsuri și a executa sarcini după finalizarea antrenării), descris ca fiind în creștere rapidă. Conform Financial Times, Huawei și-a poziționat procesoarele 950PR drept opțiunea preferată pentru companiile locale care rulează sarcini de inference. Argumentul Huawei, redat în articol: pe măsură ce asistenții AI și agenții autonomi devin mai răspândiți, inference ar urma să devină cea mai mare sursă de cerere pentru putere de calcul AI. Pentru că aceste sarcini sunt, în general, mai puțin solicitante decât antrenarea modelelor foarte mari, Huawei poate rămâne competitivă chiar dacă performanța brută a cipurilor este mai slabă. Pentru a compensa, compania ar lega un număr mare de cipuri folosind tehnologie proprie de rețelistică, construind clustere (grupuri de servere/cipuri care lucrează împreună) pentru a crește performanța la nivel de sistem. Un exemplu invocat: DeepSeek ar fi folosit cipul Huawei 950PR pentru inference, deși cel mai recent model v4 ar fi fost antrenat pe cipuri Nvidia, potrivit confirmării companiei menționate în articol. Miza economică: o piață de 67 mld. dolari și o pondere tot mai mare pentru furnizorii locali Estimările Morgan Stanley citate indică o schimbare structurală: piața de cipuri AI din China ar putea ajunge la circa 67 miliarde dolari (aprox. 308 miliarde lei) până în 2030, iar companiile locale ar urma să acopere aproximativ 86% din cerere. Tot Morgan Stanley estimează că furnizorii chinezi ar putea reprezenta, singuri, circa 21 miliarde dolari (aprox. 97 miliarde lei) din piață chiar în acest an. În paralel, Huawei își sprijină planurile de creștere pe capacitatea de producție internă: majoritatea cipurilor sale AI sunt fabricate de SMIC , iar compania ar plănui să adauge încă două fabrici dedicate în acest an. Dacă își crește producția cu succes, prognoza inițială de venituri ar putea fi depășită, potrivit articolului. Ce rămâne în avantajul Nvidia Chiar și cu presiunea de reglementare, Nvidia păstrează avantaje importante, în special ecosistemul software. Tom’s Hardware arată că, deși Huawei dezvoltă platforma Cann ca alternativă internă la CUDA (platforma software Nvidia folosită pe scară largă), dezvoltatorii spun că aceasta rămâne în urmă la capitolele ușurință de utilizare și maturitate. Costurile operaționale și complexitatea de dezvoltare pot crește pentru clienți, ceea ce ajută Nvidia să își mențină influența globală. În China, însă, „prinderea” Nvidia s-a slăbit după ce Washingtonul a blocat anul trecut vânzările H20 (un procesor modificat pentru piața chineză, conform cerințelor de export), iar compania ar avea dificultăți în a găsi un produs care să respecte simultan regulile americane și cerințele de reglementare chineze. „Ziua în care DeepSeek apare mai întâi pe Huawei este un rezultat groaznic pentru națiunea noastră – ar putea duce la un scenariu în care modelele AI din întreaga lume sunt dezvoltate și rulează cel mai bine pe hardware non-american”, a spus Jensen Huang, într-un interviu recent citat de articol. În lipsa unei deblocări rapide a livrărilor H200 și a unei soluții stabile de conformare pe ambele maluri, riscul operațional pentru Nvidia este ca piața chineză să se reorienteze accelerat către furnizori locali, cu efect direct asupra veniturilor și a influenței ecosistemului său în a doua cea mai mare economie a lumii. [...]

Procesul dintre Elon Musk și OpenAI mută disputa despre AI în zona de control și guvernanță, cu Microsoft în centrul mizei – potrivit Antena 3 , conflictul juridic ridică întrebarea practică a pieței: cine ajunge să decidă direcția unei tehnologii pe care chiar actorii din industrie o descriu drept potențial „superinteligență” (AGI), adică un nivel ipotetic în care capacitățile mașinii le depășesc pe cele umane. Miza imediată a procesului, așa cum este prezentată în material, este schimbarea OpenAI de la un „laborator” nonprofit la o structură orientată spre profit, supravegheată de o fundație nonprofit. Musk susține că liderii OpenAI ar fi trădat misiunea inițială – dezvoltarea AI „în mod sigur și transparent” – în favoarea obiectivului de a face bani. OpenAI, la rândul său, afirmă că Musk, cofondator plecat în 2018, ar fi devenit vocal abia acum din cauza succesului lui Sam Altman pe o piață pe care concurează și compania de AI a lui Musk, xAI, despre care Antena 3 notează că a fuzionat în februarie cu SpaceX. Microsoft, „controlul” și disputa despre cine decide În depoziția din această săptămână, Musk a reluat ideea că, în primii ani ai OpenAI, el ar fi trebuit să fie la conducere pentru a se asigura că tehnologia este folosită în siguranță. În același context, el a invocat investiția Microsoft de 20 de miliarde de dolari în OpenAI (aprox. 92 miliarde lei) ca motiv de îngrijorare, argumentând că „Microsoft are propriile motivații” care ar putea devia de la obiectivele inițiale. Musk a formulat în instanță și o întrebare către jurați, în linie cu teza sa privind riscurile: „Chiar ați vrea ca Microsoft să controleze superinteligența digitală?” Materialul citat de Antena 3, o analiză CNN, punctează însă că alternativa sugerată implicit de Musk, cel puțin în primii ani ai OpenAI, ar fi fost un control concentrat în jurul lui Musk și al unui consiliu dominat de numiri făcute de el. Musk ar fi spus că „avea nevoie de control” la început, anticipând ulterior diluarea participației prin intrarea altor investitori. O listă scurtă de „stăpâni” ai AGI și problema de legitimitate Analiza CNN redată de Antena 3 susține că, în timp ce părțile se contrazic, opțiunile discutate rămân, practic, în interiorul unui cerc restrâns de mari jucători: Musk, OpenAI (condusă de Sam Altman), Microsoft și, eventual, Google, Meta sau Anthropic. În același material apare și reacția unor membri ai juriului, care ar indica o ostilitate față de Musk, inclusiv formulări dure din chestionarele de selecție. Judecătoarea federală Yvonne Gonzalez Rogers ar fi recunoscut existența acestei ostilități, dar a susținut că ea nu exclude integritatea procesului judiciar. Instanța delimitează tema: nu este un proces despre riscurile AI Judecătoarea a intervenit și pe fondul retoricii despre riscurile existențiale ale AI, remarcând – potrivit textului – ironia faptului că Musk dezvoltă o companie în același domeniu. Tot ea a delimitat însă obiectul cauzei, spunând că nu este un proces despre riscurile AI sau efectele asupra omenirii, ci că acesta ar putea fi subiectul unui proces viitor. În termeni de impact, cazul evidențiază o tensiune care depășește disputa dintre două nume: cum se stabilește guvernanța (cine controlează, cu ce mandat și ce mecanisme de verificare) într-o industrie în care capitalul mare și infrastructura tehnologică tind să concentreze decizia în mâinile câtorva companii și fondatori. [...]

Sam Altman încearcă să reducă anxietatea legată de concedieri, susținând că OpenAI vizează „instrumente” care amplifică munca oamenilor, nu „entități” care îi înlocuiesc , potrivit IT之家 . Mesajul vine pe fondul unei percepții tot mai răspândite că inteligența artificială ar putea prelua o parte semnificativă din locurile de muncă, după un an marcat în SUA de valuri de disponibilizări. Altman a scris pe platforma X că direcția companiei este să construiască tehnologii care „îmbunătățesc și cresc capacitățile umane”, nu sisteme menite să înlocuiască oamenii. În aceeași intervenție, el a argumentat că pesimismul pe termen lung legat de „înlocuirea oamenilor de către AI” este greșit, deoarece, în timp, oamenii vor găsi „munci mai semnificative”. De ce contează: concedierile asociate cu AI alimentează rezistența față de tehnologie Publicația dă ca exemplu cazul dezvoltatorului jocului mobil „Candy Crush”, compania King, care ar fi concediat ingineri ce lucrau la un instrument de generare a nivelurilor cu ajutorul AI, după finalizarea proiectului, aceștia fiind înlocuiți de sistemul pe care l-au construit. În acest context, IT之家 notează că mulți oameni cred că AI va „prelua toate joburile”, iar această stare de spirit amplifică reticența față de tehnologie. Context: declarațiile din industrie care amplifică temerile Materialul amintește și de pozițiile CEO-ului Anthropic, Dario Amodei, care a susținut în repetate rânduri că lumea ar putea ajunge la un punct în care „tot codul este scris de AI” într-un interval de „șase luni până la un an”, contribuind la creșterea anxietății în jurul impactului AI asupra muncii. Ce promite Altman pe termen lung Altman a schițat și o viziune optimistă despre viitor, sugerând că oamenii ar putea avea o „viață prosperă și minunată” chiar și dacă nu își doresc să muncească din greu, fără a detalia însă cum ar funcționa concret un astfel de scenariu. [...]

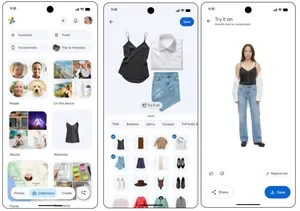

Google Photos testează o funcție de „probă virtuală” cu AI, care poate schimba modul în care utilizatorii își aleg ținutele din propriile fotografii , potrivit CNET . Instrumentul promite să îi ajute pe oameni să se „vadă” în diferite haine din garderobă, direct în aplicație, fără să fie nevoie să încerce fizic fiecare combinație. Miza practică este una operațională: dacă funcția ajunge la scară largă, Google Photos ar putea deveni mai mult decât o arhivă de imagini și ar intra în zona de utilitate zilnică, prin recomandări și vizualizări generate cu inteligență artificială pentru ținute. Pentru utilizatori, asta înseamnă mai puțin timp pierdut cu alegerea hainelor și, potențial, o nouă categorie de funcții „asistent” în aplicațiile foto. Ce face, concret, noul instrument Din informațiile prezentate, funcția folosește inteligența artificială pentru a genera o previzualizare a utilizatorului în diferite articole vestimentare, pe baza fotografiilor existente. Cu alte cuvinte, aplicația încearcă să simuleze cum ar arăta o persoană purtând diverse haine din garderobă. CNET nu oferă, în fragmentul disponibil, detalii tehnice despre modelul folosit, condițiile exacte de utilizare sau dacă funcția este disponibilă public ori doar în testare limitată. De ce contează pentru ecosistemul Google Photos O astfel de funcție împinge Google Photos spre o zonă în care fotografiile nu mai sunt doar „amintiri”, ci devin date de intrare pentru servicii personalizate. În practică, asta poate crește timpul petrecut în aplicație și dependența de funcțiile AI integrate, într-un moment în care marile platforme încearcă să justifice investițiile în inteligență artificială prin utilități concrete pentru consumatori. Ce rămâne neclar În materialul sursă extras aici lipsesc informații esențiale pentru a evalua impactul complet: când ar urma să fie lansată funcția și în ce țări; dacă va fi gratuită sau legată de un abonament; ce limitări are (tipuri de fotografii, acuratețe, erori posibile); cum sunt gestionate confidențialitatea și datele folosite pentru generare. Fără aceste detalii, rămâne de văzut dacă instrumentul va deveni o funcție de masă în Google Photos sau va rămâne un experiment de nișă. [...]

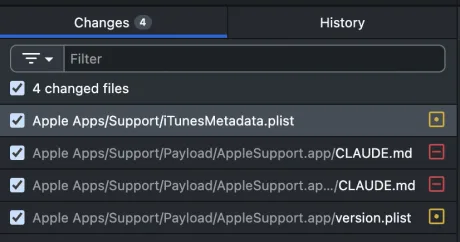

O actualizare a aplicației Apple Support a inclus din greșeală un fișier „Claude.md”, expunând indicii despre cum Apple folosește AI în dezvoltare și în arhitectura de suport , potrivit IT之家 . Incidentul, retras „de urgență” în 24 de ore, ridică o problemă operațională mai importantă decât „vibe coding”: cum mai arată controlul de calitate și revizia de cod când echipele se bazează pe asistenți AI și pe automatizări de livrare. Ce s-a întâmplat și unde a apărut fișierul Fișierul „Claude.md” a ajuns în pachetul de distribuție al aplicației Apple Support odată cu actualizarea la versiunea 5.13, livrată pe 1 mai. Descoperirea a fost semnalată de Aaron Perris, descris în material ca analist la MacRumors. Apple Support este aplicația oficială de asistență post-vânzare, folosită pentru chat cu specialiști, diagnosticare, programări la service și achiziția AppleCare. Ce indică „Claude.md” despre sistemul de suport: AI și oameni pe aceeași „bandă” Conținutul expus descrie o arhitectură de conversație în care Apple ar folosi un sistem cu două „backend-uri” (două componente de server): Juno AI pentru răspunsuri automate; Live Agents pentru preluarea de către operatori umani. Trecerea între cele două ar fi făcută printr-un strat de protocol, astfel încât „codul de deasupra” să nu știe dacă un mesaj vine de la om sau de la AI. În plus, modelul de mesaje ar avea trei roluri: „client” (utilizator), „agent” (operator Apple Support) și „assistant” (AI), procesate prin același flux, fără indicii explicite către utilizator despre cine răspunde, conform descrierii din material. Separat, sursa menționează și un modul „SAComponents”, prezentat ca o bibliotecă de componente de interfață (UI), fără logică de business, cu documentație DocC. De ce contează pentru companii: scăpări de livrare și guvernanță a codului în era AI Materialul pune accent pe faptul că nu fișierul în sine ar fi „marele secret”, ci faptul că un artefact intern a ajuns în producție , ceea ce sugerează o breșă în procesul de revizie și împachetare a aplicației. Discuția se leagă și de o controversă practică: dacă „Claude.md” (un fișier folosit, în general, pentru a instrui un asistent AI despre proiect: structură, reguli, pași de build, „capcane” de evitat) ar trebui: să fie păstrat în controlul versiunilor (ca documentație de proiect), sau să fie ignorat (de tip „configurație de mediu”, ținut local). Însă întrebarea operațională rămâne: cum a trecut fișierul din depozit/arbore de proiect în pachetul final publicat . Context: Apple și Anthropic , plus limitele concluziilor IT之家 notează că Bloomberg, prin Mark Gurman, ar fi indicat anterior că Apple rulează intern o versiune personalizată a modelului Claude pe serverele proprii, pentru a păstra datele în infrastructura companiei. Totodată, este citată și o poziție atribuită unui utilizator Hacker News care se prezintă drept fost angajat Apple: existența multor echipe izolate ar însemna că folosirea Claude într-un proiect nu dovedește automat o practică uniformă la nivelul întregii companii. Articolul mai menționează o statistică dintr-un sondaj pe 120.000 de dezvoltatori, potrivit căreia 92,6% folosesc cel puțin lunar un asistent AI de programare, ca argument că fenomenul este generalizat în industrie. Ce urmează Din informațiile prezentate nu reiese dacă Apple a comunicat public cauza exactă a includerii fișierului sau dacă a schimbat procedurile de livrare. Cert este că retragerea rapidă (în 24 de ore, conform materialului) limitează expunerea, dar nu elimină întrebarea de fond pentru organizațiile care dezvoltă software cu ajutorul AI: cine și cum mai face „review” eficient, astfel încât fișierele și instrucțiunile interne să nu ajungă în producție . [...]