Știri

Știri din categoria Inteligență artificială

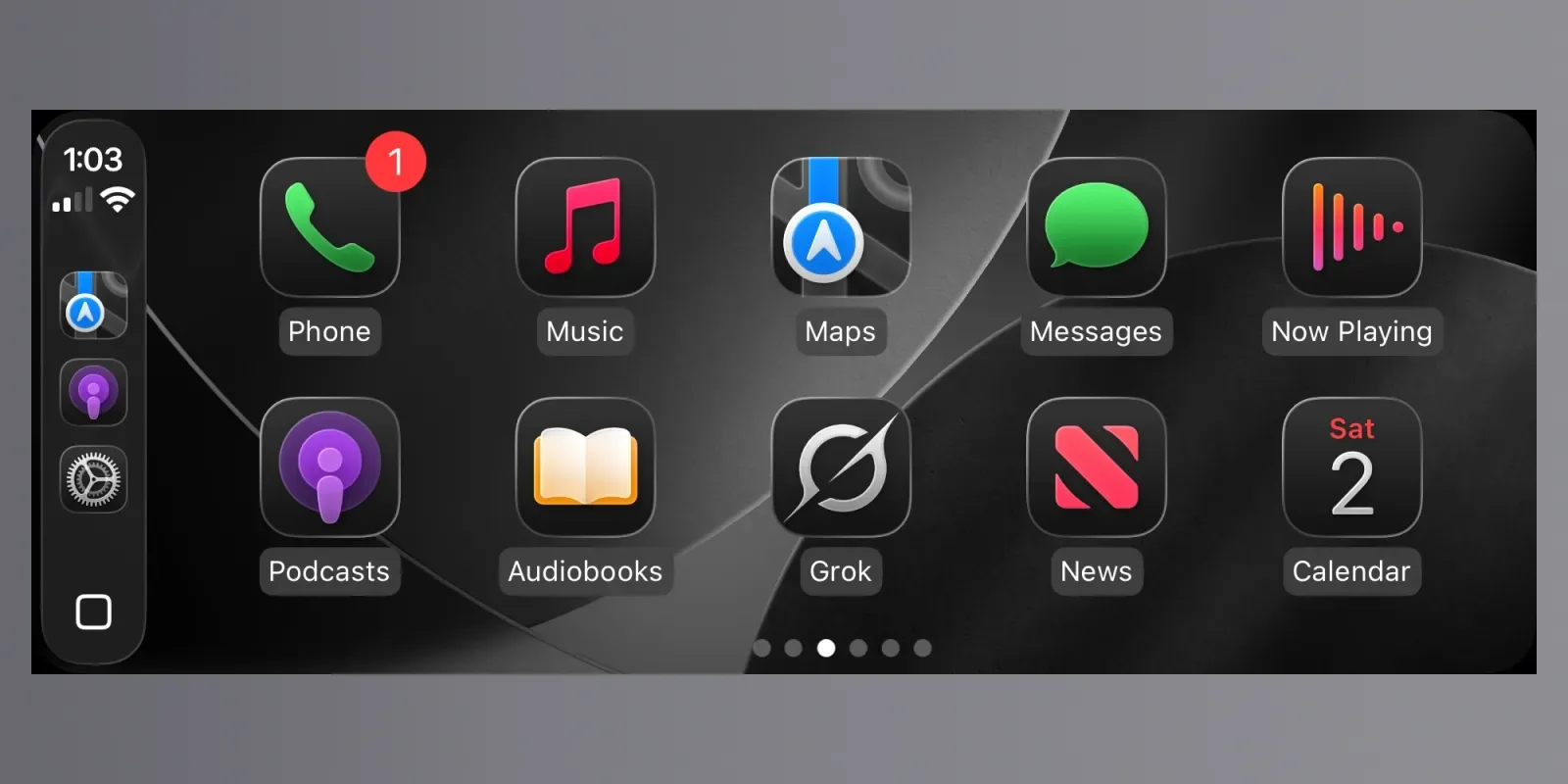

xAI pregătește extinderea lui Grok în mașinile cu CarPlay, după ce aplicația Grok pentru iPhone a început să includă un „placeholder” (o interfață nefuncțională, de test) pentru Apple CarPlay, semn că suportul este în lucru, potrivit 9to5Mac.

În forma actuală, aplicația Grok din CarPlay nu funcționează efectiv, dar la deschidere afișează mesajul: „Grok Voice mode coming soon to CarPlay” („Modul Grok Voice vine în curând pe CarPlay”). Consecința practică este că xAI urmărește să ducă experiența de chatbot cu comandă vocală în ecosistemul CarPlay, adică în „aproape orice altă mașină de pe șosea”, nu doar în vehiculele Tesla, unde Grok este deja integrat.

CarPlay a început recent să accepte aplicații de tip chatbot AI, iar Grok ar urma să fie a treia aplicație care adaugă suport, alături de ChatGPT și Perplexity, conform publicației. Pentru utilizatori, asta înseamnă mai multe opțiuni de asistent conversațional în interfața mașinii, cu accent pe interacțiunea vocală.

În același context, 9to5Mac notează că Google nu a dat semne că ar aduce Gemini în CarPlay, deși modelele Gemini ar urma să ajute la „noul Siri” din iOS 27, mai târziu în acest an. Publicația mai menționează și așteptarea ca Apple să lanseze o aplicație Siri dedicată, care „probabil” va funcționa și cu CarPlay.

Sursa nu oferă o dată de lansare, ci doar indică faptul că modul Grok Voice ar urma să ajungă „în curând” pe CarPlay, pe baza mesajului din aplicație și a prezenței interfeței nefuncționale. Aplicația Grok pentru iOS este disponibilă în App Store, însă suportul CarPlay nu este încă activ.

Recomandate

Elon Musk a admis că xAI a folosit modele OpenAI pentru a antrena Grok , o recunoaștere care împinge în prim-plan „zona gri” a industriei AI privind distilarea modelelor și riscurile de încălcare a proprietății intelectuale, potrivit G4Media . Declarația a fost făcută într-un proces din California , în timpul unei audieri în care Musk a fost întrebat despre practicile de antrenare a modelelor de inteligență artificială. Discuția s-a concentrat pe „distilare” – o metodă prin care un model mai mare și mai performant este folosit pentru a antrena unul mai mic, transferându-i din capabilități. Întrebat direct dacă xAI a folosit tehnologia OpenAI în acest mod, Musk a evitat inițial un răspuns tranșant, spunând că „în general, toate companiile de AI” recurg la astfel de practici. Presat să clarifice, el a răspuns: „Parțial”. De ce contează: distilarea, între practică uzuală și dispută de proprietate intelectuală Distilarea este descrisă ca fiind larg utilizată în industrie, mai ales pentru a obține versiuni mai eficiente și mai accesibile ale unor sisteme complexe. În același timp, metoda a devenit controversată pe fondul disputelor legate de proprietatea intelectuală și de respectarea termenilor de utilizare. În acest context, articolul menționează mai multe poziții și reacții din industrie: Anthropic și OpenAI au atras atenția asupra riscurilor ca distilarea să fie folosită pentru a replica performanțele unor modele concurente fără a parcurge întregul proces de dezvoltare. Unele firme din China au fost acuzate că folosesc astfel de metode pentru a reduce costurile și timpul de dezvoltare. Google a anunțat măsuri pentru a limita ceea ce numește „atacuri de distilare”, pe care le consideră o posibilă formă de încălcare a proprietății intelectuale. Reprezentanții Anthropic au spus, într-o analiză publicată anterior, că distilarea este în esență o metodă legitimă și frecvent folosită pentru optimizarea modelelor proprii, dar care poate fi exploatată pentru avantaje competitive „discutabile”. Ce susține Musk Ulterior, Musk a spus că este „o practică standard” ca modelele de inteligență artificială să fie validate sau îmbunătățite cu ajutorul altor sisteme similare. Declarațiile vin pe fondul intensificării competiției în AI, într-un moment în care delimitarea dintre inovație, colaborare și utilizare controversată a tehnologiei devine tot mai dificilă, mai notează articolul. [...]

Elon Musk a recunoscut în instanță că xAI a folosit „distilarea” pe modele OpenAI pentru a antrena Grok , o practică ce poate eroda avantajul competitiv al laboratoarelor care investesc masiv în infrastructură de calcul și care, în același timp, ridică mizele privind aplicarea termenilor de utilizare ai modelelor, potrivit TechCrunch . Mărturia a fost dată joi, într-o instanță federală din California, în procesul în care Musk dă în judecată OpenAI , pe CEO-ul Sam Altman și pe Greg Brockman. Întrebat dacă xAI a folosit tehnici de distilare pe modele OpenAI pentru a antrena Grok, Musk a spus că este o practică generală în industrie, iar când i s-a cerut să confirme dacă răspunsul este „da”, a răspuns: „Parțial”. De ce contează: distilarea reduce bariera de cost și apasă pe regulile de utilizare Distilarea (în contextul modelelor de inteligență artificială) este o metodă prin care un model nou este antrenat să reproducă comportamentul unuia mai performant, prin interogări sistematice ale chatboturilor sau ale interfețelor de programare (API) puse la dispoziție public. Miza economică este că astfel pot fi obținute modele „aproape la fel de capabile” la costuri mai mici, subminând avantajul construit de jucătorii mari prin investiții în capacitate de calcul. TechCrunch notează că nu este clar dacă distilarea este explicit ilegală; mai degrabă, ar putea încălca termenii de utilizare impuși de companii pentru produsele lor. Reacția industriei: încercări de a bloca interogările „suspecte” În paralel, OpenAI, Anthropic și Google ar fi lansat, prin Frontier Model Forum, o inițiativă de schimb de informații despre cum pot fi combătute încercările de distilare, în special din China. Abordarea descrisă se bazează pe identificarea și prevenirea interogărilor în masă care pot „cartografia” comportamentul intern al modelelor. OpenAI nu a răspuns solicitării de comentariu privind declarația lui Musk, la momentul publicării articolului. Context din proces: poziționarea xAI în cursa globală În aceeași mărturie, Musk a fost întrebat despre o afirmație făcută vara trecută, potrivit căreia xAI ar urma să depășească în curând orice companie, cu excepția Google. El a clasat furnizorii de top astfel: Anthropic pe primul loc, urmată de OpenAI, Google și modele chinezești cu cod deschis, caracterizând xAI drept o companie mult mai mică, cu „câteva sute” de angajați. [...]

Procesul dintre Elon Musk și OpenAI mută disputa despre AI în zona de control și guvernanță, cu Microsoft în centrul mizei – potrivit Antena 3 , conflictul juridic ridică întrebarea practică a pieței: cine ajunge să decidă direcția unei tehnologii pe care chiar actorii din industrie o descriu drept potențial „superinteligență” (AGI), adică un nivel ipotetic în care capacitățile mașinii le depășesc pe cele umane. Miza imediată a procesului, așa cum este prezentată în material, este schimbarea OpenAI de la un „laborator” nonprofit la o structură orientată spre profit, supravegheată de o fundație nonprofit. Musk susține că liderii OpenAI ar fi trădat misiunea inițială – dezvoltarea AI „în mod sigur și transparent” – în favoarea obiectivului de a face bani. OpenAI, la rândul său, afirmă că Musk, cofondator plecat în 2018, ar fi devenit vocal abia acum din cauza succesului lui Sam Altman pe o piață pe care concurează și compania de AI a lui Musk, xAI, despre care Antena 3 notează că a fuzionat în februarie cu SpaceX. Microsoft, „controlul” și disputa despre cine decide În depoziția din această săptămână, Musk a reluat ideea că, în primii ani ai OpenAI, el ar fi trebuit să fie la conducere pentru a se asigura că tehnologia este folosită în siguranță. În același context, el a invocat investiția Microsoft de 20 de miliarde de dolari în OpenAI (aprox. 92 miliarde lei) ca motiv de îngrijorare, argumentând că „Microsoft are propriile motivații” care ar putea devia de la obiectivele inițiale. Musk a formulat în instanță și o întrebare către jurați, în linie cu teza sa privind riscurile: „Chiar ați vrea ca Microsoft să controleze superinteligența digitală?” Materialul citat de Antena 3, o analiză CNN, punctează însă că alternativa sugerată implicit de Musk, cel puțin în primii ani ai OpenAI, ar fi fost un control concentrat în jurul lui Musk și al unui consiliu dominat de numiri făcute de el. Musk ar fi spus că „avea nevoie de control” la început, anticipând ulterior diluarea participației prin intrarea altor investitori. O listă scurtă de „stăpâni” ai AGI și problema de legitimitate Analiza CNN redată de Antena 3 susține că, în timp ce părțile se contrazic, opțiunile discutate rămân, practic, în interiorul unui cerc restrâns de mari jucători: Musk, OpenAI (condusă de Sam Altman), Microsoft și, eventual, Google, Meta sau Anthropic. În același material apare și reacția unor membri ai juriului, care ar indica o ostilitate față de Musk, inclusiv formulări dure din chestionarele de selecție. Judecătoarea federală Yvonne Gonzalez Rogers ar fi recunoscut existența acestei ostilități, dar a susținut că ea nu exclude integritatea procesului judiciar. Instanța delimitează tema: nu este un proces despre riscurile AI Judecătoarea a intervenit și pe fondul retoricii despre riscurile existențiale ale AI, remarcând – potrivit textului – ironia faptului că Musk dezvoltă o companie în același domeniu. Tot ea a delimitat însă obiectul cauzei, spunând că nu este un proces despre riscurile AI sau efectele asupra omenirii, ci că acesta ar putea fi subiectul unui proces viitor. În termeni de impact, cazul evidențiază o tensiune care depășește disputa dintre două nume: cum se stabilește guvernanța (cine controlează, cu ce mandat și ce mecanisme de verificare) într-o industrie în care capitalul mare și infrastructura tehnologică tind să concentreze decizia în mâinile câtorva companii și fondatori. [...]

Procesul dintre Elon Musk și Sam Altman riscă să complice traseul OpenAI către o listare și să amplifice presiunea juridică asupra modelului său hibrid (nonprofit–profit), într-un moment în care compania este descrisă ca fiind „pregătită” pentru un IPO, potrivit Al Jazeera . Într-un proces federal din California , Musk – cofondator OpenAI – a depus mărturie pentru a doua zi, susținând că Altman a „trădat” promisiunile inițiale de a păstra organizația ca nonprofit „dedicată beneficiului umanității”. Litigiul pornește de la înființarea OpenAI în 2015 ca nonprofit și transformarea ulterioară într-o structură orientată spre profit. Musk a declarat în fața juraților că și-a pierdut încrederea că Altman va menține misiunea nonprofit și a spus că, spre finalul lui 2022, se temea că Altman încerca să „fure caritatea”, afirmând că „s-a dovedit a fi adevărat”. Altman a fost prezent în sală, dar nu a depus mărturie, conform relatării. Miza economică: IPO și modelul de finanțare Avocații OpenAI au respins acuzațiile și au susținut că nu a existat niciodată un angajament de a rămâne nonprofit. Compania afirmă că a creat o componentă cu scop lucrativ pentru a finanța nevoile mari de putere de calcul și pentru a atrage talente. În același timp, OpenAI ar fi „pregătită” pentru o ofertă publică inițială care ar putea evalua compania la 1.000 de miliarde de dolari, potrivit Reuters, citată de Al Jazeera. În acest context, disputa privind guvernanța și misiunea inițială poate deveni un factor de risc reputațional și juridic, cu potențiale efecte asupra investitorilor și structurii de control. Ce cere Musk în instanță Musk a investit aproximativ 38 de milioane de dolari (aprox. 174 milioane lei) în OpenAI între 2015 și 2017 și a părăsit organizația în 2018. În proces, el solicită: 150 de miliarde de dolari (aprox. 690 miliarde lei) despăgubiri de la OpenAI și Microsoft , cu orice sumă acordată direcționată către brațul caritabil al OpenAI; obligarea OpenAI să revină la statutul de nonprofit; înlăturarea lui Sam Altman și a cofondatorului Greg Brockman din conducere. Musk a mai susținut că organizația a fost „capturată” și a descris o ofertă de a investi, venită din partea lui Altman, ca părând „ca o mită”. Apărarea OpenAI: competiția cu xAI Echipa juridică a OpenAI afirmă că acțiunea lui Musk urmărește să submineze compania în favoarea propriei sale inițiative, xAI. OpenAI, organizată acum ca „public benefit corporation” (o formă corporativă care combină obiective comerciale cu o misiune de interes public), susține că demersul este alimentat de competiție și notează că xAI este în urma OpenAI la adopția de către utilizatori. Context suplimentar despre proces apare într-un material anterior al publicației, „stand for a second day”, disponibil aici: Al Jazeera . [...]

O hotărâre a Tribunalului Intermediar al Poporului din Hangzhou limitează concedierile motivate de automatizare , stabilind că firmele nu pot da afară angajați doar ca să îi înlocuiască cu inteligență artificială pentru reducerea costurilor, potrivit G4Media . Decizia este prezentată ca un reper pentru protecția muncii într-un context de adoptare accelerată a tehnologiilor AI. Instanța a menținut concluziile anterioare într-un caz în care o companie de tehnologie a concediat ilegal un angajat cu funcție superioară după ce a introdus sisteme de inteligență artificială care îi preluau atribuțiile. Cazul a fost publicat într-un set de exemple juridice-model înaintea Zilei Internaționale a Muncii, ceea ce îi amplifică relevanța pentru practica judiciară și pentru companii. Ce a decis instanța și de ce contează pentru companii Litigiul a vizat un angajat identificat drept Zhou, angajat în 2022 ca supervizor de asigurare a calității. Rolul lui era să supravegheze rezultatele generate de „ modele lingvistice mari ” (sisteme AI care generează text) și să se asigure că sunt respectate standardele privind datele și conținutul. Pe măsură ce firma a automatizat tot mai mult procesele, lui Zhou i s-a propus un post mai prost plătit, cu responsabilități mult reduse. După ce a refuzat reîncadrarea, a fost concediat și i s-a oferit o compensație, contestată ulterior prin arbitraj. Autoritățile au constatat că justificarea companiei – o restructurare organizațională determinată de adoptarea AI – nu îndeplinea pragul legal necesar pentru concediere în baza legislației muncii din China. Instanțele au concluzionat că înlocuirea unui lucrător cu AI nu este, în sine, o „schimbare majoră a circumstanțelor obiective” (precum relocarea sau fuziunea) și nu poate fi folosită ca temei pentru încetarea contractului. De asemenea, rolul alternativ oferit a fost considerat nerezonabil din cauza reducerii abrupte a salariului. Context: AI se extinde, iar litigiile de muncă se înmulțesc Potrivit materialului, experți juridici apreciază că hotărârea întărește ideea că firmele pot urmări eficiența prin automatizare, dar trebuie să își respecte obligațiile față de angajați. Decizia vine după rezultate similare în arbitraje din alte orașe chineze, unde concedierile determinate de AI au fost considerate ilegale. Cazul apare într-un moment în care sectorul AI din China se extinde rapid, cu mii de firme active și cu o integrare pe scară largă așteptată în toate industriile până la sfârșitul deceniului, pe fondul îngrijorărilor privind utilizarea abuzivă a automatizării, inclusiv situații în care companiile ar reproduce roluri umane prin echivalente digitale bazate pe AI. [...]

Pentagonul menține interdicția asupra Anthropic , dar tratează separat modelul AI Mythos , evaluat ca tehnologie cu implicații pentru securitatea națională, potrivit Profit . Distincția arată cum autoritățile americane separă riscul de „lanț de aprovizionare” asociat unei companii de utilitatea punctuală a unui model de inteligență artificială în zona de apărare și securitate cibernetică. Modelul Mythos este analizat separat deoarece ar avea capacități avansate de identificare și remediere a vulnerabilităților cibernetice. Directorul tehnologic al Pentagonului, Emil Michael, a spus că aceste capabilități obligă autoritățile să consolideze securitatea rețelelor guvernamentale. Ce înseamnă, practic, „interdicția” pentru Anthropic Deși Mythos e evaluat distinct, statutul Anthropic de „risc pentru securitate” rămâne în vigoare, pe fondul unui conflict deschis între companie și autoritățile americane privind utilizarea tehnologiei sale. Consecința operațională este directă pentru ecosistemul de furnizori ai armatei: firmele contractoare trebuie să certifice că nu folosesc modelele Claude (dezvoltate de Anthropic) în proiecte militare. Compania a dat în judecată administrația americană pentru a contesta decizia de clasificare, conform informațiilor din articol. Context: Pentagonul își extinde parteneriatele AI pentru rețele clasificate În paralel, Pentagonul a anunțat acorduri cu mai multe companii tehnologice majore — OpenAI, Google, Microsoft, Nvidia și Amazon Web Services — pentru implementarea soluțiilor de inteligență artificială în rețelele clasificate ale instituției. Pentru piață, mesajul este că accesul la contracte și implementări în zona de apărare depinde nu doar de performanța tehnologică, ci și de evaluările de risc privind furnizorul și lanțul de aprovizionare, care pot bloca utilizarea unor modele chiar și atunci când anumite componente sunt considerate relevante pentru securitatea națională. [...]