Știri

Știri din categoria Inteligență artificială

Apple pregătește înlocuirea Core ML cu noul framework Core AI la WWDC 2026, într-o mișcare care marchează o repoziționare strategică în jurul inteligenței artificiale, potrivit informațiilor publicate de 9to5Mac, care citează newsletterul „Power On” al jurnalistului Mark Gurman de la Bloomberg.

Core ML, instrumentul folosit de ani buni pentru integrarea funcțiilor de învățare automată direct pe dispozitivele Apple, ar urma să fie înlocuit treptat de Core AI, un cadru gândit pentru a reflecta mai clar orientarea companiei către inteligența artificială generativă. Potrivit sursei, schimbarea de denumire nu este doar una de imagine, ci semnalează extinderea capacităților pentru integrarea modelelor externe de inteligență artificială în aplicații.

Tranziția nu va fi bruscă. Core ML nu va dispărea imediat, însă noul Core AI ar urma să devină fundația pentru dezvoltatorii care vor să integreze modele lingvistice mari și modele de generare de conținut direct în aplicațiile pentru iPhone, iPad și Mac. În paralel, Apple analizează posibila integrare a unor standarde deschise pentru conectarea modelelor la surse externe de date.

Anunțul este așteptat la conferința anuală Worldwide Developers Conference din iunie 2026 și va fi strâns legat de lansarea iOS 27 în toamnă. Potrivit relatărilor din presa de specialitate, inclusiv MacRumors, noua versiune a sistemului de operare ar putea aduce o versiune extinsă a asistentului Siri, cu funcții conversaționale avansate și capacitatea de a menține contextul între interacțiuni.

Apple a confirmat anterior colaborarea cu Google pentru integrarea modelului Gemini în așa-numitele Foundation Models, ceea ce sugerează o deschidere mai mare către parteneriate externe în zona AI. Pentru dezvoltatori, combinația dintre Core AI și noile modele ar putea reduce barierele tehnice în crearea de aplicații bazate pe inteligență artificială pentru ecosistemul Apple, care depășește două miliarde de dispozitive active la nivel global.

Schimbarea indică faptul că Apple încearcă să recupereze teren într-un sector dominat de competitori care au avansat rapid în zona modelelor generative, repoziționându-și instrumentele și mesajul în jurul conceptului de inteligență artificială.

Recomandate

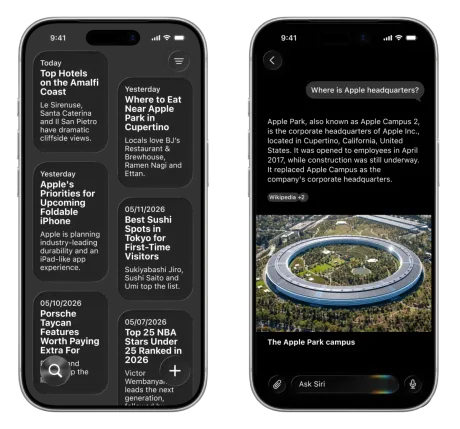

Apple pregătește o integrare Siri-IA la scară de masă în iOS 27 , mizând pe parteneri externi pentru „inteligență” și pe distribuția uriașă a ecosistemului său, potrivit unei analize TechCrunch , bazată pe randări și informații publicate de Bloomberg înainte de WWDC din iunie. Imaginile, realizate de Bloomberg pe baza unor surse, indică faptul că Siri ar urma să fie „țesută” mai adânc în sistemul de operare, cu o interfață care apare din Dynamic Island (zona neagră, în formă de pastilă, din partea de sus a ecranului iPhone). În iOS 27, apăsarea butonului pentru Siri ar declanșa o animație și răspunsuri afișate în acest spațiu, un mod gândit pentru întrebări rapide, similar utilizării actuale. Căutarea de tip Spotlight devine poarta principală către Siri „nouă” O schimbare operațională importantă ar fi un nou mod care aduce „căutarea cu Siri” în gestul deja familiar utilizatorilor: glisarea în jos pentru Spotlight Search (funcția integrată de căutare în telefon și pe web). Gestul ar rămâne același, dar rezultatele ar urma să fie generate de o versiune Siri cu un model refăcut, care „folosește sub capotă” tehnologia de inteligență artificială Gemini de la Google, conform TechCrunch. În această interfață, utilizatorii ar putea, între altele: să caute informații și să lanseze aplicații; să înceapă mesaje; să verifice vremea; să adauge evenimente în calendar; să caute în notițe; să declanșeze „scurtături” (automatizări) din aplicații, cu rezultate afișate ca text formatat, în carduri care apar tot din Dynamic Island, potrivit Bloomberg. Apple ar pregăti și o aplicație Siri separată, în stil „chatbot” Pe lângă integrarea în iOS, Bloomberg mai susține că Apple ar urma să lanseze și o aplicație Siri de sine stătătoare, concepută să concureze direct cu chatboți precum ChatGPT, Claude sau Gemini. Aceasta ar include istoricul conversațiilor și ar permite încărcarea de documente și fotografii, nu doar interacțiune prin text. De ce contează: Apple mizează pe parteneri și pe distribuție, nu pe „construit de la zero” Analiza compară strategia Apple din IA cu parteneriatul său de „miliarde de dolari” cu Google pentru motorul de căutare implicit pe iPhone: în loc să construiască totul intern, compania ar combina tehnologie de la parteneri (pentru capabilități cerute „acum” de utilizatori) cu dezvoltarea propriilor modele, inclusiv „IA locală” care rulează pe dispozitiv, nu în cloud — o direcție care susține poziționarea Apple pe confidențialitate. Miza este amplificată de distribuție: TechCrunch notează că ChatGPT ar avea 900 de milioane de utilizatori activi săptămânal, în timp ce baza instalată Apple (toate dispozitivele, nu doar iPhone) este estimată la 2,5 miliarde. În acest context, integrarea IA direct în iOS ar putea aduce rapid astfel de funcții către utilizatori care nu folosesc încă instrumente IA separate. Notă: informațiile despre interfață și funcții provin din randări și relatări bazate pe surse, publicate de Bloomberg înainte de WWDC; Apple nu a confirmat oficial detaliile în materialul citat. [...]

NVIDIA își extinde ofensiva în centrele de date cu Vera, un CPU „pentru agenți” care promite să crească veniturile din tokeni. Potrivit NVIDIA News , noul procesor Vera este deja în producție și este poziționat ca o piesă-cheie pentru „fabricile de AI” (infrastructuri care rulează antrenare, inferență și execuție de agenți), într-un moment în care economia acestor sisteme se mută de la „nuclee per dolar” la „tokeni per dolar” — adică la câți pași de calcul utili pot livra pentru fiecare unitate de cost. NVIDIA susține că Vera finalizează sarcini cu 1,8 ori mai repede decât procesoarele x86, pe o plajă de utilizări care include AI „agentic” (modele care nu doar răspund, ci execută acțiuni, rulează cod și folosesc instrumente), învățare prin recompensă (reinforcement learning) și procesare de date. Miza economică invocată de companie este directă: mai multă performanță CPU pe fluxurile critice din centrele de date ar însemna mai mult „token revenue” (venituri asociate volumului de tokeni procesați în servicii AI). De ce contează: CPU-ul devine din nou o constrângere în „fabricile de AI” În arhitecturile moderne pentru AI, acceleratoarele (GPU) fac partea grea de calcul, dar multe etape rămân limitate de CPU: rularea mediilor Python, compilări, execuție de cod în sandbox (medii izolate), logică de orchestrare și conducte de analiză. NVIDIA își construiește argumentul pe ideea că agenții AI cresc masiv cererea pentru astfel de sarcini, iar un CPU mai rapid și mai eficient energetic crește „debitul” (throughput) de agenți și interactivitatea. Jensen Huang , fondator și CEO al NVIDIA, afirmă: „Agenții AI vor fi cei mai mari utilizatori de calcul. Vera este primul CPU proiectat pentru acel viitor — construit pentru a rula AI agentic la scară hyperscale cu performanță, eficiență și programabilitate extraordinare.” Ce aduce Vera: arhitectură proprie și integrare strânsă cu platformele NVIDIA Vera este bazat pe „Olympus”, un nucleu CPU personalizat NVIDIA, și include 88 de nuclee Olympus , „Spatial Multithreading” (o tehnică de execuție paralelă pentru a crește utilizarea resurselor) și memorie LPDDR5X cu până la 1,2 TB/s lățime de bandă. Pe partea de integrare în platformele companiei, Vera este prezentat ca: CPU pentru servere Vera „standalone” (configurații dedicate CPU), CPU gazdă pentru platformele NVIDIA Vera Rubin , prin interconectarea NVLink-C2C de generația a doua, cu până la 1,8 TB/s lățime de bandă coerentă între CPU și GPU, componentă pentru platforme de stocare AI, prin NVIDIA Vera BlueField-4 STX , care combină CPU-ul cu rețelistică, accelerare de stocare și securitate „în siliciu”. NVIDIA mai spune că Vera extinde „Confidential Computing” (mecanisme hardware/software care protejează datele în utilizare) la nivel de rack, pentru a proteja sarcini agentice. Cine îl adoptă și cine îl produce: ecosistem de cloud și OEM Compania indică drept potențiali utilizatori sau evaluatori ai Vera atât laboratoare AI, cât și operatori mari de cloud și infrastructură. Sunt menționate, între altele, Anthropic, OpenAI și SpaceXAI, precum și ByteDance, CoreWeave și Oracle Cloud Infrastructure (OCI). În zona enterprise, NVIDIA indică și NYSE ca utilizator care explorează platforma. Pe partea de producție și integrare hardware, NVIDIA spune că sisteme Vera vor fi construite la scară de producători precum Dell Technologies, HPE, Lenovo și Supermicro, alături de ASUS, Compal, Foxconn, GIGABYTE, Pegatron, Quanta Cloud Technology (QCT), Wistron și Wiwynn, între alții. Publicația notează că marii OEM ar urma să ofere Vera în configurații de server CPU „standalone”, ca „prima opțiune standard de CPU dincolo de x86”. Performanță: benchmark-uri invocate și un exemplu de utilizare NVIDIA citează Phoronix (publicație de benchmark-uri open-source) spunând că Vera a livrat „cea mai rapidă performanță generală” pe sarcini agentice precum compilare de cod, Python, Java și procesare de baze de date — exact tipuri de încărcări care apar pe traseul critic al execuției agenților (utilizare de instrumente și execuție în sandbox). Într-un exemplu operațional, NYSE Group leagă adopția de obiective de latență și capacitate. Lynn Martin, președinte NYSE Group, spune: „NYSE procesează peste 1,1 trilioane de mesaje pe zi și, în colaborare cu Redpanda și HPE, folosind CPU-urile NVIDIA Vera, ne vom extinde capacitatea, optimizând în continuare latența pentru a susține o infrastructură de piață performantă, rezilientă și pregătită pentru AI.” Disponibilitate: când ajunge pe piață NVIDIA afirmă că sistemele Vera vor fi disponibile de la integratori și parteneri cloud din această toamnă . Compania nu oferă în material detalii despre prețuri sau despre configurații comerciale concrete pentru fiecare segment, astfel că impactul financiar imediat rămâne de evaluat în funcție de ritmul de adoptare în cloud și în centrele de date enterprise. [...]

Beretta își extinde portofoliul spre apărare cu un sistem anti-dronă automatizat , mizând pe cererea în creștere pentru protecția infrastructurilor critice, potrivit Digi24 . Beretta Defense Technologies pregătește lansarea „Livet”, o stație de armament controlată de la distanță, capabilă să detecteze și să doboare drone de mici dimensiuni, care va fi prezentată la salonul Eurosatory de la Paris. Sistemul „Livet” folosește opt puști Benelli „Drone Guardian”, montate într-o turelă de tip antiaerian compact. Compania spune că platforma are funcții automate de urmărire a țintelor și poate angaja ținte de la distanță, pentru timpi rapizi de reacție, cu scopul declarat de a proteja „active strategice și infrastructuri critice”. Cum funcționează sistemul și unde intervine inteligența artificială Platforma este dotată cu un sistem de urmărire integrat cu inteligență artificială, care ar permite identificarea și blocarea automată a țintelor. În plus, poate fi conectată la senzori externi pentru detectare și ghidaj: radare externe de scurtă rază; scanere de radiofrecvență, care pot furniza coordonate în timp real. La nivel de muniție, sistemul folosește cartușe cu wolfram și poate fi echipat cu muniție care explodează în aer, concepută să neutralizeze dronele mici prin dispersia fragmentelor. De ce contează: piața anti-dronă se accelerează pe fondul conflictelor Contextul este dat de rolul tot mai mare al dronelor în conflictele recente, inclusiv în Ucraina și în Orientul Mijlociu. Digi24 notează că dronele FPV (first-person-view – drone operate cu imagine „din perspectiva pilotului”) pot fi asamblate cu aproximativ 300 de dolari (aprox. 1.400 lei), iar eficiența lor a împins statele să accelereze dezvoltarea tehnologiilor anti-dronă, alimentând și un boom al startupurilor europene din industria de apărare. „Livet” urmează să fie prezentat la Eurosatory, eveniment programat între 15 și 19 iunie, care reunește companii din industria de apărare și oficiali guvernamentali și militari. Potrivit informațiilor citate de Digi24, Beretta Defense Technologies își va dezvălui sistemul în această vară, informația fiind transmisă inițial de Euronews . [...]

Papa Leo XIV cere control și reglementare pentru AI, pe fondul creșterii neîncrederii publice , într-un mesaj care poate alimenta presiunea politică pentru reguli mai dure asupra companiilor din domeniu, potrivit HotNews . Într-o enciclică de peste 40.000 de cuvinte, Papa avertizează că inteligența artificială nu este „în sine” ostilă omului, dar poate deveni problematică atunci când este ghidată exclusiv de profit, mai ales dacă ajunge să înlocuiască locuri de muncă fără protecție sau reconversie pentru angajați. Mesajul este adresat liderilor politici, mediului de afaceri și societății, cu accent pe riscul afectării demnității și autonomiei umane. Ce tip de măsuri cere Vaticanul și de ce contează pentru companii În viziunea prezentată, controlul dezvoltării AI ar trebui să se traducă în politici publice și obligații mai clare pentru sectorul privat. Papa cere explicit: reglementarea companiilor private din domeniul AI; programe de recalificare pentru muncitori; educație care să dezvolte gândirea critică față de AI; măsuri de protejare a copiilor de conținut fals, violent sau sexualizat. Pentru mediul de afaceri, un astfel de cadru ar însemna costuri de conformare și responsabilități suplimentare (de la guvernanță și evaluarea riscurilor până la protecția utilizatorilor), dar și o schimbare de ritm: modelul de inovare rapidă, tolerat în valurile anterioare de tehnologie, ar putea deveni mai greu de susținut în fața unei opinii publice tot mai prudente. Neîncrederea în AI crește: semnale din SUA și Europa HotNews plasează mesajul Papei într-un context în care încrederea în AI scade. În SUA, un sondaj Pew Research Center indică faptul că aproximativ jumătate dintre americani sunt „mai degrabă îngrijorați decât entuziasmați” de creșterea AI, iar ponderea a urcat de la 37% în 2021 la 50% „în prezent”. În Europa, datele citate arată o reticență similară: aproximativ 25% dintre europeni spun că s-ar simți confortabil ca AI să preia sarcini administrative la job, iar aproape 50% dintre europenii cu studii superioare cred că locul lor de muncă este în pericol „acum” din cauza AI. Totodată, jumătate dintre europeni cred că AI va avea un impact negativ asupra societății. Pe zona de informare și politică, un alt studiu menționat arată că, deși 49% dintre respondenți spun că au folosit instrumente AI precum ChatGPT pentru subiecte politice, doar 30% cred că beneficiile depășesc riscurile. Percepția asupra democrației este împărțită: 32% văd AI mai degrabă ca oportunitate, iar 39% o consideră deja un risc. De la „tehnologie a progresului” la „tehnologie a riscului” Analiza compară primirea AI cu entuziasmul care a însoțit internetul în anii ’90 și începutul anilor 2000, inclusiv în România, unde internetul a fost asociat cu modernizarea și „intrarea în rândul lumii”. În schimb, AI este percepută mai puțin ca infrastructură care facilitează acțiunea umană și mai mult ca un sistem care poate genera conținut, influența decizii și „risca să înceapă să ia decizii în locul oamenilor”. În plus, AI apare într-o lume deja marcată de efectele secundare ale revoluției digitale: dezinformare, colectare masivă de date personale, polarizare și neîncredere în Big Tech. În acest context, tensiunea dintre promisiunea de productivitate și mesajele către investitori despre reducerea costurilor prin înlocuirea forței de muncă devine un factor major de respingere socială. Ce urmează: risc de reglementări mai puternice HotNews notează că acestea sunt scenarii, însă climatul social poate împinge politicienii către reglementări mai ferme. Miza nu mai este doar tehnologică, ci socială: dacă AI este percepută în primul rând ca instrument al concedierilor, al fraudei digitale sau al manipulării informației, integrarea ei „profundă” în viața de zi cu zi ar putea întâmpina rezistență, cu efect direct asupra pieței și asupra modului în care companiile pot lansa și scala produse bazate pe AI. [...]

Băncile europene ar putea tăia 10%–20% din posturi în următorii cinci ani , pe măsură ce inteligența artificială crește productivitatea și reduce nevoia de personal în activitățile de suport, potrivit unei analize citate de Agerpres . Estimarea vine de la analiștii Morgan Stanley și indică un impact direct asupra costurilor operaționale ale băncilor. Analiștii Morgan Stanley estimează că adoptarea AI ar putea aduce creșteri de productivitate de 30% și ar permite reducerea efectivelor „pe termen scurt”, cu restructurări realizate în mare parte prin plecări voluntare, inclusiv pensionări. În același timp, economiile de costuri asociate acestor reduceri ar putea ajunge la aproximativ 4%–9% din total, potrivit calculelor din raport. Unde se vede deja impactul: suport, middle și back office Semnalele de pe piață arată că băncile încep să lege explicit planurile de eficientizare de utilizarea AI, în special în zonele care țin de operațiuni și suport: Standard Chartered a anunțat eliminarea a aproape 8.000 de posturi în domeniul suport, în următorii patru ani, asociind decizia cu AI. Directorul Bill Winters a spus că planul va afecta „capitalul uman cu valoare mai mică”, formulare pentru care ulterior și-a cerut scuze. HSBC analizează posibilitatea de a elimina aproximativ 20.000 de locuri de muncă , pornind de la ipoteza că AI poate reduce dimensiunea echipelor din funcțiile de tip middle și back office (activități interne de procesare, control și suport operațional), potrivit unei informații Bloomberg menționate în material. La Commerzbank , directorul general Bettina Orlopp a indicat economii de costuri de aproximativ 350 de milioane de euro (aprox. 1,75 miliarde lei) în câțiva ani, pe fondul utilizării inteligenței artificiale. Miza economică: costuri mai mici, dar și venituri potențial mai mari Dincolo de reducerea cheltuielilor, analiștii Morgan Stanley susțin că AI ar putea sprijini și creșterea veniturilor, de exemplu printr-o mai bună identificare a produselor potrivite pentru fiecare client. În această logică, băncile cu platforme integrate — retail, economii, asigurări și administrarea averilor — ar fi mai bine poziționate să valorifice tendința, deoarece pot folosi datele și distribuția internă pentru a personaliza oferta către clienți. Ce urmează Materialul indică o direcție: restructurările ar putea fi accelerate de implementarea AI în funcții bancare diverse, iar reducerea de personal ar urma să se facă, în bună măsură, prin ieșiri naturale din sistem. Ritmul și amploarea vor depinde însă de cât de repede reușesc băncile să introducă AI în procesele de bază și să transforme câștigurile de productivitate în economii efective. [...]

Intel susține că a rezolvat o problemă-cheie care frânează adoptarea „AI fizic” în robotică , o afirmație cu potențial impact operațional pentru companiile care dezvoltă și implementează roboți în industrie, logistică sau retail, potrivit Neowin , care relatează despre anunțul făcut la Computex 2026 . Miza este una practică: „AI fizic” (modele de inteligență artificială care controlează sisteme din lumea reală, precum roboți) se lovește de constrângeri diferite față de software-ul clasic — de la cerințe de latență (întârzierea dintre decizie și acțiune) până la integrarea cu senzori și actuatori. În acest context, Intel spune că a abordat una dintre cele mai mari probleme din zona roboticii și a AI-ului „încorporat” în dispozitive. De ce contează pentru companii Dacă soluția descrisă de Intel se confirmă în implementări comerciale, efectul direct ar putea fi reducerea fricțiunii la trecerea de la prototipuri la sisteme utilizabile în producție, adică: integrare mai rapidă a componentelor hardware și software în proiecte de robotică; timpi mai mici de dezvoltare și testare pentru aplicații care trebuie să funcționeze „în teren”; premise pentru extinderea utilizării roboților în medii unde fiabilitatea și reacția în timp real sunt critice. Ce știm și ce rămâne neclar Materialul indică faptul că afirmația a fost făcută în cadrul Computex 2026, însă, în fragmentul de conținut disponibil aici, nu apar detalii tehnice complete despre mecanismul exact, condițiile de utilizare sau rezultate măsurabile (de exemplu, valori de latență, scenarii de test, disponibilitate comercială). În lipsa acestor elemente, impactul concret pentru piață rămâne de validat prin implementări și date publice suplimentare. [...]