Știri

Știri din categoria Inteligență artificială

Nvidia confirmă parteneriatul cu MediaTek pentru cipuri AI de PC, potrivit YouTube, unde CEO-ul Jensen Huang a vorbit cu reporterii la banchetul anual Weiya al companiei, organizat la Taipei, pe 30 ianuarie 2026. Miza este intrarea mai agresivă a Nvidia pe piața laptopurilor cu Windows, dominată în prezent de Intel și AMD.

Huang a spus că cele două companii lucrează la un nou „system-on-chip” (SoC, adică un cip care integrează mai multe componente-cheie ale unui computer, precum procesor și grafică), orientat către PC-uri cu capabilități avansate de inteligență artificială, dar cu consum redus de energie. Confirmarea vine pe fondul informațiilor tot mai numeroase despre procesoarele N1/N1X, asociate cu o strategie Nvidia de a aduce arhitectura Arm în zona laptopurilor Windows.

„Am făcut un parteneriat cu MediaTek pentru a construi un SoC foarte puternic și are consum redus, dar este foarte puternic și este conceput pentru computere cu inteligență artificială foarte puternică”, a declarat Huang. „Aplicațiile sunt destul de multe.”

Din punct de vedere tehnic, cipurile N1 și N1X par să fie legate de „GB10 Superchip”, folosit în microstația de lucru DGX Spark, iar detalii apărute în industrie indică o configurație cu procesor Arm cu 20 de nuclee și o componentă grafică bazată pe arhitectura Blackwell, notează Tom’s Hardware. În aceeași zonă de informații, The Register menționează că aceste cipuri ar fi fabricate pe 3 nm la TSMC și ar folosi memorie LPDDR5X unificată, o alegere care susține obiectivul de eficiență energetică invocat de Nvidia.

Parteneriatul cu MediaTek este relevant și prin prisma rolului companiei taiwaneze în proiectarea unor nuclee Arm și în integrarea platformelor cu consum redus, ceea ce poate accelera ambiția Nvidia de a livra laptopuri „AI-first” (orientate în primul rând către rularea locală a sarcinilor de inteligență artificială, nu doar în cloud). În termeni de piață, combinația dintre expertiza Nvidia în accelerare grafică și AI și experiența MediaTek în SoC-uri eficiente poate crea o alternativă credibilă la platformele x86 tradiționale.

Pe partea comercială, mai mulți producători ar pregăti laptopuri bazate pe N1/N1X pentru începutul lui 2026; documente interne „scăpate” în spațiul public indică modele Lenovo, iar Dell ar fi vizat atât gama Alienware, cât și XPS, potrivit TweakTown. Separat, Tom’s Hardware citează surse DigiTimes care plasează debutul laptopurilor Windows pe Arm cu N1X în T1 2026, într-un calendar care ar coincide cu lansarea Windows 11 26H1, descris ca fiind proiectat „să susțină anumite platforme hardware”.

Rămân însă și riscuri: presiunea pe lanțurile de aprovizionare (inclusiv pe zona de memorie, afectată de cererea din centrele de date pentru AI) și limitările ecosistemului Windows pe Arm, unde multe jocuri încă depind de emulare x86. HotHardware atrage atenția că întrebarea cheie este dacă utilizatorii, în special gamerii, vor accepta compromisurile de compatibilitate și performanță care pot apărea atunci când aplicațiile nu rulează nativ.

În acest context, parteneriatul Nvidia–MediaTek nu este doar o colaborare tehnologică, ci un test de piață pentru ideea de laptop Windows cu AI rulat local, pe arhitectură Arm, la scară largă.

Recomandate

Departamentul american al Apărării își extinde rapid accesul la instrumente de inteligență artificială pe rețele militare clasificate , după ce Amazon Web Services (AWS) , Microsoft și NVIDIA au semnat acorduri care permit Pentagonului utilizarea tehnologiilor lor „pentru utilizare operațională legală”, potrivit Engadget . Informația este relatată inițial de Bloomberg , care notează că, alături de cele trei companii, și Reflection AI a încheiat un acord similar. Pentagonul a transmis, într-o declarație citată de Bloomberg, că aceste acorduri „accelerează transformarea” către un model în care armata SUA devine o „forță de luptă AI-first” (orientată în primul rând către folosirea inteligenței artificiale). Ce se schimbă operațional: AI pe rețele clasificate Elementul cu impact direct este faptul că instrumentele de AI ale companiilor vor putea fi folosite pe rețele militare clasificate , ceea ce ridică miza față de utilizări comerciale sau administrative. Formularea „pentru utilizare operațională legală” indică un cadru de utilizare în interiorul regulilor și procedurilor militare, fără ca materialul citat să detalieze ce tipuri de aplicații vor fi implementate efectiv. Lista furnizorilor se lărgește; Anthropic rămâne în afara acordurilor Engadget arată că AWS, Microsoft și NVIDIA se alătură altor companii care au semnat acorduri similare cu Departamentul Apărării, între care xAI, OpenAI și Google. În acest context, Anthropic este prezentată drept singurul furnizor major de AI din SUA care nu are un acord funcțional cu Pentagonul. Materialul descrie și tensiunile dintre administrația Trump și Anthropic: în februarie, secretarul apărării Pete Hegseth ar fi amenințat că va eticheta compania drept „risc pentru lanțul de aprovizionare” dacă nu renunță la măsuri de protecție care împiedică folosirea chatbotului Claude pentru supraveghere în masă a americanilor sau în arme complet autonome. După refuzul companiei, președintele Trump a ordonat agențiilor federale să înceteze utilizarea produselor Anthropic în termen de șase luni, iar disputa a ajuns în instanță. Reacție publică: semnal de risc reputațional pentru furnizori Engadget notează că ritmul de adopție al AI în apărare și viteza cu care marile companii americane „se aliniază” pentru a vinde către administrația Trump ar trebui să fie un motiv de îngrijorare pentru cetățenii SUA. Ca indiciu al sensibilității publice, publicația citează date ale firmei de inteligență de piață Sensor Tower: OpenAI ar fi înregistrat o creștere cu 413% de la an la an a dezinstalărilor aplicației ChatGPT în februarie, după acordul companiei cu Departamentul Apărării. Ce urmează, pe baza informațiilor disponibile, este extinderea acestui tip de parteneriate în zona militară, cu o presiune tot mai mare pe furnizorii care nu acceptă condițiile Pentagonului și cu posibile costuri de imagine pentru cei care intră în astfel de acorduri. [...]

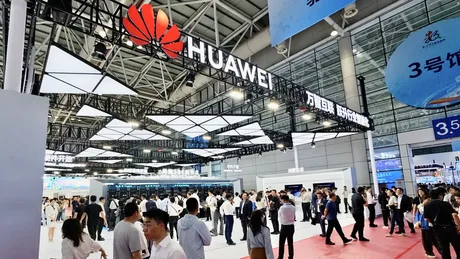

Blocajele de reglementare care țin pe loc livrările Nvidia H200 către China pot accelera transferul de cotă de piață către Huawei , într-o piață locală de cipuri pentru inteligență artificială estimată să ajungă la 67 miliarde dolari (aprox. 308 miliarde lei) până în 2030, potrivit unei analize Tom's Hardware , care citează un reportaj Financial Times și estimări Morgan Stanley. Potrivit Financial Times (link în sursă), Huawei este „pe drumul” de a capta cea mai mare cotă din piața chineză de cipuri AI chiar din acest an, pe fondul cererii în creștere din partea companiilor chineze pentru alternative interne la Nvidia. Contextul: operațiunile Nvidia din China, care ar fi reprezentat anterior până la 25% din veniturile diviziei de centre de date, sunt afectate de restricții la export și bariere de reglementare impuse atât de SUA, cât și de China, pe fondul tensiunilor comerciale și tehnologice. De ce s-au blocat livrările H200: cerințe contradictorii SUA–China Tom’s Hardware notează că Jensen Huang, CEO-ul Nvidia, a confirmat în martie 2026 că firma a primit licențe din SUA pentru a vinde cipuri AI H200 către China și că a repornit producția pentru a acoperi cererea. Totuși, deși compania ar fi obținut aprobarea SUA și comenzi de la clienți chinezi, livrările au întâmpinat obstacole, cu posibile întârzieri legate de reglementările chineze de import. Financial Times susține că Beijingul ar fi instruit companiile chineze de tehnologie să limiteze utilizarea cipurilor Nvidia la operațiunile lor din afara țării, în timp ce sprijină producția internă. În paralel, autoritățile americane cer ca toate cipurile Nvidia comandate de clienți chinezi să fie folosite doar în China. Rezultatul, potrivit materialului: un blocaj la nivelul procedurilor vamale pentru H200, pe fondul acestor cerințe care se bat cap în cap. Pariul Huawei: „inference” și clustere, nu performanță brută Deși cipurile Nvidia rămân mai avansate, Huawei ar urmări o strategie diferită: țintește segmentul de „inference” (calculul folosit de modelele AI pentru a genera răspunsuri și a executa sarcini după finalizarea antrenării), descris ca fiind în creștere rapidă. Conform Financial Times, Huawei și-a poziționat procesoarele 950PR drept opțiunea preferată pentru companiile locale care rulează sarcini de inference. Argumentul Huawei, redat în articol: pe măsură ce asistenții AI și agenții autonomi devin mai răspândiți, inference ar urma să devină cea mai mare sursă de cerere pentru putere de calcul AI. Pentru că aceste sarcini sunt, în general, mai puțin solicitante decât antrenarea modelelor foarte mari, Huawei poate rămâne competitivă chiar dacă performanța brută a cipurilor este mai slabă. Pentru a compensa, compania ar lega un număr mare de cipuri folosind tehnologie proprie de rețelistică, construind clustere (grupuri de servere/cipuri care lucrează împreună) pentru a crește performanța la nivel de sistem. Un exemplu invocat: DeepSeek ar fi folosit cipul Huawei 950PR pentru inference, deși cel mai recent model v4 ar fi fost antrenat pe cipuri Nvidia, potrivit confirmării companiei menționate în articol. Miza economică: o piață de 67 mld. dolari și o pondere tot mai mare pentru furnizorii locali Estimările Morgan Stanley citate indică o schimbare structurală: piața de cipuri AI din China ar putea ajunge la circa 67 miliarde dolari (aprox. 308 miliarde lei) până în 2030, iar companiile locale ar urma să acopere aproximativ 86% din cerere. Tot Morgan Stanley estimează că furnizorii chinezi ar putea reprezenta, singuri, circa 21 miliarde dolari (aprox. 97 miliarde lei) din piață chiar în acest an. În paralel, Huawei își sprijină planurile de creștere pe capacitatea de producție internă: majoritatea cipurilor sale AI sunt fabricate de SMIC , iar compania ar plănui să adauge încă două fabrici dedicate în acest an. Dacă își crește producția cu succes, prognoza inițială de venituri ar putea fi depășită, potrivit articolului. Ce rămâne în avantajul Nvidia Chiar și cu presiunea de reglementare, Nvidia păstrează avantaje importante, în special ecosistemul software. Tom’s Hardware arată că, deși Huawei dezvoltă platforma Cann ca alternativă internă la CUDA (platforma software Nvidia folosită pe scară largă), dezvoltatorii spun că aceasta rămâne în urmă la capitolele ușurință de utilizare și maturitate. Costurile operaționale și complexitatea de dezvoltare pot crește pentru clienți, ceea ce ajută Nvidia să își mențină influența globală. În China, însă, „prinderea” Nvidia s-a slăbit după ce Washingtonul a blocat anul trecut vânzările H20 (un procesor modificat pentru piața chineză, conform cerințelor de export), iar compania ar avea dificultăți în a găsi un produs care să respecte simultan regulile americane și cerințele de reglementare chineze. „Ziua în care DeepSeek apare mai întâi pe Huawei este un rezultat groaznic pentru națiunea noastră – ar putea duce la un scenariu în care modelele AI din întreaga lume sunt dezvoltate și rulează cel mai bine pe hardware non-american”, a spus Jensen Huang, într-un interviu recent citat de articol. În lipsa unei deblocări rapide a livrărilor H200 și a unei soluții stabile de conformare pe ambele maluri, riscul operațional pentru Nvidia este ca piața chineză să se reorienteze accelerat către furnizori locali, cu efect direct asupra veniturilor și a influenței ecosistemului său în a doua cea mai mare economie a lumii. [...]

În plin conflict juridic cu Elon Musk, Sam Altman a transmis public că acesta „poate veni” la petrecerea de celebrare GPT-5.5, un gest care mută disputa din sala de judecată în zona de reputație și control al comunicării , potrivit iTHome . Evenimentul este programat pe 5 mai, iar OpenAI ar urma să organizeze o „petrecere de succes” pentru GPT-5.5. Altman a publicat online un formular de înscriere pentru cei interesați, menționând că instrumentul Codex va ajuta compania să selecteze participanții. Contextul invitației a apărut după ce scriitorul Andrew Curran a comentat că Musk ar putea apărea neinvitat „ca vrăjitoarea din Frumoasa din pădurea adormită” și ar „arunca un blestem” asupra petrecerii. Altman a răspuns: „Dacă vrea să vină, poate veni. Lumea are nevoie de mai multă iubire.” De ce contează: presiune pe comunicarea publică în timpul procesului Gestul vine la scurt timp după ce judecătoarea federală americană Yvonne Gonzalez Rogers i-ar fi avertizat pe cei doi executivi să-și „controleze impulsul” de a posta pe rețelele sociale și să nu agraveze situația în afara instanței. În acest cadru, mesajul lui Altman funcționează ca un semnal public de detensionare, dar și ca o mutare cu potențial de impact reputațional într-un litigiu aflat deja în desfășurare. Relația Musk–OpenAI și procesul Musk și Altman au o relație conflictuală de ani de zile. Potrivit informațiilor citate, cei doi au cofondat OpenAI în 2015, iar Musk a părăsit organizația în 2018, invocând divergențe de valori. Ulterior, Musk a criticat OpenAI și a pus sub semnul întrebării trecerea de la modelul non-profit la unul comercial, în timp ce și-a lansat propria companie de inteligență artificială, xAI. În martie 2024, Musk a dat în judecată OpenAI, pe Altman și alți cofondatori, susținând că ar fi fost încălcat acordul inițial de înființare. Cazul a intrat în faza de judecată la finalul lunii aprilie, iar relatarea menționează un climat tensionat în sală, inclusiv un moment de confruntare între Musk și avocații OpenAI înainte de intervenția judecătorului. [...]

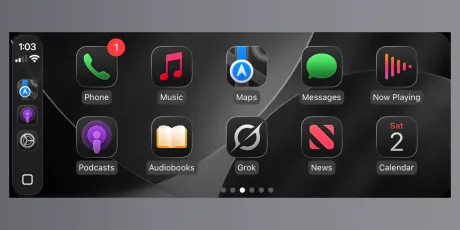

xAI pregătește extinderea lui Grok în mașinile cu CarPlay , după ce aplicația Grok pentru iPhone a început să includă un „placeholder” (o interfață nefuncțională, de test) pentru Apple CarPlay, semn că suportul este în lucru, potrivit 9to5Mac . În forma actuală, aplicația Grok din CarPlay nu funcționează efectiv, dar la deschidere afișează mesajul: „Grok Voice mode coming soon to CarPlay” („Modul Grok Voice vine în curând pe CarPlay”). Consecința practică este că xAI urmărește să ducă experiența de chatbot cu comandă vocală în ecosistemul CarPlay, adică în „aproape orice altă mașină de pe șosea”, nu doar în vehiculele Tesla, unde Grok este deja integrat. De ce contează: CarPlay devine o platformă pentru chatboți AI CarPlay a început recent să accepte aplicații de tip chatbot AI, iar Grok ar urma să fie a treia aplicație care adaugă suport, alături de ChatGPT și Perplexity , conform publicației. Pentru utilizatori, asta înseamnă mai multe opțiuni de asistent conversațional în interfața mașinii, cu accent pe interacțiunea vocală. În același context, 9to5Mac notează că Google nu a dat semne că ar aduce Gemini în CarPlay, deși modelele Gemini ar urma să ajute la „noul Siri” din iOS 27, mai târziu în acest an. Publicația mai menționează și așteptarea ca Apple să lanseze o aplicație Siri dedicată, care „probabil” va funcționa și cu CarPlay. Ce se știe despre calendar și disponibilitate Sursa nu oferă o dată de lansare, ci doar indică faptul că modul Grok Voice ar urma să ajungă „în curând” pe CarPlay, pe baza mesajului din aplicație și a prezenței interfeței nefuncționale. Aplicația Grok pentru iOS este disponibilă în App Store, însă suportul CarPlay nu este încă activ. [...]

O hotărâre a Tribunalului Intermediar al Poporului din Hangzhou limitează concedierile motivate de automatizare , stabilind că firmele nu pot da afară angajați doar ca să îi înlocuiască cu inteligență artificială pentru reducerea costurilor, potrivit G4Media . Decizia este prezentată ca un reper pentru protecția muncii într-un context de adoptare accelerată a tehnologiilor AI. Instanța a menținut concluziile anterioare într-un caz în care o companie de tehnologie a concediat ilegal un angajat cu funcție superioară după ce a introdus sisteme de inteligență artificială care îi preluau atribuțiile. Cazul a fost publicat într-un set de exemple juridice-model înaintea Zilei Internaționale a Muncii, ceea ce îi amplifică relevanța pentru practica judiciară și pentru companii. Ce a decis instanța și de ce contează pentru companii Litigiul a vizat un angajat identificat drept Zhou, angajat în 2022 ca supervizor de asigurare a calității. Rolul lui era să supravegheze rezultatele generate de „ modele lingvistice mari ” (sisteme AI care generează text) și să se asigure că sunt respectate standardele privind datele și conținutul. Pe măsură ce firma a automatizat tot mai mult procesele, lui Zhou i s-a propus un post mai prost plătit, cu responsabilități mult reduse. După ce a refuzat reîncadrarea, a fost concediat și i s-a oferit o compensație, contestată ulterior prin arbitraj. Autoritățile au constatat că justificarea companiei – o restructurare organizațională determinată de adoptarea AI – nu îndeplinea pragul legal necesar pentru concediere în baza legislației muncii din China. Instanțele au concluzionat că înlocuirea unui lucrător cu AI nu este, în sine, o „schimbare majoră a circumstanțelor obiective” (precum relocarea sau fuziunea) și nu poate fi folosită ca temei pentru încetarea contractului. De asemenea, rolul alternativ oferit a fost considerat nerezonabil din cauza reducerii abrupte a salariului. Context: AI se extinde, iar litigiile de muncă se înmulțesc Potrivit materialului, experți juridici apreciază că hotărârea întărește ideea că firmele pot urmări eficiența prin automatizare, dar trebuie să își respecte obligațiile față de angajați. Decizia vine după rezultate similare în arbitraje din alte orașe chineze, unde concedierile determinate de AI au fost considerate ilegale. Cazul apare într-un moment în care sectorul AI din China se extinde rapid, cu mii de firme active și cu o integrare pe scară largă așteptată în toate industriile până la sfârșitul deceniului, pe fondul îngrijorărilor privind utilizarea abuzivă a automatizării, inclusiv situații în care companiile ar reproduce roluri umane prin echivalente digitale bazate pe AI. [...]

Pentagonul menține interdicția asupra Anthropic , dar tratează separat modelul AI Mythos , evaluat ca tehnologie cu implicații pentru securitatea națională, potrivit Profit . Distincția arată cum autoritățile americane separă riscul de „lanț de aprovizionare” asociat unei companii de utilitatea punctuală a unui model de inteligență artificială în zona de apărare și securitate cibernetică. Modelul Mythos este analizat separat deoarece ar avea capacități avansate de identificare și remediere a vulnerabilităților cibernetice. Directorul tehnologic al Pentagonului, Emil Michael, a spus că aceste capabilități obligă autoritățile să consolideze securitatea rețelelor guvernamentale. Ce înseamnă, practic, „interdicția” pentru Anthropic Deși Mythos e evaluat distinct, statutul Anthropic de „risc pentru securitate” rămâne în vigoare, pe fondul unui conflict deschis între companie și autoritățile americane privind utilizarea tehnologiei sale. Consecința operațională este directă pentru ecosistemul de furnizori ai armatei: firmele contractoare trebuie să certifice că nu folosesc modelele Claude (dezvoltate de Anthropic) în proiecte militare. Compania a dat în judecată administrația americană pentru a contesta decizia de clasificare, conform informațiilor din articol. Context: Pentagonul își extinde parteneriatele AI pentru rețele clasificate În paralel, Pentagonul a anunțat acorduri cu mai multe companii tehnologice majore — OpenAI, Google, Microsoft, Nvidia și Amazon Web Services — pentru implementarea soluțiilor de inteligență artificială în rețelele clasificate ale instituției. Pentru piață, mesajul este că accesul la contracte și implementări în zona de apărare depinde nu doar de performanța tehnologică, ci și de evaluările de risc privind furnizorul și lanțul de aprovizionare, care pot bloca utilizarea unor modele chiar și atunci când anumite componente sunt considerate relevante pentru securitatea națională. [...]