Știri

Știri din categoria Inteligență artificială

Microsoft testează integrarea unor funcții de tip OpenClaw în Microsoft 365 Copilot, cu accent pe controlul de securitate pentru clienții enterprise, potrivit TechCrunch. Compania a confirmat pentru The Information că noile capabilități ar viza mediul corporate și ar veni cu „controale de securitate mai bune” decât agentul open-source OpenClaw, descris ca fiind riscant.

Miza operațională este trecerea de la Copilot ca asistent care răspunde la solicitări la un agent care poate executa acțiuni în mod continuu. Conform informațiilor citate, una dintre funcțiile principale ar fi un fel de „365 Copilot care lucrează mereu”, capabil să inițieze acțiuni oricând și să ducă la capăt sarcini în mai mulți pași, pe perioade mai lungi.

OpenClaw este prezentat ca un instrument care rulează local pe calculatorul utilizatorului și poate crea „agenți” care îndeplinesc sarcini în numele acestuia. TechCrunch notează că, dacă Microsoft va construi propria versiune de „Claw” (adică un agent care rulează local), proiectul s-ar alătura unei serii de instrumente „agentice” anunțate de companie în ultimele luni.

Deocamdată, publicația subliniază că nu este clar dacă noul „Claw” al Microsoft va rula local sau va prelua doar unele dintre funcțiile apreciate de comunitatea OpenClaw.

În material sunt menționate mai multe inițiative recente ale Microsoft în zona de agenți:

Pentru companii, diferența majoră sugerată de articol este promisiunea unor controale de securitate mai solide decât în cazul unui proiect open-source considerat „riscant”, într-un context în care agenții capabili să execute acțiuni pot amplifica impactul unui incident (de la acces neautorizat la automatizări greșite).

TechCrunch mai notează și un element de piață: deși OpenClaw poate rula pe Windows, Mac Mini a devenit platforma preferată pentru utilizatorii OpenClaw, iar aceste dispozitive „s-au vândut ca pâinea caldă”, ceea ce ar putea fi încă o motivație pentru Microsoft să vină cu propria alternativă.

Compania ar urma să prezinte noul „Claw” (sau o versiune îmbunătățită a unuia dintre instrumentele existente) la conferința Microsoft Build din iunie, potrivit unui material The Verge citat de TechCrunch. Publicația spune că a cerut Microsoft clarificări despre cum se poziționează acest agent față de ceilalți și va actualiza informația când va primi un răspuns.

Recomandate

Microsoft testează „Scout”, un asistent AI care rulează permanent în fundal, cu identitate separată și controale de administrare pentru companii , potrivit WinFuture . Noul agent, prezentat la Build 2026, este gândit să urmărească sarcini în mod autonom, nu doar să răspundă la comenzi punctuale, însă se află încă într-o fază timpurie de testare. Scout este descris ca un „autopilot” pentru munca de birou: rămâne activ în fundal, folosește o identitate proprie și ar trebui să coordoneze fluxuri de lucru între mai multe servicii Microsoft 365. În lista de integrare intră Teams, Outlook, OneDrive și SharePoint, dar și acțiuni locale pe dispozitiv. De ce contează pentru companii: de la „chat” la agent care execută și urmărește sarcini Miza operațională este trecerea de la un instrument de tip chatbot la un agent care „ține minte” contextul și continuă pașii necesari fără intervenție constantă. Microsoft indică drept exemple activități de coordonare repetitivă, precum programarea întâlnirilor, identificarea ședințelor importante sau blocarea automată a unor intervale în calendar. Pentru a face asta, Scout se bazează pe „Work IQ”, o componentă de context care ar urma să recunoască tipare, persoane și fișiere din mediul de lucru, astfel încât recomandările să devină mai relevante în timp. Securitate și guvernanță: identitate Entra separată și politici înainte de trimitere/stocare Un element central în poziționarea Scout este controlul pentru mediile enterprise. Fiecare agent rulează cu o identitate Entra administrată, nu printr-un cont comun de serviciu, astfel încât acțiunile să fie atribuibile și aliniate la politicile existente. Administratorii pot seta reguli, limita accesul și securiza acțiuni sensibile. Publicația notează că se aplică și mecanisme din Microsoft Purview , inclusiv etichete de confidențialitate și politici de prevenire a scurgerilor de date, înainte ca informațiile să fie trimise sau salvate. Microsoft a publicat și documentație dedicată. Disponibilitate: acces limitat, condiționat de politici și licențe Scout este disponibil inițial doar pentru așa-numitele „Frontier-Organizații”, într-o versiune experimentală. Accesul presupune o înregistrare Frontier, politici Intune și o confirmare separată; ulterior, utilizatorii cu licență GitHub Copilot pot descărca și instala soluția. Din perspectiva arhitecturii, Scout folosește tehnologia deschisă OpenClaw ca bază, peste care Microsoft adaugă integrarea în Microsoft 365 și funcțiile de securitate și administrare. Pentru companii, semnalul este direcția în care se împinge piața: asistenți AI „mereu activi”, integrați în procese și guvernanță, nu doar în ferestre de chat. [...]

Microsoft și Qualcomm își repoziționează strategia de platformă către „agenți” de inteligență artificială , pe fondul lansării Project Solara, o inițiativă „de la cip la cloud” menită să susțină acest tip de software, potrivit 9to5Mac . Mesajul-cheie vine de la CEO-ul Microsoft, Satya Nadella, care descrie tranziția ca pe o schimbare de paradigmă în modul în care vor fi construite produsele și experiențele digitale. Project Solara este prezentat de Qualcomm drept „o nouă platformă de la cip la cloud, unde siliciul, software-ul și cloud-ul se reunesc pentru a alimenta experiențe AI mai personale, mai conștiente de context și mereu cu tine”. Inițiativa este dezvoltată în parteneriat cu Microsoft și a fost anunțată în cadrul Microsoft Build , conferința anuală a companiei pentru dezvoltatori. Ce spune Nadella: de la sisteme de operare și aplicații, la „agenți” Într-un videoclip realizat împreună cu CEO-ul Qualcomm, Cristiano Amon, Nadella a formulat explicit direcția strategică a Microsoft: „Există o schimbare reală de platformă. Trecem de la a construi sisteme de operare, dispozitive pentru aplicații, la agenți.” Din perspectiva operațională, afirmația sugerează o mutare a centrului de greutate: în loc ca sistemul de operare și aplicațiile să fie „unitatea” principală a experienței, rolul ar urma să fie preluat de agenți AI — programe care execută sarcini și interacționează mai autonom, în numele utilizatorului. De ce contează: presiune competitivă înainte de WWDC Materialul plasează această repoziționare și în contextul competiției din ecosistemul Apple. Publicația notează că pivotarea Microsoft către „agent-first computing” creează un cadru în care Apple urmează să-și contureze propria viziune la WWDC (conferința dezvoltatorilor), unde sunt așteptate atât actualizări tradiționale de sisteme de operare, cât și prezentarea unei noi versiuni Siri în iOS 27, cu „capabilități agentice” vehiculate ca zvon. Pentru detalii suplimentare despre inițiativă, articolul indică și pagina dedicată Project Solara de pe site-ul Microsoft, precum și anunțul Qualcomm despre proiect. [...]

NVIDIA își extinde „trusa” pentru agenți AI autonomi, mizând pe reducerea costurilor și pe controlul de securitate în enterprise , într-o mișcare care poate accelera adoptarea acestor „colegi digitali” în inginerie, securitate cibernetică și operațiuni, potrivit NVIDIA News . Noutatea nu este doar apariția unor modele și componente software, ci faptul că NVIDIA încearcă să standardizeze „stratul” care transformă un model AI într-un agent capabil să ruleze pe termen lung, cu memorie, orchestrare, utilizare de instrumente și politici de confidențialitate. În practică, compania împinge o combinație de elemente open-source (cod deschis) și parteneriate cu furnizori mari de software, pentru a face agenții mai ușor de construit și mai siguri de rulat în organizații. Ce livrează NVIDIA: toolkit, runtime securizat și „abilități” din CUDA-X Pachetul anunțat este centrat pe NVIDIA Agent Toolkit și include: NVIDIA NemoClaw (blueprint-uri, adică șabloane/planuri de implementare pentru agenți) – disponibil acum; modele NVIDIA Nemotron (deschise) pentru agenți care rulează „always-on”; NVIDIA OpenShell , un runtime (mediu de execuție) securizat cu politici de confidențialitate și control – disponibil în „early preview”; acces la bibliotecile NVIDIA CUDA-X ca „skills” (abilități) pe care agenții le pot apela pentru sarcini specializate. NVIDIA susține că această combinație oferă „blocuri” deschise pentru dezvoltarea enterprise, cu accent pe agenți care pot rula mult timp și pot fi guvernați prin politici. Unde se vede impactul operațional: inginerie și simulare, din săptămâni în ore În zona de proiectare și simulare (semiconductori și inginerie industrială), NVIDIA indică un beneficiu operațional direct: companii precum Cadence, Dassault Systèmes, Siemens și Synopsys folosesc NemoClaw pentru a construi „ingineri AI” autonomi care execută fluxuri de lucru de simulare și verificare, cu promisiunea de a comprima săptămâni de muncă în ore . Câteva exemple punctuale din anunț: Cadence folosește OpenShell pentru a securiza „ChipStack AI Super Agent”, un agent complet autonom pentru proiectare și verificare de cipuri; NVIDIA spune că este primul client care îl folosește pentru verificarea autonomă a propriilor proiecte. Dassault Systèmes utilizează NemoClaw și OpenShell pentru a „productiza” (a transforma în produs) o platformă de agenți autonomi pentru design, simulare și operațiuni de producție. Siemens integrează NemoClaw și OpenShell în Fuse EDA AI Agent, pentru orchestrarea fluxurilor multi-instrument în proiectarea de semiconductori și plăci de circuit. Synopsys lucrează cu NVIDIA la „ingineri AI” autonomi „always-on”, cu obiectivul de autonomie completă a fluxurilor de lucru. Separat, NVIDIA menționează și un pilot la Foxconn , care ar urma să folosească NemoClaw pentru platforme din zona medicală (Nurabot și CoDoctor) și pentru un agent de operațiuni de fabrică (MoMClaw), cu controale de confidențialitate în OpenShell. Miza de cost și performanță: Nemotron 3 Ultra și agenții „long-running” Pentru partea de „inteligență” a agenților, NVIDIA anunță Nemotron 3 Ultra , descris ca un model „mixture-of-experts” cu 550 de miliarde de parametri , orientat către agenți care rulează pe termen lung. Compania afirmă că modelul oferă: inferență de până la 5 ori mai rapidă ; costuri cu până la 30% mai mici pentru sarcini agentice complexe, comparativ cu „modele frontieră deschise” din aceeași clasă (fără a detalia în comunicat care sunt reperele exacte). Disponibilitatea indicată: Nemotron 3 Ultra este așteptat pe 4 iunie , inclusiv prin Hugging Face, ModelScope, OpenRouter și build.nvidia.com, ca microservicii NVIDIA NIM. De ce insistă NVIDIA pe runtime și politici: parteneriate cu Microsoft, Canonical și Red Hat Pe măsură ce agenții devin capabili să scrie cod, să creeze sub-agenți și să păstreze context între sesiuni, crește și riscul operațional. NVIDIA poziționează OpenShell ca stratul critic de control (politici, confidențialitate, „guardrails”) pentru rularea agenților la scară. În acest context: NVIDIA și Microsoft colaborează pentru o experiență „nativă” pe Windows, bazată pe noi „primitives” de securitate (identitate, izolare/containment, politici, securitate end-to-end), peste care OpenShell adaugă politici suplimentare și rutare „inteligentă” a cererilor către modele locale, în funcție de setările de confidențialitate; totodată, OpenShell poate „masca” informații personale în cereri trimise către modele din cloud. Canonical ar urma să integreze OpenShell cu Ubuntu prin snaps și „rocks” (containere compatibile OCI). Red Hat integrează OpenShell în platforma Red Hat AI și contribuie la proiectul open-source „upstream” pentru standardizarea modului în care agenții sunt gestionați pe platforme enterprise. NVIDIA mai indică faptul că aceste anunțuri continuă integrări recente cu SAP (Joule Studio runtime) și ServiceNow (Project Arc), însă fără a oferi detalii suplimentare despre calendar sau amploarea implementărilor. „Skills” pentru agenți: ce biblioteci CUDA-X devin accesibile NVIDIA spune că bibliotecile CUDA-X pot fi apelate de agenți ca abilități specializate, cu exemple precum: cuDF pentru procesare și analiză de date structurate la scară mare; cuOpt pentru optimizare (rutare, programare, alocare de resurse, lanț de aprovizionare) în timp real; AI-Q pentru rutare, context persistent și evaluare în fluxuri de cercetare și cunoaștere; NeMo pentru optimizare, evaluare și guvernanță (inclusiv rutare de modele și personalizare); PhysicsNeMo pentru modele de fizică și simulări; CUDA-Q pentru instalare și testare de programe cuantice, simulare și orchestrare de aplicații cuantice. Separat, compania menționează și o colecție de biblioteci și framework-uri open-source pentru „physical AI” (de exemplu, robotică și sisteme industriale), fără a detalia în acest material conținutul exact. Ce urmează Pe termen scurt, reperele sunt disponibilitatea deja anunțată pentru NemoClaw și „early preview” pentru OpenShell, respectiv lansarea așteptată a Nemotron 3 Ultra pe 4 iunie. Din perspectivă operațională, semnalul important este că furnizori mari de software industrial și EDA (electronic design automation) își construiesc agenți autonomi pe aceste componente, cu obiectivul declarat de a scurta semnificativ ciclurile de simulare și verificare și de a muta efortul uman către activități cu valoare mai mare. [...]

Donald Trump a semnat un ordin executiv care introduce un cadru voluntar de evaluare a modelelor avansate de inteligență artificială înainte de lansare , o schimbare de strategie la Casa Albă menită să reducă riscurile de securitate cibernetică fără a impune un control obligatoriu al administrației, potrivit Digi24 . Ordinul urmărește să protejeze sistemele informatice ale SUA în fața unor modele AI care pot detecta și exploata vulnerabilități „cu o viteză fără precedent”. Mecanismul propus permite companiilor să își trimită, opțional, modelele de ultimă generație pentru revizuire guvernamentală înainte de lansare, însă textul precizează explicit că decretul nu trebuie interpretat ca instituind un control prealabil obligatoriu. Ce se schimbă operațional: o revizuire „pe bază de voluntariat”, cu termen mai scurt Documentul reduce perioada de analiză voluntară la 30 de zile, de la 90 de zile în versiunea anterioară, pe care Trump a refuzat să o semneze în ultimul moment cu două săptămâni înainte. Președintele a motivat atunci amânarea prin faptul că „nu i-au plăcut anumite aspecte” și că nu a vrut să „compromită” avantajul Americii asupra Chinei. Platformă de coordonare la Trezorerie, cu NSA și CISA Ordinul creează și o „platformă de coordonare” condusă de Departamentul Trezoreriei , împreună cu Agenția Națională de Securitate (NSA) și Agenția pentru Securitatea Cibernetică (CISA). Rolul acesteia este să lucreze cu industria — tot voluntar — pentru detectarea și remedierea vulnerabilităților software. Miza de reglementare: securitatea cibernetică împinge administrația spre un compromis Episodul semnării scoate la iveală tensiuni interne între o tabără favorabilă reglementării, condusă de secretarul Trezoreriei, Scott Bessent, și o aripă ostilă oricărei forme de reglementare, care vede revizuirea guvernamentală drept un obstacol pentru inovație în competiția cu China. În același timp, ordinul este prezentat ca o schimbare prudentă față de poziția anterioară a administrației, care se opusese ferm reglementării AI. În ultimele luni, îngrijorările privind posibile atacuri asupra infrastructurii critice — inclusiv rețele electrice, bănci și agenții guvernamentale — au cântărit mai mult în balanță. Un element de context menționat este modelul Mythos al startup-ului Anthropic , cu acces limitat la parteneri care îl folosesc pentru consolidarea securității cibernetice, ceea ce ar fi contribuit la declanșarea proiectului. Context: asemănări cu abordarea Biden, după abrogarea ordinului din 2023 Abordarea voluntară este descrisă ca fiind similară, în principiu, cu ordinul executiv semnat de Joe Biden în 2023, bazat pe angajamente ale companiilor de a împărtăși rezultatele testelor de securitate cu administrația. Trump abrogase acel text la revenirea la Casa Albă, considerându-l prea restrictiv. [...]

Valul de concedieri din IT se extinde în România , pe fondul restructurărilor și al investițiilor accelerate în automatizare și inteligență artificială, potrivit Libertatea . Dincolo de eticheta de „apocalipsă AI”, miza economică este comprimarea costurilor și redesenarea echipelor în companii mari, cu efect direct în piața muncii din tehnologie. În timp ce lideri din industrie resping ideea că inteligența artificială ar provoca șomaj, concedierile colective se văd atât la nivel global, cât și local, pe o listă care include nume mari din IT, retail online și auto, arată publicația. Cine taie din personal și ce dimensiune au reducerile Printre cele mai recente cazuri menționate se află Telus Digital , care concediază 300 de persoane, după ce alte 300 ar fi fost concediate odată cu închiderea unui alt proiect major, conform consultantului în resurse umane Doru Șupeală. Compania are operațiuni în mai multe orașe (inclusiv București, Craiova și Brașov) și avea în 2024 aproximativ 2.489 de angajați, potrivit datelor financiare citate. eMAG a anunțat o reorganizare internă care presupune reducerea cu aproximativ 3% a numărului de angajați. Dante International SA, compania din spatele eMAG, avea 3.191 de angajați în 2024; grupul include și Fashion Days, PC Garage și Sameday. În zona auto cu componentă puternică de inginerie și software, Renault ar urma să concedieze între 15% și 20% din totalul inginerilor, conform noii strategii anunțate de CEO-ul Francois Provost. În România, Renault are un centru de dezvoltare în București și unul la Titu împreună cu Geely, prin compania mixtă Horse. La Dacia, compania a anunțat un program de concedieri voluntare, iar sindicatul a afirmat că 1.200 de oameni sunt vizați, în contextul mutării producției unor modele și al planurilor pentru viitoare modele. Multinaționalele din tech: reduceri globale, efecte locale Amazon a concediat 30.000 de oameni la nivel global, iar în România Amazon Development Center anunța anul trecut concedierea a 504 oameni la Iași. În material se menționează și acuzații că posturile de la Iași ar fi fost mutate în India. Pentru Oracle, presa a scris în noiembrie anul trecut că grupul american ar urma să concedieze aproximativ 400 de angajați din România, în cadrul unei restructurări globale. La nivel global, Oracle a renunțat la 30.000 de persoane, iar compania investește masiv în inteligența artificială, la fel ca Amazon. Microsoft a avut mai multe runde de concedieri la nivel global în ultimul an, iar unele au vizat și România. Doru Șupeală a afirmat că 150–200 de angajați din România sunt afectați, însă Ziarul Financiar a scris că, în pofida restructurărilor, numărul de angajați ai Microsoft din România a crescut cu 110 în 2025, până la 1.668. IBM a anunțat concedierea a 2.700 de angajați la nivel global (din 270.000), invocând creșterea eficienței organizaționale; în România, compania are circa 3.300 de angajați, potrivit articolului. Playtika a anunțat în ianuarie 2026 un val de concedieri care va afecta 15% din personalul la nivel internațional, potrivit StartupCafe.ro, invocând trecerea la „echipe optimizate prin inteligență artificială și automatizare”. În România, compania avea 299 de angajați prin Homerun QT SRL și 114 prin Homerun Ciero SRL. Libertatea mai notează că în ultimii ani au existat concedieri în România și la Atos, UiPath și Endava. De ce contează: piața muncii intră într-o fază de „optimizare” pe termen mediu Din informațiile prezentate, concedierile nu sunt izolate, ci apar în paralel în mai multe companii și sectoare, cu justificări care merg de la reorganizări interne la strategii globale și eficientizare. Legătura directă dintre fiecare rundă de concedieri și inteligența artificială nu este demonstrată uniform în toate cazurile din material; în unele situații, companiile invocă explicit automatizarea, iar în altele contextul este mai larg (restructurări, mutări de producție, decizii globale). În afara IT-ului, articolul plasează aceste evoluții într-un tablou mai amplu de disponibilizări în energie și industrie, precum și în zona auto, ceea ce sugerează o presiune mai generală pe costuri și pe reconfigurarea operațiunilor, nu doar o schimbare tehnologică punctuală. [...]

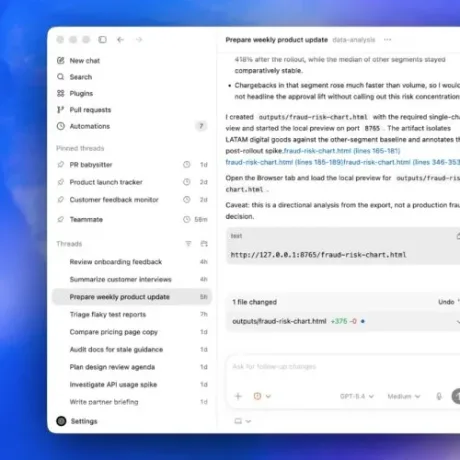

Codex depășește zona de programare și intră în munca de birou , iar această schimbare se vede deja în utilizare: potrivit OpenAI , instrumentul are peste 5 milioane de utilizatori activi săptămânal, de peste șase ori mai mulți față de momentul lansării aplicației desktop în februarie, iar „knowledge workers” (angajați care lucrează preponderent cu informație și documente) ajung la circa 20% din baza de utilizatori și cresc de peste trei ori mai repede decât restul. Datele vin dintr-un raport nou, „ The Next Era of Knowledge Work ”, care descrie cum Codex este folosit tot mai mult pentru automatizarea sarcinilor repetitive și reducerea blocajelor operaționale din activitățile de tip office. Deși dezvoltatorii rămân cel mai mare grup de utilizatori, dinamica de creștere indică o extindere rapidă către roluri non-tehnice. Ce fac, concret, utilizatorii non-tehnici cu Codex În zona de „knowledge work”, Codex este folosit în principal pentru livrabile standard, pe care multe echipe le produc recurent: rapoarte, foi de calcul și prezentări; contracte și alte documente de lucru; cercetare și sinteză de informații; analiză de date; automatizarea fluxurilor de lucru; construirea de instrumente simple („lightweight tools”) care înainte necesitau suport de la echipe de inginerie. OpenAI notează că cele mai rapide creșteri, ca tip de activitate, sunt la analiza de date, cercetare și crearea de „artefacte de cunoaștere” (documente și materiale care codifică informația pentru utilizare internă). Impact operațional: lucru în paralel și viteză mai mare de execuție Un element important din raport este creșterea utilizării în paralel: tot mai mulți utilizatori rulează mai multe sarcini Codex simultan, astfel încât pot investiga date, redacta materiale și automatiza fluxuri în același timp. În logica operațională a companiilor, asta înseamnă potențial mai puține timpi morți între etape și o capacitate mai mare de a împinge proiecte prin ciclurile de revizuire și aprobare. OpenAI sugerează că această „viteză” ar putea schimba pe termen lung impactul inteligenței artificiale asupra muncii: oamenii ar putea aborda proiecte mai ambițioase, cu o extindere a responsabilităților și, posibil, accelerarea progresului în carieră. Unde se vede utilitatea, indiferent de industrie Modelul de utilizare este descris ca fiind similar în mai multe industrii: Codex ar reduce „fricțiunea” muncii moderne prin faptul că ajută la găsirea informațiilor împrăștiate în sisteme diferite, coordonarea muncii între instrumente și echipe, producerea de livrabile de calitate și avansarea proiectelor prin procese interne. Raportul nu oferă, în fragmentul publicat, o defalcare pe industrii sau exemple cantitative de economii de timp, dar indică o schimbare de poziționare: Codex este împins tot mai mult ca instrument general de productivitate, nu doar ca unealtă pentru scriere de cod. [...]