Știri

Știri din categoria Inteligență artificială

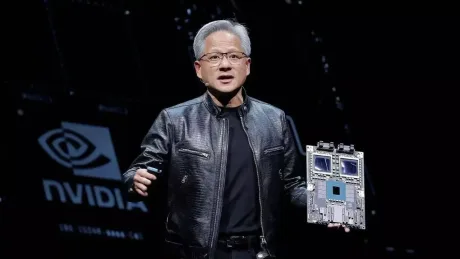

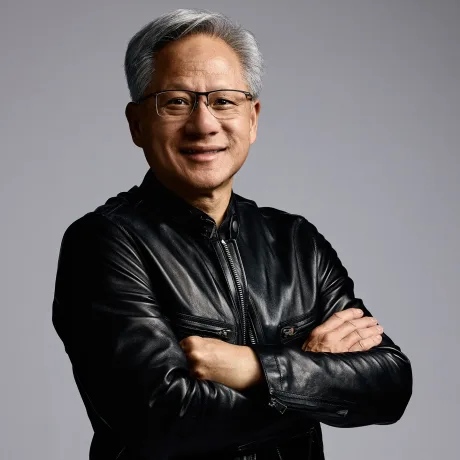

Jensen Huang susține că restricțiile SUA la export nu pot „sufoca” capacitatea de calcul a Chinei, argumentând că Beijingul are suficiente resurse energetice, infrastructură și competențe industriale pentru a compensa lipsa celor mai avansate cipuri americane, potrivit IT之家. În acest context, CEO-ul Nvidia cere reluarea dialogului și a cooperării de cercetare între SUA și China pentru stabilirea unor reguli comune de utilizare sigură a inteligenței artificiale.

Declarațiile au fost făcute miercuri, într-un interviu acordat podcastului de tehnologie Dwarkesh, pe fondul tensiunilor comerciale și de securitate dintre cele două țări, despre care Huang spune că au redus colaborarea în zone de cercetare considerate critice. El a invocat drept exemplu progresele asociate modelului de securitate cibernetică „Mythos” al Anthropic, pe care le vede ca un semnal că cele două mari economii ar trebui să ajungă la un consens privind utilizările „interzise” ale AI.

„Noi vrem ca America să câștige, dar cred că menținerea dialogului, desfășurarea schimburilor la nivel de cercetare poate fi cea mai sigură abordare. Trebuie să muncim să ajungem la un acord, să fie clar ce utilizări nu pot fi făcute cu AI. Acest lucru este crucial.”

Întrebat dacă măsurile SUA de control al exporturilor chiar limitează China, Huang a susținut că piața chineză nu va fi constrânsă de lipsa capacității de calcul, deoarece China ar avea:

El a mai spus că puterea de calcul necesară pentru antrenarea modelului Anthropic „Mythos” ar fi fost „relativ obișnuită” și „disponibilă pe scară largă” în China. Conform materialului, modelul are capabilități puternice de securitate cibernetică și, în prezent, este disponibil doar pentru unele companii și oficiali guvernamentali.

În ultimul an, Huang ar fi făcut presiuni asupra administrației Trump pentru relaxarea restricțiilor de export impuse din motive de securitate națională, care blochează vânzarea către China a celor mai performante procesoare AI ale Nvidia. Mesajul său public combină două idei: pe de o parte, nevoia de reguli comune privind utilizarea sigură a AI; pe de altă parte, faptul că limitarea accesului la cipuri de top nu ar elimina capacitatea Chinei de a construi infrastructură de calcul la scară mare.

Recomandate

Nvidia susține că și-a asigurat capacitatea de producție pentru a alimenta creșterea cererii de cipuri pentru inteligență artificială, chiar dacă blocajele de aprovizionare nu au dispărut , potrivit Reuters . Mesajul vine într-un moment în care compania este tratată de piață drept un barometru al sănătății sectorului AI, deoarece procesoarele sale sunt folosite în aproape toate marile centre de date. Jensen Huang , CEO-ul Nvidia, a declarat la o conferință de presă organizată în timpul săptămânii Computex , la Taipei, că firma „a securizat” suficientă ofertă pentru o „creștere foarte robustă” atât la procesoare centrale (CPU), cât și la procesoare grafice (GPU). În același timp, el a admis că Nvidia rămâne „constrânsă de ofertă”, semnalând că presiunea cererii depășește încă ritmul la care poate fi livrată producția. De ce contează: semnal pentru piața AI și pentru clienții de centre de date Nvidia este considerată un indicator pentru piața AI, iar orice nuanță legată de disponibilitatea cipului are implicații directe pentru ritmul investițiilor în infrastructura de calcul. Declarațiile lui Huang sugerează că Nvidia încearcă să reducă riscul ca lipsa de capacitate să frâneze extinderea centrelor de date, dar și că tensiunile din lanțul de aprovizionare rămân un factor de incertitudine. Cererea pentru GPU-urile Nvidia destinate AI a generat „zeci de miliarde de dolari” în venituri, notează Reuters , și a contribuit la poziționarea companiei drept cea mai valoroasă din lume. CPU-urile „Vera”, prezentate ca următorul motor de creștere Huang a indicat că procesoarele de centru de date „Vera” ar putea deveni chiar mai populare decât GPU-urile, argumentând că rolul CPU-urilor în „procesarea informației” este esențial. Nvidia concurează aici cu AMD și Intel, iar CEO-ul a descris Vera drept un viitor „motor major de creștere” pentru companie. Extinderea către PC-uri cu AI și competiția directă cu AMD, Intel și Apple Declarațiile au venit la o zi după ce Nvidia a prezentat un cip nou care aduce capabilități AI direct pe PC-uri. Cipul RTX Spark ar urma să fie lansat în toamnă și va concura cu produse ale AMD, Intel și Apple. Huang a spus că RTX Spark face parte din eforturile Nvidia împreună cu Microsoft de a „reinventa PC-ul” pentru era AI. Taiwan, pivot în lanțul de aprovizionare și în strategia de reziliență Născut în Tainan, Huang a reiterat importanța Taiwanului în strategia Nvidia, afirmând că insula este un partener strategic pentru SUA și invocând investițiile Taiwanului în producția din SUA. Nvidia intenționează să continue investițiile în Taiwan și să își facă lanțul de aprovizionare „cât mai rezilient posibil”, Huang adăugând că firma este „cel mai mare cumpărător” din ecosistemul Taiwanului. În lipsa unor detalii suplimentare despre volume sau termene de livrare, mesajul central rămâne unul de echilibru: Nvidia spune că și-a asigurat capacitatea pentru creștere, dar recunoaște că presiunea cererii menține compania într-o zonă de constrângeri de ofertă. [...]

Nvidia își extinde miza dincolo de centrele de date, intrând pe piața PC-urilor cu un cip care promite să ruleze „agenți” AI local și să schimbe modul de interacțiune cu laptopurile și desktopurile, potrivit The Guardian . Mișcarea deschide o nouă linie de business pentru companie, dar analiștii citați avertizează că impactul financiar ar urma să se vadă în timp, nu imediat. Nvidia, evaluată la 5.000 miliarde dolari (aprox. 23.000 miliarde lei), a prezentat cipul RTX Spark , descris drept „supercip”, care va fi lansat în acest an și va fi folosit de producători precum Dell, Lenovo, Asus și HP, în combinație cu Windows de la Microsoft. CEO-ul Jensen Huang a vorbit despre „reinventarea PC-ului” pentru era AI, după trei ani de colaborare între Nvidia și Microsoft, la conferința Computex din Taiwan . Ce schimbă RTX Spark: AI „la margine”, nu în cloud Cipul este o combinație între un microprocesor și un cip grafic, dezvoltat cu ajutorul MediaTek din Taiwan, și este proiectat să ruleze agenți AI local (pe dispozitiv), în loc să se bazeze pe cloud (infrastructură la distanță). Consecința, în viziunea companiei, este că acești agenți ar putea naviga autonom pe PC, reducând dependența de interacțiunea clasică prin mouse și tastatură. Nvidia susține că, deși cipul este „foarte puternic”, computerele vor putea rămâne „subțiri și ușoare”. Huang a spus că Nvidia reimaginează PC-ul „pentru prima dată în 40 de ani”. De ce contează pentru piață: o confruntare directă cu Intel, Apple, Qualcomm și AMD Intrarea Nvidia cu un cip dedicat PC-urilor deschide „un nou front” în competiția pentru dominația în cipuri AI, punând compania în competiție mai directă cu Intel, Apple, Qualcomm și AMD. Publicația notează că Nvidia, lider în piața în plină expansiune a semiconductorilor pentru AI, împinge strategia dincolo de plăcile grafice, către cipuri integrate care pot alimenta întregul computer. Neil Shah, cofondator al Counterpoint Research, compară „momentul RTX Spark” cu apariția iPhone-ului, ChatGPT și DeepSeek și susține că direcția este trecerea de la PC-ul „centrat pe aplicații” la un „PC personal” bazat pe AI de tip agent (software care execută sarcini în numele utilizatorului). Investitorii: oportunitate pe termen lung, nu motor imediat de profit Susannah Streeter, chief investment strategist la Wealth Club, spune că inițiativa este o încercare „îndrăzneață” de a extinde dominația Nvidia dincolo de centrele de date către utilizarea de zi cu zi, dar că investitorii ar putea privi această mutare mai degrabă ca pe o oportunitate de creștere pe termen lung decât ca pe un factor imediat de câștiguri. În prezent, performanța Nvidia depinde „covârșitor” de cererea globală pentru infrastructură AI și putere de calcul în centrele de date, potrivit aceleiași analize. Context: rivalii accelerează, iar Nvidia își lărgește portofoliul Pe fondul intensificării „războaielor cipurilor”, Intel intenționează să înceapă livrările unui cip AI mai târziu în acest an și a anunțat un nou procesor grafic (GPU) Xe3P, cu numele de cod Crescent Island, descris drept construit pentru „generația” de agenți AI. În paralel, The Guardian notează că noul cip și unitatea centrală de procesare (CPU) Vera arată accentul tot mai mare al Nvidia pe produse pentru PC și CPU. Vera este descris ca fiind proiectat pentru agenți AI, iar printre primii adoptatori sunt menționați OpenAI, Anthropic și SpaceX. Ce urmează Din informațiile disponibile, RTX Spark ar urma să ajungă în produse ale mai multor producători de PC „în acest an”, în combinație cu Windows. Rămâne de văzut cât de repede se va traduce această extindere către PC-uri într-un aport material la venituri, în condițiile în care analiștii citați indică un orizont mai degrabă gradual. [...]

Vizita lui Jensen Huang în Coreea de Sud poate accelera parteneriatele Nvidia cu conglomeratele locale pe AI și robotică , într-un moment în care companiile asiatice își consolidează lanțurile de aprovizionare și capacitățile de „AI fizic” (integrarea AI în sisteme care acționează în lumea reală, precum roboții), potrivit IT之家 . Informația, atribuită de publicație unor surse din industrie citate de The Korea Times, indică faptul că fondatorul și CEO-ul Nvidia ar urma să ajungă la Seul joi seara, după participarea la Computex Taipei 2026 , iar vineri să înceapă o serie de întâlniri cu lideri ai unor grupuri sud-coreene. Cine ar urma să participe și cine lipsește Conform acelorași surse, la discuții sunt așteptați: președintele SK Group, Chey Tae-won; președintele LG Group, Koo Kwang-mo; fondatorul și președintele consiliului Naver, Lee Hae-jin; președintele executiv al Hyundai Motor Group, Chung Eui-sun (care ar „lua în calcul” participarea). În schimb, președintele Samsung Group, Lee Jae-yong, este așteptat să nu participe, din cauza programului de deplasări externe, potrivit informațiilor citate. Ce teme sunt vizate: dincolo de semiconductori Observatori din industrie citați în material anticipează că agenda nu se va limita la cooperarea pe semiconductori pentru AI, ci ar putea include și robotică și „AI fizic”. Dacă întâlnirile se concretizează, miza operațională este extinderea colaborărilor Nvidia către aplicații industriale și platforme care combină hardware, software și implementare în teren. Separat, o sursă menționează că Naver discută cu Nvidia o posibilă vizită a lui Jensen Huang luni, săptămâna viitoare, la a doua clădire de birouri a companiei. IT之家 amintește că, în martie, președinta AMD, Lisa Su, a vizitat aceeași locație și a semnat un acord de cooperare privind infrastructura AI. [...]

Anthropic a depus confidențial documentele pentru un IPO , o mișcare care poate accelera „fereastra” de listări din zona inteligenței artificiale și pune presiune pe rivali precum OpenAI , într-un moment în care piața americană arată din nou apetit pentru oferte publice. Informațiile apar în IT之家 , care citează un anunț publicat luni, ora locală, pe blogul oficial al companiei. Compania care dezvoltă Claude spune că a transmis către autoritatea americană de supraveghere a pieței de capital (SEC) un proiect de documentație pentru înregistrarea unei oferte publice inițiale (IPO), fără să stabilească deocamdată numărul de acțiuni sau prețul. Anthropic precizează că listarea depinde de condițiile de piață și de „factori complecși”, fără un calendar ferm. De ce contează: semnal de „dezgheț” pe piața IPO și test pentru evaluările din AI Depunerea „în secret” (confidențial) permite companiei să pregătească listarea fără să publice imediat date detaliate despre finanțe, riscuri și operațiuni. Dacă decide să meargă mai departe, Anthropic va trebui ulterior să depună formularul S‑1, cu dezvăluiri complete despre situația financiară, aspecte juridice, riscuri și structura acționariatului cu drepturi de vot. IT之家 plasează demersul într-un context de revenire a pieței IPO din SUA și notează că și SpaceX ar avansa în același ciclu, cu o țintă de evaluare de 2.000 de miliarde de dolari (aprox. 9.200 de miliarde de lei) și o intenție de a atrage peste 75 de miliarde de dolari (aprox. 345 de miliarde de lei). Evaluări și finanțare: Anthropic vine după o rundă majoră Cu mai puțin de o săptămână înainte de depunerea documentelor pentru IPO, Anthropic a încheiat o rundă H de finanțare de 65 de miliarde de dolari (aprox. 299 de miliarde de lei), care i-a ridicat evaluarea post-investiție la 965 de miliarde de dolari (aprox. 4.439 de miliarde de lei), potrivit sursei. Runda a fost condusă de un consorțiu de investitori, între care Altimeter Capital, Dragoneer, Greenoaks, Sequoia Capital, Capital Group, Coatue și D1 Capital Partners. Publicația notează că intrarea mai multor investitori ar fi fost alimentată de așteptarea unei listări apropiate. Presiune competitivă: OpenAI încă strânge capital și pregătește, la rândul ei, IPO În același timp, OpenAI continuă finanțările: în martie ar fi închis o rundă de 122 de miliarde de dolari (aprox. 561 de miliarde de lei), la o evaluare post-investiție de 852 de miliarde de dolari (aprox. 3.919 de miliarde de lei), și ar pregăti de asemenea un IPO, conform informațiilor din material. IT之家 concluzionează că intrarea simultană în „linia de start” a celor două laboratoare de top ar putea transforma perioada următoare într-un an puternic pentru listările din AI și, în același timp, într-un test al încrederii investitorilor în segmentul de inteligență artificială generativă. Venituri și produs: creștere accelerată, dar și riscuri operaționale Anthropic ar fi comunicat recent că a depășit un venit anualizat de 47 de miliarde de dolari (aprox. 216 miliarde de lei), față de 9 miliarde de dolari (aprox. 41 miliarde de lei) la final de 2025, potrivit sursei. Compania mizează pe extinderea comercială a modelului Mythos pentru a accelera creșterea. În același timp, accesul la Mythos ar fi fost ținut mult timp restricționat, pe fondul unor probleme de securitate: compania ar fi identificat „mii” de vulnerabilități software cu risc ridicat, care ar trebui remediate înainte de deschiderea completă. Separat, IT之家 menționează o relatare Bloomberg, care citează surse anonime, potrivit căreia Anthropic ar intenționa să ofere acces la Mythos către Agenția UE pentru Securitate Cibernetică (ENISA) . [...]

TSMC își integrează inteligența artificială NVIDIA în fabrici pentru a accelera proiectarea și producția de cipuri , într-o mișcare cu impact operațional direct asupra randamentului și timpilor de livrare din lanțul global de semiconductori, potrivit Android Headlines . Colaborarea vizează folosirea platformelor și instrumentelor NVIDIA pentru a automatiza și optimiza etape critice din fluxul de fabricație, într-un moment în care cererea pentru cipuri avansate (în special pentru aplicații de inteligență artificială) pune presiune pe capacitățile de producție și pe eficiența uzinelor. Ce se schimbă în operarea fabricilor TSMC Din informațiile prezentate, direcția principală este integrarea de soluții bazate pe IA în procesele de producție, cu scopul de a îmbunătăți modul în care sunt proiectate, testate și fabricate noile generații de siliciu. În termeni practici, asta înseamnă mai multă analiză automată a datelor din fabrică și decizii mai rapide în controlul proceselor. Pentru TSMC, miza este reducerea pierderilor și creșterea randamentului (proporția de cipuri conforme obținute dintr-un lot), dar și scurtarea ciclurilor de dezvoltare, într-o industrie în care fiecare lună câștigată poate însemna avantaj competitiv pentru clienți. De ce contează: capacitate, costuri și termene într-o piață tensionată Integrarea IA în fabrici nu este doar un exercițiu tehnologic, ci o încercare de a crește eficiența într-un sector cu investiții masive și cu constrângeri structurale: echipamente scumpe, procese extrem de complexe și cerere volatilă, dar ridicată pe segmentul de cipuri pentru centre de date și acceleratoare IA. Dacă abordarea funcționează la scară, efectul se poate vedea în: timpi mai buni de producție și livrare pentru cipuri avansate; utilizare mai eficientă a capacităților existente; presiune mai mică pe costurile asociate rebuturilor și recalibrărilor din fabricație. Ce urmează Materialul indică o direcție de consolidare a parteneriatelor dintre furnizorii de tehnologie IA și marii producători de semiconductori, pe fondul competiției pentru „următoarea generație” de cipuri. Detalii despre calendar, amploarea implementării sau rezultate măsurabile nu sunt prezentate în informațiile disponibile în sursă. [...]

NVIDIA pregătește intrarea în producție de masă cu „Vera”, un CPU proiectat special pentru agenți AI , o mișcare care poate schimba arhitectura standard a serverelor pentru inteligență artificială și, implicit, costurile și performanța infrastructurii din centrele de date, potrivit Android Headlines . Din informațiile prezentate, „Vera” este un procesor (CPU) gândit „de la zero” pentru a lucra cu sarcini specifice agenților AI – adică sisteme care nu doar răspund la comenzi, ci pot planifica și executa pași multipli pentru a atinge un obiectiv. Miza operațională este reducerea blocajelor dintre CPU și acceleratoarele AI (de regulă GPU), într-un moment în care companiile caută să scoată mai multă eficiență din fiecare rack de servere. De ce contează: NVIDIA vrea să controleze mai mult din „stiva” hardware pentru AI Până acum, în multe configurații de server, CPU-ul este furnizat de jucători consacrați, iar NVIDIA domină partea de accelerare cu GPU-uri. Un CPU proprietar orientat către agenți AI ar însemna o integrare mai strânsă între componente și o optimizare pentru fluxuri de lucru care devin tot mai frecvente în aplicațiile enterprise. În termeni practici, direcția indicată de această inițiativă este una de standardizare a platformelor AI în jurul ecosistemului NVIDIA, cu efecte potențiale asupra: modului în care sunt proiectate serverele pentru AI (alegeri de platformă, compatibilități); costului total de operare (prin eficiență mai bună sau, dimpotrivă, prin dependență mai mare de un singur furnizor); puterii de negociere în lanțul de aprovizionare pentru centrele de date. Ce se știe și ce rămâne neclar Materialul indică faptul că „Vera” ar urma să ajungă în producție de masă, însă detaliile tehnice și calendarul exact nu sunt prezentate în fragmentul de text disponibil în input. În lipsa acestor informații, rămâne de văzut: când începe efectiv producția și în ce volume; în ce sisteme va fi integrat CPU-ul și pentru ce clienți; ce câștiguri de performanță sau eficiență sunt vizate, comparativ cu platformele actuale. Pentru piață, semnalul principal este că NVIDIA își extinde ambiția dincolo de acceleratoare și încearcă să optimizeze „cap-coadă” hardware-ul pentru generația de aplicații bazate pe agenți AI, unde latența, coordonarea între componente și eficiența energetică devin criterii de diferențiere. [...]