Știri

Știri din categoria Inteligență artificială

Google pregătește o nouă categorie de laptopuri, Googlebook, construită în jurul Gemini și a integrării cu Android, cu funcții care mută asistența AI direct în interfața de lucru și promit o tranziție mai rapidă între aplicațiile de pe telefon și cele de pe laptop, potrivit Google Blog. Dispozitivele ar urma să ajungă pe piață „în această toamnă”, iar compania indică parteneriate hardware cu producători consacrați.

Unghiul principal al anunțului este unul operațional: Google încearcă să redefinească modul în care utilizatorii lucrează pe laptop, tratând „inteligența” (Gemini) ca element central al experienței, nu ca funcție adăugată ulterior. În același timp, Google poziționează Googlebook ca un produs care combină elemente din Android (aplicații și „tech stack”, adică baza tehnologică) și ChromeOS (browserul Chrome), pentru a accelera ritmul de inovare și a consolida ecosistemul multi-dispozitiv.

Google descrie două funcții-cheie care ar urma să diferențieze Googlebook:

O a doua direcție majoră este integrarea cu telefonul Android, cu accent pe continuitatea activității între dispozitive. Google susține că Googlebook este „în sync” cu telefonul și dă exemple de utilizare a aplicațiilor de pe telefon fără a părăsi ecranul laptopului.

Pe zona de fișiere, compania introduce Quick Access, o funcție care ar permite accesarea fișierelor de pe telefon direct din managerul de fișiere al laptopului, pentru vizualizare, căutare sau inserare, „fără transferuri”.

Google spune că lucrează cu Acer, ASUS, Dell, HP și Lenovo pentru primele dispozitive Googlebook și că acestea vor veni cu „hardware premium”, în mai multe formate și dimensiuni. Un element de design distinctiv menționat este „glowbar”, descris ca un detaliu vizual „funcțional și frumos”, care ar urma să identifice ușor categoria.

Compania indică faptul că va publica mai multe detalii înainte de lansare și trimite utilizatorii către googlebook.com pentru actualizări, fără să ofere în material prețuri, configurații sau piețe de disponibilitate.

Recomandate

Google împinge Gemini spre utilizare practică în educație, transformând fotografii cu notițe scrise de mână în ghiduri de învățare structurate , o funcție care poate reduce timpul de sinteză pentru elevi și studenți și mută aplicația mai aproape de un instrument operațional de lucru, nu doar de conversație, potrivit Google Blog . Materialul descrie un flux simplu: utilizatorul fotografiază fiecare pagină de notițe, încarcă imaginile în Gemini și folosește un îndemn (prompt) de tipul „Creează un ghid de studiu pe baza materialelor mele de curs pentru examene”. Dacă utilizatorul stăpânește deja partea introductivă, poate cere explicit să fie sărite noțiunile de bază și să se intre direct în subiecte mai complexe. Din perspectiva utilizării, Google indică faptul că Gemini poate „distila” notițele în: ghiduri de studiu; fișe de tip flashcards (cartonașe cu întrebări și răspunsuri); o organizare a materiei pe un semestru, pentru reluare ulterioară. De ce contează operațional Mesajul central este trecerea de la acumularea de pagini și informație greu de gestionat, la un rezumat structurat generat din conținutul propriu al utilizatorului. Pentru zona educațională, asta înseamnă că munca de „curățare” și reorganizare a notițelor poate fi parțial automatizată, iar interacțiunea cu aplicația se mută spre sarcini concrete (sinteză, structurare, recapitulare), nu doar întrebări punctuale. Google nu oferă în material detalii despre disponibilitate pe piețe, limitări tehnice, costuri sau condiții de acces, astfel că impactul exact (cât de larg poate fi folosit și în ce scenarii) rămâne neprecizat în sursa citată. [...]

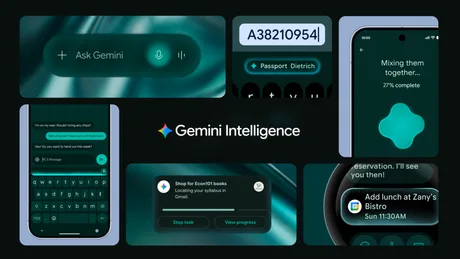

Google integrează automatizări cu Gemini direct în Android, mutând tot mai multe sarcini între aplicații către un „agent” AI , potrivit TechRadar . Noul pachet, numit „ Gemini Intelligence ”, este prezentat ca un sistem care reduce „fricțiunea” în utilizarea telefonului, preluând pași repetitivi precum completarea de formulare, rezumarea paginilor web sau construirea unui coș de cumpărături dintr-o fotografie. Miza operațională pentru utilizatori este trecerea de la comenzi punctuale către fluxuri de lucru (task-uri) pe mai mulți pași, în care Android ar urma să execute acțiuni în lanț în numele tău, cu confirmare finală înainte de a „apăsa” efectiv pe butonul de cumpărare/rezervare. Ce este „Gemini Intelligence” și de ce contează Conform publicației, Google combină Gemini (asistentul său AI) cu Android și Chrome, astfel încât telefonul să poată gestiona sarcini „plictisitoare” și repetitive: să înțeleagă contextul de pe ecran, să extragă informații din aplicații conectate și să automatizeze pași care, până acum, cereau comutări manuale între aplicații. Direcția este una „mai proactivă” pentru Android: multe funcții pornesc totuși de la un îndemn (prompt) al utilizatorului, dar obiectivul declarat este ca sistemul să ceară mai puțină intervenție manuală. Cele 7 funcții evidențiate de Google Automatizarea sarcinilor în mai mulți pași, între aplicații : exemplele includ găsirea unui document în Gmail, identificarea unor cărți necesare și adăugarea lor în coșul de cumpărături, sau rezervarea unei biciclete în față la un curs. Transformarea conținutului de pe ecran în acțiuni : Gemini poate porni de la capturi de ecran, fotografii sau conținut afișat. Un exemplu: dintr-o listă de cumpărături în Notes, să construiască automat un coș pentru livrare; altul: dintr-o broșură de călătorie fotografiată, să caute un tur similar pentru un grup de șase. Gemini în Chrome (Android) : „mai târziu anul acesta”, Gemini ar urma să rezume pagini, să compare informații între site-uri și să ajute la cercetare direct în browser. „Chrome auto browse” : o componentă din Chrome în care Gemini ar putea executa sarcini online de rutină „în locul tău”, precum programări sau rezervări (de exemplu, locuri de parcare). Autofill mai „inteligent” : completarea automată a formularelor ar urma să folosească informații relevante din aplicații conectate pentru formulare mai complicate. „Rambler” pentru dictare (voice-to-text) : o funcție care „curăță” dictarea, eliminând pauze, repetiții, corecții și cuvinte de umplutură (de tipul „ăă”), păstrând stilul utilizatorului; Google spune că suportă și conversații multilingve în același mesaj. „Create My Widget” : generarea de widgeturi (mini-aplicații) prin descriere în limbaj natural, fără programare; exemplul din material este un cronometru de tip countdown. Actualizări de interfață Material 3 Expressive : schimbări de design menite să facă sistemul „mai calm” și mai puțin distractiv, în timp ce Gemini rulează sarcini în fundal. Ce rămâne de văzut TechRadar notează că utilitatea reală va depinde de cât de fiabil funcționează Gemini în utilizarea de zi cu zi, în condițiile în care asistenții AI au promis de ani buni simplificarea vieții digitale, dar au fost limitați de comenzi stângace, suport redus între aplicații și erori când sarcinile devin mai complexe. Pentru moment, calendarul exact și disponibilitatea pe modele/versiuni Android nu sunt detaliate în textul sursă, cu excepția mențiunii că integrarea Gemini în Chrome pe Android începe „mai târziu anul acesta”. [...]

Google aduce automatizări „multi-step” și completare inteligentă în Android prin Gemini Intelligence , o schimbare cu impact operațional direct: telefonul preia sarcini repetitive între aplicații, dar numai la comandă și cu opțiuni explicite de control, potrivit Google Blog . Google poziționează Android „în tranziție” de la un sistem de operare la un „sistem de inteligență”, iar noutatea centrală este un set de funcții proactive bazate pe Gemini, gândite să economisească timp în activități de zi cu zi. Lansarea se face etapizat: funcțiile Gemini Intelligence „vor fi livrate în valuri” începând din această vară pe cele mai noi telefoane Samsung Galaxy și Google Pixel, urmând să ajungă „mai târziu în acest an” și pe alte dispozitive Android, inclusiv ceas, mașină, ochelari și laptopuri. Automatizare între aplicații, cu acțiuni la comandă Cea mai concretă schimbare anunțată este automatizarea sarcinilor cu mai mulți pași în aplicații. Google spune că a „rafinăt luni de zile” aceste capabilități pe Galaxy S26 și Pixel 10, în aplicații populare de livrare de mâncare și ridesharing, pentru ca interacțiunile să fie „fără fricțiuni”. Exemplele date includ situații în care Gemini: caută și execută pași pentru o acțiune (de pildă, găsirea unui loc „în față” la o clasă de spinning); extrage informații din aplicații conectate (de exemplu, găsește un syllabus în Gmail) și continuă fluxul (adaugă cărțile necesare în coș); folosește contextul de pe ecran sau din imagini pentru a transforma „contextul vizual” în acțiune (de exemplu, pornești Gemini peste o listă de cumpărături și ceri construirea unui coș pentru livrare); pornește de la o fotografie (de exemplu, o broșură) și caută o ofertă similară, cu urmărirea progresului prin notificări. Google insistă că utilizatorul rămâne în control: asistentul „acționează doar la comanda ta” și se oprește când sarcina e finalizată, rămânând doar confirmarea finală. Gemini în Chrome și completarea formularelor „dintr-un tap” Pe zona de navigare web, Google anunță „Gemini în Chrome” ca asistent de cercetare, rezumare și comparare a conținutului de pe web, cu disponibilitate „începând de la finalul lunii iunie” pe Android. Tot aici apare „Chrome auto browse”, care ar urma să preia sarcini precum programări sau rezervarea unui loc de parcare. Separat, „Autofill with Google” (completarea automată) este extinsă cu „Personal Intelligence” din Gemini, astfel încât Android să poată completa mai multe câmpuri mici în aplicații, inclusiv în Chrome, folosind informații relevante din aplicațiile conectate. Conectarea Gemini la Autofill este descrisă ca „strict opțională” (opt-in), cu posibilitatea de a activa/dezactiva din setări. Rambler în Gboard și widgeturi generate din limbaj natural Google introduce și „Rambler”, o funcție Gemini Intelligence în Gboard care transformă vorbirea „naturală” în mesaje mai concise și mai „profesionale”, eliminând repetiții și interjecții. Compania precizează că Rambler indică vizibil când este activat, iar audio este folosit doar pentru transcriere în timp real și „nu este stocat sau salvat”. Funcția este prezentată ca fiind construită pentru comunicare multilingvă, cu trecere între limbi în același mesaj. Pe personalizare, Google anunță „Create My Widget”, care permite crearea de widgeturi personalizate prin descriere în limbaj natural (de exemplu, un panou cu sugestii săptămânale de rețete sau un widget meteo axat pe anumiți indicatori). Funcția este descrisă ca disponibilă atât pe telefon, cât și pe ceasuri cu Wear OS. Ce urmează Calendarul comunicat este în două trepte: debut „în această vară” pe cele mai noi modele Samsung Galaxy și Google Pixel, apoi extindere „mai târziu în acest an” către restul ecosistemului Android (inclusiv dispozitive purtabile și auto). Google nu oferă în material o listă completă de țări, limbi sau modele eligibile dincolo de exemplele menționate, nici detalii despre condiții comerciale. [...]

Google alocă 10 milioane de dolari (aprox. 46 milioane lei) pentru cinci universități prin programul REPLIQA, o inițiativă care urmărește să aplice împreună știința cuantică și inteligența artificială în cercetarea din științele vieții, cu miza de a accelera instrumentele necesare viitoarelor descoperiri medicale, potrivit Google Blog . Programul se numește Research Program at the Intersection of Life Sciences & Quantum AI (REPLIQA) și este derulat de Google Quantum AI împreună cu Google.org . Obiectivul declarat este îmbunătățirea „rezultatelor pentru oameni”, prin dezvoltarea unor capabilități care să ajute la înțelegerea biologiei la nivel molecular. De ce contează: finanțare direcționată către „cercetare de bază”, nu rezultate rapide Google precizează că REPLIQA este un efort de cercetare fundamentală, ceea ce înseamnă că nu promite rezultate imediate. Accentul este pus pe construirea „uneltelor esențiale” — de la senzori cuantici la algoritmi de inteligență artificială îmbunătățiți cu tehnici cuantice — care ar putea face posibile, ulterior, progrese în domenii precum dezvoltarea de medicamente. Această poziționare e relevantă și economic: banii merg către infrastructură științifică și capacitate de cercetare în universități, într-o zonă în care aplicațiile comerciale sunt încă incerte și depind de maturizarea tehnologiei de calcul cuantic. Ce probleme vizează: simulări moleculare pe care calculatoarele clasice le gestionează greu Google argumentează că procese biologice precum plierea proteinelor sau reacția unei celule la un medicament implică interacțiuni atomice foarte complexe, dificil de simulat cu calculatoare „clasice” (convenționale). În schimb, tehnologiile cuantice operează pe baza aceleiași mecanici cuantice care guvernează moleculele, ceea ce ar putea face simulările mai eficiente pe termen lung. În exemplificările din material, compania menționează: utilizarea senzorilor cuantici pentru a observa procese biologice cu o precizie mai mare; rezultate experimentale recente care sugerează că „spinul cuantic” (o proprietate a particulelor subatomice) ar putea avea un rol în funcționarea celulelor; potențialul calculatoarelor cuantice de a accelera simulări ale interacțiunilor moleculare complexe, inclusiv în cazul enzimei P450, relevantă pentru dezvoltarea de medicamente. Cine primește finanțarea Cele cinci instituții academice menționate ca partenere în program sunt: Harvard University Massachusetts Institute of Technology (MIT) University of California San Diego University of California, Santa Barbara University of Arizona Google notează că aceste universități sunt deja active în zona de intersecție dintre știința cuantică și biologie. Ce urmează Compania indică faptul că, pe măsură ce tehnologia de calcul cuantic „se maturizează”, combinarea ei cu inteligența artificială și științele biologice ar putea deschide direcții noi de descoperire. În același timp, mesajul central rămâne unul de prudență: REPLIQA este construit ca un program de fundație, cu rezultate așteptate în timp, nu „peste noapte”. [...]

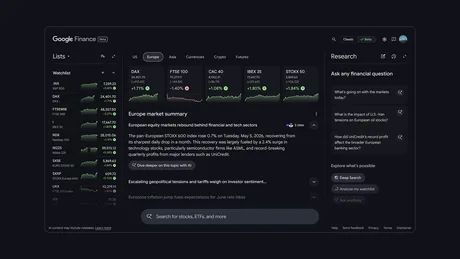

Google extinde în Europa o versiune de Google Finance cu funcții pe bază de inteligență artificială , mizând pe acces mai rapid la informații financiare și pe instrumente de analiză direct în produs, potrivit Google Blog . Lansarea are loc „săptămâna aceasta” și include suport complet pentru limbile locale, într-o versiune „reimaginată” a Google Finance, care adaugă capabilități orientate spre documentare, vizualizare și urmărirea evenimentelor de piață în timp real. Ce se schimbă pentru utilizatori și pentru fluxul de analiză Noul Google Finance introduce un set de funcții care mută o parte din munca de căutare și sinteză în interiorul platformei: Cercetare asistată de AI : utilizatorii pot întreba despre acțiuni individuale sau tendințe mai largi de piață și primesc un răspuns generat de AI, însoțit de linkuri pentru aprofundare. Pentru întrebări mai complexe, este disponibil „ Deep Search ”, menționat ca fiind acum disponibil global în Google Finance. Vizualizări avansate : instrumente noi de graficare permit afișarea unor indicatori tehnici (de exemplu, „moving average envelopes” – benzi construite în jurul unei medii mobile, folosite în analiza tehnică) și identificarea momentelor-cheie din grafice, cu explicații despre motivele mișcării de preț din ziua respectivă. Informații în timp real : un flux de știri refăcut și date extinse pentru mărfuri și criptomonede, pentru urmărirea piețelor pe măsură ce se mișcă. Rezultate financiare „live” : urmărirea teleconferințelor de raportare (earnings calls) cu audio live, transcrieri sincronizate și „insight-uri” generate de AI, inclusiv evidențieri adnotate. De ce contează: presiune pe viteza de documentare și pe instrumentele clasice Din perspectiva utilizării, extinderea în Europa cu suport local de limbă sugerează o încercare de a standardiza, la scară regională, un mod de lucru în care utilizatorul obține rapid o sinteză și apoi aprofundează prin surse linkuite, fără să iasă din produs. În același timp, integrarea transcrierilor și a „insight-urilor” pentru teleconferințe poate reduce timpul necesar pentru a parcurge integral apelurile cu investitorii, mai ales în zilele aglomerate de raportări. Google nu oferă în material o listă de țări, un calendar detaliat pe piețe sau indicatori de adopție; informațiile disponibile se limitează la faptul că lansarea are loc în Europa „săptămâna aceasta” și că include suport complet pentru limbile locale. [...]

Google testează în Gemini Live un selector de modele AI cu 7 variante , o schimbare care ar muta o parte din controlul experienței de conversație de la companie către utilizator, potrivit unei analize de tip teardown citate de Mobilissimo , realizată pe aplicația Google (versiunea 17.18.22), cu câteva zile înainte de Google I/O 2026. Miza operațională este semnificativă: până acum, Google ar fi gestionat automat ce model rulează în funcție de context sau de abonament, în timp ce noul mecanism ar permite alegerea manuală a modelului folosit în conversațiile din Gemini Live. Ce s-a găsit în aplicație și de ce contează În codul aplicației ar fi apărut un „selector intern” de modele AI, cu șapte opțiuni, unele orientate spre raționament avansat, altele spre personalizare. Google nu a confirmat public existența acestor modele, iar informația rămâne la nivel de indicii din aplicație, nu de anunț oficial. Separat, în aceeași zonă de funcții în lucru apare și un nou „Thinking Mode”, descris ca un mod în care modelul ar „gândi” mai mult înainte să răspundă, pentru rezultate mai detaliate. Mobilissimo notează că, potrivit unor informații publicate anterior de 9to5Google , acest mod ar extinde capabilitățile de „reasoning” (raționament) deja disponibile în Gemini 3 Pro. Funcții asociate: memorie, cameră și personalizare Tot din referințele identificate în aplicație sunt menționate mai multe direcții de dezvoltare pentru Gemini Live: memorie multimodală; gestionare mai bună a zgomotului ambiental; răspunsuri bazate pe ceea ce vede camera; personalizare folosind aplicațiile Google ale utilizatorului; funcții experimentale integrate în Gemini Live. Android Authority ar susține, de asemenea, că Google pregătește eliminarea unor opțiuni mai vechi de voce pentru Gemini, un indiciu că interfața și experiența de utilizare ar urma să fie redesenate. Context: Google I/O 2026, cu AI în prim-plan Google I/O 2026 este programat în perioada 19–20 mai, iar compania a confirmat că accentul principal va fi pe inteligența artificială. Invitațiile oficiale menționează „actualizări Gemini” și tehnologii de tip „agentic coding” (instrumente care pot executa pași de programare în mod semi-autonom). În paralel, în ultimele săptămâni au circulat zvonuri despre modele precum Gemini 3.5 Pro și Gemini 3.2 Flash, dar și despre alte produse/inițiative (inclusiv Aluminium OS, ochelari Android XR și funcții noi pentru Android 17). Mobilissimo mai notează și o posibilă reproiectare a interfeței Gemini, inclusiv eliminarea modului fullscreen din Gemini Live și integrarea unui model video cu numele intern „Omni”. Deocamdată, fără confirmare oficială din partea Google, rămâne de văzut dacă selectorul de modele și „Thinking Mode” vor fi anunțate la I/O și în ce formă vor ajunge la utilizatori. [...]