Știri

Știri din categoria Inteligență artificială

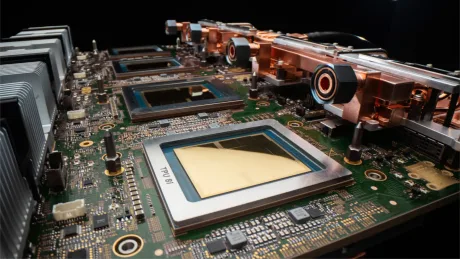

Cipurile TPU ale Google au ajuns la 121 exaflopși, o miză directă pentru costul și viteza rulării modelelor AI: potrivit Google Cloud, cea mai nouă generație de Tensor Processing Units (TPU) poate procesa 121 exaflopși putere de calcul și vine cu o lățime de bandă dublă față de generațiile anterioare, într-un moment în care sarcinile de lucru pentru inteligență artificială devin tot mai „grele”.

TPU-urile sunt cipuri specializate, proiectate „pentru un singur job”: efectuarea de calcule matematice la scară foarte mare, necesare pentru antrenarea și rularea modelelor AI. Google spune că le-a proiectat „de la zero” în urmă cu mai bine de un deceniu, tocmai pentru a rula astfel de modele.

În practică, creșterea de putere de calcul și de lățime de bandă are impact operațional: poate reduce timpii de procesare pentru sarcini AI și poate susține modele mai mari sau mai multe cereri simultane, în funcție de modul în care sunt folosite aceste resurse în infrastructură.

Google își poziționează TPU-urile ca infrastructură din spatele produselor sale de zi cu zi, subliniind că aceste cipuri sunt construite pentru a accelera calculele care stau la baza funcționării modelelor AI.

Din informațiile publicate, elementele tehnice punctuale sunt:

Materialul include și un video explicativ despre modul în care funcționează TPU-urile, fără alte detalii financiare sau de disponibilitate comercială în textul extras.

Recomandate

Parteneriatul Apple–Google intră în faza operațională: Siri va rula pe Gemini , iar mutarea poate schimba rapid capabilitățile „Apple Intelligence” încă din acest an, cu implicații directe asupra infrastructurii cloud folosite de Apple, potrivit GSMArena . Confirmarea vine de la Google, făcută pe scenă la conferința Cloud Next 2026 din Las Vegas. Thomas Kurian, șeful Google Cloud, a spus că Google colaborează cu Apple „ca furnizor cloud preferat” pentru a dezvolta „următoarea generație de Apple Foundation Models” bazate pe tehnologia Gemini, iar aceste modele „vor alimenta viitoare funcții Apple Intelligence, inclusiv un Siri mai personalizat, care va veni mai târziu în acest an”. Ce se știe despre calendar Informația completează confirmarea anterioară a Apple, care anunțase încă din ianuarie că modelele Gemini vor sta la baza următoarei evoluții Apple Intelligence. Potrivit publicației, Apple ar urma să prezinte noutățile în iunie, la Worldwide Developers Conference (WWDC) , iar lansarea către utilizatori este așteptată în toamnă, odată cu iOS 27 și iPadOS 27. De ce contează: unde va rula, de fapt, AI-ul Rămâne neclar dacă modelele Gemini folosite de Apple vor rula pe serverele Google sau prin Apple Private Cloud Compute (infrastructura proprie Apple pentru procesare în cloud cu accent pe confidențialitate). Această decizie are consecințe practice pentru: dependența operațională de un furnizor extern de cloud (Google) versus rulare în cloud-ul Apple; controlul asupra datelor și procesării , în funcție de arhitectura aleasă; viteza de livrare și scalarea funcțiilor de inteligență artificială în ecosistemul Apple. Context: Siri a fost întârziat din cauza acurateții Siri „revizuit” era inițial așteptat anul trecut, apoi a fost amânat pentru această primăvară, însă Apple ar fi întâmpinat probleme de acuratețe. Clarificările privind implementarea și detaliile tehnice sunt așteptate la începutul lui iunie, odată cu WWDC. [...]

Google își extinde oferta de infrastructură AI către un model „hibrid” (TPU propriu + GPU NVIDIA), prin AI Hypercomputer , o arhitectură de centru de date care combină TPU-uri de generația a 8-a, procesoare Axion și viitoarele acceleratoare NVIDIA Rubin, potrivit Wccftech . Miza operațională este flexibilitatea: clienții pot rula antrenare și inferență (execuția modelului în producție) pe hardware diferit, în același „pachet” de infrastructură, ceea ce poate reduce costul total de operare și timpul de implementare pentru proiecte AI la scară mare. Ce este AI Hypercomputer și de ce contează pentru clienți AI Hypercomputer este prezentat ca un ansamblu integrat de hardware (calcul, stocare, rețea) și software deschis (framework-uri și motoare de inferență), construit pentru „AI agentic” – sisteme care pot executa sarcini în lanț, cu un grad mai mare de autonomie, și care cer atât capacitate mare de antrenare, cât și latență redusă în producție. Din perspectiva utilizatorilor de cloud, elementul practic este că Google încearcă să ofere o infrastructură „cap-coadă” pentru AI, în care: TPU-urile proprii acoperă antrenarea și inferența pe platforma Google; GPU-urile NVIDIA rămân o opțiune majoră pentru clienții care preferă ecosistemul NVIDIA; rețeaua și stocarea sunt optimizate pentru a susține clustere foarte mari. TPU 8t și TPU 8i: două cipuri, două sarcini Google își împarte TPU-urile de generația a 8-a în două variante: TPU 8t (antrenare) : este descris ca un cip orientat spre antrenarea modelelor mari, cu o capacitate totală de calcul FP4 de 121 exaflopși per „pod” , menționată ca fiind de 2,84 ori peste Ironwood. Un „superpod” TPU 8t poate scala la 9.600 de cipuri și 2 PB (petabytes) de memorie partajată cu lățime mare de bandă. TPU 8i (inferință) : orientat spre rularea modelelor în producție, cu 288 GB HBM (memorie cu lățime mare de bandă) și 384 MB SRAM pe cip , adică o creștere de 3 ori față de generația anterioară. Pentru calcul, este indicată o capacitate FP8 de 331,8 exaflopși per pod , menționată ca fiind de 6,74 ori peste Ironwood. Publicația notează și îmbunătățiri „performanță per dolar” față de Ironwood („TPUv7”): 2,7 ori pentru TPU 8t în antrenare la scară mare și +80% pentru TPU 8i în inferență cu latență redusă (ținte MoE – „Mixture of Experts”, o arhitectură de model). Ambele ar livra și de două ori mai bună „performanță per watt”, relevantă pentru costul total de operare (TCO). Rețea, stocare și răcire: infrastructura din jurul cipurilor Pentru scalare, Google introduce Virgo Network , o rețea optimizată pentru AI, menită să conecteze atât sisteme NVIDIA Vera Rubin NVL72, cât și superpoduri TPU 8t în clustere foarte mari. Pe partea de stocare, sunt menționate: Managed Lustre cu 10 TB/s către A5X sau TPU 8t prin RDMA; Rapid Storage, cu un salt de la 6 TB/s la 15 TB/s . La nivel fizic, TPU-urile sunt proiectate să funcționeze cu răcire cu lichid de generația a 4-a , pentru densități de calcul care nu ar fi sustenabile cu răcire pe aer. Unde intră NVIDIA Rubin și Axion în ecuație Google afirmă că va fi „printre primii” furnizori care oferă NVIDIA Vera Rubin NVL72 , alături de instanțe bazate pe Blackwell și Hopper deja disponibile. În paralel, compania își împinge propriile procesoare Axion (Arm), inclusiv instanțele N4A, despre care sursa spune că ar livra 100% mai bun raport preț–performanță decât alternative x86 comparabile. Cine ar urma să folosească platforma Wccftech enumeră câțiva clienți pentru AI Hypercomputer, între care US DOE (Departamentul Energiei al SUA) , Boston Dynamics , Citadel Securities , Thinking Machine Labs și Axia Energy . Materialul nu oferă detalii despre dimensiunea contractelor sau calendarul implementărilor. [...]

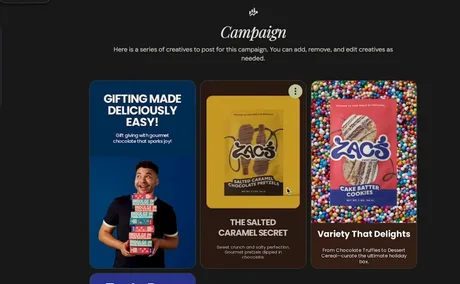

Google aduce în România Pomelli , un instrument cu inteligență artificială care poate reduce costurile și timpul de producție pentru materiale de marketing ale firmelor mici , prin generarea rapidă de imagini, clipuri video și propuneri de campanii, potrivit Paginademedia . Pomelli este un experiment dezvoltat de Google Labs în parteneriat cu Google DeepMind și este disponibil „din aceste zile” în România, dar și în Uniunea Europeană, Norvegia, Elveția și Marea Britanie. Instrumentul funcționează, deocamdată, în limba engleză. Cum funcționează Pomelli, în practică Platforma folosește AI pentru a „înțelege” o afacere și a genera conținut personalizat în trei pași: Analiză : scanează site-ul companiei pentru a identifica elemente precum comunicarea de brand, mesaje, fonturi și culori. Generare de propuneri : sugerează idei de conținut și campanii pe baza identității identificate; utilizatorul poate rafina rezultatele prin comenzi conversaționale. Creație : produce conținut pentru social media, site sau reclame (imagini și video), care poate fi editat sau descărcat direct, inclusiv pentru fotografii de produs ori „sesiuni foto” pentru produse și servicii. Limitări și ce înseamnă pentru utilizatorii din România În forma actuală, Pomelli generează imagini și clipuri video cu text în engleză, iar interacțiunea cu utilizatorul este tot în engleză. Platforma permite însă editarea textelor, astfel încât acestea pot fi modificate și adaptate în limba română. Instrumentul are și o versiune de mobil, conform aceleiași surse. [...]

Google mută masiv munca de programare către IA, iar inginerii ajung să supervizeze codul : în prezent, 75% din codul scris pentru propriile produse este generat de inteligența artificială, potrivit Profit . Schimbarea contează operațional pentru o companie care dezvoltă la scară globală, pentru că redefinește rolul echipelor tehnice și ritmul de livrare al produselor. În acest model, inginerii software care nu mai scriu efectiv cod au rolul de a superviza codul produs de IA, pe măsură ce tehnologia „devine din ce în ce mai bună la programare”, notează publicația. Un exemplu invocat de CEO-ul Google, Sundar Pichai , indică impactul asupra vitezei de execuție: o migrare de cod „deosebit de complexă”, realizată cu „agenți” (instrumente software bazate pe IA care execută sarcini) și ingineri lucrând împreună, ar fi fost finalizată de șase ori mai repede decât era posibil cu un an în urmă, când procesul se baza doar pe ingineri. „Recent, o migrare de cod deosebit de complexă, realizată de agenți și ingineri care au lucrat împreună, a fost finalizată de șase ori mai repede decât era posibil acum un an doar cu ingineri”, spune Sundar Pichai. Ce se schimbă în practică Din informațiile prezentate, tranziția are două efecte directe în organizație: o parte semnificativă din scrierea codului este transferată către IA (75% din total, conform Google); rolul inginerilor se mută spre control, verificare și coordonare a codului generat automat, nu doar spre implementare manuală. Articolul nu oferă detalii despre ce produse sau ce tipuri de proiecte sunt incluse în acest procent și nici despre modul în care Google măsoară „codul scris” de IA, astfel că amploarea exactă pe echipe și arii rămâne neprecizată în materialul citat. [...]

Google face disponibil „în producție” Gemini Embedding 2 , un model de „embedding” (reprezentări numerice folosite la căutare și potrivire semantică) care poate lucra nativ cu mai multe tipuri de date, potrivit Google Blog . Miza pentru companii și dezvoltatori este operațională: trecerea de la prototipuri la sisteme stabile, optimizate, care pot căuta și „raționa” peste text, imagini, video și audio fără lanțuri tehnice fragmentate. Disponibilitatea generală (general availability) înseamnă, în termeni practici, că Google consideră produsul suficient de matur pentru utilizare la scară largă, cu stabilitatea și optimizările necesare pentru implementări în medii de producție. Accesul se face prin Gemini API și prin Vertex AI, platforma Google pentru dezvoltarea și rularea aplicațiilor de inteligență artificială. Ce problemă încearcă să rezolve În perioada de previzualizare, utilizatorii au construit prototipuri precum motoare avansate de descoperire pentru comerț electronic și instrumente mai eficiente de analiză video, notează compania. Exemplele sunt relevante pentru că indică tipul de aplicații unde „embedding”-urile multimodale pot reduce complexitatea: în loc de fluxuri separate pentru text, imagine sau video, un singur sistem poate indexa și interoga mai multe formate. Google argumentează că această abordare răspunde unei nevoi tot mai frecvente în organizații: sisteme care pot face căutare și inferență peste date eterogene (text, imagine, video, audio), unde anterior era nevoie de „pipeline”-uri (lanțuri de procesare) complexe și fragmentate. Ce se schimbă pentru dezvoltatori și companii Odată cu trecerea la disponibilitate generală, Google poziționează Gemini Embedding 2 ca tehnologie pregătită pentru producție, cu accent pe: stabilitate pentru rulare în aplicații comerciale; optimizări pentru implementări la scară; integrare prin canale standard pentru clienți: Gemini API și Vertex AI. Compania mai precizează că modelul este parte dintr-o categorie de tehnologii care alimentează multe produse Google și că își propune să transfere aceste rezultate de cercetare către comunitatea de dezvoltatori. Ce urmează Materialul nu oferă detalii despre prețuri, niveluri de performanță sau limite tehnice, astfel că impactul financiar direct (costuri per apel, condiții comerciale) nu poate fi evaluat din această sursă. Din informațiile publicate, concluzia principală este că Google împinge explicit Gemini Embedding 2 din zona de test în zona de implementare operațională, prin canale enterprise (Vertex AI) și prin API-ul Gemini. [...]

Nothing mută dictarea cu AI la nivel de sistem pe telefoanele sale , o abordare care poate schimba modul în care utilizatorii folosesc transcrierea în aplicații, printr-o integrare directă în software-ul dispozitivului, nu doar ca aplicație separată, potrivit TechCrunch . Compania a lansat Essential Voice , un instrument care transformă vorbirea în text „formatat” în orice aplicație și elimină automat interjecții precum „um” și „ah”. Essential Voice este disponibil acum pe Nothing Phone (3), iar compania spune că urmează să fie extins pe Phone (4a) Pro mai târziu în această lună și pe Phone (4a) luna viitoare. Ce aduce Essential Voice, concret Instrumentul funcționează la nivel de sistem (adică poate fi folosit în diverse aplicații, fără a depinde de o aplicație dedicată) și include câteva funcții orientate spre productivitate: transcrierea vorbirii în text, cu editare automată pentru a elimina „cuvintele de umplutură”; „scurtături” vocale personalizate pentru cuvinte, linkuri, șabloane și expresii repetate (de exemplu, o comandă precum „adresa mea” poate insera adresa completă); traducere directă dintr-o limbă în alta; la lansare, Nothing afirmă că sunt suportate peste 100 de limbi. Accesul se face fie prin apăsarea tastei „Essential” (acolo unde există pe dispozitiv), fie prin activarea din tastatură. De ce contează: integrarea la nivel de sistem poate deveni noul standard TechCrunch notează că Nothing este printre primele companii care oferă o integrare de dictare la nivel de sistem. În același timp, publicația indică faptul că, după lansarea recentă de către Google a unei aplicații de dictare offline, este posibil ca mai multe companii să vină cu instrumente similare. Pe termen scurt, Nothing spune că va introduce și „stilizare” personalizată în funcție de aplicație, astfel încât utilizatorii să poată ajusta tonul editării AI în categorii precum „muncă” și „mesagerie” (funcție anunțată pentru viitor, fără un calendar detaliat în material). [...]