Știri

Știri din categoria Inteligență artificială

Google face disponibil „în producție” Gemini Embedding 2, un model de „embedding” (reprezentări numerice folosite la căutare și potrivire semantică) care poate lucra nativ cu mai multe tipuri de date, potrivit Google Blog. Miza pentru companii și dezvoltatori este operațională: trecerea de la prototipuri la sisteme stabile, optimizate, care pot căuta și „raționa” peste text, imagini, video și audio fără lanțuri tehnice fragmentate.

Disponibilitatea generală (general availability) înseamnă, în termeni practici, că Google consideră produsul suficient de matur pentru utilizare la scară largă, cu stabilitatea și optimizările necesare pentru implementări în medii de producție. Accesul se face prin Gemini API și prin Vertex AI, platforma Google pentru dezvoltarea și rularea aplicațiilor de inteligență artificială.

În perioada de previzualizare, utilizatorii au construit prototipuri precum motoare avansate de descoperire pentru comerț electronic și instrumente mai eficiente de analiză video, notează compania. Exemplele sunt relevante pentru că indică tipul de aplicații unde „embedding”-urile multimodale pot reduce complexitatea: în loc de fluxuri separate pentru text, imagine sau video, un singur sistem poate indexa și interoga mai multe formate.

Google argumentează că această abordare răspunde unei nevoi tot mai frecvente în organizații: sisteme care pot face căutare și inferență peste date eterogene (text, imagine, video, audio), unde anterior era nevoie de „pipeline”-uri (lanțuri de procesare) complexe și fragmentate.

Odată cu trecerea la disponibilitate generală, Google poziționează Gemini Embedding 2 ca tehnologie pregătită pentru producție, cu accent pe:

Compania mai precizează că modelul este parte dintr-o categorie de tehnologii care alimentează multe produse Google și că își propune să transfere aceste rezultate de cercetare către comunitatea de dezvoltatori.

Materialul nu oferă detalii despre prețuri, niveluri de performanță sau limite tehnice, astfel că impactul financiar direct (costuri per apel, condiții comerciale) nu poate fi evaluat din această sursă. Din informațiile publicate, concluzia principală este că Google împinge explicit Gemini Embedding 2 din zona de test în zona de implementare operațională, prin canale enterprise (Vertex AI) și prin API-ul Gemini.

Recomandate

Google își diversifică producția de cipuri pentru AI, reducând dependența de TSMC , printr-o comandă fermă către Intel pentru fabricarea a peste trei milioane de unități în 2028, potrivit The Next Web . Mișcarea vine pe fondul presiunii tot mai mari asupra capacităților TSMC, în special în zona de „advanced packaging” (împachetare avansată, adică integrarea cipului cu memoria), un blocaj care începe să schimbe strategiile de aprovizionare ale marilor cumpărători din AI. Informația, atribuită de publicație unui material The Information, indică faptul că Google a plasat comanda către Intel pentru producția de „tensor processing units” (TPU – acceleratoare dezvoltate intern pentru sarcini de inteligență artificială). În paralel, Nvidia testează tehnologiile Intel, inclusiv împachetarea avansată și procesul 18A, fără să fi luat încă o decizie de producție. Pe fondul știrii, acțiunile Intel au urcat cu aproximativ 12%. De ce contează: blocajele de capacitate la TSMC împing clienții spre „plan B” Miza nu este o schimbare de lider în industrie, ci reducerea riscului operațional într-un lanț de aprovizionare concentrat într-o singură țară și, practic, într-un singur furnizor pentru cele mai avansate cipuri AI. TSMC „se chinuie” să țină pasul cu cererea, iar presiunea este descrisă ca fiind cea mai severă în liniile de împachetare avansată, unde cipurile și memoria sunt „cusute” împreună pentru performanță. Pentru companiile care proiectează cipuri de top, această dependență devine o vulnerabilitate strategică, iar diversificarea furnizorilor începe să arate mai puțin ca o opțiune și mai mult ca o necesitate. Două strategii diferite: comandă fermă la Google, teste timpurii la Nvidia Publicația separă explicit cele două abordări: Google : comandă fermă către Intel pentru peste trei milioane de TPU în 2028 , după luni de testare a tehnologiilor de împachetare ale Intel. În context, este menționată și o estimare Morgan Stanley privind un „build-out” de peste șase milioane de TPU în 2027 și 2028 (estimare a băncii, nu cifră raportată de companie). Nvidia : nu a făcut un angajament , dar rulează teste timpurii, inclusiv „multiproject wafer runs” pe 18A, și verifică dacă Intel poate construi un procesor care combină patru cipuri grafice într-unul singur, design asociat arhitecturii Feynman, așteptată în 2028. Ce câștigă Intel și unde rămân semnele de întrebare Pentru Intel, interesul – chiar și prudent – este prezentat ca un prag important, în condițiile în care compania încearcă de ani să transforme divizia de producție pentru terți (foundry, adică fabricare la comandă) într-un rival credibil pentru TSMC, cu rezultate limitate și pierderi mari. Publicația amintește că Intel a încercat să atragă Apple ca client și că atât guvernul SUA, cât și Nvidia au luat participații în companie. Totuși, „fereastra” pe termen scurt pare să fie mai degrabă în împachetare decât în fabricația de vârf , unde Intel încă rămâne în urmă. Un punct critic rămâne dacă 18A poate egala TSMC la „yield” (randament – proporția de cipuri funcționale rezultate din producție), o problemă care a mai afectat Intel în trecut. În același timp, este menționat că SK Hynix ar testa compatibilitatea memoriei sale HBM (high-bandwidth memory) cu împachetarea Intel. Context: Google își întărește controlul asupra propriului „silicon” Comanda către Intel este prezentată și ca o continuare a strategiei Google de a-și controla infrastructura de cipuri: TPU-urile „se livrează acum în milioane”, iar compania și-a „împrăștiat” comenzile către mai mulți parteneri pentru a reduce dependența atât de Nvidia, cât și de TSMC. Adăugarea Intel este încă o măsură de acoperire. Concluzia implicită: TSMC nu este „detronată”, dar faptul că cei mai mari cumpărători din AI caută alternative arată că presiunea de capacitate și riscul de concentrare au devenit suficient de mari încât să redeseneze, treptat, harta furnizorilor. Pentru Intel, Google devine un client care validează – cel puțin parțial – ambiția de revenire. [...]

Google împinge cumpărăturile second-hand spre „căutare asistată de AI” , prin funcții din Search și Shopping care ajută utilizatorii să găsească produse similare, să compare prețuri și chiar să estimeze valoarea de revânzare, potrivit Google Blog . Miza practică este reducerea fricțiunii din piața de resale (revânzare) – de la descoperire și verificare, până la decizia de cumpărare sau vânzare. În contextul în care interesul de căutare pentru „vintage” și „how to thrift” a atins maxime istorice în 2026, Google își poziționează instrumentele ca „strat” de orientare pentru cumpărăturile de obiecte second-hand și vintage, inclusiv pentru căutări aflate în trend precum „vintage jersey” și „thrifted heels”. Ce se schimbă operațional pentru utilizatori: 5 funcții, un singur flux Google descrie cinci moduri prin care Search poate „ridica nivelul” cumpărăturilor de tip thrift/vintage, cu accent pe căutare vizuală și întrebări în limbaj natural: AI Mode în Search : utilizatorii pot formula întrebări detaliate pentru a-și planifica „ieșirea la thrift”, iar răspunsurile includ opțiuni și detalii relevante, plus linkuri pentru documentare. Exemplul din articol combină căutarea de „tricouri vintage” cu o condiție logistică (brunch fără gluten în apropiere). Google Lens pentru identificare și context : prin fotografierea unui obiect în magazin, Lens poate afișa potriviri vizuale și permite întrebări despre designer sau perioadă („din ce eră este?”). Tot aici apare componenta cu impact direct în tranzacție: utilizatorul poate vedea la ce preț se vinde online și câte oferte similare există, pentru a evalua dacă e „piesă rară” sau produs comun. Circle to Search (Android) : utilizatorul încercuiește un obiect văzut pe ecran, iar funcția caută rapid produse similare, prețuri și locuri de cumpărare; apoi pot urma întrebări de rafinare (de exemplu, stiluri cu „vibe” de anii ’90). Virtual Try-On : un „cabina de probă” digitală. Utilizatorul găsește un produs similar cu Lens, apasă „try it on” și încarcă o fotografie full-body pentru a vedea cum ar arăta purtat. Lens pentru vânzare din propria garderobă : Google sugerează folosirea Lens pentru a estima cât ar valora un obiect la revânzare și ce tip de magazine ar cumpăra astfel de produse („Could I resell this?”). De ce contează: mai multă transparență de preț și mai puține „achiziții la ghici” Din perspectiva pieței, setul de funcții descris de Google mută o parte din „munca” specifică second-hand (identificare, autentificare informală prin comparații, orientare de preț) în interfața de căutare. În practică, asta poate crește transparența pentru cumpărători și poate accelera decizia de achiziție sau revânzare, mai ales când utilizatorul compară rapid cu ofertele online. Google nu oferă în material date despre lansări pe piețe, disponibilitate în România sau rezultate măsurabile (de tip conversii ori economii), astfel că impactul concret depinde de accesul efectiv la aceste funcții și de cât de bine acoperă ofertele locale. [...]

Apple mută Siri în zona de asistent cu inteligență artificială integrată odată cu iOS 27 , prezentat la WWDC 2026 , potrivit CNET . Pentru utilizatori și pentru companiile care dezvoltă aplicații pe iPhone, miza este una operațională: dacă Siri devine mai „capabil” prin integrarea AI, interacțiunea cu telefonul și automatizările din aplicații ar putea fi redesenate în jurul comenzilor vocale și al funcțiilor asistate de AI. Informația centrală din material este că Apple a anunțat iOS 27 și a pus accent pe o versiune de Siri „integrată cu AI” (inteligență artificială), fără ca în textul furnizat aici să apară detalii tehnice despre cum funcționează, ce modele folosește sau ce limitări are. De ce contează: schimbare de utilizare, nu doar o actualizare de sistem O Siri cu AI integrat poate schimba modul în care utilizatorii execută sarcini uzuale (căutări, mesaje, setări, organizare), dar și felul în care aplicațiile pot fi controlate sau „orchestrate” prin comenzi. În practică, o astfel de mutare poate împinge ecosistemul iOS spre o utilizare mai puternic bazată pe asistenți, cu efect direct asupra: modului în care utilizatorii navighează și „cer” acțiuni pe telefon; priorităților de dezvoltare pentru aplicații (dacă Apple extinde integrarea Siri/AI la nivel de sistem); diferențierii comerciale a iPhone-ului într-o piață în care funcțiile AI au devenit un criteriu de cumpărare. Ce lipsește din informația disponibilă În fragmentul de conținut furnizat nu apar date despre calendarul de lansare, compatibilitatea pe modele de iPhone sau lista de funcții concrete din iOS 27 și din noul Siri. În lipsa acestor detalii, impactul exact (ce se schimbă efectiv pentru utilizatori și dezvoltatori, și când) rămâne de confirmat pe măsură ce Apple publică specificațiile complete ale actualizării. [...]

Administrația Trump vrea să accelereze adoptarea IA în armată, dar introduce și o frână contractuală importantă: furnizorii comerciali nu vor mai putea opri sau modifica unilateral sistemele pe care se bazează militarii , potrivit The Next Web . Măsura apare în NSPM-11 (National Security Presidential Memorandum 11) și schimbă direct relația operațională dintre stat și companiile care livrează modele și infrastructură de inteligență artificială. Ce schimbă NSPM-11 în achiziții și controlul asupra sistemelor Memorandumul semnat vineri înlocuiește NSM-25, cadrul stabilit în 2024 în administrația Biden pentru utilizarea IA în securitatea națională. Noul document cere armatei și agențiilor de informații să adopte mai rapid „frontier AI” (modele de vârf) și include o prevedere cu impact practic: niciun furnizor comercial nu poate „dezactiva, degrada sau modifica” un sistem de IA de care depind militarii americani fără aprobare prealabilă din partea guvernului. În paralel, NSPM-11 impune termene scurte pentru schimbări administrative: 120 de zile pentru ca agențiile să revizuiască și să actualizeze procesele de achiziții, astfel încât să poată integra rapid modele avansate de la mai mulți furnizori; 90 de zile pentru ca secretarul Apărării să actualizeze directiva care guvernează autonomia în sistemele de armament; emiterea, în 90 de zile , a unei anexe clasificate (conținut nepublic). Documentul cere și parteneriate „profunde, proactive” cu industria IA, inclusiv pentru instituții precum FBI, Office of the Director of National Intelligence și Office of the National Cyber Director. De ce contează: riscul de „dependență de furnizor” devine subiect de securitate națională Prevederea care blochează posibilitatea unui furnizor de a „trage ștecherul” (a opri sau altera serviciul) mută o problemă tipică din IT – dependența de furnizor și controlul asupra actualizărilor – în zona de securitate națională. În termeni operaționali, guvernul încearcă să reducă riscul ca un actor privat să poată afecta continuitatea unor capabilități critice în teren, fie din motive comerciale, fie din rațiuni tehnice sau juridice. În același timp, memorandumul recunoaște explicit că ritmul de dezvoltare al IA depășește capacitatea actuală a sistemelor de achiziții ale armatei și agențiilor de a integra tehnologia. Protecția modelelor: ținta sunt atacurile de „distilare” atribuite Chinei Pe componenta defensivă, NSPM-11 îi instruiește pe oficiali precum secretarul Apărării Pete Hegseth și șeful NSA, generalul Joshua Rudd, să lucreze cu „companii private dispuse” pentru a dezvolta protocoale care să protejeze modelele de vârf de tentative de furt sau replicare. Motivul invocat este riscul de atacuri de distilare – o tehnică prin care un actor poate reproduce comportamentul unui model printr-un volum foarte mare de interogări. Casa Albă descrisese în aprilie un astfel de scenariu, în care laboratoare chineze ar fi trimis milioane de solicitări către modele americane pentru a le replica capabilitățile. Presiune politică și un val de politici IA în aceeași săptămână Memorandumul vine într-o săptămână aglomerată de decizii și semnale pe zona IA: un ordin executiv „voluntar” privind evaluarea modelelor de frontieră și anunțul că Anthropic se pregătește să lanseze public modele „Mythos-class”. În Congres, senatoarea Elizabeth Warren cere audieri privind viteza cu care administrația împinge adoptarea IA fără garanții suficiente. Ea a solicitat audieri cu secretarul Comerțului Howard Lutnick și secretarul Trezoreriei Scott Bessent și a criticat prevederea „voluntară” din ordinul executiv, pe care o descrie ca un „bilet de trecere” pentru companiile de IA în detrimentul siguranței. Warren a ridicat și tema exporturilor de cipuri, invocând orientări ale Departamentului Comerțului pentru blocarea accesului companiilor chineze la cipuri avansate prin filiale din străinătate și susținând că regimul actual de control al exporturilor ar avea breșe. Ce urmează: termene scurte, dar multe necunoscute În următoarele luni, efectele concrete vor depinde de modul în care agențiile rescriu procedurile de achiziții și de cum va fi aplicată prevederea care limitează intervențiile furnizorilor asupra sistemelor. O parte relevantă a cadrului va rămâne însă opacă: memorandumul menționează o anexă clasificată care urmează să fie emisă în 90 de zile, iar conținutul ei nu este public. [...]

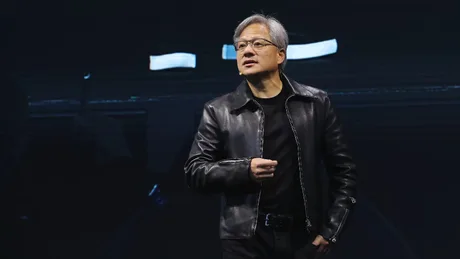

Nvidia își securizează pe termen lung memoria HBM4, o piesă critică pentru livrările de acceleratoare AI , printr-un acord multianual de co-dezvoltare cu SK Hynix , într-un moment în care memoria – nu GPU-urile – a devenit principala frână pentru extinderea infrastructurii AI, potrivit The Next Web . Acordul, anunțat duminică în timpul vizitei în Coreea de Sud a CEO-ului Nvidia, Jensen Huang, acoperă atât proiectarea, cât și fabricarea memoriei de nouă generație pentru AI, inclusiv HBM4 (memorie cu lățime mare de bandă, folosită în acceleratoare) pentru platforma Vera Rubin , care intră acum în producție la scară completă. De ce contează: memoria a devenit „gâtul de sticlă” al industriei AI Publicația notează că, pe fondul cererii explozive pentru infrastructură AI, constrângerea majoră s-a mutat de la procesoare grafice la memorie. CEO-ul Arm, Rene Haas, a spus recent că memoria este „probabil cea mai dificilă” problemă de rezolvat pentru industrie. Pentru Nvidia, miza acordului nu este doar să-și asigure livrări, ci să se asigure că această capacitate de producție va exista efectiv în anii următori, într-un context în care disponibilitatea HBM este așteptată să rămână limitată cel puțin până în 2028, iar unele prognoze împing presiunea până în 2030. Ce include acordul cu SK Hynix Parteneriatul depășește un contract tipic de furnizare: Nvidia și SK Hynix vor co-dezvolta memoria de generație următoare pentru ceea ce Nvidia numește „fabrici AI” – clustere mari de centre de date folosite pentru antrenare și inferență (rulare) a modelelor. Acordul vizează, potrivit articolului, și infrastructura și zona de „AI fizic” (aplicații AI integrate în roboți și sisteme industriale), dar componenta centrală rămâne memoria proiectată pentru Vera Rubin, descrisă ca cea mai puternică platformă de acceleratoare a Nvidia. Efectul competitiv: SK Hynix își consolidează poziția în HBM4 Jensen Huang a confirmat la Computex, în Taipei, că Samsung, SK Hynix și Micron au fost aprobate să furnizeze HBM4 pentru Vera Rubin. Totuși, acordul multianual de co-dezvoltare cu SK Hynix indică o relație mai profundă decât o simplă „calificare” de furnizor. Potrivit estimărilor citate de The Next Web, SK Hynix ar avea alocat aproximativ 60%–70% din volumul de HBM4 pentru Vera Rubin, Samsung circa 25%–30%, iar Micron restul. În această logică, angajamentele pe termen lung ar putea facilita extinderea capacității SK Hynix și întărirea cotei sale în timp. Context operațional: cerințe mari de memorie și ambalare avansată Vera Rubin este descrisă ca fiind construită în jurul unor clustere de procesoare Vera și nuclee grafice Rubin, „aliate” cu terabytes de HBM4 în fiecare sistem server. Publicația menționează și o constrângere tehnologică importantă: ambalarea avansată (în special procesul CoWoS al TSMC, care integrează GPU-urile cu HBM într-un singur pachet) este un factor-cheie care limitează ritmul livrărilor. Livrările pentru Vera Rubin sunt așteptate să înceapă în trimestrul al treilea din 2026, iar producția implică peste 350 de parteneri din lanțul de aprovizionare, în 30 de țări, conform articolului. „Împreună, vom co-dezvolta următoarea generație de memorie pentru fabricile AI și vom susține expansiunea globală accelerată a infrastructurii AI”, a declarat Jensen Huang, într-un comunicat citat de publicație. Ce urmează Semnalul principal al acordului este că Nvidia încearcă să-și „blindeze” din timp componenta cea mai rară din configurațiile sale de vârf – memoria HBM – pentru a putea susține ritmul de livrare al sistemelor din generația Vera Rubin. În paralel, competiția dintre SK Hynix, Samsung și Micron se mută tot mai mult pe capacitate și pe viteza cu care pot livra stive HBM mai avansate, într-o piață în care deficitul de memorie riscă să dicteze ritmul întregii industrii AI. [...]

Inteligența artificială a devenit în SUA principalul motiv invocat pentru concedieri , după ce angajatorii au atribuit tehnologiei 40% din cele 97.006 posturi desființate în luna mai, potrivit HotNews , care citează un raport Challenger, Gray & Christmas. Miza economică este că AI nu mai apare doar ca promisiune de productivitate, ci ca justificare operațională imediată pentru reducerea costurilor cu personalul. Raportul indică faptul că este cea mai mare rată lunară de când Challenger a început, în 2023, să urmărească impactul inteligenței artificiale asupra pierderilor de locuri de muncă. În total, în 2026, 87.714 concedieri au fost atribuite AI, peste nivelul de 54.836 raportat pentru 2025. „Datele noastre arată că firmele deja acționează în acest sens, invocând inteligența artificială mai mult decât orice alt motiv pentru a face mai multe reduceri”, a declarat Andy Challenger, director de venituri la Challenger, Gray & Christmas. Concedieri la cel mai ridicat nivel din 2020, cu tehnologia în frunte Per ansamblu, Challenger a constatat că în mai 2026 s-a înregistrat cel mai mare număr de concedieri din 2020, când au fost anunțate 397.016 concedieri în vârful pandemiei. Sectorul tehnologic rămâne domeniul cu cele mai multe concedieri, „cu o marjă mare”, potrivit raportului. Cât din „vina AI” este reală: contestări din industrie și din zona macro Atribuirea concedierilor către AI este contestată inclusiv de actori din ecosistemul tehnologic. CEO-ul OpenAI, Sam Altman , a spus recent că unele firme își „spală” concedierile dând vina pe tehnologie. Separat, economistul-șef al Apollo Global Management , Torsten Sløk, a scris că nu vede „nicio dovadă a pierderilor de locuri de muncă din cauza inteligenței artificiale”, invocând Raportul național privind ocuparea forței de muncă al ADP. Alte sectoare care au redus personal în mai Dincolo de AI, raportul notează tăieri și în alte industrii: Farmaceutice : 5.045 reduceri în mai; 12.485 în primele cinci luni din 2026 (în creștere cu 753% față de 1.463 până în mai 2025). Administrații federale/statale/locale : 4.499 reduceri în mai; 15.918 în 2026 (în scădere cu 94% față de 284.827 până în mai 2025, când au predominat reducerile legate de DOGE). Media : 436 reduceri în mai; 3.390 în 2026 (minus 17% față de 4.107 în primele cinci luni ale anului trecut). În paralel, până acum în 2026, cele mai frecvente motive invocate de angajatori pentru concedieri au fost „condițiile de piață și economice” (69.645), falimentele (66.733) și „restructurarea” (52.249), ceea ce sugerează că AI se suprapune peste un context mai larg de ajustare a costurilor. Pentru detalii, raportul Challenger este disponibil aici . [...]