Știri

Știri din categoria Inteligență artificială

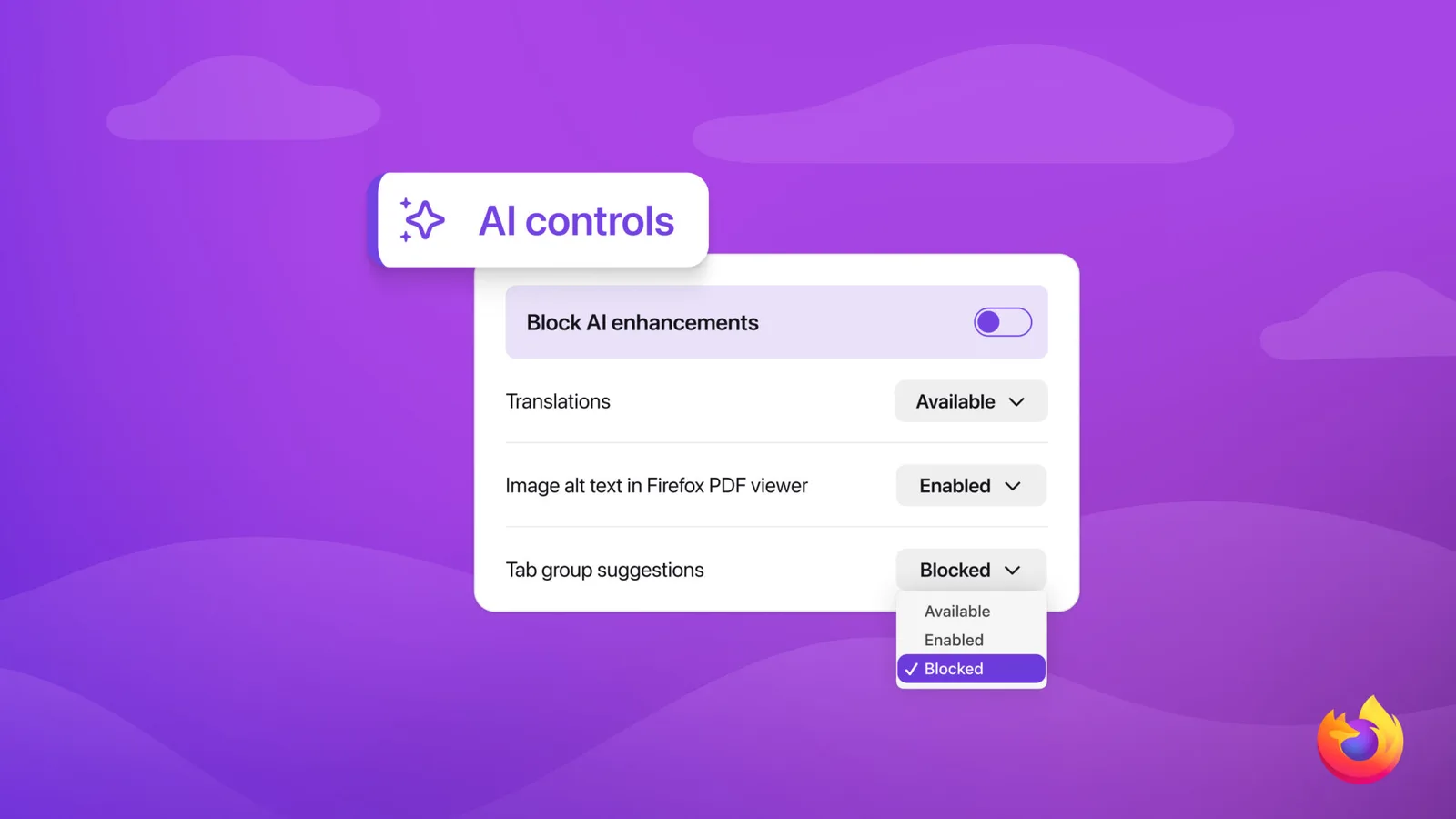

Firefox va introduce un comutator care dezactivează toate funcțiile bazate pe inteligență artificială, într-o mișcare menită să răspundă utilizatorilor care nu vor ca astfel de opțiuni să fie activate sau promovate în browser.

Decizia vine după ce Google și Microsoft au adăugat funcții cu inteligență artificială în Chrome și Edge, iar Firefox a urmat rapid direcția, oferind mai multe instrumente: un ajutor pentru gruparea filelor (taburilor), traducere asistată de inteligență artificială și acces rapid la un chatbot. În acest context, Mozilla pregătește un „kill switch” (comutator general) care va opri dintr-o singură setare toate funcțiile de acest tip.

Actualizarea care aduce comutatorul este programată pentru 24 februarie 2026, conform aceleiași surse. Directorul general al Mozilla, Enzor-DeMeo, a declarat că „alegerea contează” și că, în opinia sa, funcțiile cu inteligență artificială deja introduse în Firefox, precum și cele care urmează, sunt utile, iar utilizatorii pot avea încredere în Mozilla în privința datelor colectate. Totuși, compania va oferi explicit opțiunea de a opri complet aceste funcționalități.

Miza practică a comutatorului este una de control și încredere: o parte dintre utilizatori apreciază instrumentele noi, dar alții fie nu vor să le folosească deloc, fie invocă îngrijorări legate de confidențialitate. Printr-o setare unică de dezactivare, Mozilla încearcă să reducă fricțiunea pentru cei care vor un browser fără componente bazate pe inteligență artificială, fără să elimine opțiunile pentru cei care le consideră utile.

Recomandate

Mira Murati , fost CTO al OpenAI , a declarat sub jurământ că Sam Altman a mințit-o despre procedurile interne de siguranță , într-o mărturie prezentată în procesul „Musk v. Altman”, potrivit The Verge . Afirmația ridică miza de reglementare și de guvernanță corporativă în jurul OpenAI, într-un moment în care controalele de siguranță pentru modelele de inteligență artificială sunt tot mai des invocate ca argument pentru intervenție publică și reguli mai stricte. Într-o depoziție video difuzată în instanță, Murati a spus că Altman i-ar fi transmis în mod fals că departamentul juridic al OpenAI a decis că un nou model de inteligență artificială nu trebuie să treacă prin comitetul intern de siguranță pentru lansare (deployment safety board). Întrebată direct dacă Altman spunea adevărul, Murati a răspuns: „Nu”. Ce spune mărturia despre controlul intern al riscurilor Murati a descris episodul ca pe un exemplu al felului în care, în perioada în care a lucrat la OpenAI, Altman i-ar fi îngreunat activitatea. Critica ei ar fi „complet legată de management”, susținând că avea „o muncă incredibil de grea” într-o organizație complexă și că îi cerea lui Altman „să conducă, să conducă cu claritate” și să nu-i submineze capacitatea de a-și face treaba. În cazul concret al unui model din familia GPT, Murati a spus că, după discuția cu Altman, a verificat situația cu Jason Kwon (venit la OpenAI în 2021 ca director juridic și ajuns între timp director de strategie). Potrivit mărturiei, a constatat o „nepotrivire” între ce îi spusese Kwon și ce îi spusese Altman și, „pentru siguranță”, s-a asigurat că modelul a trecut totuși prin comitetul de siguranță. Context: acuzații mai vechi privind conduita lui Altman Materialul notează că nu este prima dată când Altman este acuzat că ar fi mințit. Cofondatorul Ilya Sutskever ar fi afirmat, într-un memoriu de 52 de pagini către board-ul OpenAI (citit într-o depoziție), că Altman „manifestă un tipar constant de minciună, subminare a executivilor și punerea executivilor unii împotriva altora”. De ce contează pentru piață și pentru reglementare Dincolo de disputa personală, mărturia lovește în credibilitatea mecanismelor interne prin care o companie de vârf din AI susține că își gestionează riscurile înainte de lansarea unor modele noi. Dacă deciziile privind trecerea prin filtrele de siguranță pot fi ocolite sau prezentate eronat în interior, presiunea pentru supraveghere externă și reguli mai stricte poate crește, inclusiv prin cerințe de audit și trasabilitate a deciziilor de lansare. Procesul „Musk v. Altman” este în desfășurare, iar informațiile provin din depoziții prezentate în instanță; articolul nu oferă, în acest fragment, poziția lui Altman sau a OpenAI la aceste afirmații. [...]

SpaceX își monetizează infrastructura de calcul AI printr-un acord care oferă Anthropic acces complet la centrul de date „Colossus 1”. Potrivit Mediafax , parteneriatul permite startup-ului american să folosească întreaga capacitate de procesare a facilității din Memphis, Tennessee, pentru a crește performanța asistenților Claude și pentru a depăși blocajele de capacitate generate de cererea în creștere. Acordul este relevant economic și operațional: pe de o parte, Anthropic își asigură accesul la resurse de calcul la scară mare, esențiale pentru antrenarea și rularea modelelor avansate; pe de altă parte, SpaceX își consolidează poziția în infrastructura AI ca linie de business, într-un moment în care compania caută să atragă investitori înaintea unui posibil IPO al diviziei sale AI, conform materialului. Ce câștigă Anthropic: capacitate pentru Claude Pro, Claude Max și Claude Code Anthropic va folosi capacitatea Colossus 1 pentru a îmbunătăți Claude Pro și Claude Max și pentru a reduce limitările apărute pe fondul cererii ridicate, în special pentru instrumentul de programare asistată de inteligență artificială Claude Code. În contextul competiției globale din AI, accesul la infrastructură devine un diferențiator practic, nu doar tehnologic. Ce livrează SpaceX: un centru de date cu peste 220.000 de procesoare Nvidia Colossus 1 este descris ca unul dintre cele mai mari centre de date dedicate inteligenței artificiale la nivel mondial. Facilitatea găzduiește peste 220.000 de procesoare Nvidia, inclusiv H100, H200 și acceleratoare GB200, utilizate pentru antrenarea și operarea modelelor AI de ultimă generație. Miza pe termen lung: centre de date „spațiale” și finanțare suplimentară Dincolo de utilizarea infrastructurii existente, Anthropic și-a exprimat interesul pentru dezvoltarea unor centre de date spațiale „de ordinul gigawaților”, un proiect considerat prioritar de Elon Musk . Ideea este ca astfel de facilități să fie amplasate în spațiu pentru energie solară continuă și costuri operaționale mai mici pe termen lung, însă proiectul este prezentat ca „extrem de costisitor” și unul dintre motivele pentru care SpaceX pregătește noi surse de finanțare și o posibilă listare publică. Extinderea spre companii: funcția „dreaming”, în test Parteneriatul a fost anunțat la un eveniment Anthropic în San Francisco, unde compania a prezentat și o funcție nouă pentru Claude AI, numită „dreaming”, disponibilă experimental. Aceasta ar permite agenților AI să își analizeze activitatea între sesiuni, să identifice tipare și să actualizeze automat fișiere cu preferințele utilizatorilor și alte informații relevante. În paralel, Anthropic încearcă să își întărească poziția pe segmentul corporate, într-o piață care pune presiune pe companiile tradiționale de software; startup-ul este susținut de Google și Amazon și a anunțat recent și agenți AI specializați pentru sectorul financiar, mai notează materialul. [...]

Europa și SUA ar trebui să-și coordoneze investițiile în infrastructura pentru inteligență artificială , în condițiile în care costurile estimate până în 2030 ajung la aproape 7 trilioane de dolari (aprox. 31,5 trilioane lei), iar competiția globală cu China se intensifică, a declarat vicepreședintele Parlamentului European , Victor Negrescu , potrivit Mediafax . Negrescu a susținut că Statele Unite „nu pot câștiga” cursa inteligenței artificiale fără un parteneriat solid cu Europa, argumentând că miza nu este doar tehnologică, ci și una de capacitate de finanțare și de construire a infrastructurii necesare. Infrastructura: SUA conduce, Europa urmează În intervenția sa la CNN, Negrescu a indicat dimensiunea actuală a infrastructurii de procesare (centre de date), esențială pentru dezvoltarea și rularea modelelor de inteligență artificială: SUA: aproximativ 4.000 de centre de date Europa: aproximativ 3.000 de centre de date Pe acest fundal, el a avertizat că, până în 2030, ar fi nevoie de investiții comune de aproape 7 trilioane de dolari (aprox. 31,5 trilioane lei), pe care le-a descris drept „sume uriașe de bani”. Lanțuri de aprovizionare și materii prime: apel la o politică comună Negrescu a pledat pentru reducerea competiției interne între aliați și pentru o abordare coordonată pe lanțul de aprovizionare, inclusiv printr-o politică comună privind „mineralele” și „materiile prime” necesare industriei. „De ce să concurăm unii împotriva altora? Trebuie să ne gândim cu adevărat la lanțul de aprovizionare, să ne asigurăm că avem și o politică comună în ceea ce privește mineralele, materiile prime.” Relația cu China: „strategie reală” înainte de discuții Oficialul european a mai spus că Occidentul ar trebui să-și alinieze poziția față de China, menționând că urmează o discuție între președintele SUA, Donald Trump, și președintele Chinei. În acest context, Negrescu a cerut ca statele occidentale să discute între ele înainte de interacțiunea cu Beijingul și să aibă „o strategie reală” privind transformarea prin inteligență artificială. [...]

Peste 600 de milioane de chinezi folosesc deja AI generativă , iar ritmul de adopție transformă China într-o piață-„laborator” care poate împinge înainte produse și modele de inteligență artificială prin testare la scară uriașă, potrivit G4Media . Datele citate de publicație indică o creștere de 142% față de anul anterior, ceea ce ridică miza competiției globale: nu doar cine are cel mai bun model, ci cine poate construi cel mai repede un ecosistem folosit zilnic. La mai bine de un an după ce startupul chinez DeepSeek a atras atenția internațională cu modele avansate, utilizarea aplicațiilor AI a intrat în rutina de zi cu zi, de la rezervări și cumpărături până la recrutare, sănătate și administrarea afacerilor, conform AP, citată de Mediafax. Adopție accelerată și integrare în platforme mari Potrivit Centrului de Informare privind Internetul din China, la finalul anului trecut peste 600 de milioane de chinezi utilizau aplicații de inteligență artificială generativă, în creștere cu 142% față de anul anterior. În paralel, AI este integrată în platforme populare precum WeChat , unde utilizatorii pot comanda mâncare, face plăți sau organiza călătorii cu ajutorul funcțiilor bazate pe inteligență artificială. În acest context, companii precum Tencent, Alibaba și Baidu investesc în integrarea AI în servicii, iar studenți și antreprenori folosesc instrumente pentru sarcini precum generarea de site-uri, clipuri video și administrarea conturilor de social media. De ce contează pentru piață: „testare în timp real” la scară națională În Beijing și Shenzhen, sute de persoane au participat la evenimente dedicate instalării și configurării unor asistenți AI, inclusiv OpenClaw, descris ca un sistem capabil să execute sarcini complexe și să automatizeze activități digitale. Un utilizator citat, Sun Lei, manager de resurse umane, spune că vrea să folosească AI pentru selecția și analiza CV-urilor, pe fondul temerii că ar putea rămâne în urmă tehnologic. Un element central al avantajului Chinei, potrivit experților citați, este viteza de adopție: Lizzi Lee, analist la Asia Society Policy Institute, afirmă că „competiția nu mai este doar între modele AI, ci între ecosisteme întregi”, iar utilizatorii chinezi ajung să funcționeze ca „testeri în timp real” pentru noile tehnologii. Presiunea restricțiilor SUA și reorientarea către soluții locale Materialul notează că SUA domină în continuare zona cipurilor avansate și a infrastructurii de calcul, însă restricțiile la export către China au avut și efecte secundare: companiile chineze au accelerat dezvoltarea propriilor soluții hardware și software. În acest context, DeepSeek a anunțat recent că noul său model AI utilizează parțial cipuri produse de Huawei, reducând dependența de producători americani precum NVIDIA. Totodată, un raport al Institutului pentru Inteligență Artificială Centrată pe Om al Stanford University arată că diferența dintre modelele AI dezvoltate în SUA și cele din China „s-a redus semnificativ”. Ce urmează Pe termen scurt, direcția indicată de articol este extinderea utilizării AI în servicii și în sectorul public, în linie cu planul național „AI Plus”, care vizează integrarea în domenii precum sănătatea, educația, justiția și industria. În unele instanțe din Shenzhen, instrumentele AI sunt deja folosite pentru analiza dosarelor și asistarea proceselor judiciare. [...]

Apple ar putea transforma Apple Intelligence într-o platformă cu mai mulți furnizori de modele AI , ceea ce ar schimba concret modul în care utilizatorii aleg și folosesc funcțiile de inteligență artificială pe iPhone, iPad și Mac, potrivit Mobilissimo . Informația vizează iOS 27 , iPadOS 27 și macOS 27, unde Apple ar urma să permită integrarea directă, la nivel de sistem, a unor modele AI dezvoltate de terți, nu doar a ChatGPT, singura opțiune „third-party” (de la un furnizor extern) integrată oficial până acum. Ce s-ar schimba pentru utilizatori: alegerea modelului AI din setări Potrivit articolului, noile integrări ar fi descrise drept „Extensions”, iar utilizatorii ar putea selecta modelul preferat direct din aplicația Settings, după instalarea unei aplicații compatibile din App Store. Miza operațională este că aceeași funcție din sistem ar putea rula pe modele diferite, în funcție de preferințe și de ce aplicații sunt instalate pe dispozitiv. Conform informațiilor citate de Mobilissimo din Bloomberg, Apple ar testa deja intern integrarea unor modele dezvoltate de Google și Anthropic. Funcțiile Apple Intelligence care ar putea fi influențate Dacă suportul pentru mai mulți furnizori ajunge în versiunea finală, schimbările ar putea afecta inclusiv funcții centrale ale Apple Intelligence, precum: Siri; Writing Tools (instrumente de redactare); Image Playground; alte funcții AI integrate în sistem. Un detaliu menționat este că Apple ar putea introduce voci diferite pentru Siri, în funcție de modelul AI folosit (de exemplu, o voce distinctă pentru modelul propriu Apple față de una asociată unui model extern). De ce contează: Apple acceptă un model „multi-IA” în ecosistem Mutarea ar sugera o schimbare de abordare: Apple ar accepta că ritmul de evoluție al AI este prea rapid pentru a rămâne limitată la propriile modele și ar încerca să transforme Apple Intelligence într-o „platformă” compatibilă cu mai mulți furnizori, în loc să mizeze pe o singură integrare externă. Deocamdată, nu există informații oficiale despre lista completă de modele compatibile sau despre condițiile pe care Apple le-ar putea impune dezvoltatorilor. Mobilissimo notează că, dacă funcția va fi inclusă în iOS 27, utilizatorii ar putea avea pentru prima dată control direct asupra modelului AI folosit în sistemul de operare. [...]

Google pregătește pentru macOS un agent Gemini care poate prelua controlul asupra computerului și automatiza organizarea fișierelor , o extindere cu impact operațional direct asupra modului în care utilizatorii își gestionează documentele și fluxurile de lucru în Google Workspace , potrivit 9to5Google . În prezent, aplicația Gemini pentru macOS are două funcții principale: o interfață nativă de chat (similară celei web) și o comandă rapidă „alt-space” care deschide Gemini din orice aplicație. Această a doua funcție permite și partajarea ferestrei curente cu Gemini, oferind asistentului context vizual despre sarcina în desfășurare. Ce ar urma să facă agentul: fișiere locale + integrare cu Workspace O analiză a echipei „APK Insight” a publicației indică faptul că Google plănuiește să extindă prezența Gemini pe Mac printr-un mod de utilizare „agentic” (adică un asistent care execută pași în numele utilizatorului), similar cu ceea ce oferă Claude Cowork. 9to5Google descrie patru exemple de comenzi (prompts) care conturează direcția produsului: Conversia fișierelor într-un tabel : scanarea unui folder local (de tip facturi sau rapoarte), extragerea datelor și structurarea lor într-un Google Sheet. Organizarea folderelor : identificarea fișierelor neorganizate din Desktop sau Downloads, gruparea lor după tip sau context și arhivarea „dezordinii”. Standardizarea fișierelor : citirea metadatelor și redenumirea în masă a unui număr mare de fișiere, cu rearanjare în subfoldere mai ușor de înțeles. „Închiderea buclei” după ultima ședință : preluarea celui mai recent transcript Meet sau a notițelor dintr-un document și redactarea unui e-mail de follow-up cu idei și acțiuni. Primele trei scenarii pun accent pe fișierele locale și pe transferul structurii rezultate în aplicații din Google Workspace, în timp ce al patrulea mută accentul spre aplicații Google precum Meet, Docs și Gmail. Cum ar funcționa tehnic: acces la ecran și funcții de accesibilitate Conform publicației, aceste capabilități ar urma să se bazeze pe „Screen Access” și pe funcțiile de accesibilitate din macOS, pentru ca Gemini să poată „vedea” ecranul și să controleze mouse-ul și tastatura. Practic, miza este automatizarea unor sarcini repetitive (organizare, redenumire, extragere de date) direct pe computer, nu doar răspunsuri în chat. De ce contează: productivitate și competiție directă cu Claude Din perspectiva utilizării, un astfel de agent ar transforma Gemini pe macOS dintr-o aplicație de conversație într-un instrument de execuție a sarcinilor, cu efect imediat asupra productivității, mai ales în organizații care folosesc intens Google Workspace. 9to5Google notează și un contrast cu Android: pe telefoane, doar un subset redus de dispozitive (exemplul dat este seria Galaxy S26) poate cere lui Gemini să automatizeze sarcini simple în aplicații, precum comandarea de mâncare. Pe Mac, ambiția pare mai mare, iar Google ar urmări să poziționeze Gemini ca rival direct pentru Claude Cowork, pe fondul experimentelor anterioare cu zona de „computer use” din previzualizarea Gemini 2.5. [...]