Știri

Știri din categoria Inteligență artificială

Apple a dezvoltat un sistem de inteligență artificială care poate recunoaște gesturi ale mâinii chiar și fără exemple anterioare, folosind semnale musculare colectate de senzori purtabili, potrivit unui studiu publicat de companie.

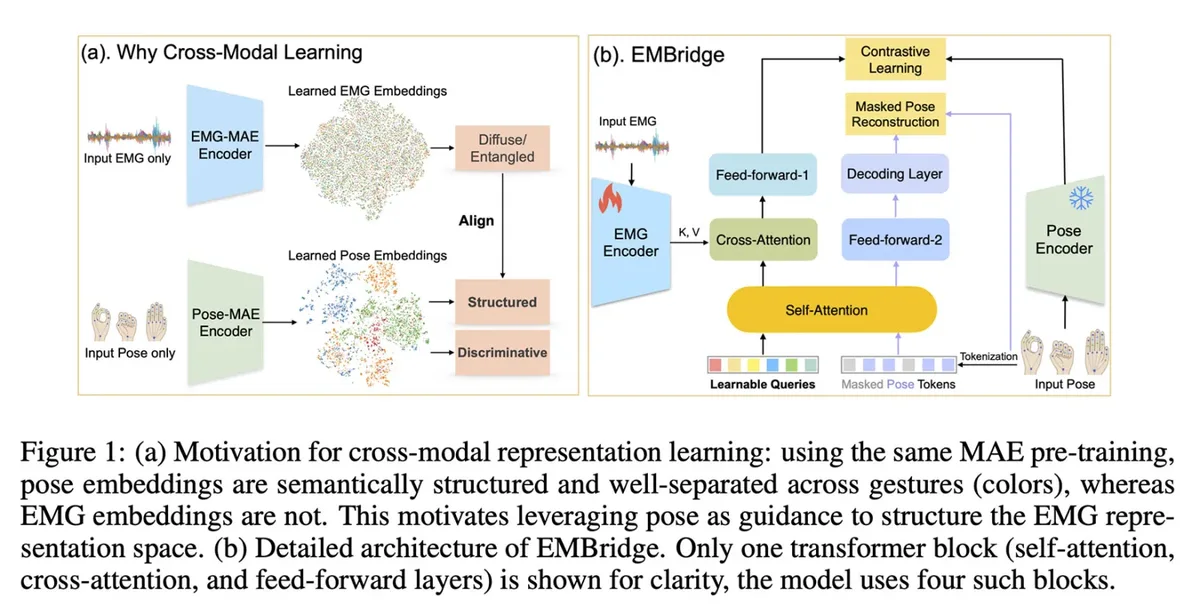

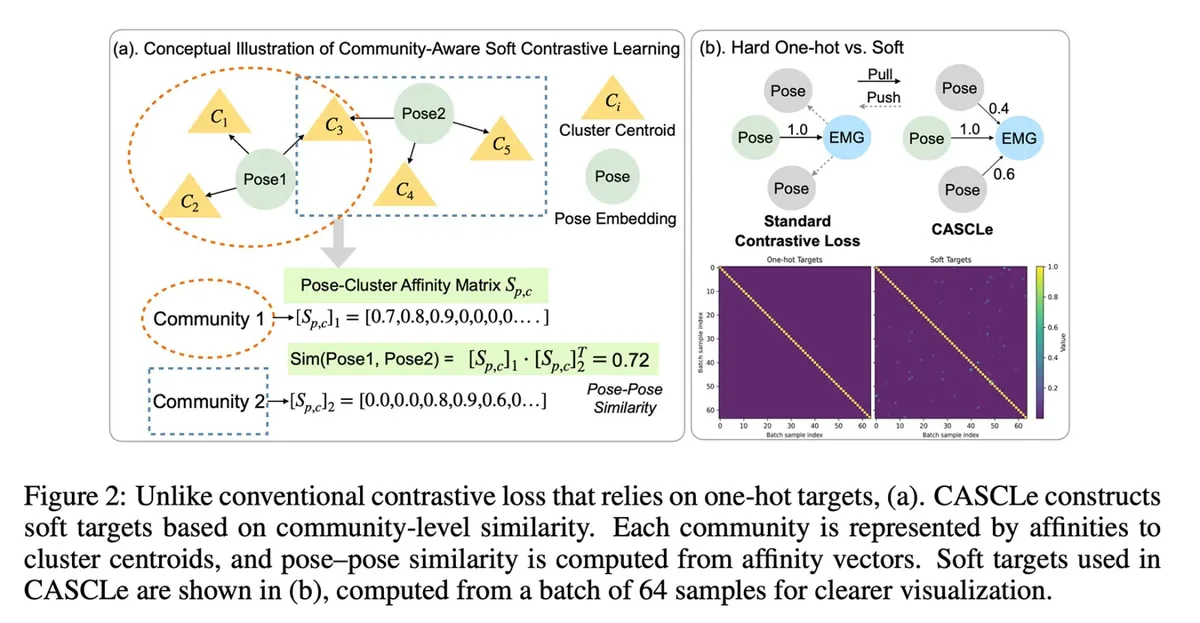

Cercetarea, prezentată pe blogul Apple Machine Learning Research și programată pentru conferința ICLR 2026, introduce un model numit EMBridge, capabil să identifice mișcări ale mâinii pe baza semnalelor electromiografice (EMG). Aceste semnale reprezintă activitatea electrică generată de mușchi în timpul contracției.

Sistemul folosește senzori care detectează semnale EMG și le corelează cu poziția reală a mâinii pentru a învăța tipare de mișcare.

Principalele etape ale procesului:

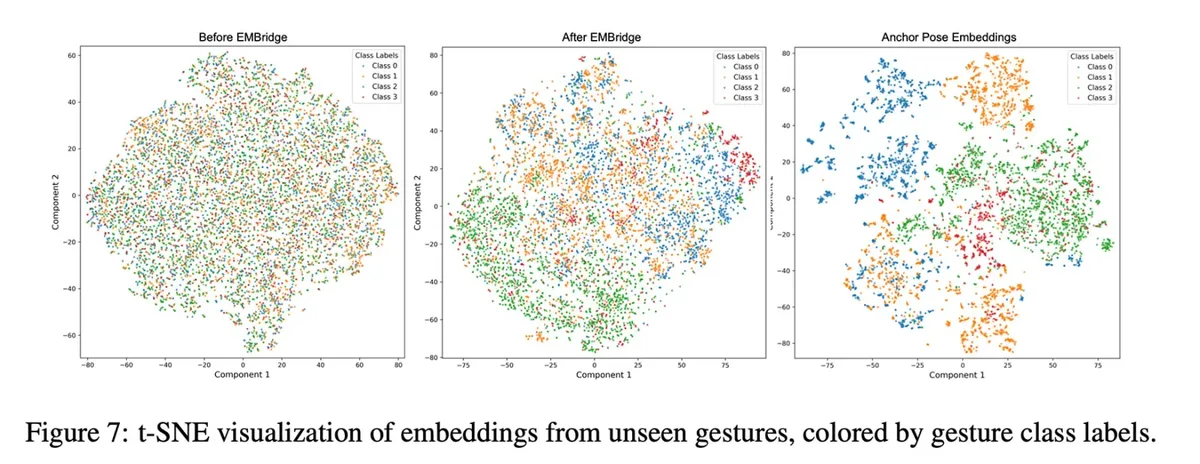

În testele realizate pe două seturi mari de date – emg2pose și NinaPro – sistemul a depășit performanța altor metode existente, reușind să identifice gesturi necunoscute chiar și cu aproximativ 40% din datele de antrenare.

Deși studiul nu confirmă produse viitoare, cercetătorii sugerează că tehnologia ar putea fi utilizată în dispozitive purtabile pentru controlul altor gadgeturi.

Printre scenariile posibile:

Tehnologia ar putea funcționa printr-un dispozitiv purtat la încheietură care interpretează semnalele musculare ale mâinii și le transformă în comenzi digitale.

Controlul dispozitivelor prin semnale musculare devine tot mai explorat în domeniul realității augmentate și al tehnologiei purtabile. Companii precum Meta testează deja concepte similare, folosind brățări capabile să interpreteze semnale neuronale pentru controlul dispozitivelor inteligente.

Potrivit cercetătorilor Apple, astfel de sisteme ar putea deschide noi metode de interacțiune cu tehnologia, mai intuitive și mai accesibile.

Recomandate

Google Translate adaugă o funcție „Practice” cu inteligență artificială care îți corectează pronunția , un pas care mută aplicația din zona de traducere rapidă spre antrenament de vorbire și poate crește timpul petrecut în ecosistemul Google, potrivit Android Headlines . Noua opțiune „Practice” este gândită ca un instrument de exersare: utilizatorul rostește cuvinte sau expresii, iar sistemul folosește inteligența artificială pentru a identifica unde pronunția diferă de forma așteptată și pentru a ajuta la corectare. Din informațiile disponibile în material, accentul este pe feedback-ul de pronunție, nu pe traducere în sine. Ce se schimbă, practic, pentru utilizatori Funcția adaugă un flux de utilizare diferit față de „ascultă și repetă” din traducătoarele clasice, printr-o componentă de evaluare automată a vorbirii. Pe scurt, „Practice” urmărește să transforme Google Translate într-un instrument de învățare mai activ, nu doar într-un dicționar cu redare audio. De ce contează operațional pentru Google Integrarea unei funcții de exersare a pronunției în Translate poate însemna: utilizare mai frecventă a aplicației în contexte de învățare (nu doar „la nevoie”); o poziționare mai directă în zona aplicațiilor de învățare a limbilor, unde diferențiatorul este feedback-ul personalizat; o extindere a rolului inteligenței artificiale în aplicații de masă, cu interacțiuni vocale și evaluare în timp real. Materialul nu oferă detalii despre disponibilitate pe piețe, limbi suportate, calendar de lansare sau condiții comerciale (gratuit/abonament), astfel că impactul exact asupra utilizării și monetizării rămâne deocamdată neclar. [...]

Google ar putea direcționa până la 40 mld. dolari (aprox. 184 mld. lei) către Anthropic , o companie de inteligență artificială care concurează direct cu propriile sale eforturi, într-o mișcare ce sugerează o strategie de „acoperire a pariurilor” într-o piață în care accesul la modele performante și la capacitate de calcul devine un avantaj economic major, potrivit Android Headlines . Suma menționată în material este prezentată ca un plafon („până la”), ceea ce indică faptul că nu este vorba neapărat de o singură tranzacție imediată, ci de un angajament investițional care poate fi etapizat sau condiționat. În lipsa unor detalii suplimentare în textul disponibil, nu reiese structura exactă a finanțării și nici calendarul. De ce contează: investiție într-un „rival” ca instrument de poziționare Unghiul economic al știrii ține de modul în care un jucător dominant își gestionează riscul și influența într-un sector cu costuri foarte mari. O investiție de asemenea dimensiune într-un concurent direct poate funcționa ca: o modalitate de a păstra accesul la tehnologie și talent, chiar dacă direcțiile interne nu livrează cel mai rapid; un pariu pe mai multe „platforme” de modele, într-o piață în care câștigătorul nu este încă stabilit; o consolidare a poziției în ecosistemul de inteligență artificială, prin finanțarea unor actori cheie. Ce se vede în piață: competiția se mută și în zona capitalului Materialul indică faptul că rivalitatea în inteligența artificială nu se joacă doar la nivel de produse, ci și la nivel de finanțare: cine poate susține costurile de dezvoltare și operare ale modelelor are un avantaj structural. În acest context, faptul că Google ar finanța masiv un competitor direct arată presiunea de a rămâne conectat la cele mai competitive modele, indiferent de „sigla” de pe produs. Ce urmează În forma prezentată de sursă, informația rămâne la nivelul intenției/posibilității („până la 40 de miliarde de dolari”), fără detalii despre termeni, condiții sau aprobări. Relevanța practică va depinde de confirmarea oficială a sumei, de structura investiției și de modul în care aceasta se traduce în acces la tehnologie sau în parteneriate comerciale între cele două companii. [...]

Peste 70% dintre soluțiile AI din companii scapă controlului intern, generând riscuri și costuri suplimentare , potrivit , un studiu Lenovo care evidențiază o problemă tot mai vizibilă în organizațiile moderne: utilizarea „din umbră” a inteligenței artificiale. Deși adopția AI crește accelerat, mecanismele de control, securitate și guvernanță nu țin pasul, ceea ce creează vulnerabilități și afectează direct eficiența investițiilor. Raportul, bazat pe un sondaj realizat în rândul a 6.000 de angajați la nivel global, arată că peste 70% folosesc AI săptămânal , iar până la o treime o fac fără implicarea departamentului IT. Această utilizare neautorizată extinde suprafața de atac și crește riscul expunerii datelor sensibile. În paralel, 61% dintre liderii IT observă o creștere a amenințărilor cibernetice asociate AI, însă doar 31% spun că sunt pregătiți să le gestioneze. Efectele directe asupra companiilor: investiții în AI cu recuperare întârziată (ROI mai lent) costuri duble din cauza utilizării mai multor instrumente similare lipsă de vizibilitate asupra modului în care este folosită AI dificultăți în extinderea soluțiilor la nivelul întregii organizații În plus, apare un dezechilibru intern: unii angajați folosesc instrumente AI securizate, în timp ce alții recurg la soluții improvizate, ceea ce duce la procese ineficiente și decizii fragmentate. Lenovo susține că problema nu ține de lipsa tehnologiei, ci de modul în care aceasta este implementată. Compania propune o abordare integrată, în care controlul AI începe de la nivelul dispozitivelor și este gestionat unitar, prin servicii de securitate și administrare continuă. Scopul este reducerea complexității și eliminarea breșelor dintre infrastructură, dispozitive și protecția datelor. Concluzia raportului este clară: fără un control coerent, inteligența artificială riscă să devină o sursă de costuri și vulnerabilități, nu un avantaj competitiv. În schimb, organizațiile care reușesc să gestioneze unitar implementarea pot transforma AI într-un instrument scalabil, cu beneficii reale și măsurabile. [...]

În procesul cu Sam Altman , Elon Musk își construiește apărarea pe ideea că miza OpenAI este „salvarea umanității” , încercând să influențeze percepția juriului asupra intențiilor sale și, implicit, asupra legitimității pretențiilor din dosar, potrivit The Verge . În depoziția sa, Musk a petrecut mult timp cu propria „poveste de origine”, de la copilăria în Africa de Sud și plecarea la studii în Canada, până la parcursul antreprenorial (Zip2, PayPal și companiile pe care le conduce în prezent). Publicația notează că această abordare pare menită să îl prezinte drept un actor motivat de interesul public, nu de câștig personal. Musk a susținut în fața instanței că proiectele sale au avut ca fir roșu „bunăstarea umanității”: SpaceX ar fi fost creată ca „asigurare de viață pentru viața așa cum o știm”, iar Tesla – pentru a reduce dependența de combustibili fosili, pe care a spus că o consideră dăunătoare pentru mediu și pentru oameni. The Verge menționează și că, în timpul mărturiei, Musk a afirmat în mod discutabil că el a fondat Tesla. AI, între promisiune și risc existențial În aceeași logică, Musk a spus că încă din anii de facultate era îngrijorat de inteligența artificială, pe care a descris-o ca pe o „sabie cu două tăișuri”: ar putea „rezolva toate bolile și face pe toată lumea prosperă” sau „ne-ar putea omorî pe toți”. A prezentat două scenarii extreme – unul utopic, de tip „Star Trek”, și unul distopic, de tip „Terminator” – și a indicat că acesta ar fi fost motivul pentru care a cofondat OpenAI. Atacul la Altman și argumentul „precedentului” pentru organizații caritabile Musk a încercat să creeze un contrast direct cu Altman, pe care l-a portretizat drept opusul său. A mers până la a-l acuza că ar fi „furat” o organizație caritabilă și a susținut că un verdict favorabil pârâților ar putea crea un precedent juridic periculos pentru sectorul filantropic din SUA. „E foarte simplu: nu e în regulă să furi o organizație caritabilă. (...) Dacă verdictul iese astfel încât să fie în regulă să jefuiești o organizație caritabilă, întreaga fundație a donațiilor caritabile în America va fi distrusă.” În același context, The Verge notează că Musk nu le-a spus juraților că majoritatea donațiilor filantropice ale fundației sale au mers către interese strâns legate, sau direct legate, de propriile sale activități. Din informațiile publicate nu reiese ce urmează procedural în proces sau care este calendarul etapelor următoare; materialul se concentrează pe strategia de poziționare a lui Musk în fața juriului și pe implicațiile pe care el le invocă în legătură cu statutul și controlul asupra OpenAI. [...]

Comisia Europeană cere ca Android să deschidă accesul la funcții-cheie pentru asistenți AI rivali , într-un demers care poate obliga Google să trateze egal serviciile terțe față de Gemini, în baza regulilor din Digital Markets Act (DMA), potrivit GSMArena . Android este desemnat „gatekeeper” (platformă cu rol de intermediar major) în DMA, ceea ce implică obligația de a oferi acces egal la funcții esențiale ale telefoanelor și tabletelor pentru companii terțe. Comisia Europeană consideră însă că Alphabet (Google) nu a făcut suficient și a păstrat unele funcții legate de inteligența artificială exclusiv pentru propria platformă Gemini. În acest context, Comisia a propus modificări și a lansat o consultare publică . Ce vrea Comisia să se schimbe pe Android Discuția se concentrează pe trei teme principale: posibilitatea utilizatorilor de a apela servicii AI prin „cuvinte de trezire” (wake words); capacitatea serviciilor AI de a interacționa eficient cu aplicațiile utilizatorului, pentru a înțelege contextul și a executa sarcini în numele acestuia; accesul la resursele hardware și software necesare, astfel încât serviciile AI să fie fiabile și rapide. Exemplele invocate: butonul de pe bara de navigare și „Hey Google” În detaliu, Comisia a analizat funcția de apăsare lungă pe scurtătura din bara de navigare, care declanșează Gemini, îi oferă date de context și îi permite să suprapună informații pe ecran. În mod obișnuit, această acțiune este asociată cu „Circle to Search” și, potrivit Comisiei, „nu este disponibilă în mod egal pentru dezvoltatorii terți”. Un alt punct este detectarea permanentă a cuvântului de trezire, asociată cu „Hey Google”. Comisia vrea ca Android să permită dezvoltatorilor de aplicații terțe să își poată adăuga propriile wake words. Separat, Comisia indică și limitări privind accesul la datele aplicațiilor (în special cele stocate doar pe dispozitiv): acestea pot fi accesate doar prin permisiunea AppSearch, care este atribuită doar asistentului implicit și nu poate fi acordată asistenților terți. Documentele Comisiei (inclusiv un rezumat de caz în format PDF) acoperă și zone precum sugestii proactive, inteligență bazată pe context și date ambientale. Reacția Google: costuri mai mari și riscuri pentru confidențialitate Într-un e-mail către Reuters , consilierul senior pe concurență al Alphabet a criticat inițiativa, susținând că: „Această intervenție nejustificată ar elimina autonomia, ar impune acces la hardware sensibil și permisiuni ale dispozitivului; crescând inutil costurile și subminând protecții critice de confidențialitate și securitate pentru utilizatorii europeni.” Context: precedentul Apple GSMArena amintește că Apple a fost vizată anterior pentru păstrarea unor funcții doar pentru propriile servicii (de exemplu, accesul exclusiv al Apple Pay la cipul NFC din iPhone), care ulterior a fost deschis către servicii terțe, deși „elvețienii încă au îngrijorări”. Pentru piață, miza imediată este dacă și în ce formă Android va trebui să permită asistenților AI concurenți să folosească aceleași „puncte de intrare” și aceleași resurse ca Gemini, ceea ce ar putea schimba competiția pe zona de asistenți digitali și integrarea lor în sistemul de operare. [...]

Apple Music spune că peste o treime din muzica trimisă pe platformă este 100% generată de AI , un volum care pune presiune pe filtrarea conținutului și pe mecanismele antifraudă din streaming, potrivit G4Media . Declarația îi aparține lui Oliver Schusser , vicepreședinte Apple Music, care a spus pentru Billboard că „mai mult de o treime” din ceea ce primește Apple Music „astăzi” este „100% AI”. În același timp, el susține că acest val ajunge la un procent foarte mic din consumul efectiv: sub 0,5% din utilizare, „rotunjind”, conform aceleiași intervenții. Ce schimbă pentru operarea platformei: identificare și etichetare a conținutului Schusser afirmă că Apple a dezvoltat intern o tehnologie care ar permite companiei să vadă „exact ce muzică” este livrată, „ce model AI este” și alte detalii, făcând trimitere, cel mai probabil, la așa-numitele „Transparency Tags” (un sistem de metadate care ar indica dacă o piesă este generată sau asistată de AI). Apple ar fi trimis din martie o scrisoare către partenerii din industrie în care își prezintă planul de a introduce aceste „Transparency Tags”, menite să semnaleze muzica generată de AI și cea asistată de AI. Sistemul ar permite caselor de discuri și distribuitorilor să declare utilizarea AI la trimiterea pieselor către Apple Music; opțiunea este descrisă ca fiind voluntară, însă Schusser spune că are „cu adevărat nevoie” ca furnizorii de conținut și casele de discuri „să își asume responsabilitatea”. Miza economică: frauda și penalizările care afectează plățile Pe lângă filtrarea conținutului, Apple Music leagă fenomenul AI de fraudă și de modul în care sunt distribuiți banii. Schusser spune că Apple a introdus o penalizare pentru fraudă acum patru ani, iar dacă platforma „prinde pe cineva”, „ia efectiv banii și îi pune înapoi în fondul comun”. Compania ar fi dublat penalizarea „începând din acest an”. „Trebuie să monitorizăm muzica AI, pentru că există o corelație între AI și fraudă.” Tot el afirmă că Apple a observat o „reducere de 60%” a încărcărilor frauduloase după introducerea penalizării. Context în industrie: Deezer și Spotify, măsuri diferite În material este menționat și Deezer, care ar fi anunțat „chiar săptămâna trecută” că aproape jumătate din muzica nouă trimisă pe platformă este generată de AI, decizie urmată de oprirea oferirii versiunilor „hi-res” pentru aceste piese. Tot ca reper de industrie, Spotify este descris ca fiind criticat pentru găzduirea de conținut AI de slabă calitate și ca lucrând la protejarea utilizatorilor, inclusiv prin eliminarea a 25 de milioane de piese generate de AI în ultimele 12 luni, potrivit textului citat de G4Media. Ce urmează Din informațiile prezentate, direcția Apple este combinarea etichetării (prin metadate de tip „Transparency Tags”) cu întărirea măsurilor antifraudă, pe fondul creșterii rapide a volumului de conținut generat integral de AI trimis către platformă. Limitarea importantă: Apple nu indică în material un calendar de implementare sau dacă etichetarea va deveni obligatorie. [...]