Știri

Știri din categoria Inteligență artificială

YouTube a interzis canalul pro-Iran „Explosive Media”, invocând încălcări legate de practici înșelătoare, într-un nou semnal că platformele mari înăspresc controlul asupra propagandei realizate cu animații generate de inteligență artificială, potrivit The Jerusalem Post.

Un purtător de cuvânt al YouTube a declarat pentru AFP că platforma a „închis” canalul pentru încălcarea politicilor privind „spam, practici înșelătoare și escrocherii”. Înainte de eliminare, canalul fusese suspendat inițial pe 27 martie, conform aceleiași declarații.

„Explosive Media”, care se descria drept independent, este „suspectat pe scară largă” de legături cu guvernul Iranului, notează AFP, citată de publicație. Canalul a câștigat vizibilitate în timpul „Operation Roaring Lion”, prin videoclipuri pro-Iran realizate în stil LEGO cu ajutorul AI, care au strâns milioane de vizualizări.

În paralel, presa americană a relatat miercuri că grupul ar fi fost eliminat și de pe Instagram, însă, potrivit AFP, rămâne activ pe alte platforme, inclusiv X (fostul Twitter) și Telegram.

Materialul mai arată că Iranul a folosit și anterior astfel de imagini generate cu AI. Agenția Tasnim, afiliată Corpului Gardienilor Revoluției Islamice (IRGC), a distribuit pe 10 martie un videoclip de propagandă în stil LEGO, în care dădea vina pe Israel și SUA pentru un atac asupra unei școli de fete din Minab (Iran), pe 28 februarie, despre care susținea că a ucis 168 de persoane.

Potrivit watermark-ului menționat în articol, videoclipul ar fi fost generat de institutul de stat Revayat-e Fath.

Un reprezentant al „Explosive Media” a spus într-un interviu BBC din 11 aprilie că guvernul iranian a fost „client” al grupului, dar a negat că echipa ar fi fost angajată de regimul de la Teheran. Reprezentantul, identificat doar ca „Mr. Explosive”, a afirmat că echipa are sub 10 oameni și că a ales estetica LEGO deoarece ar fi „un limbaj universal”.

Publicația mai notează că această metodă ar fi facilitat redistribuirea conținutului de către diverse țări, inclusiv de media de stat iraniene și ruse, pe X.

Potrivit articolului, videoclipurile de propagandă produse de grup au inclus „inexactități factuale”, precum:

Publicația nu oferă detalii suplimentare despre durata interdicției sau despre eventuale contestații ale deciziei YouTube.

Recomandate

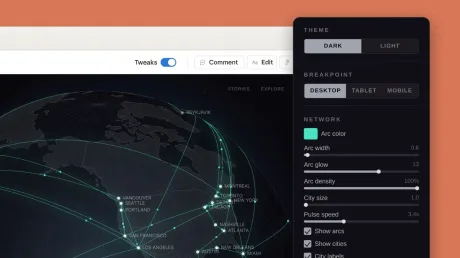

Anthropic își extinde Claude spre zona de design, iar accesul este legat direct de abonamentele plătite : noul instrument Claude Design, bazat pe modelul Claude Opus 4.7 , este lansat ca „unealtă de creație vizuală” și este disponibil treptat pentru utilizatorii Claude Pro, Max, Team și Enterprise, potrivit IT之家 . Claude Design este gândit să transforme, prin conversație, idei în designuri, prototipuri și prezentări, cu accent pe două categorii de utilizatori: designeri (pentru explorare mai rapidă) și persoane fără pregătire de design – precum product manageri sau fondatori – care ar putea produce în „câteva minute” materiale vizuale utilizabile. Ce schimbă operațional: de la „prompt” la prototip editabil și exportabil Instrumentul pornește de la descrieri în limbaj natural pentru a genera o primă versiune de design, apoi permite rafinarea rezultatului prin mai multe mecanisme: ajustări prin dialog; comentarii „în linie” (direct pe elemente); editare directă; glisoare personalizate pentru reglaje fine. După finalizare, rezultatele pot fi exportate în formate și platforme uzuale: Canva, PDF, PPTX sau fișier HTML independent. Alternativ, proiectul poate fi „împachetat” și predat către Claude Code pentru a intra în fluxul de dezvoltare. Integrare cu materiale existente și consistență de brand Claude Design acceptă import din mai multe surse și formate: texte (inclusiv prompturi), imagini și documente DOCX/PPTX. Pentru a menține consistența între prototip și produsul real, instrumentul poate „prelua” (scrape) elemente din pagini web. Un element central este „sistemul de brand” integrat: acesta poate citi codul din depozitul (codebase) companiei și fișierele de design, aplicând automat reguli unitare de culori, fonturi și componente. Exemple de utilizare și un indicator de productivitate IT之家 notează că instrumentul acoperă scenarii precum transformarea modelelor statice în prototipuri interactive, realizarea rapidă de wireframe-uri (schițe de structură pentru interfețe), generarea de prezentări pentru finanțare și materiale de marketing. Ca exemplu de eficiență, publicația menționează un test în care echipa Brilliant ar fi avut nevoie de „peste 20” de iterații de prompturi într-un alt instrument pentru a finaliza o pagină complexă, în timp ce în Claude Design ar fi fost suficiente 2 prompturi. (Detalii suplimentare despre metodologia testului nu sunt oferite în material.) [...]

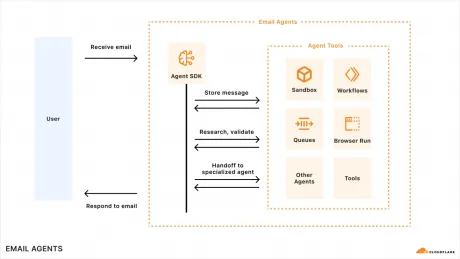

Cloudflare a deschis testarea publică a unui serviciu de e-mail care le dă agenților AI capacitatea nativă de a trimite și primi mesaje , o mutare care poate simplifica integrarea e-mailului în aplicații automatizate și reduce efortul operațional pentru dezvoltatori, potrivit IT之家 . Serviciul include funcții de trimitere și rutare a e-mailurilor și promite configurare automată pentru înregistrări de autentificare precum SPF și DKIM (mecanisme care ajută la verificarea expeditorului și la livrarea în inbox, nu în spam). Dezvoltatorii pot trimite e-mailuri fie prin legături native în Workers (platforma de rulare a codului la marginea rețelei Cloudflare), fie printr-un API REST (interfață web standard pentru apeluri între sisteme). Ce se schimbă operațional pentru dezvoltatori Cloudflare susține că, în Workers, trimiterea se face prin „binding” nativ, fără administrarea cheilor API sau a perechilor de chei. Alternativ, serviciul poate fi apelat prin SDK-uri (biblioteci software) pentru TypeScript și Python, folosind API-ul REST. Platforma configurează automat și DMARC, pe lângă SPF și DKIM, pentru a crește șansele ca mesajele să treacă verificările de autentificare și să fie livrate corect. Cloudflare leagă și performanța de propria rețea globală, menționând livrare cu latență redusă la nivel internațional. De ce contează pentru „agenții” AI Agents SDK adaugă o funcție „onEmail”, prin care agentul poate primi e-mailuri și poate răspunde asincron folosind noua funcție de trimitere. Diferența față de un chatbot, conform descrierii, este că un agent bazat pe e-mail poate lucra ore întregi la o sarcină (de exemplu, procesare de date sau coordonare între sisteme) și poate reveni ulterior cu un răspuns sau cu pași de urmat. Fiecare agent are o identitate separată, iar un mecanism de „rezolvare a adreselor” poate direcționa e-mailuri cu prefixe diferite către instanțe diferite ale agentului. Integrare și aplicație de referință Cloudflare descrie mai multe opțiuni de integrare: printr-un server MCP, care permite apelarea interfeței de e-mail prin instrucțiuni în limbaj natural; prin Wrangler CLI, pentru a reduce consumul de „token-uri” (unități de text procesate de modele) asociat definirii instrumentelor, astfel încât agentul să poată trimite e-mailuri cu un cost de context aproape nul; printr-un proiect open-source numit Skills, cu ghiduri de configurare și bune practici pentru aplicații de producție. Pentru a demonstra capabilitățile, compania a publicat și o aplicație de referință open-source, „Agentic Inbox”, care combină rutarea și trimiterea e-mailurilor cu clasificare AI, stocare de atașamente și logică de agent, inclusiv suport pentru fire de conversație și răspunsuri automate. [...]

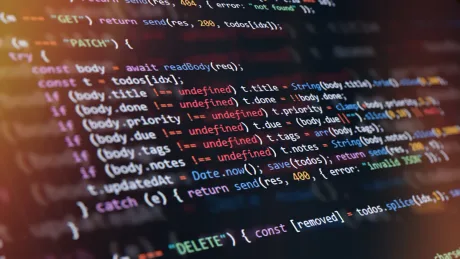

„Tokenmaxxing” riscă să umfle costurile fără câștiguri proporționale de productivitate , pe măsură ce tot mai multe echipe de software tratează bugetele mari de „tokeni” (consum de procesare pentru instrumente AI) ca pe un indicator de performanță, potrivit unei analize TechCrunch . Ideea centrală este că măsurarea „inputului” (câți tokeni consumă un dezvoltator sau cât cod generează cu ajutorul AI) poate înlocui greșit măsurarea „outputului” (calitatea și durabilitatea codului livrat). În practică, companiile care urmăresc productivitatea inginerilor observă că volumul de cod acceptat crește, dar și nevoia de a reveni ulterior pentru corecții și rescrieri — ceea ce erodează beneficiul inițial. De ce contează pentru companii: costuri mai mari, valoare incertă TechCrunch descrie apariția unei „insigne de onoare” în rândul dezvoltatorilor din Silicon Valley: bugete „enorme” de tokeni, adică limita de procesare AI pe care o pot consuma. Problema, în logica articolului, este că acest tip de metrică încurajează consumul de resurse, nu eficiența. Datele invocate din zona companiilor de analiză a productivității sugerează un tipar: se scrie mai mult cod, însă o parte disproporționată „nu rămâne” (este modificată sau ștearsă ulterior), ceea ce înseamnă timp suplimentar de revizie și acumulare de datorie tehnică (muncă viitoare generată de soluții rapide sau imperfecte). Ce arată datele: „churn” mai mare și randament care nu scalează În analiza TechCrunch, mai multe platforme de „engineering intelligence” (instrumente care măsoară activitatea și fluxurile de lucru din dezvoltare) raportează creșteri puternice ale așa-numitului „code churn” — diferența dintre liniile de cod adăugate și cele șterse, un indicator al rescrierilor. Pe scurt, exemplele citate în articol includ: Waydev : CEO-ul și fondatorul Alex Circei spune că managerii văd rate de acceptare a codului AI de 80%–90%, dar „churn”-ul din săptămânile următoare ar coborî acceptarea „reală” la 10%–30% din codul generat. Waydev lucrează cu 50 de clienți care au împreună peste 10.000 de ingineri software, potrivit articolului. GitClear: un raport din ianuarie a constatat că utilizatorii frecvenți de AI au avut, în medie, un „code churn” de 9,4 ori mai mare decât cei care nu folosesc AI în mod regulat, depășind de peste două ori câștigurile de productivitate raportate. Faros AI: într-un raport din martie 2026, pe baza a doi ani de date de la clienți, „code churn” ar fi crescut cu 861% în condiții de adopție ridicată a AI. Jellyfish: analizând 7.548 de ingineri în T1 2026, compania a găsit că cei cu cele mai mari bugete de tokeni au produs cele mai multe „pull request”-uri (propuneri de modificări într-un depozit comun de cod), însă îmbunătățirea productivității nu a crescut proporțional: de două ori mai mult „throughput” (volum de livrare) la un cost de 10 ori mai mare în tokeni. Ce se schimbă operațional: mai multă revizie, diferențe între seniori și juniori Articolul notează că, din discuțiile cu dezvoltatori, se conturează o realitate familiară: cresc presiunea pe code review (verificarea codului) și datoria tehnică, chiar dacă instrumentele AI oferă viteză și „libertate” în scrierea inițială. O observație recurentă este diferența între inginerii seniori și cei juniori: juniorii tind să accepte mai mult cod generat de AI și ajung, în consecință, să rescrie mai mult ulterior. Ce urmează: companiile nu dau înapoi, dar își schimbă măsurătorile Deși apar semne că organizațiile încă învață să folosească eficient instrumentele AI, direcția generală rămâne de adopție, nu de retragere. TechCrunch amintește și de interesul comercial din jurul măsurării randamentului: Atlassian a cumpărat anul trecut DX, un startup de „engineering intelligence”, pentru 1 miliard de dolari, pentru a-și ajuta clienții să înțeleagă rentabilitatea investiției în agenți de programare. În acest context, Waydev spune că și-a refăcut platforma în ultimele șase luni pentru a urmări metadatele generate de agenții AI și pentru a oferi managerilor analize despre calitatea și costul codului, nu doar despre volum. „Aceasta este o nouă eră a dezvoltării software și trebuie să te adaptezi, iar ca firmă ești forțat să te adaptezi. Nu e ca și cum ar fi un ciclu care va trece”, a declarat Alex Circei pentru TechCrunch. [...]

Marea Britanie pornește un fond suveran de 500 milioane lire pentru AI, cu investiții și acces la supercomputere legat de drepturi preferențiale potrivit iThome , într-o mișcare care urmărește să accelereze creșterea companiilor locale de inteligență artificială și să le păstreze în țară, pe un model apropiat de capitalul de risc. Fondul, în valoare de 500 milioane lire sterline (aprox. 2,9 miliarde lei), a fost lansat odată cu anunțarea primei investiții. Ministrul britanic pentru tehnologie, Liz Kendall , a susținut că guvernul trebuie să „valorifice oportunitatea” AI și a încercat să reducă temerile legate de impactul asupra locurilor de muncă și asupra securității cibernetice, notează publicația, care citează The Guardian. Cum funcționează intervenția statului: bani, infrastructură și opțiuni de investiție Pe lângă investiții directe, schema include și acces la resurse de calcul: șase companii britanice vor primi drept de utilizare a unei rețele de supercomputere finanțate de guvern pentru dezvoltarea de modele AI. În schimb, statul obține drepturi de investiție preferențiale în unele dintre firmele sprijinite, iar această susținere prin putere de calcul este inclusă în dimensiunea totală a fondului de 500 milioane lire. Fondul suveran de AI este descris ca fiind conceput similar unui fond de venture capital (capital de risc), iar lansarea oficială a avut loc la sediul din Londra al startup-ului de conducere autonomă Wayve . Primele investiții și companiile vizate Guvernul a investit în Callosum, companie cu sediul la Londra care lucrează la creșterea eficienței colaborării dintre diferite tipuri de cipuri, pentru a susține antrenarea și rularea modelelor AI. A mai fost finanțată încă o companie al cărei nume nu a fost făcut public, conform informațiilor citate. Între startup-urile care primesc sprijin (prin acces la infrastructură) se numără: Prima Mente , care dezvoltă „modele de bază biologice” pentru utilizări precum abordarea bolii Alzheimer; Cursive , fondată de foști membri Google DeepMind, axată pe dezvoltarea de agenți AI autonomi; Odyssey , care dezvoltă „modele ale lumii”, adică medii simulate apropiate de realitate în care sistemele AI pot interacționa. De ce contează: păstrarea „campionilor” AI în Marea Britanie Cancelarul britanic al finanțelor, Rachel Reeves, a spus că sprijinirea companiilor locale de AI ar permite Marii Britanii să se asigure că firme competitive internațional „încep, cresc și rămân” în țară. În același timp, Kendall a recunoscut existența îngrijorărilor publice privind riscurile AI și efectele asupra ocupării, dar a reiterat ideea că tehnologia poate crea și locuri de muncă, chiar dacă unele roluri vor dispărea pe fondul automatizării. Callosum a argumentat, printr-unul dintre cofondatori, că avantajul Marii Britanii vine din baza de talente din universități și din ecosistemul de laboratoare private, inclusiv DeepMind, elemente care ar face piața locală atractivă pentru dezvoltarea companiilor din domeniu. [...]

Jensen Huang susține că „miza” pe piața muncii se mută de la existența AI la accesul la instruire , iar companiile și autoritățile ar trebui să reducă barierele de utilizare pentru a crește productivitatea, potrivit IT之家 , care relatează despre un discurs al CEO-ului Nvidia distribuit pe X de contul oficial al companiei. În intervenția sa, Huang argumentează că, într-un mediu de lucru tot mai automatizat, factorul care „decide” traiectoria profesională nu este tehnologia în sine, ci alegerea individului de a o adopta și folosi. Cu alte cuvinte, avantajul competitiv nu vine din faptul că AI există, ci din capacitatea de a o integra în activitatea curentă. AI ca „multiplicator” și barieră mai mică de intrare Huang respinge ideea că AI este doar un instrument de înlocuire a oamenilor și o descrie ca pe o forță care amplifică abilitățile. El folosește, ca analogie, evoluția de la tâmplărie la proiectare în construcții pentru a ilustra cum progresul tehnologic poate „împuternici” individul. În același registru, CEO-ul Nvidia susține că platformele AI permit utilizatorilor obișnuiți să depășească mai ușor barierele tradiționale de competențe: chiar și fără cunoștințe avansate, pot realiza sarcini complexe de desen și proiectare. De ce contează: presiune pe formare și pe reducerea obstacolelor Un punct central al discursului este că AI ar fi tehnologia cu cea mai rapidă răspândire din istorie, iar ușurința de utilizare ar accelera adoptarea. În acest context, Huang face apel la liderii din industrie și la factorii de decizie publică să colaboreze pentru: eliminarea obstacolelor care îngreunează folosirea tehnologiei; poziționarea AI ca instrument general de învățare; simplificarea accesului la sisteme, pentru a sprijini dezvoltarea profesională și acumularea de cunoștințe. Potrivit lui Huang, dezbaterea de pe piața muncii se mută treptat de la „dacă există instrumentul” la „dacă instruirea este răspândită”, iar reducerea fricii sociale față de noile tehnologii ar fi esențială pentru creșterea productivității. Ce urmează, în viziunea lui Huang În final, Huang afirmă că angajații care stăpânesc instrumentele AI vor deveni reperul în industrii, iar sectoarele economice ar trebui să accelereze adoptarea și să-și ajute oamenii să-și construiască un avantaj competitiv într-o economie tot mai automatizată. [...]

Administrația Trump încearcă să refacă punțile cu Anthropic , pe fondul temerilor că noul model „Mythos” ar putea amplifica atacurile cibernetice , potrivit South China Morning Post . Discuția de la Casa Albă cu CEO-ul Dario Amodei are loc după un conflict deschis cu Pentagonul , care a limitat drastic utilizarea tehnologiei companiei în instituțiile federale. Întâlnirea – prima de acest tip după disputa de la începutul anului – sugerează că cele două părți ar putea încerca să reconstruiască încrederea, într-un moment în care guverne și industrii încearcă să înțeleagă rapid implicațiile modelului Mythos, despre care există temeri că ar putea face atacurile cibernetice complexe mai ușor și mai rapid de executat. De ce contează: riscul operațional pentru bănci și instituții financiare Publicația notează că industria bancară este considerată deosebit de vulnerabilă, din cauza sistemelor IT vechi („legacy”, adică infrastructură tehnologică moștenită, dificil de modernizat integral), care pot deschide un număr mare de puncte slabe. Oficialii guvernamentali din cel puțin trei țări – SUA, Canada și Marea Britanie – s-au întâlnit cu lideri din banking pentru a discuta amenințările asociate cu Mythos. TJ Marlin, CEO al firmei de securitate pentru inteligență artificială Guardrail Technologies, a indicat că „stivele” tehnologice din instituțiile financiare combină instrumente moderne cu software vechi de decenii, ceea ce poate crește suprafața de atac. Ce au discutat Casa Albă și Anthropic La întâlnire au participat, între alții, secretarul Trezoreriei Scott Bessent și șefa de cabinet Susie Wiles, potrivit Axios, citat de South China Morning Post. Casa Albă a transmis, într-un comunicat, că discuția a fost „productivă și constructivă” și a vizat colaborarea, inclusiv „abordări și protocoale” comune pentru provocările asociate cu scalarea tehnologiei. De asemenea, părțile au discutat despre echilibrul dintre inovare și siguranță, iar administrația a spus că intenționează să aibă discuții similare și cu alte companii importante din domeniul AI. Anthropic a descris întâlnirea drept „productivă” și a precizat că a vizat priorități comune precum securitatea cibernetică, poziția SUA în „cursa AI” și siguranța inteligenței artificiale. Context: de la interdicții federale la proces cu Pentagonul Înainte de lansarea Mythos, guvernul SUA și compania din Silicon Valley au avut un dezacord privind utilizările permise ale AI. După luni de negocieri tensionate, Pentagonul a aplicat Anthropic o desemnare formală de risc în lanțul de aprovizionare, limitând sever utilizarea tehnologiei, după ce start-up-ul ar fi refuzat să elimine „gardurile de protecție” care împiedicau folosirea AI pentru arme autonome sau supraveghere internă. Ulterior, președintele Donald Trump a criticat public compania, iar Anthropic a dat în judecată Pentagonul în martie, încercând să blocheze includerea pe o listă de securitate națională. Întrebat de reporteri despre întâlnirea cu Anthropic, Trump a răspuns: „Nu am nicio idee.” Ce este „Mythos” și cum este testat Mythos a fost anunțat pe 7 aprilie și este implementat inițial către un grup select de companii, prin „Project Glasswing” – o inițiativă controlată care permite organizațiilor să folosească modelul „Claude Mythos Preview” (încă nelansat public) pentru a căuta vulnerabilități de securitate cibernetică. Anthropic susține că este cel mai capabil model al său pentru programare și „sarcini agentice” (adică poate acționa autonom). Experți citați de publicație avertizează însă că tocmai capacitatea avansată de a scrie cod ar putea oferi o abilitate fără precedent de a identifica vulnerabilități și de a concepe metode de exploatare a acestora. [...]