Știri

Știri din categoria Inteligență artificială

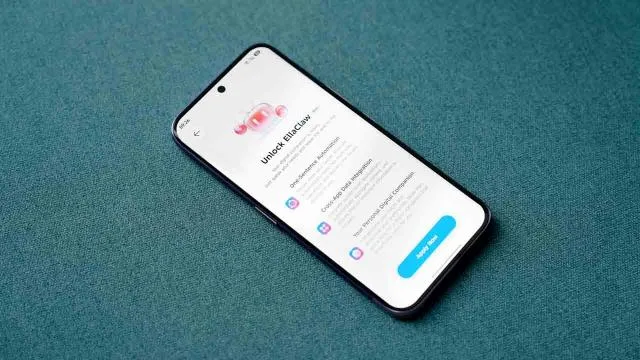

Tecno pregătește EllaClaw, un asistent AI cu acțiuni autonome, potrivit Mobilissimo, într-o mișcare prin care compania încearcă să intre mai serios în zona inteligenței artificiale de pe smartphone-uri și să concureze cu soluțiile dezvoltate de Google și Samsung.

Noul sistem ar urma să integreze platforma OpenClaw în asistentul virtual Ella, sub numele „EllaClaw”. Conceptul este cel al unui „agent” care poate executa sarcini fără intervenția constantă a utilizatorului, într-o direcție similară cu funcții precum Magic Cue de pe Pixel 10, menționată ca reper în material.

Concret, EllaClaw este prezentat ca un instrument care poate automatiza activități uzuale și poate oferi recomandări în funcție de context, folosind informații din aplicațiile de pe telefon. Exemplele de utilizare indicate includ:

Un element cheie este controlul utilizatorului asupra autonomiei: sistemul ar funcționa pe mai multe niveluri de permisiune, astfel încât proprietarul telefonului să poată decide cât de mult acces și inițiativă primește asistentul. În plus, pe măsură ce este folosit, EllaClaw ar urma să „învețe” preferințele utilizatorului pentru a automatiza mai eficient sarcinile zilnice.

Rămâne însă deschisă o întrebare importantă pentru astfel de funcții: unde sunt procesate datele, local pe dispozitiv sau în cloud (infrastructură la distanță). Mobilissimo notează, de asemenea, că Tecno ar putea lansa inițial funcția într-un program beta, pentru un număr limitat de utilizatori, înainte de o disponibilitate mai largă.

Recomandate

Apple pregătește o creștere „mare” a calității vizuale pentru modelele sale de generare de imagini din Apple Intelligence , folosite în Genmoji și Image Playground, odată cu iOS 27, potrivit 9to5Mac . Miza este una operațională: Apple încearcă să reducă diferența de calitate față de rivalii din zona de generare de imagini, după un debut considerat modest în iOS 18.2. Informația este atribuită newsletterului „Power On” al Bloomberg și lui Mark Gurman , care susține că modelele Apple vor primi un „big boost” (o îmbunătățire semnificativă) la nivel de fidelitate vizuală. În paralel, Apple ar pregăti și extinderea suportului pentru modele terțe de generare de imagini în aplicația Image Playground reproiectată din iOS 27, dincolo de OpenAI (ChatGPT), deja integrat. De ce contează: Apple încearcă să repare o verigă slabă din Apple Intelligence Genmoji și, mai ales, Image Playground au fost lansate în iOS 18.2 cu rezultate vizuale descrise ca neimpresionante, în special în comparație cu alte instrumente de generare de imagini. În acest context, o creștere vizibilă a calității ar putea schimba utilitatea reală a acestor funcții pentru utilizatori și ar reduce presiunea de a apela la servicii externe. Publicația notează și un element tehnic important: modelele care alimentează Genmoji și Image Playground sunt „on-device” (rulează pe dispozitiv), ceea ce poate explica parțial limitele de calitate. Totuși, rămâne neclar dacă, după upgrade, modelele vor continua să ruleze local sau dacă Apple va schimba abordarea. Ce se schimbă în iOS 27: upgrade la modelele Apple și mai multe opțiuni externe Din informațiile citate, direcțiile de evoluție sunt două: îmbunătățirea modelelor proprii Apple pentru Genmoji și Image Playground, cu un salt de calitate vizuală în iOS 27; extinderea Image Playground pentru a suporta și alte modele de generare de imagini, pe lângă ChatGPT, cu mențiunea că ar putea apărea suport și pentru „Nano Banana” de la Google, între alți competitori. Separat, 9to5Mac amintește și de un raport anterior despre Genmoji, care ar urma să primească sugestii automate bazate pe biblioteca foto și alte detalii ale utilizatorului, dar subliniază că îmbunătățirea calității vizuale nu se limitează la această funcție. În lipsa unor detalii oficiale despre calendar și cerințe tehnice, rămâne de văzut dacă Apple va păstra execuția exclusiv pe dispozitiv sau va combina procesarea locală cu servicii în cloud pentru a obține saltul de calitate promis. [...]

Atacurile cu drone asupra a două centre de date AWS din Emiratele Arabe Unite au schimbat calculul de risc pentru investițiile în infrastructura AI din Golf , iar proiectele în derulare riscă să devină mai scumpe și mai lente, pe fondul creșterii costurilor cu energia și al unei prime geopolitice mai mari, potrivit The Next Web . Două centre de date Amazon Web Services (AWS) din EAU au fost vizate la începutul războiului din Orientul Mijlociu. La aproape trei luni de atunci, petrolul se menține în jur de 100 de dolari/baril (aprox. 460 lei), iar Strâmtoarea Hormuz rămâne închisă — o combinație care pune sub presiune ambiția regiunii de a deveni un hub global pentru inteligență artificială, mizând pe energie ieftină, poziție geografică și capital suveran. Investiții amânate și decizii mai lente Publicația notează că unele decizii de investiții în proiecte de centre de date au fost puse pe pauză sau durează mai mult. CEO-ul Pure Data Center Group, Gary Wojtaszek, a declarat pentru CNBC că firma a suspendat temporar deciziile de investiții în Orientul Mijlociu. În paralel, Mark Richards, partener la casa de avocatură BCLP, spune că deciziile „durează mai mult” din cauza riscurilor asociate unei regiuni cu „amenințări serioase”. Atlantic Council, prin Trisha Ray, sintetizează schimbarea de paradigmă: „Conflictul în desfășurare din Orientul Mijlociu pune infrastructura AI literalmente pe linia frontului, în moduri care chiar și acum un an ar fi părut în afara posibilului.” Energia nu mai e „garanția” care făcea Golful atractiv Înainte de conflict, piețele din Golf ofereau energie industrială la circa 0,11 dolari/kWh (aprox. 0,50 lei), față de 0,25–0,40 dolari/kWh (aprox. 1,15–1,85 lei) în părți din Europa. Războiul a destabilizat însă piețele energetice, iar Agenția Internațională a Energiei (IEA) a numit închiderea efectivă a Strâmtorii Hormuz drept „cea mai mare perturbare a aprovizionării cu petrol din istorie”. În acest context, Brent a crescut cu peste 55%, de la aproximativ 72 de dolari la aproape 120 de dolari la vârf (aprox. 330–550 lei), pe parcursul a trei luni. În EAU, prețurile la gaz au urcat cu 30% pentru consumatori în aprilie. Concluzia: chiar și în state bogate în energie, curentul ieftin nu mai este garantat pentru marii consumatori industriali, inclusiv centrele de date. Centrele de date intră în logica de securitate a regiunii Atacurile asupra facilităților AWS sunt descrise ca o escaladare fără precedent, cu implicații directe pentru modul în care vor fi proiectate viitoarele centre de date: fortificare fizică, posibil construcții subterane, tehnologii anti-drone și diversificare prin proiecte în afara țării — toate cu impact în costuri și termene. Riscul este întărit și de un episod separat: Corpul Gardienilor Revoluției Islamice din Iran a publicat imagini satelitare cu campusul Stargate al OpenAI din Abu Dhabi și l-a desemnat drept potențială țintă militară, ceea ce, în lectura TNW, mută infrastructura AI în „calculul strategic” al conflictului. Ambițiile rămân, dar cu facturi mai mari Jucătorii regionali susțin public că războiul nu le schimbă planurile: G42 (EAU) spune că „convingerea” sa „s-a adâncit”, iar CEO-ul HUMAIN din Arabia Saudită, Tareq Amin, afirmă că firma „construiește întregul stack AI” (adică toate straturile tehnologice necesare, de la infrastructură la aplicații) și că „scara” regatului este un avantaj strategic. În același timp, think tank-ul CSIS, prin Aalok Mehta, avertizează că iluzia stabilității pe termen lung în Golf a fost „spulberată”. Efectele probabile asupra proiectelor, potrivit materialului, includ: costuri mai mari pentru fortificarea facilităților și tehnologii anti-drone; prime de asigurare mai ridicate; întârzieri și costuri suplimentare din perturbări ale lanțurilor de aprovizionare. Într-o piață deja tensionată de deficitul global de cipuri și memorie, adăugarea riscului geopolitic poate pune presiune dublă pe „pipeline”-ul de centre de date din Golf: hardware mai greu de procurat și locații mai greu (și mai scump) de asigurat. Concluzia TNW este că ambițiile AI ale regiunii nu dispar, dar devin „mai scumpe, mai lente și mai riscante” decât erau cu patru luni în urmă. [...]

Criza de cipuri obligă SUA să rămână pe Claude, deși Pentagonul a pus Anthropic pe lista neagră , iar Casa Albă a aprobat o finanțare de urgență de 9 miliarde de dolari (aprox. 41 miliarde lei) pentru centre de date clasificate, potrivit The Next Web . Miza este una operațională: fără hardware suficient pentru a rula modele „de frontieră” (cele mai avansate) pe rețele secrete, agențiile de informații nu pot înlocui rapid furnizorii considerați riscanți. Decizia de a continua utilizarea unui model avansat Anthropic de către National Security Agency (NSA) a fost autorizată de șefa de cabinet a Casei Albe, Susie Wiles, pe fondul unui deficit critic de cipuri necesare pentru rularea inteligenței artificiale generative în infrastructuri clasificate. The Next Web notează că informația a fost relatată de New York Times. 9 miliarde de dolari pentru centre de date compatibile cu Nvidia Grace Blackwell Pachetul de 9 miliarde de dolari (aprox. 41 miliarde lei) este descris ca o cerere secretă de finanțare de urgență aprobată de Casa Albă, menită să ajute principalele agenții de spionaj ale SUA, inclusiv CIA și NSA, să obțină semiconductori de vârf și să construiască infrastructura necesară pentru a rula AI pe sisteme „top secret”. Banii ar urma să finanțeze centre de date federale specializate, construite pentru infrastructura „supercipului” Nvidia Grace Blackwell. Potrivit materialului, aceste sisteme cer configurații personalizate, consum mare de energie și răcire cu lichid, nefiind compatibile cu „grilele” standard de calcul ale guvernului. Congresul urmează să voteze formal aprobarea pachetului. Până atunci, Casa Albă redirecționează 800 milioane de dolari (aprox. 3,7 miliarde lei) din alte bugete pentru a începe imediat achiziția de capacitate de calcul. De ce nu poate guvernul „să schimbe furnizorul” peste noapte Problema, așa cum o descrie publicația, este că cerințele de calcul ale modelelor moderne au depășit ce anticipaseră experții din apărare și comisiile din Congres. Modelele avansate consumă mult mai multă putere de procesare decât pot livra rețelele clasificate existente, iar lipsa de cipuri a împiedicat agențiile să instaleze sau să testeze complet cele mai noi instrumente AI. În acest context, apare contradicția: Pentagonul a „blacklistat” (a introdus pe lista neagră) Anthropic ca risc de securitate în lanțul de aprovizionare, invocând îngrijorări legate de structura corporativă și legături cu investiții străine, dar NSA rămâne dependentă de modelele companiei în lipsa unei alternative fezabile pe infrastructura proprie. AI în intelligence: utilitate imediată, blocaj de infrastructură Materialul arată că serviciile militare și de informații folosesc AI pentru a analiza volume foarte mari de date – de la comunicații interceptate la imagini satelitare – pentru a semnala anomalii și potențiale amenințări care ar scăpa analiștilor umani. Din această perspectivă, blocarea accesului la hardware care ține pe loc aceste instrumente este tratată de guvern drept o urgență de securitate națională, alimentată și de teama că China ar putea obține un avantaj de calcul în operațiunile globale de intelligence. Context: aceeași presiune pe cipuri se vede și în electronicele de consum The Next Web leagă criza guvernului de o tendință mai largă: realocarea producției de memorie și plachete (wafers) către AI, pe măsură ce companii precum Samsung, SK Hynix și Micron ar redirecționa capacități dinspre electronicele de consum către zona AI. În această logică, cererea de 9 miliarde de dolari este „versiunea guvernamentală” a aceleiași constrângeri care afectează și piața globală. Separat, publicația menționează că veniturile Anthropic ar fi crescut de la 9 miliarde de dolari la 30 miliarde de dolari anualizat între finalul lui 2025 și începutul lui aprilie 2026 și că firma se pregătește pentru o posibilă listare (IPO) la o evaluare care ar putea ajunge la 800 miliarde de dolari. Ce urmează Finanțarea de 9 miliarde de dolari vizează, în esență, reducerea dependenței operaționale: odată construite centrele de date clasificate, comunitatea de informații ar putea rula „orice modele alege” fără să depindă de un singur furnizor. Până când infrastructura devine funcțională, NSA ar urma să continue să folosească modelele Anthropic, în pofida poziției oficiale a Pentagonului. [...]

O postare cu o imagine generată de inteligența artificială, distribuită de Donald Trump , riscă să inflameze percepțiile despre escaladare militară într-un moment în care SUA și Iran discută un posibil acord de încetare a războiului, potrivit Digi24 . Digi24 relatează că președintele SUA a publicat duminică o imagine generată cu AI, însoțită de legenda „Adios”, în care apare o dronă americană distrugând o navă a marinei iraniene. Informația este atribuită de publicație The Times of Israel, care notează că nu este clar ce mesaj a urmărit Trump să transmită, în contextul discuțiilor în desfășurare cu Teheranul. Ce se negociază și de ce contează Strâmtoarea Ormuz Potrivit mai multor rapoarte citate de The Times of Israel și „confirmate de oficiali israelieni”, acordul inițial ar urma să se concentreze pe: prelungirea armistițiului existent cu încă 60 de zile; redeschiderea Strâmtorii Ormuz, descrisă ca fiind blocată în prezent, pentru transportul maritim „vital”. În același cadru, problema activităților nucleare ale Iranului ar urma să fie amânată pentru discuții în perioada armistițiului, fără a se impune Iranului obligația de a-și exporta stocul de uraniu puternic îmbogățit, mai notează sursa citată. Elemente suplimentare din plan și poziția Iranului Planul ar include și un armistițiu în conflictul dintre Israel și gruparea libaneză Hezbollah, însă nu ar prevedea dezarmarea acesteia, potrivit acelorași informații. Digi24 mai arată că Trump a declarat sâmbătă că un acord mai amplu între Statele Unite și Iran a fost „în mare parte negociat” și că Strâmtoarea Ormuz va fi redeschisă, sugerând un posibil impuls către încheierea războiului. Pe de altă parte, agenția de știri iraniană Tansim, afiliată statului, a relatat duminică faptul că Iranul „nu a acceptat nicio decizie nouă” legată de programul său nuclear în cadrul negocierilor pentru încetarea conflictului. În paralel, sunt menționate informații venite dinspre Washington potrivit cărora s-ar fi ajuns la un acord, iar un anunț ar putea interveni chiar duminică, potrivit CNN. [...]

Boomul AI a mutat câștigurile spre cipuri și infrastructură, lăsând software-ul în urmă , iar această schimbare de ierarhie începe să se vadă atât în rezultate financiare, cât și în evoluția bursieră, potrivit Mediafax . Momentul de inflexiune indicat de mulți investitori este 24 mai 2023, când NVIDIA a raportat rezultate mult peste așteptări, pe fondul cererii accelerate pentru inteligență artificială. De atunci, boomul AI a reordonat sectorul tehnologic și a împins în față companiile care produc „uneltele” necesare antrenării și rulării modelelor de inteligență artificială, nu neapărat pe cele care vând aplicații software. Cipurile pentru AI, motorul principal al creșterii O analiză Morningstar arată o creștere fără precedent a veniturilor generate de cipurile folosite în AI, cu NVIDIA în prim-plan. Veniturile companiei din segmentul acceleratoarelor AI (cipuri specializate pentru antrenarea și rularea AI) au urcat de la 3,4 miliarde de dolari (aprox. 15,6 miliarde lei) la peste 60 de miliarde de dolari (aprox. 276 miliarde lei) în trei ani, un avans de circa 1.600%. În ultimul trimestru raportat, NVIDIA a anunțat venituri de 81,6 miliarde de dolari (aprox. 375 miliarde lei), peste estimările analiștilor. Potrivit acestora, nu există semne de încetinire a cererii pentru echipamentele AI ale companiei, descrisă ca „insațiabilă”. Acceleratoarele AI sunt utilizate pe scară largă de jucători precum OpenAI, Google sau Meta Platforms, iar cererea a susținut și alte nume din zona semiconductorilor și a infrastructurii, inclusiv Advanced Micro Devices și Broadcom. Software-ul rămâne în urmă, pe fondul temerilor investitorilor În timp ce producătorii de cipuri și furnizorii de infrastructură au beneficiat direct, companiile din software au performat mai slab, notează analiza citată. Motivul: investitorii iau în calcul că AI ar putea reduce nevoia de aplicații tradiționale sau ar putea înlocui anumite servicii. În acest context, indicele companiilor de semiconductori a crescut cu aproape 424% din 2023 până în prezent, în timp ce multe firme software au avut creșteri modeste sau chiar scăderi. Efect de propagare: centre de date, energie și construcții Expansiunea AI a accelerat construirea centrelor de date (facilități care găzduiesc serverele necesare funcționării AI), cu efecte în lanț în energie, construcții și infrastructură. Printre beneficiari este menționat producătorul american Caterpillar, alături de companii care produc generatoare sau construiesc infrastructura de alimentare a acestor centre. Pe fondul cererii mari de energie, Bloom Energy și-a văzut acțiunile crescând cu peste 240% în ultimele șase luni, potrivit sursei. Startup-uri evaluate la sute de miliarde și o piață mai concentrată Boomul AI a schimbat și piața companiilor private. Conform datelor PitchBook citate, evaluarea OpenAI a crescut de la 86 de miliarde de dolari (aprox. 396 miliarde lei) în ianuarie 2024 la peste 850 de miliarde de dolari (aprox. 3.910 miliarde lei) în martie 2026. În paralel, Anthropic ar fi urcat de la 21 de miliarde de dolari (aprox. 97 miliarde lei) la aproximativ 900 de miliarde de dolari (aprox. 4.140 miliarde lei). Analiștii mai indică și o concentrare accentuată pe piețele financiare, unde câteva companii foarte mari ajung să domine o parte importantă din bursa americană. În același timp, avertismentul rămâne că nu toate companiile vor câștiga din acest val, iar entuziasmul investitorilor s-ar putea tempera dacă economia încetinește sau dacă rezultatele nu confirmă așteptările ridicate ale pieței. [...]

Apple pregătește o extindere a funcțiilor de inteligență artificială generativă în iOS 27, iPadOS 27 și macOS 27 , după ce a creat un nou înregistrare DNS pentru subdomeniul „genai.apple.com”, un indiciu că va centraliza și operaționaliza mai mult zona „genAI” (AI generativă) înainte de WWDC 2026 , potrivit WinFuture . Conferința WWDC 2026 începe pe 8 iunie și va avea în prim-plan noile versiuni ale sistemelor de operare iOS 27, iPadOS 27 și macOS 27. Subdomeniul nu este activ în acest moment, însă astfel de adrese sunt folosite frecvent ca puncte de acces pentru dezvoltatori, unde sunt publicate documentații pentru interfețe de programare (API) și reguli, inclusiv pe zona de confidențialitate. Ce indică subdomeniul „genai” pentru strategia Apple Mișcarea sugerează că Apple pregătește funcții noi bazate pe inteligență artificială generativă, care poate produce conținut (de exemplu texte sau imagini) pe baza datelor existente. Așteptările sunt ca Apple să extindă capabilitățile sub umbrela „Apple Intelligence”, adică setul de funcții AI introdus deja în ecosistem. Siri și funcții „în aplicații”, cu procesare în cloud Publicația notează, citând 9to5Mac, că Apple ar lucra la o versiune revizuită a lui Siri, capabilă să înțeleagă contextul de pe ecran și să execute acțiuni direct în aplicații. Pentru aceste funcții, Apple ar urma să folosească modele Google Gemini, livrate prin infrastructura „ Private Cloud Compute ” (procesare în cloud cu accent pe protecția datelor). Abordarea permite rularea unor sarcini mai solicitante, dar implică necesitatea unei conexiuni la internet; procesarea ar fi „asigurată criptografic”, conform sursei. Exemple de îmbunătățiri așteptate în aplicații Între funcțiile menționate ca așteptate se numără: Safari, care ar putea denumi automat grupurile de file (tab-uri); Wallet, care ar putea crea permise digitale pornind de la bilete fizice; „Visual Intelligence”, care ar putea recunoaște informații precum valori nutriționale sau cărți de vizită; „Voice Control”, care ar putea permite navigarea prin limbaj natural. În paralel, Apple continuă să mizeze pe accelerarea locală a sarcinilor AI prin „Neural Engine”, integrată în cipurile sale de mai mulți ani, începând cu A11 Bionic. Ce urmează Semnalul principal rămâne operațional: apariția „genai.apple.com” indică pregătirea unui „hub” dedicat pentru dezvoltatori și, implicit, o extindere mai structurată a funcțiilor de AI generativă în următoarele versiuni majore de iOS, iPadOS și macOS, cu detalii așteptate odată cu WWDC, din 8 iunie. [...]