Știri

Știri din categoria Inteligență artificială

Sam Altman încearcă să reducă anxietatea legată de concedieri, susținând că OpenAI vizează „instrumente” care amplifică munca oamenilor, nu „entități” care îi înlocuiesc, potrivit IT之家. Mesajul vine pe fondul unei percepții tot mai răspândite că inteligența artificială ar putea prelua o parte semnificativă din locurile de muncă, după un an marcat în SUA de valuri de disponibilizări.

Altman a scris pe platforma X că direcția companiei este să construiască tehnologii care „îmbunătățesc și cresc capacitățile umane”, nu sisteme menite să înlocuiască oamenii. În aceeași intervenție, el a argumentat că pesimismul pe termen lung legat de „înlocuirea oamenilor de către AI” este greșit, deoarece, în timp, oamenii vor găsi „munci mai semnificative”.

Publicația dă ca exemplu cazul dezvoltatorului jocului mobil „Candy Crush”, compania King, care ar fi concediat ingineri ce lucrau la un instrument de generare a nivelurilor cu ajutorul AI, după finalizarea proiectului, aceștia fiind înlocuiți de sistemul pe care l-au construit.

În acest context, IT之家 notează că mulți oameni cred că AI va „prelua toate joburile”, iar această stare de spirit amplifică reticența față de tehnologie.

Materialul amintește și de pozițiile CEO-ului Anthropic, Dario Amodei, care a susținut în repetate rânduri că lumea ar putea ajunge la un punct în care „tot codul este scris de AI” într-un interval de „șase luni până la un an”, contribuind la creșterea anxietății în jurul impactului AI asupra muncii.

Altman a schițat și o viziune optimistă despre viitor, sugerând că oamenii ar putea avea o „viață prosperă și minunată” chiar și dacă nu își doresc să muncească din greu, fără a detalia însă cum ar funcționa concret un astfel de scenariu.

Recomandate

Procesul dintre Elon Musk și OpenAI mută disputa despre AI în zona de control și guvernanță, cu Microsoft în centrul mizei – potrivit Antena 3 , conflictul juridic ridică întrebarea practică a pieței: cine ajunge să decidă direcția unei tehnologii pe care chiar actorii din industrie o descriu drept potențial „superinteligență” (AGI), adică un nivel ipotetic în care capacitățile mașinii le depășesc pe cele umane. Miza imediată a procesului, așa cum este prezentată în material, este schimbarea OpenAI de la un „laborator” nonprofit la o structură orientată spre profit, supravegheată de o fundație nonprofit. Musk susține că liderii OpenAI ar fi trădat misiunea inițială – dezvoltarea AI „în mod sigur și transparent” – în favoarea obiectivului de a face bani. OpenAI, la rândul său, afirmă că Musk, cofondator plecat în 2018, ar fi devenit vocal abia acum din cauza succesului lui Sam Altman pe o piață pe care concurează și compania de AI a lui Musk, xAI, despre care Antena 3 notează că a fuzionat în februarie cu SpaceX. Microsoft, „controlul” și disputa despre cine decide În depoziția din această săptămână, Musk a reluat ideea că, în primii ani ai OpenAI, el ar fi trebuit să fie la conducere pentru a se asigura că tehnologia este folosită în siguranță. În același context, el a invocat investiția Microsoft de 20 de miliarde de dolari în OpenAI (aprox. 92 miliarde lei) ca motiv de îngrijorare, argumentând că „Microsoft are propriile motivații” care ar putea devia de la obiectivele inițiale. Musk a formulat în instanță și o întrebare către jurați, în linie cu teza sa privind riscurile: „Chiar ați vrea ca Microsoft să controleze superinteligența digitală?” Materialul citat de Antena 3, o analiză CNN, punctează însă că alternativa sugerată implicit de Musk, cel puțin în primii ani ai OpenAI, ar fi fost un control concentrat în jurul lui Musk și al unui consiliu dominat de numiri făcute de el. Musk ar fi spus că „avea nevoie de control” la început, anticipând ulterior diluarea participației prin intrarea altor investitori. O listă scurtă de „stăpâni” ai AGI și problema de legitimitate Analiza CNN redată de Antena 3 susține că, în timp ce părțile se contrazic, opțiunile discutate rămân, practic, în interiorul unui cerc restrâns de mari jucători: Musk, OpenAI (condusă de Sam Altman), Microsoft și, eventual, Google, Meta sau Anthropic. În același material apare și reacția unor membri ai juriului, care ar indica o ostilitate față de Musk, inclusiv formulări dure din chestionarele de selecție. Judecătoarea federală Yvonne Gonzalez Rogers ar fi recunoscut existența acestei ostilități, dar a susținut că ea nu exclude integritatea procesului judiciar. Instanța delimitează tema: nu este un proces despre riscurile AI Judecătoarea a intervenit și pe fondul retoricii despre riscurile existențiale ale AI, remarcând – potrivit textului – ironia faptului că Musk dezvoltă o companie în același domeniu. Tot ea a delimitat însă obiectul cauzei, spunând că nu este un proces despre riscurile AI sau efectele asupra omenirii, ci că acesta ar putea fi subiectul unui proces viitor. În termeni de impact, cazul evidențiază o tensiune care depășește disputa dintre două nume: cum se stabilește guvernanța (cine controlează, cu ce mandat și ce mecanisme de verificare) într-o industrie în care capitalul mare și infrastructura tehnologică tind să concentreze decizia în mâinile câtorva companii și fondatori. [...]

Noile teste arată că GPT-5.5 ajunge din urmă Mythos Preview la capabilități relevante pentru securitate cibernetică , ceea ce pune sub semnul întrebării argumentul comercial al lansărilor „cu acces limitat” vândute ca măsură de siguranță, potrivit Ars Technica . În evaluarea AISI (instituția nu este detaliată în fragmentul furnizat), rezultatele pentru GPT-5.5 sugerează că Mythos Preview probabil nu a fost „un progres specific unui singur model”, ci mai degrabă un efect al îmbunătățirilor generale în autonomie pe termen lung, raționament și programare — adică exact tipul de evoluții care pot ridica simultan și utilitatea, și riscul în zona de „cyber”. De ce contează pentru companii și piața de securitate Dacă performanța „de vârf” în scenarii de securitate cibernetică nu mai este un diferențiator exclusiv al unui model foarte mediatizat, atunci: justificarea pentru prețuri premium și poziționare bazată pe „pericol” devine mai greu de susținut; presiunea se mută pe guvernanță (cine primește acces, în ce condiții) și pe control operațional, nu pe „unicitatea” tehnologică a unui singur produs; organizațiile care evaluează astfel de modele pentru apărare trebuie să trateze riscul ca fiind mai „generalizat” în generațiile noi de modele, nu ca o excepție. „Marketing bazat pe frică” și accesul limitat, în centrul discuției Într-un interviu recent acordat podcastului Core Memory , Sam Altman, CEO OpenAI, a criticat promovarea lansărilor limitate prin ceea ce el numește „marketing bazat pe frică”. El a comparat retorica din jurul unor modele cu un mesaj de tipul „am construit o bombă” urmat de vânzarea unui „adăpost anti-bombă” pentru 100 de milioane de dolari. „Va exista mult mai multă retorică despre modele prea periculoase pentru a fi lansate. Vor exista și modele foarte periculoase care vor trebui lansate în moduri diferite.” Interviul este disponibil aici: Core Memory . Cum își structurează OpenAI accesul la modelele „cyber” OpenAI a introdus în februarie un program-pilot numit „ Trusted Access for Cyber ”, prin care cercetători în securitate și companii își pot verifica identitatea și își pot înregistra interesul pentru a studia modele de frontieră în scopuri defensive: Trusted Access for Cyber și pagina de verificare: chatgpt.com/cyber . Luna trecută, compania a spus că folosește această listă pentru a controla lansarea limitată a GPT-5.4-Cyber, o variantă „ajustată intenționat” pentru capabilități suplimentare în zona cyber și cu mai puține restricții: OpenAI . Iar joi, Altman a afirmat pe rețele sociale că lansarea inițială a GPT-5.5-Cyber va fi, la rândul ei, limitată „în următoarele zile” la „apărători critici” din zona cyber: X . Ce urmează Pe termen scurt, miza se mută pe criteriile de acces și pe modul în care astfel de programe „cu identitate verificată” vor deveni un standard de piață pentru utilizarea defensivă. În același timp, dacă îmbunătățirile care cresc riscul sunt „mai generale”, cum sugerează AISI, presiunea pentru reguli și proceduri de lansare diferențiate (nu doar pentru un singur model „special”) ar putea crește. Limitarea importantă: fragmentul furnizat nu include detalii despre metodologie, seturi de teste sau scoruri, deci comparația rămâne la nivelul concluziei prezentate. [...]

Procesul dintre Elon Musk și Sam Altman riscă să complice traseul OpenAI către o listare și să amplifice presiunea juridică asupra modelului său hibrid (nonprofit–profit), într-un moment în care compania este descrisă ca fiind „pregătită” pentru un IPO, potrivit Al Jazeera . Într-un proces federal din California , Musk – cofondator OpenAI – a depus mărturie pentru a doua zi, susținând că Altman a „trădat” promisiunile inițiale de a păstra organizația ca nonprofit „dedicată beneficiului umanității”. Litigiul pornește de la înființarea OpenAI în 2015 ca nonprofit și transformarea ulterioară într-o structură orientată spre profit. Musk a declarat în fața juraților că și-a pierdut încrederea că Altman va menține misiunea nonprofit și a spus că, spre finalul lui 2022, se temea că Altman încerca să „fure caritatea”, afirmând că „s-a dovedit a fi adevărat”. Altman a fost prezent în sală, dar nu a depus mărturie, conform relatării. Miza economică: IPO și modelul de finanțare Avocații OpenAI au respins acuzațiile și au susținut că nu a existat niciodată un angajament de a rămâne nonprofit. Compania afirmă că a creat o componentă cu scop lucrativ pentru a finanța nevoile mari de putere de calcul și pentru a atrage talente. În același timp, OpenAI ar fi „pregătită” pentru o ofertă publică inițială care ar putea evalua compania la 1.000 de miliarde de dolari, potrivit Reuters, citată de Al Jazeera. În acest context, disputa privind guvernanța și misiunea inițială poate deveni un factor de risc reputațional și juridic, cu potențiale efecte asupra investitorilor și structurii de control. Ce cere Musk în instanță Musk a investit aproximativ 38 de milioane de dolari (aprox. 174 milioane lei) în OpenAI între 2015 și 2017 și a părăsit organizația în 2018. În proces, el solicită: 150 de miliarde de dolari (aprox. 690 miliarde lei) despăgubiri de la OpenAI și Microsoft , cu orice sumă acordată direcționată către brațul caritabil al OpenAI; obligarea OpenAI să revină la statutul de nonprofit; înlăturarea lui Sam Altman și a cofondatorului Greg Brockman din conducere. Musk a mai susținut că organizația a fost „capturată” și a descris o ofertă de a investi, venită din partea lui Altman, ca părând „ca o mită”. Apărarea OpenAI: competiția cu xAI Echipa juridică a OpenAI afirmă că acțiunea lui Musk urmărește să submineze compania în favoarea propriei sale inițiative, xAI. OpenAI, organizată acum ca „public benefit corporation” (o formă corporativă care combină obiective comerciale cu o misiune de interes public), susține că demersul este alimentat de competiție și notează că xAI este în urma OpenAI la adopția de către utilizatori. Context suplimentar despre proces apare într-un material anterior al publicației, „stand for a second day”, disponibil aici: Al Jazeera . [...]

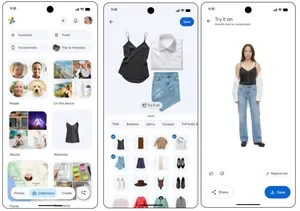

Google Photos testează o funcție de „probă virtuală” cu AI, care poate schimba modul în care utilizatorii își aleg ținutele din propriile fotografii , potrivit CNET . Instrumentul promite să îi ajute pe oameni să se „vadă” în diferite haine din garderobă, direct în aplicație, fără să fie nevoie să încerce fizic fiecare combinație. Miza practică este una operațională: dacă funcția ajunge la scară largă, Google Photos ar putea deveni mai mult decât o arhivă de imagini și ar intra în zona de utilitate zilnică, prin recomandări și vizualizări generate cu inteligență artificială pentru ținute. Pentru utilizatori, asta înseamnă mai puțin timp pierdut cu alegerea hainelor și, potențial, o nouă categorie de funcții „asistent” în aplicațiile foto. Ce face, concret, noul instrument Din informațiile prezentate, funcția folosește inteligența artificială pentru a genera o previzualizare a utilizatorului în diferite articole vestimentare, pe baza fotografiilor existente. Cu alte cuvinte, aplicația încearcă să simuleze cum ar arăta o persoană purtând diverse haine din garderobă. CNET nu oferă, în fragmentul disponibil, detalii tehnice despre modelul folosit, condițiile exacte de utilizare sau dacă funcția este disponibilă public ori doar în testare limitată. De ce contează pentru ecosistemul Google Photos O astfel de funcție împinge Google Photos spre o zonă în care fotografiile nu mai sunt doar „amintiri”, ci devin date de intrare pentru servicii personalizate. În practică, asta poate crește timpul petrecut în aplicație și dependența de funcțiile AI integrate, într-un moment în care marile platforme încearcă să justifice investițiile în inteligență artificială prin utilități concrete pentru consumatori. Ce rămâne neclar În materialul sursă extras aici lipsesc informații esențiale pentru a evalua impactul complet: când ar urma să fie lansată funcția și în ce țări; dacă va fi gratuită sau legată de un abonament; ce limitări are (tipuri de fotografii, acuratețe, erori posibile); cum sunt gestionate confidențialitatea și datele folosite pentru generare. Fără aceste detalii, rămâne de văzut dacă instrumentul va deveni o funcție de masă în Google Photos sau va rămâne un experiment de nișă. [...]

Apple a dus cheltuielile de cercetare-dezvoltare la un nou record, 11,4 miliarde de dolari (aprox. 52 miliarde lei), cu accent pe inteligență artificială , potrivit Android Headlines . Miza economică este dublă: compania își apără avantajul competitiv într-o piață care se mută rapid spre produse și servicii bazate pe AI, dar își și crește baza de costuri într-un moment în care investitorii cer rezultate vizibile din aceste investiții. Suma de 11,4 miliarde de dolari este prezentată ca un nou maxim pentru bugetul de R&D (cercetare și dezvoltare), iar publicația leagă creșterea de intensificarea eforturilor Apple în zona de inteligență artificială și de dezvoltarea de produse viitoare. De ce contează: presiune pe marje și pe ritmul de livrare a „AI-ului” în produse Un buget mai mare de R&D înseamnă, pe termen scurt, costuri operaționale mai ridicate, care pot pune presiune pe marje dacă nu sunt compensate de venituri suplimentare. Pe termen mediu, investiția este un pariu pe capacitatea Apple de a transforma AI-ul în funcții și produse care să susțină vânzările de hardware și să accelereze veniturile din servicii. În același timp, un nivel record al cheltuielilor ridică așteptările pieței: dacă investițiile sunt „turnate” în AI, următorul pas logic este ca utilizatorii și investitorii să vadă îmbunătățiri concrete în ecosistem, nu doar promisiuni. Ce indică direcția investițiilor Din informațiile prezentate, accentul cade pe: creșterea investițiilor în cercetare și dezvoltare pentru „produse viitoare”; orientarea mai pronunțată către inteligență artificială, ca zonă prioritară de dezvoltare. Publicația nu detaliază, în fragmentul disponibil, proiecte specifice sau un calendar de lansări asociat acestor cheltuieli, astfel că rămâne neclar ce produse sau funcții vor absorbi cea mai mare parte a bugetului și când ar urma să se vadă rezultatele în piață. [...]

Pentagonul își diversifică furnizorii de AI pentru rețele secrete , semnând acorduri cu șapte companii tehnologice și lăsând în afara listei Anthropic , pe fondul unei dispute legate de mecanismele de siguranță pentru utilizarea militară a inteligenței artificiale, potrivit Agerpres . Decizia are o miză operațională și de gestionare a riscului: integrarea unor „capacități avansate” de AI în rețele clasificate, în timp ce Pentagonul încearcă să evite blocaje de aprovizionare și o dependență prea mare de un singur furnizor, conform comunicatului citat de Reuters. Cine sunt furnizorii selectați și ce urmează să livreze Cele șapte companii cu care Departamentul american al Apărării a ajuns la acorduri sunt: SpaceX, OpenAI, Google, Nvidia, Reflection, Microsoft și Amazon. Unele dintre ele colaborau deja cu Pentagonul. Aceste soluții urmează să fie integrate în rețele cu „niveluri de impact 6 și 7”, o clasificare care se referă la efectele pe care compromiterea confidențialității, integrității sau disponibilității sistemelor informatice le-ar avea asupra securității naționale. De ce lipsește Anthropic din listă Comunicatul exclude Anthropic, companie aflată într-o dispută cu Pentagonul privind mecanismele de siguranță pentru utilizarea militară a AI. În același timp, sursa citată arată că există rezerve interne față de renunțarea la Anthropic: unii angajați ai departamentului, foști oficiali și furnizori de tehnologie care lucrează îndeaproape cu armata americană au declarat pentru Reuters că instrumentele firmei ar fi „mai bune decât alternativele”, deși s-a ordonat eliminarea lor în următoarele șase luni. Directorul pentru tehnologie al Departamentului Apărării, Emil Michael, a declarat pentru CNBC că Anthropic reprezintă în continuare un risc pentru lanțul de aprovizionare. Unde va fi folosită AI în armată Extinderea serviciilor de AI vizează utilizări precum: planificare; logistică; selectarea țintelor; alte activități operaționale, cu obiectivul de a simplifica și accelera operațiunile, potrivit comunicatului preluat de Reuters. [...]