Știri

Știri din categoria Inteligență artificială

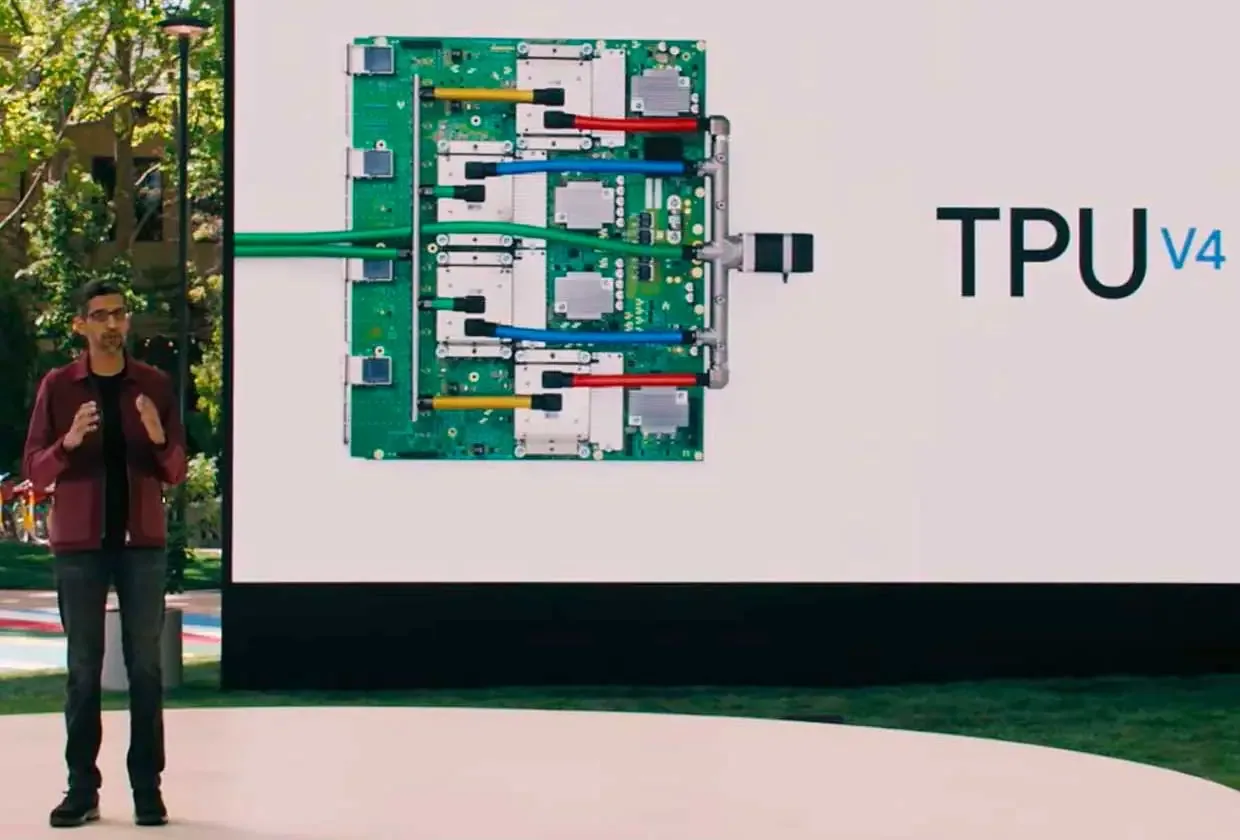

Google își accelerează strategia de a reduce dependența de Nvidia prin discuții cu Marvell Technology pentru dezvoltarea a două cipuri dedicate inteligenței artificiale, într-un demers care ar putea influența costurile și capacitatea de livrare a Google Cloud, potrivit ITmedia.

Informația, atribuită de ITmedia publicației The Information, indică negocieri între Google (parte a Alphabet) și Marvell pentru a crea două componente noi menite să ruleze mai eficient modele de inteligență artificială. Miza este dublă: performanță mai bună pentru sarcini AI și o alternativă mai credibilă la plăcile grafice (GPU) Nvidia, care domină infrastructura de antrenare și inferență pentru AI.

Potrivit materialului, proiectul ar include:

ITmedia notează că Google lucrează de mai mult timp la poziționarea TPU ca alternativă viabilă la GPU-urile Nvidia folosite pe scară largă în industrie.

Articolul leagă direct această inițiativă de presiunea asupra Google de a demonstra investitorilor că investițiile în AI se transformă în rezultate comerciale. În acest context, vânzările de TPU sunt prezentate ca un factor important pentru creșterea veniturilor din Google Cloud.

Cu alte cuvinte, dacă Google reușește să-și întărească oferta de cipuri proprii (și ecosistemul din jurul lor), poate câștiga atât la nivel de costuri și disponibilitate a infrastructurii, cât și la nivel de diferențiere față de competitori care depind mai mult de Nvidia.

Conform informațiilor citate, cele două companii ar urmări ca proiectarea unității de procesare a memoriei să fie finalizată cel mai devreme anul viitor, după care ar urma livrarea pentru producție de test.

Materialul nu oferă detalii despre termeni comerciali, volume sau despre momentul în care noul TPU ar putea intra în producție.

Recomandate

Google împinge rularea locală a agenților multimodali pe laptopuri prin Gemma 4 12B , un model care promite performanță apropiată de varianta mai mare (26B) la un consum de memorie mult redus și care poate rula pe hardware de consum, potrivit Google Blog . Modelul este poziționat între Gemma E4B (orientat spre „edge”, adică rulare pe dispozitive) și Gemma 26B de tip Mixture of Experts (MoE – arhitectură care activează selectiv „experți” specializați). Google spune că Gemma 4 12B „împachetează” capabilități puternice într-un „memory footprint” mai mic și este primul model „mid-sized” din familie cu intrări audio native. De ce contează: inferență locală cu cerințe mai mici de memorie Miza operațională este reducerea dependenței de cloud pentru aplicații cu imagini și audio, printr-un model suficient de mic pentru rulare locală. Google afirmă că Gemma 4 12B este „laptop ready”, putând rula cu 16 GB de VRAM sau memorie unificată (în funcție de platformă), și că atinge performanțe apropiate de modelul 26B MoE pe benchmark-uri standard, dar la mai puțin de jumătate din amprenta totală de memorie . În același timp, compania indică o adopție deja mare a familiei Gemma 4: modelele au depășit 150 de milioane de descărcări , iar comunitatea a construit aplicații de la „brațe robotice purtabile” până la soluții de securitate AI pentru mediul enterprise. Ce aduce nou: arhitectură multimodală unificată, fără encodere separate Diferențiatorul tehnic principal este arhitectura „encoder-free”: în loc să folosească encodere separate pentru a transforma imaginea sau audio în reprezentări intermediare înainte de modelul lingvistic, Gemma 4 12B introduce intrările vizuale și audio direct în „coloana vertebrală” a modelului de limbaj (LLM). Google argumentează că encoderele separate cresc latența și consumul de memorie. Pe scurt, modul de procesare descris de Google este: Viziune: encoderul vizual din Gemma 4 este înlocuit cu un modul de „embedding” (reprezentare numerică) mai ușor, bazat pe o singură înmulțire de matrice, „positional embedding” și normalizări, lăsând modelul lingvistic să preia procesarea vizuală. Audio: encoderul audio este eliminat complet, iar semnalul audio brut este proiectat în același spațiu dimensional ca „tokenii” text (unități de procesare ale modelului). Google mai spune că modelul include „drafters” pentru Multi-Token Prediction (MTP), o tehnică menită să reducă latența. Cum poate fi folosit: instrumente și distribuție Pentru testare și rulare locală, Google indică suport în mai multe instrumente și canale, inclusiv: LM Studio Ollama Google AI Edge Gallery App Google AI Edge Eloquent LiteRT-LM CLI Modelul este publicat sub licență Apache 2.0 , iar „weights” (parametrii antrenați) sunt disponibili prin colecția de pe Hugging Face . Pentru detalii de implementare, Google trimite la un ghid dedicat: Developer Guide . În paralel, compania anunță și un „Skills Repository” oficial pentru dezvoltarea de agenți (o bibliotecă de „abilități” pentru agenți construiți cu Gemma) și opțiuni de implementare în producție prin Google Cloud (inclusiv Model Garden, Cloud Run și GKE), fără a oferi în material detalii despre prețuri sau condiții comerciale. [...]

Nvidia își securizează lanțul de aprovizionare pentru HBM4 , după ce a certificat trei dintre cei mai mari producători de cipuri de memorie, un pas care poate influența direct ritmul de livrare și costurile noii generații de acceleratoare pentru inteligență artificială, potrivit IT Home . Jensen Huang , directorul general al Nvidia, a confirmat pentru prima dată că Samsung Electronics, SK Hynix și Micron Technology au trecut procesul de certificare și sunt eligibile să furnizeze HBM4 (High Bandwidth Memory – memorie cu lățime mare de bandă), componentă descrisă ca „indispensabilă” pentru platforma de generație următoare Vera Rubin , folosită în sarcini de inteligență artificială. Informația este atribuită de publicație unui material Bloomberg. De ce contează: HBM4 este un „gât de sticlă” pentru acceleratoarele AI HBM este una dintre piesele critice în construcția acceleratoarelor AI, iar accesul la volume mari, cu specificații conforme, poate limita sau accelera livrările de sisteme. Prin certificarea simultană a trei furnizori, Nvidia își reduce dependența de un singur producător și își crește șansele de a acoperi cererea pentru noua platformă. Huang a spus că toți cei trei furnizori „au trecut cu succes certificarea, au intrat pe linie în producția de masă” și lucrează la capacitate ridicată pentru a susține necesarul de livrări al platformei Vera Rubin. Context: competiție între Samsung, SK Hynix și Micron pe o piață profitabilă Cele trei companii „domină împreună” piața globală a semiconductorilor de memorie pentru stocare și concurează pentru a câștiga cotă într-un segment descris ca foarte profitabil, pe fondul cererii explozive din zona infrastructurii AI. Separat, publicația amintește că Nvidia a indicat anterior, la Computex 2026 din Taipei, că Vera Rubin a intrat în etapa de producție de masă, iar produsele complete ar urma să fie livrate în această toamnă. Platforma este prezentată ca un sistem AI construit dintr-un Vera CPU și un cluster de GPU-uri Rubin. [...]

Google împinge cumpărăturile second-hand spre „căutare asistată de AI” , prin funcții din Search și Shopping care ajută utilizatorii să găsească produse similare, să compare prețuri și chiar să estimeze valoarea de revânzare, potrivit Google Blog . Miza practică este reducerea fricțiunii din piața de resale (revânzare) – de la descoperire și verificare, până la decizia de cumpărare sau vânzare. În contextul în care interesul de căutare pentru „vintage” și „how to thrift” a atins maxime istorice în 2026, Google își poziționează instrumentele ca „strat” de orientare pentru cumpărăturile de obiecte second-hand și vintage, inclusiv pentru căutări aflate în trend precum „vintage jersey” și „thrifted heels”. Ce se schimbă operațional pentru utilizatori: 5 funcții, un singur flux Google descrie cinci moduri prin care Search poate „ridica nivelul” cumpărăturilor de tip thrift/vintage, cu accent pe căutare vizuală și întrebări în limbaj natural: AI Mode în Search : utilizatorii pot formula întrebări detaliate pentru a-și planifica „ieșirea la thrift”, iar răspunsurile includ opțiuni și detalii relevante, plus linkuri pentru documentare. Exemplul din articol combină căutarea de „tricouri vintage” cu o condiție logistică (brunch fără gluten în apropiere). Google Lens pentru identificare și context : prin fotografierea unui obiect în magazin, Lens poate afișa potriviri vizuale și permite întrebări despre designer sau perioadă („din ce eră este?”). Tot aici apare componenta cu impact direct în tranzacție: utilizatorul poate vedea la ce preț se vinde online și câte oferte similare există, pentru a evalua dacă e „piesă rară” sau produs comun. Circle to Search (Android) : utilizatorul încercuiește un obiect văzut pe ecran, iar funcția caută rapid produse similare, prețuri și locuri de cumpărare; apoi pot urma întrebări de rafinare (de exemplu, stiluri cu „vibe” de anii ’90). Virtual Try-On : un „cabina de probă” digitală. Utilizatorul găsește un produs similar cu Lens, apasă „try it on” și încarcă o fotografie full-body pentru a vedea cum ar arăta purtat. Lens pentru vânzare din propria garderobă : Google sugerează folosirea Lens pentru a estima cât ar valora un obiect la revânzare și ce tip de magazine ar cumpăra astfel de produse („Could I resell this?”). De ce contează: mai multă transparență de preț și mai puține „achiziții la ghici” Din perspectiva pieței, setul de funcții descris de Google mută o parte din „munca” specifică second-hand (identificare, autentificare informală prin comparații, orientare de preț) în interfața de căutare. În practică, asta poate crește transparența pentru cumpărători și poate accelera decizia de achiziție sau revânzare, mai ales când utilizatorul compară rapid cu ofertele online. Google nu oferă în material date despre lansări pe piețe, disponibilitate în România sau rezultate măsurabile (de tip conversii ori economii), astfel că impactul concret depinde de accesul efectiv la aceste funcții și de cât de bine acoperă ofertele locale. [...]

Apple își mută o parte din Siri în cloud-ul Google, pe cipuri Nvidia, pentru a accelera upgrade-ul AI potrivit GSMArena , care citează un raport The Information. Schimbarea contează operațional: Apple ar urma să se bazeze pe infrastructură externă ( Google Cloud și hardware Nvidia) pentru unele interogări Siri, în loc să ruleze totul pe dispozitivele proprii sau pe servere Apple. Ce presupune parteneriatul Apple–Google–Nvidia Conform informațiilor citate, Apple va folosi: cipurile Nvidia Blackwell, în special Blackwell B200, pentru partea de procesare în centrele de date; modelul de inteligență artificială Gemini al Google, într-o versiune licențiată, pentru a alimenta „Siri de nouă generație”. Raportul menționează că unele întrebări adresate lui Siri ar urma să fie procesate pe Google Cloud, nu local pe iPhone/iPad și nici pe infrastructura Apple. Miza: viteză de implementare, cu un pariu pe „confidential compute” GSMArena notează că este o schimbare de strategie pentru Apple, companie cunoscută pentru dezvoltare internă sau pentru diversificarea furnizorilor. În acest caz, dependența ar fi mai pronunțată: Apple „se va baza puternic” pe cipurile Blackwell și pe Gemini. Pentru a răspunde preocupărilor de confidențialitate, raportul indică faptul că centrele de date Google vor utiliza cipuri Nvidia Blackwell B200 cu o funcție integrată de „confidential compute” (procesare confidențială), care criptează datele în timp ce sunt procesate direct pe cip. Ideea este să reducă riscurile, chiar dacă o parte din solicitări ajung pe un cloud terț. Când ar putea apărea noul Siri Prima versiune a Siri „mai inteligent” ar putea fi văzută în septembrie, potrivit aceleiași surse. Detaliile despre ce tipuri de interogări vor fi mutate în cloud și în ce proporție nu sunt precizate în materialul citat. [...]

NVIDIA mizează pe „antrenarea la scară” pentru a reduce costurile și timpul de dezvoltare în robotică, conducere autonomă și agenți virtuali, prin modele care generalizează mai bine și rulează mai eficient pe hardware-ul din teren, potrivit NVIDIA , într-o prezentare a trei lucrări de cercetare la conferința CVPR 2026 . Ideea comună a celor trei lucrări este că volume foarte mari de date (în special din simulare) și arhitecturi optimizate pot elimina cicluri repetate de antrenare și pot face sistemele mai aplicabile „din cutie” în contexte variate — un punct cu impact operațional direct pentru companiile care dezvoltă roboți sau sisteme autonome. GraspGen-X: prindere „zero-shot” pentru grippere diferite, fără reantrenare pe fiecare configurație NVIDIA prezintă GraspGen-X , descris ca primul „model fundamental” (foundation model) pentru prindere robotică „zero-shot” — adică poate propune poziții de prindere pentru obiecte și grippere pe care nu le-a mai văzut, fără a fi reantrenat pentru fiecare tip de clește. În mod uzual, arată compania, sistemele de prindere sunt specializate: o politică de control (policy) antrenată pentru un gripper cu două degete nu se transferă automat la un gripper multi-degete, ceea ce obligă la colectare de date, ajustări (fine-tuning) și validare pentru fiecare „întrupare” (embodiment) nouă. GraspGen-X încearcă să elimine acest blocaj prin antrenare pe un set masiv de date: cercetătorii au generat 2 miliarde de prinderi simulate , acoperind mii de forme de obiecte și configurații sintetice de grippere. Modelul poate fi folosit împreună cu curoboV2 , o bibliotecă de planificare a mișcării accelerată cu CUDA, pentru a executa prinderile în medii necunoscute. NVIDIA indică și o continuare a lanțului tehnologic, prin lucrarea „Grasp-MPC”, prezentată la ICRA 2026 (link în sursă). LCDrive: raționament mai rapid pentru mașini autonome, cu mai puține „tokenuri” A doua lucrare, LCDrive, vizează o limitare practică a raționamentului de tip „chain-of-thought” (pași intermediari de gândire): în varianta bazată pe text, fiecare cuvânt generat înseamnă „tokenuri” care consumă timp de calcul, iar în mașină tokenurile devin o constrângere de latență. Soluția propusă este înlocuirea raționamentului în limbaj natural cu reprezentări latente compacte (un spațiu intern de stări care comprimă informația), astfel încât sistemul să „gândească” în stări care surprind informație spațială, nu în propoziții. Arhitectura alternează între propunerea de acțiuni candidate și predicția felului în care va arăta lumea dacă acele acțiuni sunt executate, într-o buclă de rafinare. NVIDIA susține că rezultatul este o calitate comparabilă a traiectoriei față de raționamentul bazat pe text, folosind aproximativ jumătate din tokenuri . Modelul este construit pe NVIDIA Alpamayo și antrenat cu supervizare derivată din date existente de vehicule. NitroGen: antrenarea agenților „întrupați” în jocuri, la volum mare de interacțiuni A treia lucrare, NitroGen, extinde principiul din NVIDIA Isaac GR00T (model fundamental deschis pentru roboți umanoizi) către medii virtuale, folosind jocurile video ca teren de antrenament: lumi structurate, variate, cu obiective și condiții de succes bine definite. NVIDIA afirmă că NitroGen a fost antrenat pe peste 1.000 de jocuri și 40.000 de ore de interacțiune , iar agenții rezultați au fost evaluați pe mai multe genuri (de la action RPG la platformere și jocuri open-world), demonstrând comportamente precum luptă, navigație și explorare. În condiții cu puține date (când agentul vede doar câteva exemple dintr-un mediu nou), pornirea de la NitroGen ar îmbunătăți performanța cu până la 52% față de metodele anterioare de vârf, potrivit companiei. Modelul este disponibil ca open-source pe GitHub și pe Hugging Face . De ce contează pentru industrie: mai puține cicluri de antrenare, latență mai mică, generalizare mai bună Mesajul operațional al pachetului de cercetări este reducerea „fricțiunii” de implementare: de la eliminarea reantrenării pentru fiecare gripper (GraspGen-X), la raționament mai rapid pe hardware-ul din vehicul (LCDrive), până la pre-antrenarea agenților în medii virtuale diverse înainte de contactul cu lumea reală (NitroGen). NVIDIA mai indică faptul că a prezentat la CVPR și „noi abilități” pentru agenți de „AI fizic” (physical AI) menite să accelereze dezvoltarea de vehicule autonome, roboți și sisteme de viziune, cu detalii suplimentare într-un material separat (link în sursă). [...]

NVIDIA pune la dispoziția cercetătorilor „skill-uri” pentru agenți AI, ca să reducă timpul și fragmentarea din fluxurile de lucru pentru vehicule autonome, roboți și sisteme de viziune. Potrivit NVIDIA , la CVPR compania a prezentat un set de „physical AI agent skills” (capabilități reutilizabile pentru agenți software care automatizează pași de cercetare) menite să lege într-un flux unitar etape care, în mod obișnuit, sunt împărțite între instrumente diferite: reconstrucția scenelor, generarea de scenarii rare, antrenarea politicilor, evaluarea comportamentului și iterarea rapidă. De ce contează: cercetarea „physical AI” e încetinită de integrare, nu doar de modele Mesajul central este operațional: problema majoră în „physical AI” (AI care interacționează cu lumea fizică prin percepție și acțiune) nu este doar obținerea unor modele mai puternice, ci construirea unui flux complet în jurul lor. NVIDIA susține că noile skill-uri, împreună cu biblioteci și cadre de simulare, urmăresc să reducă munca de „cusut” instrumente și să accelereze experimentarea. În acest context, compania amintește și anunțul din această săptămână privind NVIDIA Cosmos 3 , descris ca un „foundation model” pentru physical AI, care unifică raționamentul vizual, generarea de lumi și generarea de acțiuni. Skill-urile sunt poziționate ca un strat care ajută la trecerea de la capabilități de model la fluxuri de lucru scalabile, end-to-end. Vehicule autonome: simulare repetabilă pentru „coada lungă” a condusului Pentru cercetarea în vehicule autonome, NVIDIA indică drept problemă „coada lungă” a condusului: interacțiuni rare, geometrii neobișnuite ale drumului, schimbări de lumină și comportamente-limită greu de colectat repetat, dar critice pentru antrenare și validare. Abordarea propusă include automatizarea reconstrucției scenelor din date de flotă și generarea de scenarii sintetice. Un exemplu este skill-ul „Neural Reconstruction”, care ar transforma date capturate de flotă în scene 3D editabile pentru simulare și generare de date sintetice, împreună cu tehnologii precum NVIDIA Omniverse NuRec și InstantNuRec. NVIDIA mai menționează: NVIDIA AlpaGym , un cadru open-source de învățare prin recompensă (reinforcement learning) în buclă închisă, conectat la simulare de fidelitate ridicată și scalare pe mii de GPU-uri; NVIDIA OmniDreams , un model generativ de lume condiționat de acțiuni, care adaugă randare fotorealistă în bucla de simulare; NVIDIA Alpamayo 2 Super , descris ca cel mai puternic model open de condus al companiei până acum: un model VLA (vision-language-action) cu 32 de miliarde de parametri, pentru raționare, planificare și acțiune „pe întregul stack” de condus, cu țintă de dezvoltare și implementare level 4. Viziune AI: generarea de exemple controlate și „anomalii” sintetice În zona de vision AI, NVIDIA spune că blocajul este lipsa unui volum suficient de exemple controlate pentru a testa cum se comportă modelele când se schimbă condițiile vizuale, starea obiectelor sau evenimentele în timp. Sunt menționate explicit direcții precum detecția de anomalii „zero-shot”, generarea de anomalii sintetice și recunoașterea defectelor cu puține exemple (few-shot). Noile „Metropolis skills” ar permite agenților AI să genereze scenarii vizuale sintetice (inclusiv anomalii), să extindă seturile de date și să sprijine pseudo-etichetarea. Pentru inspecția vizuală, publicația dă ca exemplu skill-ul „Defect Image Generation”, care creează exemple de defecte pe suprafețe diferite pornind de la imagini reale, într-un flux ce combină Isaac Sim (simulare), Cosmos 3 și NVIDIA OSMO (orchestrare). Pentru agenți video, sunt menționate Metropolis Blueprint pentru căutare și sumarizare video (VSS), NVIDIA TAO și skill-uri de augmentare video, cu scopul de a automatiza bucla „build-and-evaluate” pentru modele care detectează evenimente, raționează pe scene complexe, sumarizează activitatea și trimit alerte. Roboți: automatizarea pașilor de simulare și antrenare, inclusiv „sim-to-real” În robotică, NVIDIA pune accent pe iterație: cercetătorii au nevoie de multe medii controlate și rulări de politici (policy rollouts) pentru a înțelege cum se schimbă comportamentul robotului între sarcini și configurații, iar asta implică, de regulă, integrare manuală între simulare, variații de sarcini, antrenare și evaluare. Compania afirmă că „robotics skills” permit agenților să automatizeze pași frecvenți precum pregătirea scenei, simularea și învățarea robotului folosind biblioteci Omniverse, Isaac Sim și Isaac Lab. Sunt menționate și skill-uri specializate pentru mobilitate și manipulare, inclusiv fluxuri pentru sarcini „sim-to-sim” și „sim-to-real” (transfer din simulare către lumea reală), precum construcția mediilor, reglaje de fizică, depanare și profilare. Pentru robotică medicală, NVIDIA indică „Cosmos-H-Surgical-Simulator”, care ar genera date realiste pentru antrenare și evaluare, învățând direct din date chirurgicale reale, cu obiectivul de a reduce diferența dintre simulare și realitate. Disponibilitate și acces: instrumente pe GitHub și medii preconfigurate pe Brev NVIDIA precizează că instrumentele și skill-urile pentru agenți physical AI sunt disponibile public prin GitHub, la NVIDIA physical AI skills . Totodată, skill-uri pentru generare de date sintetice (Neural Reconstruction, Video Augmentation, Defect Image Generation) pot fi rulate și ca „Physical AI Launchables” pe NVIDIA Brev, în medii preconfigurate care rulează pe GPU-uri NVIDIA H100 și includ credite de test pentru cercetători. Separat, compania afirmă că setul său de date „NVIDIA Physical AI Dataset” a depășit 15 milioane de descărcări pe Hugging Face și anunță noi lansări de seturi de date, inclusiv GRAIL (aprox. 50 de ore de interacțiuni humanoid–obiect) și șase seturi video sintetice folosite la antrenarea Cosmos 3. [...]