Știri

Știri din categoria Inteligență artificială

Google a anunțat lansarea modelului de inteligență artificială Gemini 3.1 Pro, conceput pentru a rezolva sarcini complexe care necesită mai mult decât un răspuns simplu, relatează Blogul Google. Acest model îmbunătățit este disponibil pentru dezvoltatori, întreprinderi și consumatori prin diverse platforme, inclusiv API-ul Gemini, Vertex AI și aplicația Gemini.

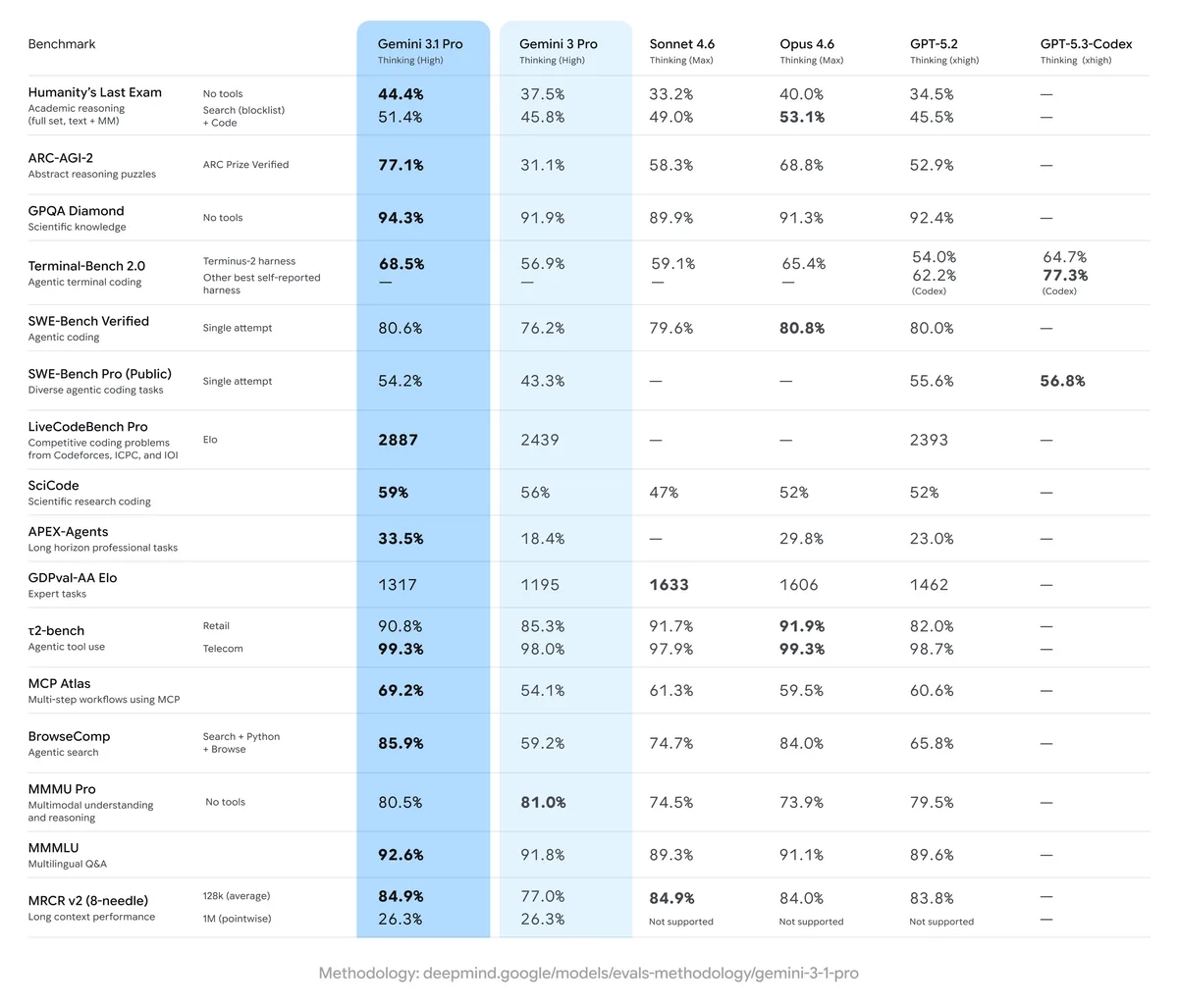

Modelul Gemini 3.1 Pro aduce progrese semnificative în capacitatea de raționament, demonstrând o performanță superioară pe benchmark-uri de rezolvare a problemelor complexe. Pe ARC-AGI-2, un test care evaluează abilitatea unui model de a rezolva tipare logice noi, Gemini 3.1 Pro a obținut un scor de 77,1%, mai mult decât dublu față de performanța versiunii anterioare, 3 Pro.

Gemini 3.1 Pro este destinat unor aplicații variate, cum ar fi:

Modelul poate genera animații SVG direct dintr-un prompt text, menținând fișierele mici și clare la orice scară. De asemenea, utilizează raționamentul avansat pentru a conecta API-uri complexe cu design-uri prietenoase pentru utilizator. Un exemplu notabil este crearea unui tablou de bord aerospațial care vizualizează orbita Stației Spațiale Internaționale.

În plus, Gemini 3.1 Pro poate transforma teme literare în cod funcțional. De exemplu, a creat un portofoliu personal modern pentru „Wuthering Heights” de Emily Brontë, capturând esența protagonistului printr-o interfață contemporană.

Google a lansat modelul Gemini 3.1 Pro în previzualizare pentru a valida actualizările și pentru a continua dezvoltarea fluxurilor de lucru agentice. Modelul este disponibil în aplicația Gemini cu limite mai mari pentru utilizatorii planurilor Google AI Pro și Ultra și pe NotebookLM exclusiv pentru acești utilizatori. Dezvoltatorii și întreprinderile pot accesa acum modelul în previzualizare prin API-ul Gemini, AI Studio, Antigravity și alte platforme.

„Nu putem aștepta să vedem ce veți construi și descoperi cu el”, a declarat echipa Gemini, subliniind entuziasmul pentru potențialul creativ și inovativ al acestui nou model.

Aceste îmbunătățiri rapide sunt rezultatul feedback-ului primit de la utilizatori și al ritmului accelerat de progres în domeniul inteligenței artificiale. Google intenționează să facă modelul Gemini 3.1 Pro disponibil pe scară largă în viitorul apropiat.

Recomandate

Inteligența artificială a devenit în SUA principalul motiv invocat pentru concedieri , după ce angajatorii au atribuit tehnologiei 40% din cele 97.006 posturi desființate în luna mai, potrivit HotNews , care citează un raport Challenger, Gray & Christmas. Miza economică este că AI nu mai apare doar ca promisiune de productivitate, ci ca justificare operațională imediată pentru reducerea costurilor cu personalul. Raportul indică faptul că este cea mai mare rată lunară de când Challenger a început, în 2023, să urmărească impactul inteligenței artificiale asupra pierderilor de locuri de muncă. În total, în 2026, 87.714 concedieri au fost atribuite AI, peste nivelul de 54.836 raportat pentru 2025. „Datele noastre arată că firmele deja acționează în acest sens, invocând inteligența artificială mai mult decât orice alt motiv pentru a face mai multe reduceri”, a declarat Andy Challenger, director de venituri la Challenger, Gray & Christmas. Concedieri la cel mai ridicat nivel din 2020, cu tehnologia în frunte Per ansamblu, Challenger a constatat că în mai 2026 s-a înregistrat cel mai mare număr de concedieri din 2020, când au fost anunțate 397.016 concedieri în vârful pandemiei. Sectorul tehnologic rămâne domeniul cu cele mai multe concedieri, „cu o marjă mare”, potrivit raportului. Cât din „vina AI” este reală: contestări din industrie și din zona macro Atribuirea concedierilor către AI este contestată inclusiv de actori din ecosistemul tehnologic. CEO-ul OpenAI, Sam Altman , a spus recent că unele firme își „spală” concedierile dând vina pe tehnologie. Separat, economistul-șef al Apollo Global Management , Torsten Sløk, a scris că nu vede „nicio dovadă a pierderilor de locuri de muncă din cauza inteligenței artificiale”, invocând Raportul național privind ocuparea forței de muncă al ADP. Alte sectoare care au redus personal în mai Dincolo de AI, raportul notează tăieri și în alte industrii: Farmaceutice : 5.045 reduceri în mai; 12.485 în primele cinci luni din 2026 (în creștere cu 753% față de 1.463 până în mai 2025). Administrații federale/statale/locale : 4.499 reduceri în mai; 15.918 în 2026 (în scădere cu 94% față de 284.827 până în mai 2025, când au predominat reducerile legate de DOGE). Media : 436 reduceri în mai; 3.390 în 2026 (minus 17% față de 4.107 în primele cinci luni ale anului trecut). În paralel, până acum în 2026, cele mai frecvente motive invocate de angajatori pentru concedieri au fost „condițiile de piață și economice” (69.645), falimentele (66.733) și „restructurarea” (52.249), ceea ce sugerează că AI se suprapune peste un context mai larg de ajustare a costurilor. Pentru detalii, raportul Challenger este disponibil aici . [...]

Google împinge cumpărăturile second-hand spre „căutare asistată de AI” , prin funcții din Search și Shopping care ajută utilizatorii să găsească produse similare, să compare prețuri și chiar să estimeze valoarea de revânzare, potrivit Google Blog . Miza practică este reducerea fricțiunii din piața de resale (revânzare) – de la descoperire și verificare, până la decizia de cumpărare sau vânzare. În contextul în care interesul de căutare pentru „vintage” și „how to thrift” a atins maxime istorice în 2026, Google își poziționează instrumentele ca „strat” de orientare pentru cumpărăturile de obiecte second-hand și vintage, inclusiv pentru căutări aflate în trend precum „vintage jersey” și „thrifted heels”. Ce se schimbă operațional pentru utilizatori: 5 funcții, un singur flux Google descrie cinci moduri prin care Search poate „ridica nivelul” cumpărăturilor de tip thrift/vintage, cu accent pe căutare vizuală și întrebări în limbaj natural: AI Mode în Search : utilizatorii pot formula întrebări detaliate pentru a-și planifica „ieșirea la thrift”, iar răspunsurile includ opțiuni și detalii relevante, plus linkuri pentru documentare. Exemplul din articol combină căutarea de „tricouri vintage” cu o condiție logistică (brunch fără gluten în apropiere). Google Lens pentru identificare și context : prin fotografierea unui obiect în magazin, Lens poate afișa potriviri vizuale și permite întrebări despre designer sau perioadă („din ce eră este?”). Tot aici apare componenta cu impact direct în tranzacție: utilizatorul poate vedea la ce preț se vinde online și câte oferte similare există, pentru a evalua dacă e „piesă rară” sau produs comun. Circle to Search (Android) : utilizatorul încercuiește un obiect văzut pe ecran, iar funcția caută rapid produse similare, prețuri și locuri de cumpărare; apoi pot urma întrebări de rafinare (de exemplu, stiluri cu „vibe” de anii ’90). Virtual Try-On : un „cabina de probă” digitală. Utilizatorul găsește un produs similar cu Lens, apasă „try it on” și încarcă o fotografie full-body pentru a vedea cum ar arăta purtat. Lens pentru vânzare din propria garderobă : Google sugerează folosirea Lens pentru a estima cât ar valora un obiect la revânzare și ce tip de magazine ar cumpăra astfel de produse („Could I resell this?”). De ce contează: mai multă transparență de preț și mai puține „achiziții la ghici” Din perspectiva pieței, setul de funcții descris de Google mută o parte din „munca” specifică second-hand (identificare, autentificare informală prin comparații, orientare de preț) în interfața de căutare. În practică, asta poate crește transparența pentru cumpărători și poate accelera decizia de achiziție sau revânzare, mai ales când utilizatorul compară rapid cu ofertele online. Google nu oferă în material date despre lansări pe piețe, disponibilitate în România sau rezultate măsurabile (de tip conversii ori economii), astfel că impactul concret depinde de accesul efectiv la aceste funcții și de cât de bine acoperă ofertele locale. [...]

Nvidia își securizează pe termen lung memoria HBM4, o piesă critică pentru livrările de acceleratoare AI , printr-un acord multianual de co-dezvoltare cu SK Hynix , într-un moment în care memoria – nu GPU-urile – a devenit principala frână pentru extinderea infrastructurii AI, potrivit The Next Web . Acordul, anunțat duminică în timpul vizitei în Coreea de Sud a CEO-ului Nvidia, Jensen Huang, acoperă atât proiectarea, cât și fabricarea memoriei de nouă generație pentru AI, inclusiv HBM4 (memorie cu lățime mare de bandă, folosită în acceleratoare) pentru platforma Vera Rubin , care intră acum în producție la scară completă. De ce contează: memoria a devenit „gâtul de sticlă” al industriei AI Publicația notează că, pe fondul cererii explozive pentru infrastructură AI, constrângerea majoră s-a mutat de la procesoare grafice la memorie. CEO-ul Arm, Rene Haas, a spus recent că memoria este „probabil cea mai dificilă” problemă de rezolvat pentru industrie. Pentru Nvidia, miza acordului nu este doar să-și asigure livrări, ci să se asigure că această capacitate de producție va exista efectiv în anii următori, într-un context în care disponibilitatea HBM este așteptată să rămână limitată cel puțin până în 2028, iar unele prognoze împing presiunea până în 2030. Ce include acordul cu SK Hynix Parteneriatul depășește un contract tipic de furnizare: Nvidia și SK Hynix vor co-dezvolta memoria de generație următoare pentru ceea ce Nvidia numește „fabrici AI” – clustere mari de centre de date folosite pentru antrenare și inferență (rulare) a modelelor. Acordul vizează, potrivit articolului, și infrastructura și zona de „AI fizic” (aplicații AI integrate în roboți și sisteme industriale), dar componenta centrală rămâne memoria proiectată pentru Vera Rubin, descrisă ca cea mai puternică platformă de acceleratoare a Nvidia. Efectul competitiv: SK Hynix își consolidează poziția în HBM4 Jensen Huang a confirmat la Computex, în Taipei, că Samsung, SK Hynix și Micron au fost aprobate să furnizeze HBM4 pentru Vera Rubin. Totuși, acordul multianual de co-dezvoltare cu SK Hynix indică o relație mai profundă decât o simplă „calificare” de furnizor. Potrivit estimărilor citate de The Next Web, SK Hynix ar avea alocat aproximativ 60%–70% din volumul de HBM4 pentru Vera Rubin, Samsung circa 25%–30%, iar Micron restul. În această logică, angajamentele pe termen lung ar putea facilita extinderea capacității SK Hynix și întărirea cotei sale în timp. Context operațional: cerințe mari de memorie și ambalare avansată Vera Rubin este descrisă ca fiind construită în jurul unor clustere de procesoare Vera și nuclee grafice Rubin, „aliate” cu terabytes de HBM4 în fiecare sistem server. Publicația menționează și o constrângere tehnologică importantă: ambalarea avansată (în special procesul CoWoS al TSMC, care integrează GPU-urile cu HBM într-un singur pachet) este un factor-cheie care limitează ritmul livrărilor. Livrările pentru Vera Rubin sunt așteptate să înceapă în trimestrul al treilea din 2026, iar producția implică peste 350 de parteneri din lanțul de aprovizionare, în 30 de țări, conform articolului. „Împreună, vom co-dezvolta următoarea generație de memorie pentru fabricile AI și vom susține expansiunea globală accelerată a infrastructurii AI”, a declarat Jensen Huang, într-un comunicat citat de publicație. Ce urmează Semnalul principal al acordului este că Nvidia încearcă să-și „blindeze” din timp componenta cea mai rară din configurațiile sale de vârf – memoria HBM – pentru a putea susține ritmul de livrare al sistemelor din generația Vera Rubin. În paralel, competiția dintre SK Hynix, Samsung și Micron se mută tot mai mult pe capacitate și pe viteza cu care pot livra stive HBM mai avansate, într-o piață în care deficitul de memorie riscă să dicteze ritmul întregii industrii AI. [...]

NVIDIA și SK hynix își leagă pe mai mulți ani dezvoltarea de memorii avansate, într-o mișcare menită să reducă riscul de blocaje de aprovizionare pe fondul extinderii „fabricilor de AI”. Parteneriatul, prezentat de NVIDIA News , aliniază co-dezvoltarea de memorii „next-generation” la foaia de parcurs a infrastructurii NVIDIA și vizează explicit susținerea capacității de livrare, într-un domeniu cu cicluri lungi de dezvoltare și investiții mari în producție. Acordul pornește de la colaborarea tehnică existentă dintre cele două companii și pune accent pe faptul că, pe măsură ce centrele de date dedicate AI se extind global, memoria avansată devine un factor critic de performanță și disponibilitate pentru platformele de calcul. În acest context, parteneriatul este descris ca un mecanism de a ține pasul cu cererea și cu ritmul de evoluție al infrastructurii NVIDIA. „Fabricile de AI sunt motoarele următoarei revoluții industriale, iar memoria avansată este esențială pentru performanța lor”, a declarat Jensen Huang, fondator și CEO al NVIDIA. Ce acoperă parteneriatul: produse și piețe vizate În cadrul acordului multianual, SK hynix ar urma să co-dezvolte memorii pentru mai multe familii de produse NVIDIA, pe segmente diferite, de la infrastructură la dispozitive: supercomputerele AI NVIDIA Vera Rubin și procesoarele NVIDIA Vera ; PC-uri cu NVIDIA RTX Spark ; platforme de calcul pentru robotică NVIDIA Jetson Thor . Publicația notează și intenția SK hynix de a se diversifica în piețe pe care NVIDIA le dezvoltă în jurul infrastructurii AI, „personal AI” și „physical AI” (AI aplicată în sisteme care interacționează cu lumea fizică). AI în proiectarea și fabricația de cipuri: simulări accelerate și „ digital twins ” O componentă operațională importantă a colaborării este folosirea AI în proiectarea și producția de semiconductori. SK hynix utilizează bibliotecile NVIDIA CUDA-X și cadrul NVIDIA PhysicsNeMo pentru a accelera simulările din zona de proiectare și fabricație, inclusiv fluxuri de lucru de tip TCAD (Technology Computer-Aided Design – simulări pentru proiectarea tehnologiilor de fabricație) și litografie computațională, precum și coduri interne de inginerie. Separat, SK hynix dezvoltă „digital twins” (gemeni digitali – replici virtuale ale fabricilor) pentru operațiuni autonome în fabrici, combinând NVIDIA Omniverse , optimizări de scene 3D prin OpenUSD și motorul de optimizare decizională NVIDIA cuOpt . În același pachet este menționată și platforma NVIDIA Metropolis , pentru analiză video inteligentă în medii industriale. De ce contează pentru piață Mesajul central al acordului este legat de securizarea și extinderea aprovizionării cu memorie avansată într-un moment în care „fabricile de AI” se construiesc și se extind rapid, iar dezvoltarea și fabricarea memoriilor de ultimă generație presupun cicluri lungi și investiții de capital ridicate. În practică, parteneriatul încearcă să reducă presiunea pe lanțul de aprovizionare și să sincronizeze mai strâns evoluția memoriei cu cerințele viitoare ale platformelor NVIDIA. Companiile mai menționează că explorează conectarea gemenilor digitali cu software-ul existent și fluxuri de lucru bazate pe „agentic AI” (sisteme AI care pot planifica și executa sarcini), pentru a automatiza activități și a îmbunătăți deciziile în producție. Materialul nu oferă însă un calendar, volume de livrare sau valori financiare ale acordului. [...]

SK Telecom vizează construirea unui AI Cloud de „scară gigawatt” în Coreea, cu prima „fabrică AI” planificată pentru 2027 , într-un parteneriat tehnologic cu NVIDIA care mizează pe eficiență energetică și cost mai mic per unitate de calcul pentru aplicații industriale și enterprise, potrivit NVIDIA News . Inițiativa folosește platforma NVIDIA DSX (o arhitectură „full-stack”, adică de la cipuri și sisteme până la software și operațiuni) ca „plan” de proiectare pentru centre de date optimizate pentru sarcini de inteligență artificială. În logica anunțului, miza este ca infrastructura să producă „token-uri” (unități de procesare folosite în modele generative) la cost cât mai redus și cu eficiență energetică ridicată, într-un context în care consumul de energie și accesul la acceleratoare (GPU) devin constrângeri operaționale majore pentru extinderea AI. Ce construiește SK Telecom și de ce contează operațional SK Telecom spune că AI Cloud-ul va susține servicii de tip „sovereign AI” (modele și date operate sub control național/organizațional), „physical AI” (AI aplicată în sisteme fizice, precum robotică și producție) și „agentic AI” (agenți software care execută sarcini), pentru companii și industrii din Coreea, cu o viziune de extindere în regiuni mai largi din Asia. Compania își bazează proiectul pe infrastructura proprie de rețea, centre de date și competențe enterprise, iar NVIDIA DSX este prezentată ca un set integrat de tehnologii care ar accelera „timpul până la producție” (cât de repede poate fi pusă în funcțiune o capacitate AI utilizabilă comercial) și ar îmbunătăți performanța raportată la energie („token performance per megawatt”). Elemente de colaborare și utilizări deja anunțate Parteneriatul este poziționat ca o extindere a colaborării dintre NVIDIA și grupul SK, inclusiv către cercetare comună pentru „arhitecturi de fabrici AI” de generație următoare, cu accent pe optimizări „de la siliciu la rețea” (cipuri, memorie și operarea centrelor de date). În paralel, SK Telecom indică proiecte conexe care conturează tipul de aplicații vizate: utilizarea „digital twins” (replici digitale ale unor procese/instalații) în fabrici de semiconductori SK hynix , pe baza bibliotecilor NVIDIA Omniverse (detalii suplimentare sunt menționate de SK Telecom aici: https://news.sktelecom.com/en/3077 ); adoptarea seturilor de date open-source NVIDIA Nemotron pentru antrenarea modelului A.X K1, în cadrul proiectului guvernamental coreean „Sovereign AI Foundation Model Project”. Totodată, SK Telecom urmează să devină „NVIDIA Cloud Partner”, adică parte dintr-un program global prin care furnizorii folosesc infrastructura și ecosistemul NVIDIA pentru a livra servicii AI în cloud. Ce urmează Calendarul explicit din anunț indică drept reper punerea în funcțiune a primei „fabrici AI” în 2027 . Dincolo de acest termen, materialul nu oferă detalii despre investiții, capacitate instalată (în GPU) sau clienți contractați, astfel că impactul economic nu poate fi cuantificat pe baza informațiilor publicate acum; accentul rămâne pe arhitectura tehnică și pe ținta de scalare la nivel „gigawatt”. [...]

NAVER își extinde infrastructura de „sovereign AI” de la 55 MW spre scară de gigawați , mizând pe platforma NVIDIA DSX pentru a proiecta și opera „fabrici de AI” (centre de date optimizate pentru antrenare și rulare de modele) într-un moment în care cererea globală pentru servicii AI trece tot mai mult din faza de test în producție, potrivit NVIDIA News . Extinderea începe cu creșterea infrastructurii la GAK Sejong , un centru de date hyperscale din Sejong, Coreea de Sud, descris ca fiind proiectat pentru densități mari de calcul accelerat (hardware specializat pentru AI), cu operațiuni eficiente energetic, automatizare avansată, funcții de sustenabilitate și capabilități de răspuns la dezastre. Obiectivul declarat este să poată deservi companii, industrii și instituții publice, inclusiv clienți globali ai diviziei de AI cloud. De ce contează: energia și „costul pe token” devin criterii de competitivitate Mesajul central al proiectului este trecerea la o infrastructură dimensionată în megawați și, ulterior, în gigawați, într-o industrie în care costul de operare al AI este tot mai strâns legat de consumul energetic și de eficiența cu care centrele de date pot produce „tokeni” (unități de text generate/procesate de modele). NVIDIA susține că DSX oferă un „blueprint” (plan standardizat) de fabrică de AI care urmărește reducerea costului pe token și scurtarea timpului până la primele implementări în producție. În această logică, NAVER își poziționează infrastructura ca alternativă „de încredere” pentru guverne și companii care au cerințe de conformitate locală și suveranitate a datelor, în special pe piețe unde astfel de condiții sunt decisive în achiziția de servicii cloud. Ce construiește NAVER și unde se vede impactul operațional Planul anunțat vizează: construirea de „AI factories” pe platforma NVIDIA DSX™ la scară de gigawați, pornind de la 55 MW; extinderea cloudului bazat pe DSX în jurul centrului de date GAK Sejong; folosirea unei suite „full-stack” NVIDIA (platforme, modele și software) pentru modele regionale și servicii de tip „agentic AI” (sisteme care pot executa sarcini în mod autonom, pe baza unor obiective). Publicația mai precizează că NAVER combină DSX cu experiența proprie în operarea de clustere GPU la scară mare și centre de date hyperscale, cu intenția de a accelera și businessul său de centre de date pentru AI. Legătura cu produsele AI: HyperCLOVA X, agenți și „world model” Pe partea de modele și aplicații, NAVER spune că își avansează modelele HyperCLOVA X prin ajustarea (fine-tuning) modelului deschis NVIDIA Nemotron™ 3 Ultra cu date proprietare și expertiză proprie de antrenare, pentru a obține un model mai adaptat cultural și lingvistic. În plus, compania este prezentată ca prima din Coreea care participă în NVIDIA Nemotron Coalition (anunțată de NVIDIA pe blogul companiei, aici: NVIDIA Nemotron Coalition ) și afirmă că intenționează să lanseze o platformă de agenți AI în Coreea în a doua jumătate a anului, bazată pe „blueprints” NVIDIA NemoClaw™ . Separat, NAVER dezvoltă un „Seoul World Model” folosind date urbane proprietare și tehnologie de modelare spațială, pe baza NVIDIA Cosmos™ . Ce urmează Conform anunțului, extinderea pornește de la 55 MW și are ca direcție trecerea la scară de gigawați, cu DSX ca platformă de proiectare și operare a fabricilor de AI. Materialul nu oferă un calendar detaliat sau investiții estimate, dar indică faptul că NAVER își aliniază infrastructura la cererea în creștere pentru AI „în producție”, inclusiv pentru clienți din afara Coreei, în contexte unde suveranitatea datelor și conformitatea locală sunt criterii de selecție. [...]