Știri

Știri din categoria Inteligență artificială

OpenAI a extins capabilitățile de generare de imagini din ChatGPT, adăugând căutare online și posibilitatea de a crea până la 8 imagini coerente dintr-un singur prompt, o schimbare care poate reduce semnificativ timpul și costul de producție pentru serii vizuale (benzi desenate, postări în social media, randări de design), potrivit IT之家.

Noul instrument se numește ChatGPT Images 2.0 și este construit pe modelul GPT Image 2. Principala noutate este introducerea unei „capacități de gândire” (în sensul descris de OpenAI ca raționare înainte de generare), care permite sistemului să planifice structura imaginii înainte de a o produce.

Conform descrierii citate, atunci când utilizatorul activează „gândirea”, generatorul de imagini poate:

Funcția este disponibilă în acest moment pentru abonații ChatGPT Plus, Pro, Business și Enterprise.

În zona de generare multi-imagine, Images 2.0 poate produce dintr-o singură comandă până la 8 imagini. Elementul cu impact practic este că sistemul poate păstra consecvența personajelor, obiectelor și a stilului în scene diferite, ceea ce vizează direct fluxurile de lucru în care utilizatorii au nevoie de „cadre” multiple din aceeași poveste vizuală.

OpenAI susține că această consistență reduce pragul de dificultate pentru:

Pe partea de calitate, noua versiune suportă rezoluție de până la 2K și extinde raportul de aspect până la 3:1 și 1:3. Totodată, sunt menționate optimizări pentru stiluri precum pixel art, benzi desenate și cadre „cinematografice”.

La capitolul multilingv, instrumentul îmbunătățește generarea de text în chineză, japoneză, coreeană, hindi și bengaleză. (Sursa nu oferă detalii despre performanță sau metrici de evaluare pentru aceste îmbunătățiri.)

Recomandate

Meta își extinde supravegherea internă a muncii pentru a genera date de antrenare IA , printr-un instrument care va rula pe computerele și aplicațiile interne și va înregistra activitatea angajaților, inclusiv tastele apăsate și clicurile de mouse, potrivit G4Media . Miza operațională este dublă: compania își accelerează dezvoltarea de inteligență artificială folosind date „din producție”, dar crește și presiunea asupra angajaților într-un moment în care sunt așteptate noi reduceri de personal. Instrumentul a fost comunicat angajaților marți și, conform informațiilor din material, va înregistra activitatea din sistemele interne pentru a fi folosită ca set de date la antrenarea tehnologiei de inteligență artificială. BBC a aflat că activitatea angajaților pe un computer Meta ar fi fost accesibilă companiei și înainte, însă utilizarea explicită a urmăririi și înregistrării în scop de instruire și îmbunătățire a instrumentelor IA este elementul nou. Ce se schimbă în practică Din descrierea din articol, noul instrument ar urma să ruleze pe: computerele angajaților Meta; aplicațiile interne ale companiei, și să înregistreze activitatea acestora pentru a o transforma în date de antrenare pentru modele de inteligență artificială. Reacțiile interne citate de BBC indică tensiuni: un angajat care a cerut anonimatul a descris situația drept „foarte distopică”, iar o persoană care a părăsit recent compania a spus că este „doar cea mai recentă modalitate prin care ne impun IA pe gât”. Context: reduceri de personal și înghețarea angajărilor Schimbarea vine pe fondul restructurărilor. Meta a concediat deja aproximativ 2.000 de angajați în acest an, în valuri mai mici, iar angajații se așteaptă la pierderi de locuri de muncă mai mari în lunile următoare, conform articolului. Totodată, luna trecută compania a adoptat o înghețare parțială a angajărilor, care „pare să aibă o amploare mai mare”: site-ul de recrutare folosit de Meta afișa aproximativ 800 de anunțuri în martie, iar acum promovează doar șapte. Un purtător de cuvânt al Meta a refuzat să comenteze eliminarea anunțurilor sau planurile de reduceri, potrivit materialului. De ce contează pentru business Din perspectivă operațională, Meta încearcă să-și alimenteze rapid proiectele de inteligență artificială cu date generate din activitatea internă, într-un moment în care Mark Zuckerberg s-a angajat să crească cheltuielile pentru IA în acest an și să poziționeze compania în fruntea tehnologiei. În același timp, măsura amplifică riscurile de climat intern și de retenție a talentelor, mai ales pe fondul concedierilor și al înghețării angajărilor descrise în articol. [...]

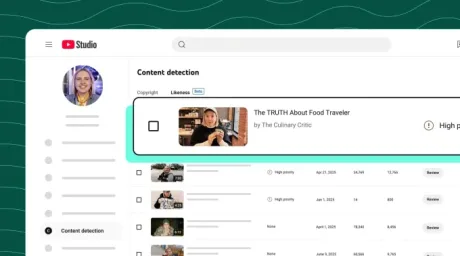

YouTube extinde un instrument de detectare a „asemănării” pentru a limita deepfake-urile cu celebrități , într-o mișcare cu impact operațional direct asupra modului în care platforma gestionează conținutul generat cu inteligență artificială, potrivit Android Authority . Noua extindere le oferă acces la funcție agențiilor de talente, companiilor de management și celebrităților, care vor putea cere eliminarea clipurilor ce le folosesc imaginea fără acord. Miza este reducerea răspândirii videoclipurilor care imită persoane reale prin tehnici de tip deepfake (conținut audio-video generat sau modificat cu ajutorul IA pentru a reproduce chipul ori vocea cuiva). YouTube spune că problema „furtului de identitate” prin IA este în creștere, iar extinderea instrumentului ar putea diminua semnificativ astfel de materiale pe platformă. Cum funcționează „likeness detection” și ce se schimbă pentru utilizatori Instrumentul este descris ca funcționând într-un mod similar cu Content ID (sistemul YouTube care identifică materiale protejate de drepturi de autor), însă în loc să caute potriviri de conținut, scanează platforma după materiale generate de IA care folosesc „asemănarea” unei persoane participante la program. Dacă utilizatorul identifică un videoclip care îi folosește imaginea fără aprobare, poate solicita eliminarea acelui conținut. Extinderea către industria de divertisment înseamnă, practic, că: agențiile de talente , companiile de management , celebritățile vor putea utiliza acest mecanism pentru a depista și raporta clipuri care le folosesc neautorizat chipul sau vocea. Context: extinderi succesive din 2024 până în prezent Funcția a fost anunțată inițial în 2024, când un grup restrâns de utilizatori a primit posibilitatea de a semnala și cere eliminarea conținutului generat de IA care le imită fața sau vocea. Ulterior, „mai devreme anul acesta”, YouTube a extins accesul la instrument și pentru oficiali guvernamentali, jurnaliști și candidați politici . YouTube a comunicat extinderea într-o postare pe blogul companiei, disponibilă aici: YouTube Blog . [...]

YouTube extinde către industria de divertisment un instrument de detectare a feței și vocii, care le permite persoanelor vizate să ceară rapid eliminarea conținutului „deepfake” (falsuri generate cu inteligență artificială), într-o mișcare ce poate schimba modul în care sunt gestionate identitatea digitală și riscurile operaționale pe platformă, potrivit IT之家 . Tehnologia funcționează similar cu sistemul Content ID al YouTube, folosit pentru identificarea muzicii și a fragmentelor video protejate de drepturi de autor. Diferența este că noul instrument nu „scanează” melodii sau secvențe din filme, ci urmărește potriviri legate de trăsături faciale și amprente vocale, pentru a identifica materiale audio-video generate de AI care copiază aspectul sau vocea unei alte persoane. Când sistemul marchează un posibil conținut potrivit, persoana afectată poate verifica materialul și poate solicita eliminarea lui. Miza, în logica platformei, este reducerea dependenței de raportările obișnuite, care tind să fie mai lente, și oferirea unei căi mai directe de protecție pentru „identitatea digitală” a celor vizați. Cine poate folosi instrumentul și ce se schimbă operațional YouTube spune că accesul nu este limitat la creatorii de conținut: actorii, artiștii și alți profesioniști din divertisment pot utiliza instrumentul chiar dacă nu dețin sau nu administrează un canal pe YouTube. Platforma a început să testeze măsura încă din 2024, inițial cu un grup restrâns. Ulterior, la începutul acestui an, utilizarea a fost extinsă și către oficiali guvernamentali, candidați politici și jurnaliști. Parteneriate pentru calibrarea sistemului Pentru optimizarea instrumentului, YouTube a lucrat cu mai multe agenții și firme de management din industrie, inclusiv CAA, UTA, WME și Untitled Management, conform aceleiași surse. [...]

Google a adus în România Pomelli, un instrument de marketing cu inteligență artificială pentru afaceri mici , care poate genera rapid materiale de „brand” – de la imagini cu produse până la campanii pentru rețele sociale – reducând munca necesară pentru producția de conținut, potrivit Știrile ProTV . Pomelli este disponibil „începând din aceste zile” și în alte piețe europene (Uniunea Europeană, Norvegia, Elveția și Marea Britanie). Instrumentul funcționează, deocamdată, în limba engleză, inclusiv la nivelul interfeței, însă utilizatorii pot edita și adapta conținutul pentru română. Ce schimbă pentru micile afaceri: producția de conținut devine un proces automatizat Platforma este prezentată ca un ajutor pentru firmele mici care nu au echipe dedicate de marketing sau bugete consistente pentru creație, dar au nevoie de materiale coerente de comunicare. Pomelli automatizează procesul în trei pași: Analiză : scanează site-ul companiei pentru a identifica detalii despre afacere, precum comunicarea de brand, mesajele, fonturile și culorile; Generare de propuneri : sugerează idei de conținut personalizat și campanii, iar utilizatorul poate explora opțiunile și prin comenzi conversaționale; Creație : generează imagini și clipuri video „de înaltă calitate” pentru social media, site sau reclame, care pot fi editate și descărcate direct. Limitări și disponibilitate În forma actuală, Pomelli generează text doar în engleză , ceea ce înseamnă că firmele care comunică preponderent în română vor avea un pas suplimentar de lucru: traducerea și adaptarea mesajelor. Instrumentul are și o versiune mobilă , optimizată pentru utilizarea de pe telefon, ceea ce îl face mai ușor de folosit în activitatea de zi cu zi a antreprenorilor și a echipelor mici. Pomelli a fost creat ca experiment de Google Labs , în parteneriat cu Google DeepMind , mai notează materialul. [...]

Posibila numire a lui John Ternus la conducerea Apple ar muta accentul strategiei AI spre dispozitive , nu doar spre modele și servicii, iar asta poate conta direct în competiția cu rivalii care împing masiv „AI în cloud”, potrivit unei analize publicate de CNET . Textul pornește de la ideea că un CEO cu profil puternic de „hardware” (adică orientat spre proiectarea și integrarea componentelor și a produsului final) ar putea fi un avantaj pentru planurile Apple în inteligență artificială, tocmai pentru că diferențiatorul companiei a fost istoric combinația strânsă dintre dispozitive, software și servicii. De ce contează pentru AI: controlul asupra „cutiei” în care rulează tehnologia În logica CNET, AI-ul Apple are mai multe șanse să se distingă dacă este împachetat în produse și funcții care rulează eficient pe dispozitivele companiei, unde Apple controlează atât arhitectura hardware, cât și sistemele de operare. Un lider format în zona de hardware ar înclina natural spre această abordare: optimizare la nivel de dispozitiv, integrare și livrare de funcții AI ca parte din experiența produsului. Această direcție ar putea susține o strategie în care AI-ul nu este perceput ca un „add-on” (o funcție adăugată ulterior), ci ca o componentă proiectată împreună cu produsul. Limitările informației din sursă Materialul CNET este un comentariu/analiză și nu oferă, în fragmentul disponibil, detalii operaționale verificabile despre un plan concret de implementare, termene sau investiții. De asemenea, nu sunt prezentate cifre sau indicatori financiari care să permită o evaluare a impactului economic pe termen scurt. În consecință, concluzia rămâne una de interpretare editorială: un CEO „de hardware” ar putea fi potrivit pentru o strategie AI centrată pe dispozitive, însă direcția efectivă depinde de deciziile companiei și de execuție. [...]

Băncile europene ar putea primi în zilele următoare acces la modelul IA „Mythos”, dar implementarea vine cu riscuri de securitate cibernetică și cu presiune din partea autorităților de reglementare pentru controale mai stricte, potrivit Agerpres , care citează informații Reuters. Extinderea accesului la „Mythos”, modelul de inteligență artificială al start-up-ului american Anthropic , ar urma să vizeze bănci din Europa și Marea Britanie, într-un moment în care instituțiile financiare încearcă să țină pasul cu rivalii din SUA, care au primit deja acces inițial la tehnologie. Ce se știe despre calendar și condițiile de acces Surse apropiate dosarului au indicat că accesul pentru băncile europene ar putea fi acordat „în câteva zile”, însă o altă estimare menționează că implementarea ar putea dura „zile sau săptămâni”. Procesul include verificări pentru a se asigura că modelul este implementat în siguranță, potrivit uneia dintre surse. Bloomberg a relatat anterior că Anthropic va oferi în curând acces la „Mythos” pentru instituții financiare din Marea Britanie. De ce contează: avertismente pe zona de securitate și atenție sporită a regulatorilor Experți în securitate cibernetică avertizează că „Mythos” ridică provocări importante pentru industria bancară și pentru sistemele tehnologice existente, context în care au apărut avertismente din partea organismelor de reglementare și a decidenților prezenți la reuniunea de primăvară a Fondului Monetar Internațional. Pe fondul acestor preocupări, autoritățile de reglementare se grăbesc să evalueze riscurile de securitate cibernetică asociate noului model de inteligență artificială, în timp ce băncile încearcă să recupereze decalajul față de instituțiile care au intrat mai devreme în testare. Cine are deja acces și cum s-a făcut selecția Anthropic a oferit inițial acces la „Mythos” partenerilor din inițiativa „Project Glasswing” și altor aproximativ 40 de organizații care dezvoltă sau întrețin infrastructură software critică. Dintre bănci, JPMorgan Chase (parte din inițiativa Glasswing) este singura instituție despre care Anthropic a spus public că are acces la „Mythos”. În același timp, Bank of America a fost în Glasswing încă de la început și a testat intern tehnologia, potrivit unei surse citate. Presiune pentru „teren de joc” egal în industrie Joachim Nagel, președintele Bundesbank (Banca Centrală a Germaniei), a cerut ca toate instituțiile să aibă acces la „Mythos” pentru a asigura condiții concurențiale echitabile și pentru a evita utilizarea abuzivă a modelului. [...]