Știri

Știri din categoria Inteligență artificială

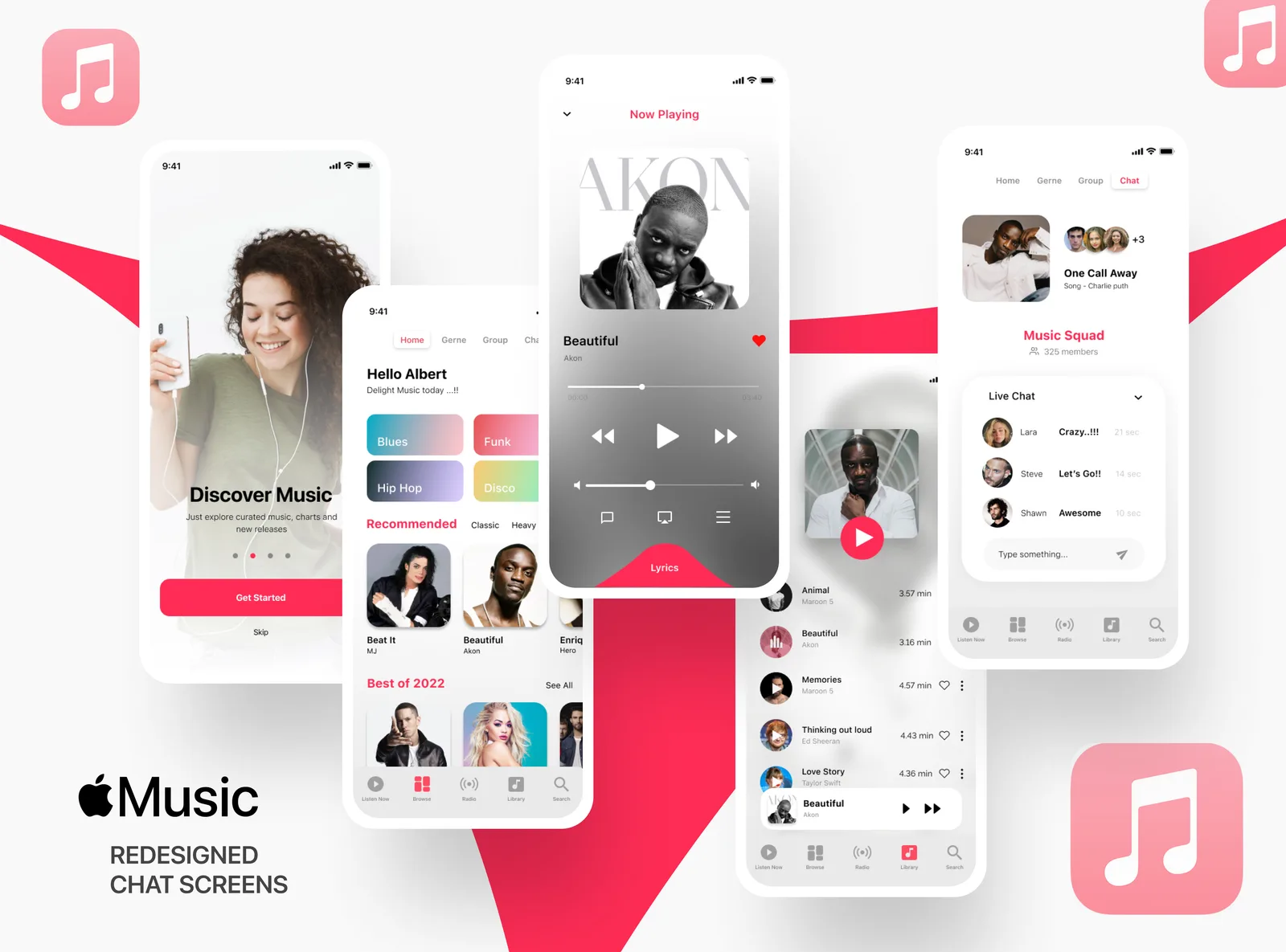

Apple a demonstrat că un model de inteligență artificială open-source, ajustat cu ajutorul feedbackului direct al designerilor, poate depăși performanța GPT-5 în generarea de interfețe grafice (UI). Studiul, publicat pe platforma de cercetare a companiei, schimbă radical modul în care este colectat feedbackul uman pentru antrenarea modelelor de limbaj: în loc de metode tradiționale precum sistemele de notare sau alegerile între variante, cercetătorii au folosit intervenții directe ale designerilor în interfețele generate de AI.

Cercetarea s-a bazat pe interacțiunile a 21 de designeri profesioniști care au oferit corecturi folosind metode proprii de lucru: schițare vizuală pe interfață, comentarii naturale și modificări directe în software-ul de design. Aceste acțiuni au generat 1.460 de exemple de preferințe între variante de UI, transformate apoi în date pentru antrenarea unui model AI.

Evaluatorii independenți au fost de acord cu intervențiile designerilor în 76,1% din cazuri și cu schițele vizuale în 63,6%, în timp ce acordul cu alegerile bazate doar pe clasificare a fost de doar 49,2%, practic echivalent cu șansa. Astfel, cercetătorii au concluzionat că datele generate prin metode de lucru naturale sunt semnificativ mai consistente și utile pentru AI decât evaluările formale.

Folosind aceste date, echipa Apple a antrenat un model open-source, Qwen2.5-Coder, aplicând o tehnică proprie de optimizare numită ORPO. Rezultatul a fost remarcabil: modelul a depășit toate bazele de comparație, inclusiv GPT-5, în evaluări realizate de oameni în format „arena” – în care mai mulți evaluatori compară răspunsuri fără să știe ce model le-a generat. Performanța confirmă că modelele mai mici, dar fin ajustate, pot întrece sisteme mai mari și mai complexe, dacă sunt instruite cu date de calitate superioară.

Studiul atrage atenția și asupra costurilor: o revizuire completă a unei interfețe de către un designer a necesitat în medie 3,45 minute, față de doar 12 secunde pentru o evaluare clasică prin alegere. Ca soluție de compromis, schițele vizuale au oferit o combinație eficientă: feedback scurt, dar profund, cu o medie de doar 42 de caractere de explicație per intervenție.

Modelul antrenat de Apple este disponibil public pe GitHub, ceea ce deschide oportunități pentru comunitatea de cercetare și pentru companiile care vor să integreze astfel de sisteme în produse comerciale.

Recomandate

DeepSeek a lansat modelul open-source V4, mizând pe eficiență de cost ca avantaj competitiv , într-un moment în care accesul la cipuri avansate și costurile de antrenare rămân o barieră majoră pentru dezvoltarea de inteligență artificială. Potrivit South China Morning Post , compania spune că noul său model fundamental (foundation model) este „competitiv” cu modele americane închise, precum cele ale OpenAI și Google DeepMind. DeepSeek descrie V4 drept un model „cost-eficient” și cu „eficiență de nivel lider mondial”, poziționându-l ca alternativă la modelele proprietare (closed-source), care nu își publică integral codul și detaliile tehnice. În același timp, faptul că V4 este open-source sugerează o strategie de accelerare a adopției prin comunitate și integrare mai ușoară în produse și servicii. Un element important de context este sprijinul anunțat de Huawei , care, potrivit aceleiași surse, a promis „sprijin total” prin noi cipuri. Mesajul indică o încercare de a consolida un lanț tehnologic intern – modele AI plus hardware – într-o perioadă în care competiția globală se poartă tot mai mult pe costuri, eficiență și disponibilitatea infrastructurii de calcul. De ce contează: costul devine o armă în cursa AI Relevanța economică a anunțului ține de faptul că „eficiența” și „cost-eficiența” sunt prezentate ca diferențiatori principali într-o piață dominată de modele foarte scumpe de antrenat și operat. Dacă afirmațiile DeepSeek privind competitivitatea cu OpenAI și Google DeepMind se confirmă în utilizare, V4 ar putea: reduce costul de intrare pentru companii care vor să construiască aplicații pe modele avansate; crește presiunea concurențială asupra furnizorilor de modele închise, printr-o alternativă open-source; accelera adoptarea în ecosisteme care preferă controlul local asupra tehnologiei și datelor. Ce se știe și ce rămâne neclar Articolul notează că DeepSeek „spune” că V4 este competitiv cu modele de top din SUA, însă în fragmentul disponibil nu apar rezultate detaliate de evaluare (benchmark-uri) sau date tehnice care să permită o comparație independentă. În lipsa acestor informații, impactul real va depinde de performanța în implementări concrete și de cât de repede va fi preluat modelul de dezvoltatori și companii. [...]

Parteneriatul Apple–Google intră în faza operațională: Siri va rula pe Gemini , iar mutarea poate schimba rapid capabilitățile „Apple Intelligence” încă din acest an, cu implicații directe asupra infrastructurii cloud folosite de Apple, potrivit GSMArena . Confirmarea vine de la Google, făcută pe scenă la conferința Cloud Next 2026 din Las Vegas. Thomas Kurian, șeful Google Cloud, a spus că Google colaborează cu Apple „ca furnizor cloud preferat” pentru a dezvolta „următoarea generație de Apple Foundation Models” bazate pe tehnologia Gemini, iar aceste modele „vor alimenta viitoare funcții Apple Intelligence, inclusiv un Siri mai personalizat, care va veni mai târziu în acest an”. Ce se știe despre calendar Informația completează confirmarea anterioară a Apple, care anunțase încă din ianuarie că modelele Gemini vor sta la baza următoarei evoluții Apple Intelligence. Potrivit publicației, Apple ar urma să prezinte noutățile în iunie, la Worldwide Developers Conference (WWDC) , iar lansarea către utilizatori este așteptată în toamnă, odată cu iOS 27 și iPadOS 27. De ce contează: unde va rula, de fapt, AI-ul Rămâne neclar dacă modelele Gemini folosite de Apple vor rula pe serverele Google sau prin Apple Private Cloud Compute (infrastructura proprie Apple pentru procesare în cloud cu accent pe confidențialitate). Această decizie are consecințe practice pentru: dependența operațională de un furnizor extern de cloud (Google) versus rulare în cloud-ul Apple; controlul asupra datelor și procesării , în funcție de arhitectura aleasă; viteza de livrare și scalarea funcțiilor de inteligență artificială în ecosistemul Apple. Context: Siri a fost întârziat din cauza acurateții Siri „revizuit” era inițial așteptat anul trecut, apoi a fost amânat pentru această primăvară, însă Apple ar fi întâmpinat probleme de acuratețe. Clarificările privind implementarea și detaliile tehnice sunt așteptate la începutul lui iunie, odată cu WWDC. [...]

Google mută masiv munca de programare către IA, iar inginerii ajung să supervizeze codul : în prezent, 75% din codul scris pentru propriile produse este generat de inteligența artificială, potrivit Profit . Schimbarea contează operațional pentru o companie care dezvoltă la scară globală, pentru că redefinește rolul echipelor tehnice și ritmul de livrare al produselor. În acest model, inginerii software care nu mai scriu efectiv cod au rolul de a superviza codul produs de IA, pe măsură ce tehnologia „devine din ce în ce mai bună la programare”, notează publicația. Un exemplu invocat de CEO-ul Google, Sundar Pichai , indică impactul asupra vitezei de execuție: o migrare de cod „deosebit de complexă”, realizată cu „agenți” (instrumente software bazate pe IA care execută sarcini) și ingineri lucrând împreună, ar fi fost finalizată de șase ori mai repede decât era posibil cu un an în urmă, când procesul se baza doar pe ingineri. „Recent, o migrare de cod deosebit de complexă, realizată de agenți și ingineri care au lucrat împreună, a fost finalizată de șase ori mai repede decât era posibil acum un an doar cu ingineri”, spune Sundar Pichai. Ce se schimbă în practică Din informațiile prezentate, tranziția are două efecte directe în organizație: o parte semnificativă din scrierea codului este transferată către IA (75% din total, conform Google); rolul inginerilor se mută spre control, verificare și coordonare a codului generat automat, nu doar spre implementare manuală. Articolul nu oferă detalii despre ce produse sau ce tipuri de proiecte sunt incluse în acest procent și nici despre modul în care Google măsoară „codul scris” de IA, astfel că amploarea exactă pe echipe și arii rămâne neprecizată în materialul citat. [...]

Senatoarea democrată Elizabeth Warren avertizează că finanțarea tot mai îndatorată și mai puțin transparentă a companiilor de inteligență artificială ar putea transforma o eventuală „spargere” a bulei AI într-un șoc cu efecte sistemice, comparabil cu 2008 , potrivit IT Home . Warren a vorbit miercuri, la Washington, în cadrul unui eveniment organizat de Vanderbilt Policy Accelerator , unde a spus că vede „asemănări uimitoare” între dinamica actuală din AI și mecanismele care au precedat criza financiară din 2008. Ea a amintit că, după criza de atunci, a avut un rol în promovarea înființării unei noi agenții de supraveghere a protecției consumatorilor în zona financiară. De ce contează: datoria și finanțarea „în umbră” pot amplifica riscul În evaluarea senatoarei, deși AI are „un potențial uriaș”, multe companii din sector „ard” capital și își cresc expunerea prin îndatorare, împingând industria spre o zonă de risc. Problema centrală, în logica ei, este decalajul dintre ritmul de creștere și ritmul cheltuielilor: veniturile nu țin pasul cu investițiile, iar companiile ajung să caute bani în canale mai puțin transparente. Warren a indicat explicit orientarea către fonduri de credit privat (private credit) ca alternativă la finanțarea bancară tradițională, subliniind că aceste surse nu sunt supravegheate la fel de strict ca băncile. Într-un astfel de cadru, dacă firmele din AI nu reușesc „foarte rapid” să-și crească veniturile, ar putea să nu poată susține povara datoriilor, iar „unele practici contabile discutabile” ar putea accelera pierderea încrederii. Mecanismul de contagiune invocat: legături cu bănci locale, asigurări și pensii Un element pe care Warren îl consideră și mai periculos este interconectarea finanțării AI cu alte surse de capital din economie. Ea a spus că modul de finanțare a ajuns să lege soarta companiilor de AI de actori precum: bănci locale; fonduri de asigurări; fonduri de pensii. În această analogie, dacă „alpinistul” (sectorul AI) cade, poate trage după el și alte părți conectate prin aceeași „coardă”, ceea ce ar putea destabiliza piețele financiare și, în scenariul ei, ar putea duce la o criză de tip 2008. Ce cere Warren: intervenție rapidă a Congresului și un nou regulator digital Senatoarea a susținut că Congresul ar trebui să intervină rapid și a propus înființarea unui nou organism de reglementare digitală, cu atribuții în aplicarea legislației privind concurența (antitrust), confidențialitatea și protecția consumatorilor. Totodată, Warren a cerut ca, în cazul în care sectorul AI intră în dificultate, Congresul să nu intervină cu măsuri de salvare (bailout), insistând asupra ideii de responsabilizare. „Tăiați coarda. Nu lăsați AI să se lege de această coardă.” [...]

Inteligența artificială ar putea consolida rolul iPhone ca „hub” de date personale, nu să-l înlocuiască , susține CEO-ul Perplexity, Aravind Srinivas , într-o intervenție citată de CNMO . Ideea centrală: pe măsură ce AI devine mai capabilă și are nevoie de „context real”, valoarea datelor personale stocate pe telefon crește, iar dispozitivul care le găzduiește devine mai greu de substituit. Srinivas folosește metafora „pașaportului digital” pentru a descrie iPhone-ul: un loc unde se adună plăți, identitate, date de sănătate, comunicare, fotografii și amintiri private. În opinia sa, acest tip de date, aflate deja pe dispozitiv, reprezintă un avantaj pe care companii precum OpenAI sau Google nu îl au în aceeași formă, iar evoluția AI amplifică importanța acestui „depozit” personal. De ce contează: mutarea sarcinilor AI pe dispozitiv poate schimba competiția În discuția despre percepția că Apple ar fi în urma OpenAI și Google în cursa AI, Srinivas nu neagă diferența, dar mută accentul pe trei elemente: hardware, confidențialitate și controlul datelor. El indică Apple Silicon drept un „activ subestimat”, care ar deveni tot mai relevant dacă sarcinile de lucru ale AI (workload-uri) se mută treptat local, pe dispozitiv, în loc să fie rulate pe servere. În acest scenariu, „buclele” de lucru ale unor agenți AI (sisteme care execută sarcini în lanț, semi-autonom) ar ajunge să ruleze local și să se lege direct de resursele din telefon: fișiere, aplicații, mesaje, e-mail, notițe și fotografii. Implicația operațională este că avantajul nu ar mai sta doar în modelul AI „din cloud”, ci și în integrarea strânsă dintre cip, sistemul de operare și datele personale. Confidențialitatea, ca avantaj competitiv acumulat O a doua linie de argumentație este confidențialitatea. Srinivas spune că, pentru a oferi ajutor mai „profund”, AI va avea nevoie de acces la date tot mai sensibile, iar reputația Apple construită în jurul protecției vieții private ar putea deveni un avantaj „invizibil” în adoptarea unor astfel de funcții. El menționează și perspectiva ca John Ternus să devină viitor CEO Apple, apreciind contribuția acestuia în tranziția către Apple Silicon și sugerând că investițiile viitoare în cipuri (inclusiv la 2 nanometri) ar întări poziționarea Apple pentru rularea locală a unor agenți AI „mai privați”. Limita argumentului: Apple nu are încă un model AI de vârf comparabil CNMO notează și o rezervă prezentă în presa internațională: deși Apple are o integrare puternică hardware–software–date personale, compania nu a prezentat până acum un model AI de ultimă generație care să concureze direct cu OpenAI sau Google, iar Siri rămâne în urmă față de noile sisteme conversaționale. În esență, miza nu este dacă AI „omoară” iPhone-ul, ci dacă Apple poate transforma avantajele de dispozitiv, date și confidențialitate într-o ofertă AI competitivă, pe măsură ce tot mai multe funcții se mută din cloud pe telefon. [...]

Meta taie circa 10% din personal pentru a finanța investițiile masive în infrastructura de inteligență artificială , într-o mișcare de eficientizare care vine pe fondul creșterii accelerate a cheltuielilor de capital ale companiei, potrivit CNN . Compania a transmis că va concedia aproximativ 10% din forța de muncă, adică în jur de 8.000 de oameni. În paralel, Meta închide circa 6.000 de posturi deschise, a scris Janelle Gale, directorul de resurse umane, într-un memo publicat de Bloomberg și confirmat ulterior de Meta pentru CNN. Concedierile urmează să intre în vigoare pe 20 mai. „Facem asta ca parte a efortului nostru continuu de a conduce compania mai eficient și pentru a ne permite să compensăm celelalte investiții pe care le facem”, a scris Gale. De ce contează: costurile cu AI urcă, iar Meta caută spațiu în buget Decizia vine în contextul în care Meta, asemenea altor giganți tech, își majorează puternic bugetele pentru AI. Compania a cheltuit 72,2 miliarde de dolari (aprox. 325 miliarde lei) pe cheltuieli de capital în 2025, în principal pentru centre de date și infrastructură necesară AI. Pentru 2026, Meta a indicat în raportarea din ianuarie că se așteaptă ca suma să crească la cel puțin 115 miliarde de dolari (aprox. 518 miliarde lei). CNN notează și că Meta investește în recrutare pentru laboratorul său de „superinteligență” și a cumpărat startup-uri de AI precum Moltbook și Manus, în încercarea de a concura cu OpenAI și alți jucători. Semnal operațional: AI schimbă structura echipelor Mark Zuckerberg a sugerat la începutul anului că investițiile în AI ar putea aduce modificări ale forței de muncă. În conferința cu investitorii din ianuarie, el a numit 2026 „anul în care AI începe să schimbe dramatic felul în care lucrăm”. „Începem să vedem proiecte care înainte necesitau echipe mari, iar acum pot fi realizate de o singură persoană foarte talentată”, a spus Zuckerberg. Ce primesc angajații afectați și reacția pieței Meta a precizat că angajații din SUA afectați vor primi 16 săptămâni de salariu de bază, plus două săptămâni pentru fiecare an de vechime; pachetele internaționale ar urma să fie similare. Pe bursă, acțiunile Meta (META) erau în scădere cu peste 2% joi după-amiază, potrivit CNN. Context: un nou val de reduceri în tech În ultimul an, tot mai multe companii au redus personalul invocând eficiențe aduse de AI. CNN amintește că Amazon a anunțat în ianuarie concedieri de 16.000 de oameni, iar Block a comunicat în februarie o reducere de 40% a forței de muncă (peste 4.000 de persoane), avertizând că vor urma și alte companii. Meta mai făcuse tăieri masive în 2022 și 2023, după creșterile din perioada pandemiei. Anul trecut, compania a spus că va reduce circa 5% dintre angajați, vizați ca „performeri slabi”, cu intenția de a reangaja pentru multe dintre rolurile respective. [...]