Știri

Știri din categoria Inteligență artificială

Apple a blocat actualizări pentru unele aplicații de „vibe coding” pe App Store, potrivit 9to5Mac, care citează un raport al The Information și o poziție transmisă ulterior de companie.

Relatează The Information, prin jurnaliștii Stephanie Palazzolo și Aaron Tilley, că Apple ar fi împiedicat discret aplicații precum Replit și Vibecode să lanseze actualizări în App Store, dacă nu fac modificări, conform unor persoane familiarizate cu situația. Miza ține de categoria de aplicații care permit utilizatorilor să creeze jocuri sau alte instrumente prin introducerea de comenzi în limbaj natural către un sistem de inteligență artificială („vibe coding”, adică dezvoltare asistată de AI pe baza de prompturi).

Poziția Apple, inclusă în material, este că nu e vorba despre o politică nouă, ci despre aplicarea unor reguli existente: compania ar fi transmis unor dezvoltatori că aceste capabilități încalcă prevederi vechi care interzic unei aplicații să ruleze cod ce îi schimbă funcționalitatea după ce a trecut de procesul de evaluare din App Store. The Information mai notează că astfel de aplicații pot deveni o amenințare comercială, deoarece ar facilita crearea de aplicații web care ocolesc App Store, o sursă importantă de venit și profit pentru Apple.

9to5Mac explică faptul că tensiunea cu regulile App Store pornește de la principiul că aplicațiile nu ar trebui să-și schimbe comportamentul după aprobare. În schimb, aplicațiile de „vibe coding” pot genera și rula pe dispozitivul utilizatorului software nou, care poate arăta și funcționa diferit față de aplicația inițială, chiar dacă acel „nou” produs nu este distribuit prin App Store.

Apple indică drept referință Ghidul App Store 2.5.2, care interzice descărcarea, instalarea sau executarea de cod ce introduce ori schimbă funcții sau caracteristici ale aplicației (inclusiv ale altor aplicații), cu o excepție limitată pentru aplicații educaționale ce permit testarea de cod executabil, în condiții stricte (codul să fie complet vizibil și editabil). Potrivit The Information, una dintre soluțiile posibile pentru cel puțin una dintre aplicații ar fi ca previzualizările pentru aplicațiile generate să fie făcute în browser, nu în interiorul aplicației de „vibe coding”.

În actualizarea publicată de 9to5Mac, Apple spune că nu are reguli App Store „specifice” împotriva aplicațiilor de „vibe coding” și mai indică secțiunea 3.3.1(B) din licența Developer Program, care permite descărcarea de cod interpretat doar dacă acesta nu schimbă scopul principal al aplicației prin funcții incompatibile cu scopul intenționat și promovat. Compania mai afirmă că a comunicat consecvent cu dezvoltatorii, explicând încălcările și pașii pentru conformare, inclusiv prin trei convorbiri telefonice în două luni.

Recomandate

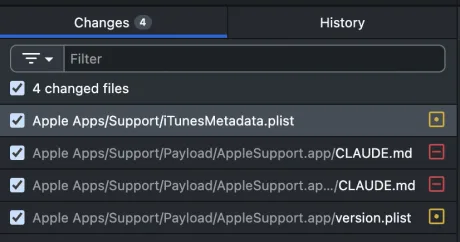

O actualizare a aplicației Apple Support a inclus din greșeală un fișier „Claude.md”, expunând indicii despre cum Apple folosește AI în dezvoltare și în arhitectura de suport , potrivit IT之家 . Incidentul, retras „de urgență” în 24 de ore, ridică o problemă operațională mai importantă decât „vibe coding”: cum mai arată controlul de calitate și revizia de cod când echipele se bazează pe asistenți AI și pe automatizări de livrare. Ce s-a întâmplat și unde a apărut fișierul Fișierul „Claude.md” a ajuns în pachetul de distribuție al aplicației Apple Support odată cu actualizarea la versiunea 5.13, livrată pe 1 mai. Descoperirea a fost semnalată de Aaron Perris, descris în material ca analist la MacRumors. Apple Support este aplicația oficială de asistență post-vânzare, folosită pentru chat cu specialiști, diagnosticare, programări la service și achiziția AppleCare. Ce indică „Claude.md” despre sistemul de suport: AI și oameni pe aceeași „bandă” Conținutul expus descrie o arhitectură de conversație în care Apple ar folosi un sistem cu două „backend-uri” (două componente de server): Juno AI pentru răspunsuri automate; Live Agents pentru preluarea de către operatori umani. Trecerea între cele două ar fi făcută printr-un strat de protocol, astfel încât „codul de deasupra” să nu știe dacă un mesaj vine de la om sau de la AI. În plus, modelul de mesaje ar avea trei roluri: „client” (utilizator), „agent” (operator Apple Support) și „assistant” (AI), procesate prin același flux, fără indicii explicite către utilizator despre cine răspunde, conform descrierii din material. Separat, sursa menționează și un modul „SAComponents”, prezentat ca o bibliotecă de componente de interfață (UI), fără logică de business, cu documentație DocC. De ce contează pentru companii: scăpări de livrare și guvernanță a codului în era AI Materialul pune accent pe faptul că nu fișierul în sine ar fi „marele secret”, ci faptul că un artefact intern a ajuns în producție , ceea ce sugerează o breșă în procesul de revizie și împachetare a aplicației. Discuția se leagă și de o controversă practică: dacă „Claude.md” (un fișier folosit, în general, pentru a instrui un asistent AI despre proiect: structură, reguli, pași de build, „capcane” de evitat) ar trebui: să fie păstrat în controlul versiunilor (ca documentație de proiect), sau să fie ignorat (de tip „configurație de mediu”, ținut local). Însă întrebarea operațională rămâne: cum a trecut fișierul din depozit/arbore de proiect în pachetul final publicat . Context: Apple și Anthropic , plus limitele concluziilor IT之家 notează că Bloomberg, prin Mark Gurman, ar fi indicat anterior că Apple rulează intern o versiune personalizată a modelului Claude pe serverele proprii, pentru a păstra datele în infrastructura companiei. Totodată, este citată și o poziție atribuită unui utilizator Hacker News care se prezintă drept fost angajat Apple: existența multor echipe izolate ar însemna că folosirea Claude într-un proiect nu dovedește automat o practică uniformă la nivelul întregii companii. Articolul mai menționează o statistică dintr-un sondaj pe 120.000 de dezvoltatori, potrivit căreia 92,6% folosesc cel puțin lunar un asistent AI de programare, ca argument că fenomenul este generalizat în industrie. Ce urmează Din informațiile prezentate nu reiese dacă Apple a comunicat public cauza exactă a includerii fișierului sau dacă a schimbat procedurile de livrare. Cert este că retragerea rapidă (în 24 de ore, conform materialului) limitează expunerea, dar nu elimină întrebarea de fond pentru organizațiile care dezvoltă software cu ajutorul AI: cine și cum mai face „review” eficient, astfel încât fișierele și instrucțiunile interne să nu ajungă în producție . [...]

Apple a dus cheltuielile de cercetare-dezvoltare la un nou record, 11,4 miliarde de dolari (aprox. 52 miliarde lei), cu accent pe inteligență artificială , potrivit Android Headlines . Miza economică este dublă: compania își apără avantajul competitiv într-o piață care se mută rapid spre produse și servicii bazate pe AI, dar își și crește baza de costuri într-un moment în care investitorii cer rezultate vizibile din aceste investiții. Suma de 11,4 miliarde de dolari este prezentată ca un nou maxim pentru bugetul de R&D (cercetare și dezvoltare), iar publicația leagă creșterea de intensificarea eforturilor Apple în zona de inteligență artificială și de dezvoltarea de produse viitoare. De ce contează: presiune pe marje și pe ritmul de livrare a „AI-ului” în produse Un buget mai mare de R&D înseamnă, pe termen scurt, costuri operaționale mai ridicate, care pot pune presiune pe marje dacă nu sunt compensate de venituri suplimentare. Pe termen mediu, investiția este un pariu pe capacitatea Apple de a transforma AI-ul în funcții și produse care să susțină vânzările de hardware și să accelereze veniturile din servicii. În același timp, un nivel record al cheltuielilor ridică așteptările pieței: dacă investițiile sunt „turnate” în AI, următorul pas logic este ca utilizatorii și investitorii să vadă îmbunătățiri concrete în ecosistem, nu doar promisiuni. Ce indică direcția investițiilor Din informațiile prezentate, accentul cade pe: creșterea investițiilor în cercetare și dezvoltare pentru „produse viitoare”; orientarea mai pronunțată către inteligență artificială, ca zonă prioritară de dezvoltare. Publicația nu detaliază, în fragmentul disponibil, proiecte specifice sau un calendar de lansări asociat acestor cheltuieli, astfel că rămâne neclar ce produse sau funcții vor absorbi cea mai mare parte a bugetului și când ar urma să se vadă rezultatele în piață. [...]

În plin conflict juridic cu Elon Musk, Sam Altman a transmis public că acesta „poate veni” la petrecerea de celebrare GPT-5.5, un gest care mută disputa din sala de judecată în zona de reputație și control al comunicării , potrivit iTHome . Evenimentul este programat pe 5 mai, iar OpenAI ar urma să organizeze o „petrecere de succes” pentru GPT-5.5. Altman a publicat online un formular de înscriere pentru cei interesați, menționând că instrumentul Codex va ajuta compania să selecteze participanții. Contextul invitației a apărut după ce scriitorul Andrew Curran a comentat că Musk ar putea apărea neinvitat „ca vrăjitoarea din Frumoasa din pădurea adormită” și ar „arunca un blestem” asupra petrecerii. Altman a răspuns: „Dacă vrea să vină, poate veni. Lumea are nevoie de mai multă iubire.” De ce contează: presiune pe comunicarea publică în timpul procesului Gestul vine la scurt timp după ce judecătoarea federală americană Yvonne Gonzalez Rogers i-ar fi avertizat pe cei doi executivi să-și „controleze impulsul” de a posta pe rețelele sociale și să nu agraveze situația în afara instanței. În acest cadru, mesajul lui Altman funcționează ca un semnal public de detensionare, dar și ca o mutare cu potențial de impact reputațional într-un litigiu aflat deja în desfășurare. Relația Musk–OpenAI și procesul Musk și Altman au o relație conflictuală de ani de zile. Potrivit informațiilor citate, cei doi au cofondat OpenAI în 2015, iar Musk a părăsit organizația în 2018, invocând divergențe de valori. Ulterior, Musk a criticat OpenAI și a pus sub semnul întrebării trecerea de la modelul non-profit la unul comercial, în timp ce și-a lansat propria companie de inteligență artificială, xAI. În martie 2024, Musk a dat în judecată OpenAI, pe Altman și alți cofondatori, susținând că ar fi fost încălcat acordul inițial de înființare. Cazul a intrat în faza de judecată la finalul lunii aprilie, iar relatarea menționează un climat tensionat în sală, inclusiv un moment de confruntare între Musk și avocații OpenAI înainte de intervenția judecătorului. [...]

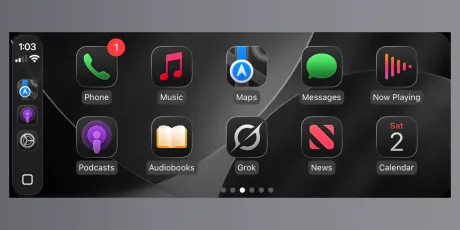

xAI pregătește extinderea lui Grok în mașinile cu CarPlay , după ce aplicația Grok pentru iPhone a început să includă un „placeholder” (o interfață nefuncțională, de test) pentru Apple CarPlay, semn că suportul este în lucru, potrivit 9to5Mac . În forma actuală, aplicația Grok din CarPlay nu funcționează efectiv, dar la deschidere afișează mesajul: „Grok Voice mode coming soon to CarPlay” („Modul Grok Voice vine în curând pe CarPlay”). Consecința practică este că xAI urmărește să ducă experiența de chatbot cu comandă vocală în ecosistemul CarPlay, adică în „aproape orice altă mașină de pe șosea”, nu doar în vehiculele Tesla, unde Grok este deja integrat. De ce contează: CarPlay devine o platformă pentru chatboți AI CarPlay a început recent să accepte aplicații de tip chatbot AI, iar Grok ar urma să fie a treia aplicație care adaugă suport, alături de ChatGPT și Perplexity , conform publicației. Pentru utilizatori, asta înseamnă mai multe opțiuni de asistent conversațional în interfața mașinii, cu accent pe interacțiunea vocală. În același context, 9to5Mac notează că Google nu a dat semne că ar aduce Gemini în CarPlay, deși modelele Gemini ar urma să ajute la „noul Siri” din iOS 27, mai târziu în acest an. Publicația mai menționează și așteptarea ca Apple să lanseze o aplicație Siri dedicată, care „probabil” va funcționa și cu CarPlay. Ce se știe despre calendar și disponibilitate Sursa nu oferă o dată de lansare, ci doar indică faptul că modul Grok Voice ar urma să ajungă „în curând” pe CarPlay, pe baza mesajului din aplicație și a prezenței interfeței nefuncționale. Aplicația Grok pentru iOS este disponibilă în App Store, însă suportul CarPlay nu este încă activ. [...]

O hotărâre a Tribunalului Intermediar al Poporului din Hangzhou limitează concedierile motivate de automatizare , stabilind că firmele nu pot da afară angajați doar ca să îi înlocuiască cu inteligență artificială pentru reducerea costurilor, potrivit G4Media . Decizia este prezentată ca un reper pentru protecția muncii într-un context de adoptare accelerată a tehnologiilor AI. Instanța a menținut concluziile anterioare într-un caz în care o companie de tehnologie a concediat ilegal un angajat cu funcție superioară după ce a introdus sisteme de inteligență artificială care îi preluau atribuțiile. Cazul a fost publicat într-un set de exemple juridice-model înaintea Zilei Internaționale a Muncii, ceea ce îi amplifică relevanța pentru practica judiciară și pentru companii. Ce a decis instanța și de ce contează pentru companii Litigiul a vizat un angajat identificat drept Zhou, angajat în 2022 ca supervizor de asigurare a calității. Rolul lui era să supravegheze rezultatele generate de „ modele lingvistice mari ” (sisteme AI care generează text) și să se asigure că sunt respectate standardele privind datele și conținutul. Pe măsură ce firma a automatizat tot mai mult procesele, lui Zhou i s-a propus un post mai prost plătit, cu responsabilități mult reduse. După ce a refuzat reîncadrarea, a fost concediat și i s-a oferit o compensație, contestată ulterior prin arbitraj. Autoritățile au constatat că justificarea companiei – o restructurare organizațională determinată de adoptarea AI – nu îndeplinea pragul legal necesar pentru concediere în baza legislației muncii din China. Instanțele au concluzionat că înlocuirea unui lucrător cu AI nu este, în sine, o „schimbare majoră a circumstanțelor obiective” (precum relocarea sau fuziunea) și nu poate fi folosită ca temei pentru încetarea contractului. De asemenea, rolul alternativ oferit a fost considerat nerezonabil din cauza reducerii abrupte a salariului. Context: AI se extinde, iar litigiile de muncă se înmulțesc Potrivit materialului, experți juridici apreciază că hotărârea întărește ideea că firmele pot urmări eficiența prin automatizare, dar trebuie să își respecte obligațiile față de angajați. Decizia vine după rezultate similare în arbitraje din alte orașe chineze, unde concedierile determinate de AI au fost considerate ilegale. Cazul apare într-un moment în care sectorul AI din China se extinde rapid, cu mii de firme active și cu o integrare pe scară largă așteptată în toate industriile până la sfârșitul deceniului, pe fondul îngrijorărilor privind utilizarea abuzivă a automatizării, inclusiv situații în care companiile ar reproduce roluri umane prin echivalente digitale bazate pe AI. [...]

Pentagonul menține interdicția asupra Anthropic , dar tratează separat modelul AI Mythos , evaluat ca tehnologie cu implicații pentru securitatea națională, potrivit Profit . Distincția arată cum autoritățile americane separă riscul de „lanț de aprovizionare” asociat unei companii de utilitatea punctuală a unui model de inteligență artificială în zona de apărare și securitate cibernetică. Modelul Mythos este analizat separat deoarece ar avea capacități avansate de identificare și remediere a vulnerabilităților cibernetice. Directorul tehnologic al Pentagonului, Emil Michael, a spus că aceste capabilități obligă autoritățile să consolideze securitatea rețelelor guvernamentale. Ce înseamnă, practic, „interdicția” pentru Anthropic Deși Mythos e evaluat distinct, statutul Anthropic de „risc pentru securitate” rămâne în vigoare, pe fondul unui conflict deschis între companie și autoritățile americane privind utilizarea tehnologiei sale. Consecința operațională este directă pentru ecosistemul de furnizori ai armatei: firmele contractoare trebuie să certifice că nu folosesc modelele Claude (dezvoltate de Anthropic) în proiecte militare. Compania a dat în judecată administrația americană pentru a contesta decizia de clasificare, conform informațiilor din articol. Context: Pentagonul își extinde parteneriatele AI pentru rețele clasificate În paralel, Pentagonul a anunțat acorduri cu mai multe companii tehnologice majore — OpenAI, Google, Microsoft, Nvidia și Amazon Web Services — pentru implementarea soluțiilor de inteligență artificială în rețelele clasificate ale instituției. Pentru piață, mesajul este că accesul la contracte și implementări în zona de apărare depinde nu doar de performanța tehnologică, ci și de evaluările de risc privind furnizorul și lanțul de aprovizionare, care pot bloca utilizarea unor modele chiar și atunci când anumite componente sunt considerate relevante pentru securitatea națională. [...]