Știri

Știri din categoria Tehnologie

OpenAI își apără decizia de a retrage GPT-4o, în pofida reacțiilor emoționale ale unor utilizatori și a proceselor aflate pe rol, argumentând că siguranța trebuie să primeze în fața atașamentului creat în jurul modelului. Retragerea programată pentru 13 februarie 2026 a declanșat un val de proteste online, mii de utilizatori descriind GPT-4o drept un sprijin emoțional constant sau chiar un „companion”, însă compania susține că tocmai acest tip de relație a devenit problematic.

Decizia OpenAI este luată într-un context juridic complicat. Compania se confruntă în prezent cu opt procese care susțin că răspunsurile excesiv de empatice și de validare ale GPT-4o ar fi contribuit la agravarea unor crize de sănătate mintală, inclusiv cazuri de sinucidere. Șapte dintre acțiunile legale au fost depuse în California, reclamanții acuzând neglijență și lansarea unui produs despre care ar fi existat avertismente interne privind riscurile psihologice.

OpenAI recunoaște amploarea reacțiilor, dar susține că atașamentele emoționale față de chatboți nu mai pot fi tratate ca un fenomen marginal. CEO-ul Sam Altman a declarat recent că relațiile formate cu astfel de sisteme au devenit „o realitate care necesită reguli mai stricte”. În acest sens, compania promovează noile modele GPT-5, considerate mai bine echipate cu mecanisme de siguranță și limitare a dependenței emoționale.

Deși GPT-4o va rămâne temporar disponibil prin API pentru clienții enterprise, OpenAI transmite că retragerea din ChatGPT este definitivă. Mesajul central al companiei este că impactul social și riscurile legale cântăresc mai mult decât popularitatea unui model, chiar și atunci când acesta a creat legături emoționale puternice cu o parte a utilizatorilor.

Recomandate

Google mizează pe ecran și eficiență energetică la Pixel 11 , iar zvonurile despre un panou OLED M16 mai luminos și mai econom, plus un chipset Tensor G6 pe 2 nm, indică o strategie de diferențiere prin autonomie și utilizare în exterior, nu prin schimbări de design, potrivit PhoneArena . Seria Pixel 11 este așteptată „cândva în august”, cu posibile detalii la conferința Google I/O . Ecran M16 OLED: mai multă luminozitate, consum mai mic Cea mai importantă schimbare vehiculată este debutul materialului OLED M16 de la Samsung pe Pixel 11. Publicația notează că această tehnologie ar aduce: un ecran „vizibil mai luminos” și mai eficient energetic; acuratețe mai bună a culorilor; un câștig mai ales în utilizarea în aer liber, unde luminozitatea contează direct. Comparația din material vizează panoul M14, despre care se afirmă că ar fi prezent pe modele concurente precum Galaxy S26 și iPhone 17. Tensor G6 pe 2 nm și schimbarea modemului: miză pe performanță și stabilitate Pixel 11 ar urma să folosească procesorul Google Tensor G6 fabricat pe 2 nm, descris ca fiind orientat către sarcini de inteligență artificială și cu promisiunea unor îmbunătățiri „pe linie” de performanță și eficiență față de generațiile anterioare. Pe zona de securitate, seria ar putea fi asociată cu un cip Titan M3 pentru protecție la nivel hardware. La conectivitate, PhoneArena menționează o posibilă trecere la modemul MediaTek M90, după utilizarea modemurilor Exynos pe Pixel-urile anterioare, cu așteptarea unei funcționări mai fiabile. „Pixel Glow”: revenirea notificărilor LED, cu rol și de diagnostic O altă noutate discutată este „Pixel Glow”, un sistem de notificare cu LED pe spatele telefonului, care ar schimba culoarea pentru a semnala notificări. În material se vorbește despre: culori roșu, verde și albastru pentru diagnostic; până la opt culori pentru notificări, dacă informațiile din zvonuri se confirmă; posibilă personalizare a culorilor în funcție de tipul notificării; o legătură cu Gemini AI, pentru un comportament „mai inteligent”. Cameră și design: senzori noi, dar schimbări vizuale minime Pe foto, scurgerile de informații invocate indică upgrade-uri de hardware: Pixel 11 și Pixel 11 Pro Fold ar putea primi un senzor nou, cu nume de cod „chemosh”, despre care se crede că ar fi de 50 MP; Pixel 11 Pro și Pro XL ar urma să primească doi senzori noi (principal și telefoto); este amintit și un zvon mai vechi despre o cameră telefoto de „64 MB” pentru Pixel 11 Pro XL, formulare pe care publicația o redă ca atare. La design, randările „scăpate” sugerează păstrarea liniei actuale (bara orizontală pentru camere), cu ajustări mici: bara ar putea fi vopsită în negru, iar ramele ecranului ar putea deveni mai subțiri. Android 17 și „Gemini Intelligence”: automatizări și widgeturi generate din descrieri Pixel 11 este așteptat să vină cu Android 17 preinstalat. Noutatea centrală menționată este „Gemini Intelligence”, descrisă ca un agent bazat pe inteligență artificială capabil să execute automatizări complexe, în mai mulți pași. Tot aici apare posibilitatea de a crea widgeturi pentru ecranul principal prin descrierea a ceea ce vrei, widgeturi realizate cu „Material Expressive”. Android 17 ar mai include funcții precum App Bubbles și Pause Point. Ce urmează Calendarul rămâne la nivel de așteptări: seria Pixel 11 ar putea fi lansată în august, iar până atunci Google ar putea oferi indicii la I/O. Toate detaliile sunt prezentate ca informații din zvonuri și scurgeri, deci specificațiile finale pot diferi. [...]

Amazfit ridică ștacheta autonomiei în zona ceasurilor pentru alergare montană , lansând modelul Cheetah 2 Ultra cu o estimare de până la 30 de zile în modul smartwatch, potrivit Notebookcheck . Miza este una operațională: utilizatorii care folosesc frecvent GPS-ul și antrenamentele în aer liber pot reduce încărcările dese, un punct sensibil la ceasurile orientate spre sport. Autonomie: 30 de zile în mod smartwatch, 60 de ore cu localizare permanentă Amazfit indică: până la 30 de zile autonomie în „smartwatch mode”; până la 60 de ore cu serviciile de localizare „always enabled” (localizare permanent activă). Pentru a susține aceste valori, compania a mărit capacitatea bateriei cu 44% , înlocuind acumulatorul de 540 mAh de pe Cheetah 2 Pro cu unul de 780 mAh pe Cheetah 2 Ultra. Ecran mai mare și hardware actualizat Cheetah 2 Ultra păstrează un ecran AMOLED de 3.000 niți (valoare de luminozitate maximă), dar crește dimensiunea și rezoluția față de varianta Pro: diagonala urcă de la 1,32 inci la 1,5 inci ; rezoluția crește de la 466 x 466 pixeli la 480 x 480 pixeli . Pe partea de stocare, modelul Ultra dublează memoria internă la 64 GB și trece la un procesor HS3s , despre care Amazfit spune că ar oferi performanță mai bună decât HS3 din Cheetah 2 Pro. Poziționare și preț: carcasă din titan și lansare globală Modelul este poziționat pentru trail running (alergare montană) și vine cu o carcasă din aliaj de titan de grad 5 , inclusiv butoane. Ceasul suportă curele de 22 mm și are peste 180 de moduri de antrenament preinstalate. Prețurile anunțate: 599 euro (aprox. 3.000 lei ) în zona euro; 599 dolari (aprox. 2.750 lei ) în SUA. În cutie sunt incluse două curele , conform aceleiași surse. [...]

Xiaomi ridică miza pe autonomie cu o baterie de 8.000 mAh pe viitorul 17 Max , un nivel care, dacă se confirmă în utilizarea reală, poate schimba așteptările pieței pentru segmentul de telefoane mari. Potrivit IT Home , Xiaomi 17 Max va fi lansat în cursul acestei luni și va integra o „baterie Jinsha River” de 8.000 mAh, pe care compania o descrie drept cea mai puternică autonomie din portofoliul său de telefoane. Pe lângă baterie, Xiaomi anunță și o configurație foto orientată spre vârf de gamă: prima cameră principală Leica de 200 MP (2 sute de milioane de pixeli) montată pe un telefon Xiaomi, plus un obiectiv telefoto tip periscop cu zoom optic 3x. Compania continuă astfel parteneriatul de imagine cu Leica, mizând pe „stilul de culoare” (tonalitatea) asociat brandului. Ce știm despre ecran și platforma hardware Telefonul ar urma să primească același ecran de 6,9 inci descris ca „super pixel” ca modelul Xiaomi 17 Pro Max și să fie echipat cu procesorul Snapdragon 8 „Extreme Edition ” de generația a cincea (o platformă de top din seria Snapdragon 8). Tot IT Home notează că Xiaomi 17 Max a fost deja confirmat pentru lansare în această lună. În materialele anterioare citate de publicație, designul menționat include: ecran plat de 6,9 inci, cu margini foarte înguste și rame egale pe toate laturile; un cadru cu muchii curbate („înfășurate”); colțuri rotunjite pronunțat („R” mare); trei variante de culoare: „Sky Blue”, „White” și „Pixel Black” (denumiri prezentate de Xiaomi). Mostre foto publicate înainte de lansare Separat, Xiaomi a publicat și mostre foto realizate cu Xiaomi 17 Max, pentru a ilustra capabilitățile camerei, potrivit unui al doilea material al aceleiași publicații, IT Home . În acest context, compania reia mesajul că telefonul va păstra soluția de imagine co-branduită cu Leica și va pune accent pe „stilul Leica”. Deocamdată, în informațiile disponibile nu apar detalii despre preț sau despre data exactă a evenimentului de lansare din această lună. [...]

Telefonul Trump T1 intră în livrare în această săptămână , un pas operațional care mută proiectul din zona promisiunilor în execuție și deschide etapa critică a onorării comenzilor, potrivit Android Headlines . Informația este atribuită CEO-ului, care susține că livrările vor începe „chiar săptămâna aceasta”. Din perspectiva pieței, momentul contează pentru că livrarea efectivă este pragul care validează lanțul de aprovizionare și capacitatea de producție și distribuție — nu doar intenția de a lansa un produs. De ce contează: trecerea de la anunț la execuție Pentru orice brand nou de hardware, începutul livrărilor este testul principal: apar primele confirmări din partea clienților, se văd timpii reali de expediere și se conturează nivelul de suport post-vânzare (retururi, garanții, reparații). În cazul Trump T1, mesajul CEO-ului indică faptul că proiectul ar fi depășit faza de precomenzi și pregătire și ar fi ajuns la livrări. Ce rămâne neclar Materialul nu oferă, în fragmentul disponibil, detalii verificabile despre volumele care vor fi livrate, piețele vizate sau calendarul complet al expedițiilor. În lipsa acestor informații, amploarea livrărilor și impactul comercial rămân deocamdată dificil de evaluat. [...]

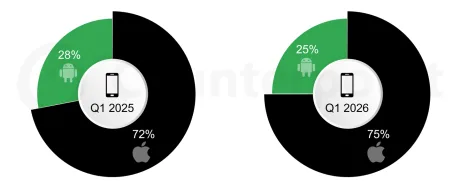

Apple a crescut vânzările de iPhone în SUA cu 1,3% în T1 2026, deși piața totală a scăzut , iar dominația sa la Verizon, AT&T și T‑Mobile a urcat la 75% din vânzările de smartphone-uri prin cei trei mari operatori, potrivit IT之家 , care citează un raport CounterPoint Research . Într-un trimestru în care piața americană de smartphone-uri a consemnat un declin anual de 5,7%, CounterPoint pune reculul pe seama prăbușirii vânzărilor de dispozitive Android, în scădere cu 14,4% față de aceeași perioadă a anului trecut. Pe acest fundal, iPhone a fost excepția, cu o creștere de 1,3% an la an. Ce înseamnă pentru distribuția prin operatori Pe baza datelor de vânzări ale Verizon, AT&T și T‑Mobile, CounterPoint estimează că iPhone a ajuns la o cotă de 75% în T1 2026, cu 3 puncte procentuale peste nivelul din T1 2025. Practic, Apple își consolidează poziția exact în canalul care rămâne critic pentru volume în SUA: vânzarea prin operatori, unde subvențiile, ratele și pachetele influențează puternic alegerea consumatorilor. Factorul preț: „ancora” pe care Apple a reușit să o păstreze CounterPoint indică drept element de diferențiere strategia de preț pentru iPhone 17e: Apple ar fi menținut prețul neschimbat, dar ar fi crescut capacitatea de stocare. În comparație, producătorii Android, descriși ca având marje hardware reduse, ar fi fost împinși către scumpiri, ceea ce a mutat „ancora” de preț în favoarea Apple (adică reperul de preț care influențează percepția consumatorilor asupra ofertelor concurente). Context: mesajul managementului Apple despre cerere În același material este citată și o declarație a CEO-ului Apple, Tim Cook , din conferința cu analiștii din 30 aprilie, potrivit căreia seria iPhone 17 ar fi cea mai populară linie de produse din istoria companiei, cu o cerere „explozivă”. „Seria iPhone 17 este cea mai populară linie de produse din istoria Apple, iar cererea a explodat.” [...]

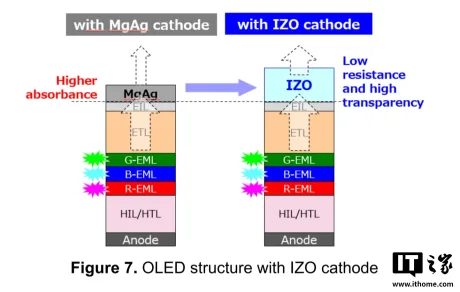

Apple pregătește pentru iPhone 2028 o schimbare de ecran care ar putea forța investiții noi în producția OLED , iar furnizorii săi Samsung Display și LG Display au început deja să avanseze tehnologia necesară, potrivit IT之家 , care citează informații publicate de presa sud-coreeană ETNEWS. Planul vizează așa-numitele ecrane OLED „curbate pe toate cele patru laturi” (marginile panoului sunt îndoite în jos pe fiecare parte), pentru a reduce și mai mult ramele și a crește „imersiunea” vizuală pe fața telefonului. În lanțul de aprovizionare, acest tip de design nu înseamnă doar o schimbare estetică, ci și modificări de materiale și echipamente, cu impact direct în capex (investiții în capacități de producție). De ce contează: materialul catodului și riscul de distorsiuni la margini Conform informațiilor citate, Apple ar urma să introducă prima dată soluția de ecran cu îndoire pe patru laturi pe modelul aniversar de 20 de ani, programat pentru anul viitor. Într-o primă versiune, stratul de catod ar folosi un aliaj magneziu-argint (MgAg), însă în zona curbată acesta ar putea provoca distorsiuni de imagine și scăderea luminozității. Motivul ține de arhitectura OLED „cu emisie frontală” (dominantă la smartphone-uri), unde lumina trebuie să treacă prin catod: cu cât transparența electrodului este mai redusă, cu atât cresc riscurile de neuniformități și degradări vizibile, mai ales în zonele de margine îndoite. Ce schimbă Apple pentru 2028: trecerea la oxid de indiu-zinc (IZO) Pentru generația din 2028, Apple ar planifica înlocuirea materialului catodului cu oxid de indiu-zinc (IZO), pentru o transparență mai bună și pentru a atenua problemele specifice zonelor curbate: încălzire, distorsiuni și luminozitate neuniformă, potrivit aceleiași surse. Această schimbare implică și adaptări de proces: în etapa de depunere (evaporare), ar fi necesară integrarea unor echipamente de „sputtering” (pulverizare catodică) pentru oxizi conductori transparenți, cu cerința de a fi „low-damage” (cu impact redus asupra straturilor sensibile ale panoului). Impact operațional: investiții în echipamente și, posibil, linii noi În calitate de furnizori de panouri OLED pentru Apple, Samsung Display și LG Display ar trebui să introducă această tehnologie, iar investițiile în echipamente pentru modelele din 2028 au intrat deja pe agendă, potrivit unor surse din industrie citate în material. LG Display a anunțat luna trecută o investiție de 1,106 trilioane woni (în material este indicat echivalentul de aproximativ 50,44 miliarde yuani), descrisă ca extindere a infrastructurii OLED și considerată de piață ca fiind legată de dezvoltarea și pregătirea producției pentru această tehnologie. Compania ar urma să folosească inițial noile echipamente în cercetare-dezvoltare, apoi să le consolideze gradual pentru trecerea la producție de masă a ecranelor cu îndoire pe patru laturi. În cazul Samsung Display, sursa arată că firma evaluează investiții în echipamente, însă industria consideră că instalarea directă a acestor echipamente pe liniile OLED existente este dificilă din motive de spațiu și design, ceea ce ar crește probabilitatea unor investiții în linii noi. În lipsa unor confirmări oficiale din partea Apple, Samsung Display sau LG Display în textul citat, rămâne de urmărit dacă și când vor apărea anunțuri concrete privind calendarul de producție și amploarea investițiilor. [...]