Știri

Știri din categoria Inteligență artificială

O comparație făcută de Sam Altman între antrenarea AI și „antrenarea” unui om reaprinde dezbaterea despre viziunea liderilor tech asupra viitorului. Declarația a fost făcută la un summit din India dedicat impactului inteligenței artificiale.

Întrebat despre consumul ridicat de energie necesar pentru antrenarea modelelor precum ChatGPT, CEO-ul OpenAI a răspuns că și dezvoltarea unui om presupune resurse considerabile. El a afirmat, pentru The Indian Express, că este nevoie de aproximativ 20 de ani și de toată hrana consumată în acest interval pentru ca o persoană să devină inteligentă.

Afirmația vine într-un moment în care impactul energetic al centrelor de date este intens discutat. Potrivit Agenției Internaționale pentru Energie, acestea au reprezentat circa 1,5% din consumul global de electricitate în 2024, iar până în 2030 se estimează o creștere anuală de aproximativ 15%, de peste patru ori mai rapidă decât în alte sectoare.

Autorul analizei atrage atenția că formularea lui Altman depășește simpla figură de stil. Compararea dezvoltării umane cu un proces tehnologic de „antrenare” ar indica, în opinia sa, o viziune utilitaristă asupra vieții, în care copilăria devine o investiție, hrana un input energetic, iar inteligența un rezultat măsurabil și optimizabil.

În logica industriei tehnologice, antrenarea presupune introducerea de date, consum de energie și obținerea unei performanțe scalabile. Aplicarea aceleiași grile asupra oamenilor estompează diferența dintre ființă umană și sistem informatic, susține analiza, alimentând temeri că eficiența ar putea deveni criteriul dominant în evaluarea valorii.

Altman a mai declarat că inteligența artificială generală este „mai aproape decât credem”, afirmație care, în contextul dezbaterii despre resurse și impact asupra mediului, amplifică întrebările legate de direcția în care se îndreaptă dezvoltarea tehnologică.

Textul subliniază că astfel de declarații ar trebui să determine o reflecție mai amplă la nivel guvernamental, în condițiile în care companiile din domeniul inteligenței artificiale concentrează o influență tot mai mare asupra economiei și societății.

Recomandate

Investițiile în tehnologie și inteligență artificială mută câștigul de eficiență în construcții dinspre „mai multe utilaje” spre „mai multă predictibilitate” , prin conectarea oamenilor, a șantierului și a mașinilor într-un flux de lucru comun, potrivit Ziarul Financiar , care îl citează pe Liviu Neagu , CEO al Bergerat Monnoyeur România , importatorul utilajelor Caterpillar pe piața locală. Mesajul central al executivului este că digitalizarea și AI nu sunt prezentate ca un înlocuitor al muncii umane, ci ca un instrument care „ușurează munca oamenilor” și îmbunătățește colaborarea dintre angajații din birouri și cei din teren. În acest cadru, beneficiul economic urmărit este reducerea fricțiunilor operaționale și creșterea controlului asupra execuției proiectelor. „Vorbim de oameni, maşini, inteligenţă artificială. Nu se merge pe ideea de a exclude prezenţa umană în următoarea perioadă, chiar dacă vom uşura munca oamenilor“. Ce înseamnă „digitalizare” pe șantier, în viziunea companiei Neagu descrie digitalizarea ca pe o schimbare de interfață între oameni și utilaje: comunicarea se face „altfel” cu utilajul și cu șantierul, iar oamenii pot comunica între ei „prin intermediul mașinilor”. Ținta este obținerea unei „predictibilități mult mai mari” asupra a ceea ce urmează să fie realizat în proiect. În practică, această direcție pune accent pe eficiență și pe coordonare, într-un sector în care întârzierile și lipsa de vizibilitate asupra progresului se traduc direct în costuri. Investițiile în AI: contextul Caterpillar și miza următorului pas În ultimii 25 de ani, Caterpillar a investit peste 20 mld. dolari (aprox. 86,4 mld. lei) în tehnologie, inclusiv digitalizare și inteligență artificială pentru utilaje de construcții, potrivit CEO-ului Bergerat Monnoyeur România. Următoarea etapă menționată de Neagu este ca utilajul „să vină și să propună soluții”, în funcție de modul în care lucrează operatorul. El a descris evoluția de până acum ca pe „salturi tehnologice” succesive. Unde se vede impactul în România Bergerat Monnoyeur România, pe care Neagu o numește liderul pieței de utilaje de construcții, a raportat afaceri de 126 mil. euro anul trecut. În logica prezentată la conferința ZF „Tendințe în piața de birouri și construcții”, câștigul operațional așteptat din AI și digitalizare este: eficiență mai mare pe șantiere; comunicare mai bună între personalul de birou și cel din teren; predictibilitate mai bună în derularea proiectelor. Publicația nu oferă, în acest material, un calendar de implementare sau indicatori cantitativi ai economiilor/creșterilor de productivitate rezultate din aceste tehnologii. [...]

Companiile care tratează AI ca „accelerator plug-and-play” în proiectare riscă să rămână blocate în faza de pilot , iar avantajul competitiv se va muta către organizațiile care integrează AI ca „strat de inteligență” peste instrumentele existente și își schimbă efectiv procesul de inginerie, potrivit unei analize publicate de TechRadar . Miza, în special pentru producătorii de echipamente și echipele de dezvoltare de produs, este capacitatea de a livra produse mai complexe mai repede, într-un context în care procesele tradiționale nu au fost gândite pentru ritmul și scara actuale. Autorul indică trei factori care vor decide competitivitatea: viteza de iterare a designului, detectarea timpurie a punctelor de fricțiune la nivel de sistem și capacitatea de a „codifica” și scala know-how-ul intern de inginerie. De ce multe inițiative de AI în design se opresc la pilot Analiza susține că o cauză frecventă este așteptarea greșită că AI poate înlocui complet instrumentele existente de proiectare și simulare. Această abordare duce la obiective nerealiste și poate adânci diferențele de competențe dintre echipe și tehnologiile pe care încearcă să le adopte. În schimb, AI este prezentată ca o extensie a tehnologiilor CAD și CAE (proiectare asistată de calculator și inginerie asistată de calculator), care poate crește eficiența și scala, fără a elimina nevoia de instrumente consacrate sau de judecată inginerească. „Noul manual”: design cantitativ și iterație continuă Modelul descris mută accentul de la perfecționarea unui singur model 3D, pe parcursul a săptămâni, către definirea unui „spațiu de design” (set de constrângeri și ținte de performanță) în care AI poate genera rapid variante viabile în paralel. Inginerii formulează intenția și condițiile, AI propune opțiuni, iar oamenii aleg direcțiile promițătoare și rafinează cerințele. Consecința operațională urmărită este comprimarea ciclurilor de decizie și aducerea mai devreme în proiect a compromisurilor (de tip cost–performanță–siguranță), înainte ca echipele să investească masiv în o singură soluție. Copiloții de design și „stratul de inteligență” peste toolchain Pentru ca acest mod de lucru să funcționeze „zi de zi”, textul descrie apariția unui „strat de inteligență” care se conectează la lanțul de instrumente deja folosit (CAD, simulare, sisteme de management al ciclului de viață al produsului) și îl completează cu copiloți AI capabili să: genereze geometrii „gata de CAD”; anticipeze comportamentul fizic; scoată la suprafață compromisuri între echipe. Ideea centrală este că organizațiile pot obține viteză și vizibilitate mai bună asupra deciziilor fără să-și reconstruiască fluxurile de lucru „de la zero” pentru proiectele aflate în derulare. Implicații pentru echipe: roluri noi, dar responsabilitatea rămâne la oameni Pe măsură ce AI se integrează, apar roluri precum „designerul cantitativ” (care explorează spații de design și encodează expertiza în fluxuri compatibile cu AI) și „constructorul AI” (care face legătura între IT, date și inginerie pentru integrare sigură și la scară). În același timp, analiza insistă că AI nu înlocuiește cunoașterea tacită acumulată prin experiență și nici evaluarea compromisurilor „dezordonate” dintre confort, siguranță, cost și performanță. AI reduce mai degrabă fricțiunea dintre judecata umană și instrumentele digitale care transformă ideile în produse. Ce urmează: de la pilot la implementări țintite În termen scurt, reușita ar veni din selectarea câtorva fluxuri de lucru „strategic importante”, demonstrarea rezultatelor designului cantitativ asistat de AI și investiții în oameni, astfel încât echipele să devină utilizatori competenți și să poată modela aceste instrumente. Pe termen mai lung, capacitatea de a combina creativitatea umană cu explorarea accelerată de AI ar urma să influențeze cât de repede ajung pe piață produse mai bune. [...]

Jensen Huang avertizează că China are „enorm” de multă putere de calcul nefolosită , inclusiv centre de date „complet goale, dar alimentate”, ceea ce ar putea accelera antrenarea unor modele avansate de inteligență artificială cu impact direct asupra securității cibernetice, potrivit TechRadar . CEO-ul Nvidia a făcut declarațiile într-un episod al podcastului Dwarkesh Patel. Miza, în lectura lui Huang, este una operațională și de risc: capacitatea de calcul (compute) disponibilă — adică infrastructura hardware necesară pentru antrenarea modelelor de IA — ar permite Chinei să dezvolte rapid un model comparabil cu Claude Mythos, inițiativă recent anunțată de Anthropic, cu potențiale consecințe „îngrijorătoare” pentru securitatea cibernetică globală. „Centre de date fantomă” și cipuri „abundent disponibile” Huang spune că tipul de infrastructură pe care a fost antrenat Mythos este „abundent disponibil” în China și atrage atenția că „cipuri există în China”. În același context, el susține că există centre de date care „stau complet goale, complet alimentate”, folosind comparația: „Au orașe fantomă, au și centre de date fantomă.” Tot el afirmă că, dacă ar decide, China ar putea „grupa mai multe cipuri” pentru a crește rapid capacitatea efectiv utilizată și adaugă că abilitatea Chinei de a produce cipuri este „una dintre cele mai mari din lume”. De ce contează: legătura cu modelele pentru securitate cibernetică Declarațiile vin pe fondul atenției crescute pentru modele de IA orientate spre securitate. TechRadar notează că Mythos este o componentă-cheie a Project Glasswing, o inițiativă de securitate cibernetică condusă de Anthropic împreună cu lideri din tehnologie, care urmărește identificarea și remedierea vulnerabilităților din software critic. În paralel, publicația amintește că OpenAI a prezentat GPT-5.4-Cyber, descris drept un „rival” al Mythos, destinat profesioniștilor din securitate pentru a detecta atacuri mai avansate. Huang: SUA „trebuie să câștige”, dar dialogul cu China e „mai sigur” Deși spune explicit că „vrem ca Statele Unite să câștige”, Huang argumentează că o abordare exclusiv adversarială poate fi contraproductivă și pledează pentru dialog între cercetători, inclusiv pentru a stabili limite de utilizare: „Este esențial ca cercetătorii noștri în IA și cercetătorii lor în IA să vorbească.” „Cred că a avea un dialog și un dialog de cercetare este probabil cel mai sigur lucru de făcut.” În același timp, el nu neagă statutul de adversar, spunând că „victimizarea” și transformarea Chinei într-un inamic „probabil nu este cel mai bun răspuns”, dar adaugă: „Ei sunt un adversar.” Ce rămâne neclar Materialul nu oferă cifre concrete despre dimensiunea capacității de calcul din China sau despre cât din aceasta este efectiv neutilizată; evaluarea este prezentată ca aprecierea lui Jensen Huang, în cadrul podcastului. [...]

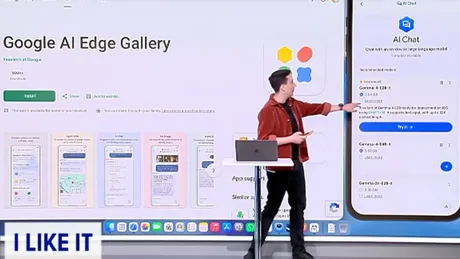

Rularea locală a modelelor de inteligență artificială poate reduce costurile cu abonamentele și dependența de cloud pentru utilizatorii care vor funcții de tip „chat” direct pe telefon sau PC, fără conexiune permanentă la internet, potrivit Stirile Pro TV . Materialul descrie o opțiune gratuită lansată de Google, care permite descărcarea și rularea pe dispozitiv a unor modele mai mici decât cele folosite de servicii precum ChatGPT sau Gemini. Aplicația indicată este Google AI Edge Gallery , disponibilă gratuit pe iOS și Android. Pentru utilizare, sursa menționează un telefon „mid-range” cu cel puțin 8 GB RAM, iar după descărcarea modelelor dispozitivul nu mai trebuie să fie conectat la internet pentru a le rula. Ce înseamnă „local” și de ce contează operațional Rularea „local” înseamnă că modelul de inteligență artificială funcționează pe telefon (sau computer), nu pe servere la distanță („în cloud”). Consecința practică este că utilizatorul poate obține răspunsuri instant și poate folosi modelul și offline, după ce a descărcat pachetul necesar. În aplicație, zona relevantă pentru conversații este „AI Chat”, unde sunt disponibile mai multe modele. Cel mai nou model gratuit menționat în material este Gemma-4 , în variante marcate E2B și E4B, diferența fiind „mărimea” modelului: o cifră mai mare indică un model mai avansat, cu o bază de date mai mare. Limitări și setări care influențează calitatea răspunsurilor Materialul notează explicit că modelele care rulează pe telefon sunt mult mai mici decât cele din cloud, care au „trilioane de parametri”. De asemenea, utilizarea în limba română este posibilă, dar modelul „nu are la fel de multe informații ca în engleză” și poate greși. Aplicația permite și ajustări care schimbă comportamentul răspunsurilor, inclusiv: „Enable thinking” (modelul „gândește” mai mult înainte de răspuns); „temperatura”, setată implicit la 1: o valoare mai mare face răspunsurile mai „bogate în personalitate”, dar crește riscul de erori, potrivit sursei. Un detaliu tehnic relevant este că telefoanele mai noi au în procesor un modul special conceput pentru astfel de modele de inteligență artificială, ceea ce poate ajuta la rularea lor pe dispozitiv. [...]

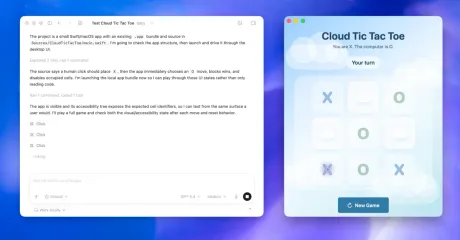

OpenAI extinde Codex cu funcții de „agent” care pot opera aplicații pe macOS , într-o mișcare menită să crească utilitatea practică a instrumentului de programare și să reducă distanța față de Claude Code de la Anthropic, potrivit The Verge . Actualizarea adaugă, între altele, capacitatea ca Codex să folosească aplicațiile de pe desktop „pe cont propriu”. OpenAI spune că agentul poate rula în fundal, fără să interfereze cu ce face utilizatorul în alte aplicații, iar mai mulți agenți pot lucra în paralel. Pentru dezvoltatori, compania indică utilizări precum testarea și iterarea modificărilor de interfață, testarea aplicațiilor sau lucrul în aplicații care nu oferă o interfață de programare (API). Disponibilitate: întâi macOS, UE „mai târziu” Funcția începe să fie livrată de astăzi utilizatorilor aplicației desktop Codex care sunt autentificați cu ChatGPT și, inițial, este limitată la macOS. OpenAI nu a oferit un calendar pentru extinderea către alte sisteme de operare. Utilizatorii din Uniunea Europeană vor trebui să aștepte, compania precizând că actualizarea va ajunge acolo „în curând”. Ce mai primește Codex în acest pachet Pe lângă controlul aplicațiilor de pe desktop, OpenAI include în pachet: generare și iterare de imagini cu „gpt-image-1.5”; noi extensii (plug-in-uri) pentru GitLab, Atlassian Rovo și Microsoft Suite; navigare web nativă printr-un browser în aplicație, unde utilizatorii pot comenta direct pe pagini pentru instrucțiuni mai precise; automatizări mai ușor de reluat, prin reutilizarea firelor de conversație și posibilitatea ca agentul să își programeze singur sarcini viitoare și să „se trezească” automat pentru a continua o activitate pe termen mai lung. Memorie „opt-in”, cu implicații directe în productivitate Codex va primi și o funcție de memorie, care îi permite să rețină context util din experiențe anterioare (de exemplu preferințe personale, corecții sau informații greu de strâns). OpenAI spune că funcția va fi opțională (opt-in) și va fi lansată în regim de previzualizare, cu scopul de a accelera sarcinile viitoare și de a livra rezultate care înainte necesitau instrucțiuni detaliate. Funcțiile de personalizare ar urma să ajungă „în curând” la utilizatorii Enterprise, Edu și din UE. De ce contează: competiția se mută din „scrie cod” în „fă treaba în aplicații” Pachetul vine pe fondul accelerării automatizării sarcinilor de programare și dezvoltare software și al competiției dintre OpenAI, Google și Anthropic. Publicația notează că rivalitatea cu Anthropic este tot mai vizibilă, după succesul Claude Code, iar OpenAI încearcă să recupereze printr-un Codex mai „agentic” — adică un instrument care nu doar generează cod, ci poate executa pași concreți în mediul de lucru al utilizatorului. [...]

Google Maps își automatizează mai agresiv moderarea conținutului, folosind Gemini pentru a bloca din fașă vandalizarea politică a denumirilor și pentru a limita recenziile spam , potrivit Android Authority . Miza este una operațională: reducerea intervențiilor reactive și a „curățeniei” făcute după ce modificările sau valurile de recenzii ajung deja să afecteze vizibilitatea unor locuri și afaceri. Filtru înainte de publicare pentru editările de nume Google spune că folosește Gemini în Google Maps pentru a identifica și opri editările de denumiri care încearcă să introducă „comentarii sociale sau politice”, astfel încât acestea să nu mai devină publice în aplicație. Android Authority notează că astfel de episoade apar ocazional, dar pot deveni virale, cum s-a întâmplat în trecut cu redenumiri „de protest” ale unor obiective. Abordarea indică o schimbare de metodă: mai puțin „prindem după” și mai mult „blocăm înainte”, cu ajutorul automatizării. Recenzii spam și șantaj: alerte și blocaje temporare A doua direcție vizează recenziile: Google își „îmbunătățește instrumentele” de detectare a recenziilor spam pentru afaceri locale, cu accent pe situații în care firmele sunt țintite de scheme de șantaj prin valuri de recenzii negative. În „următoarele câteva săptămâni”, utilizatorii ar trebui să vadă alerte în Maps atunci când Google a fost nevoit să blocheze temporar trimiterea de recenzii pentru un loc, din cauza degradării severe a calității contribuțiilor. Nu se schimbă regulile, ci aplicarea lor Google nu anunță o schimbare de politici, ci o aplicare mai automatizată a regulilor existente. Politicile Google Maps interzic conținutul care include „comentarii generale, politice sau sociale ori tirade personale”, iar noutatea este că Gemini ar urma să ajute la identificarea și oprirea mai rapidă a încălcărilor, înainte ca acestea să producă efecte vizibile în platformă. [...]