Știri

Știri din categoria Inteligență artificială

OpenAI a lansat GPT-5.3 Instant, o actualizare a modelului ChatGPT axată pe răspunsuri mai clare și conversații mai naturale, cu mai puține refuzuri inutile și o acuratețe îmbunătățită. Noua versiune este disponibilă din 3 martie 2026 pentru toți utilizatorii ChatGPT și pentru dezvoltatori prin API, sub numele „gpt-5.3-chat-latest”.

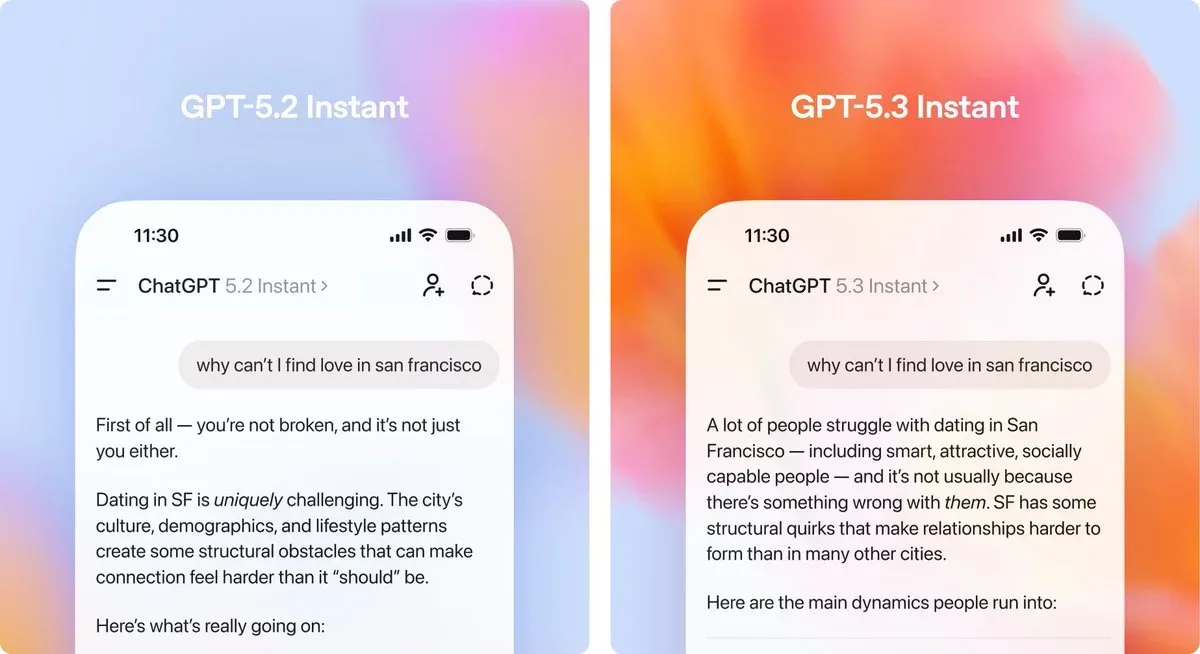

Noua actualizare vizează în special experiența zilnică a utilizatorilor: tonul conversației, relevanța răspunsurilor și fluiditatea dialogului. Compania spune că modelul răspunde acum mai direct la întrebări și evită introducerile lungi sau avertismentele excesive care întrerupeau conversația în versiunile anterioare.

Una dintre schimbările majore este modul în care modelul gestionează întrebările sensibile. În versiunea anterioară, GPT-5.2 Instant refuza uneori întrebări care puteau fi totuși abordate în siguranță sau începea răspunsul cu explicații lungi despre limitele sale.

GPT-5.3 Instant:

Astfel, conversațiile ar trebui să devină mai fluide și mai apropiate de dialogul natural.

Modelul a fost îmbunătățit și în modul în care combină informațiile găsite online cu propriile cunoștințe. În loc să listeze multe linkuri sau să rezume mecanic rezultatele căutării, GPT-5.3 Instant încearcă să sintetizeze informația și să ofere context.

Scopul este ca răspunsurile să fie:

OpenAI afirmă că noua versiune este mai fiabilă din punct de vedere factual. Conform evaluărilor interne, rata halucinațiilor a scăzut semnificativ:

| Tip evaluare | Reducere halucinații |

|---|---|

| Domenii sensibile (medicină, drept, finanțe) cu web | 26,8% |

| Domenii sensibile fără web | 19,7% |

| Conversații reale semnalate de utilizatori (cu web) | 22,5% |

| Conversații reale fără web | 9,6% |

Aceste îmbunătățiri sunt menite să reducă erorile factuale și să crească încrederea în răspunsuri.

OpenAI spune că GPT-5.3 Instant oferă și rezultate mai bune la scriere creativă sau redactare. Modelul ar trebui să producă texte mai expresive și mai variate, fără a pierde claritatea.

În același timp, compania recunoaște că există încă limitări. De exemplu, tonul conversațiilor în unele limbi, precum japoneza sau coreeana, poate suna încă rigid sau prea literal.

GPT-5.3 Instant este disponibil imediat în ChatGPT și în API pentru dezvoltatori. Modelul anterior, GPT-5.2 Instant, va rămâne accesibil încă trei luni în secțiunea „Legacy Models” pentru utilizatorii plătitori, urmând să fie retras pe 3 iunie 2026.

Actualizarea face parte din seria de îmbunătățiri continue ale platformei, care urmăresc să facă interacțiunea cu inteligența artificială mai naturală, mai utilă și mai fiabilă.

Recomandate

Google începe să înlocuiască Google Assistant cu Gemini în mașinile cu „Google built-in”, o schimbare care poate redesena rapid piața interfețelor vocale din auto. Potrivit TechCrunch , compania va începe implementarea asistentului Gemini în vehiculele compatibile, mizând pe interacțiuni mai „conversaționale” și pe integrarea mai profundă a serviciilor sale în experiența de condus. Implementarea vine la scurt timp după ce General Motors a anunțat că Gemini va ajunge la aproximativ 4 milioane de vehicule din anul de model 2022 și mai noi, din mărcile Cadillac, Chevrolet, Buick și GMC. Totuși, anunțul Google nu numește producători auto, ceea ce sugerează că extinderea nu se limitează la flota GM. Cum se face implementarea și cine primește actualizarea Lansarea începe în SUA, cu suport inițial pentru limba engleză, iar disponibilitatea ar urma să se extindă „în lunile următoare”. Un element important operațional: Gemini nu este rezervat doar mașinilor noi, ci va ajunge și pe unele vehicule existente, prin actualizări software, dacă sunt compatibile. Mașinile cu „Google built-in” au fost lansate în 2020, iar Google susține că actualizarea la Gemini schimbă modul în care șoferii interacționează cu mașina, făcând dialogul mai natural. Ce poate face Gemini în mașină Din informațiile prezentate, Gemini va putea acoperi atât funcții de infotainment, cât și comenzi legate de vehicul și comunicare, inclusiv: căutări și recomandări pe traseu (de exemplu, opriri pentru prânz), folosind date din Google Maps, cu întrebări de tip „follow-up” (parcare, meniu, preferințe alimentare); comenzi precum pornirea căldurii; direcții și recomandări de muzică; acces la informații despre vehicul; rezumarea mesajelor primite și ajutor pentru răspuns „hands-free” (fără mâini). Separat, Google introduce și „Gemini Live”, o funcție aflată în beta, pentru conversații mai deschise, în timp real. Aceasta poate fi activată din interfață sau prin comanda vocală „Hey Google, let’s talk”. Ce urmează: limbi, regiuni și integrare mai adâncă în ecosistemul Google Șoferii autentificați în contul Google, în vehicule compatibile, vor primi o opțiune de upgrade; după activare, Gemini poate fi accesat prin comenzi vocale, microfonul de pe ecran sau comenzile de pe volan. Google mai spune că vrea să extindă suportul către mai multe limbi și regiuni și că actualizări viitoare ar urma să aprofundeze integrarea cu servicii precum Gmail, Google Calendar și Google Home. În acest punct, compania nu oferă un calendar detaliat pentru aceste extinderi. [...]

Pentagonul își diversifică furnizorii de AI pentru rețele secrete , semnând acorduri cu șapte companii tehnologice și lăsând în afara listei Anthropic , pe fondul unei dispute legate de mecanismele de siguranță pentru utilizarea militară a inteligenței artificiale, potrivit Agerpres . Decizia are o miză operațională și de gestionare a riscului: integrarea unor „capacități avansate” de AI în rețele clasificate, în timp ce Pentagonul încearcă să evite blocaje de aprovizionare și o dependență prea mare de un singur furnizor, conform comunicatului citat de Reuters. Cine sunt furnizorii selectați și ce urmează să livreze Cele șapte companii cu care Departamentul american al Apărării a ajuns la acorduri sunt: SpaceX, OpenAI, Google, Nvidia, Reflection, Microsoft și Amazon. Unele dintre ele colaborau deja cu Pentagonul. Aceste soluții urmează să fie integrate în rețele cu „niveluri de impact 6 și 7”, o clasificare care se referă la efectele pe care compromiterea confidențialității, integrității sau disponibilității sistemelor informatice le-ar avea asupra securității naționale. De ce lipsește Anthropic din listă Comunicatul exclude Anthropic, companie aflată într-o dispută cu Pentagonul privind mecanismele de siguranță pentru utilizarea militară a AI. În același timp, sursa citată arată că există rezerve interne față de renunțarea la Anthropic: unii angajați ai departamentului, foști oficiali și furnizori de tehnologie care lucrează îndeaproape cu armata americană au declarat pentru Reuters că instrumentele firmei ar fi „mai bune decât alternativele”, deși s-a ordonat eliminarea lor în următoarele șase luni. Directorul pentru tehnologie al Departamentului Apărării, Emil Michael, a declarat pentru CNBC că Anthropic reprezintă în continuare un risc pentru lanțul de aprovizionare. Unde va fi folosită AI în armată Extinderea serviciilor de AI vizează utilizări precum: planificare; logistică; selectarea țintelor; alte activități operaționale, cu obiectivul de a simplifica și accelera operațiunile, potrivit comunicatului preluat de Reuters. [...]

Elon Musk a admis că xAI a folosit modele OpenAI pentru a antrena Grok , o recunoaștere care împinge în prim-plan „zona gri” a industriei AI privind distilarea modelelor și riscurile de încălcare a proprietății intelectuale, potrivit G4Media . Declarația a fost făcută într-un proces din California , în timpul unei audieri în care Musk a fost întrebat despre practicile de antrenare a modelelor de inteligență artificială. Discuția s-a concentrat pe „distilare” – o metodă prin care un model mai mare și mai performant este folosit pentru a antrena unul mai mic, transferându-i din capabilități. Întrebat direct dacă xAI a folosit tehnologia OpenAI în acest mod, Musk a evitat inițial un răspuns tranșant, spunând că „în general, toate companiile de AI” recurg la astfel de practici. Presat să clarifice, el a răspuns: „Parțial”. De ce contează: distilarea, între practică uzuală și dispută de proprietate intelectuală Distilarea este descrisă ca fiind larg utilizată în industrie, mai ales pentru a obține versiuni mai eficiente și mai accesibile ale unor sisteme complexe. În același timp, metoda a devenit controversată pe fondul disputelor legate de proprietatea intelectuală și de respectarea termenilor de utilizare. În acest context, articolul menționează mai multe poziții și reacții din industrie: Anthropic și OpenAI au atras atenția asupra riscurilor ca distilarea să fie folosită pentru a replica performanțele unor modele concurente fără a parcurge întregul proces de dezvoltare. Unele firme din China au fost acuzate că folosesc astfel de metode pentru a reduce costurile și timpul de dezvoltare. Google a anunțat măsuri pentru a limita ceea ce numește „atacuri de distilare”, pe care le consideră o posibilă formă de încălcare a proprietății intelectuale. Reprezentanții Anthropic au spus, într-o analiză publicată anterior, că distilarea este în esență o metodă legitimă și frecvent folosită pentru optimizarea modelelor proprii, dar care poate fi exploatată pentru avantaje competitive „discutabile”. Ce susține Musk Ulterior, Musk a spus că este „o practică standard” ca modelele de inteligență artificială să fie validate sau îmbunătățite cu ajutorul altor sisteme similare. Declarațiile vin pe fondul intensificării competiției în AI, într-un moment în care delimitarea dintre inovație, colaborare și utilizare controversată a tehnologiei devine tot mai dificilă, mai notează articolul. [...]

Elon Musk a recunoscut în instanță că xAI a folosit „distilarea” pe modele OpenAI pentru a antrena Grok , o practică ce poate eroda avantajul competitiv al laboratoarelor care investesc masiv în infrastructură de calcul și care, în același timp, ridică mizele privind aplicarea termenilor de utilizare ai modelelor, potrivit TechCrunch . Mărturia a fost dată joi, într-o instanță federală din California, în procesul în care Musk dă în judecată OpenAI , pe CEO-ul Sam Altman și pe Greg Brockman. Întrebat dacă xAI a folosit tehnici de distilare pe modele OpenAI pentru a antrena Grok, Musk a spus că este o practică generală în industrie, iar când i s-a cerut să confirme dacă răspunsul este „da”, a răspuns: „Parțial”. De ce contează: distilarea reduce bariera de cost și apasă pe regulile de utilizare Distilarea (în contextul modelelor de inteligență artificială) este o metodă prin care un model nou este antrenat să reproducă comportamentul unuia mai performant, prin interogări sistematice ale chatboturilor sau ale interfețelor de programare (API) puse la dispoziție public. Miza economică este că astfel pot fi obținute modele „aproape la fel de capabile” la costuri mai mici, subminând avantajul construit de jucătorii mari prin investiții în capacitate de calcul. TechCrunch notează că nu este clar dacă distilarea este explicit ilegală; mai degrabă, ar putea încălca termenii de utilizare impuși de companii pentru produsele lor. Reacția industriei: încercări de a bloca interogările „suspecte” În paralel, OpenAI, Anthropic și Google ar fi lansat, prin Frontier Model Forum, o inițiativă de schimb de informații despre cum pot fi combătute încercările de distilare, în special din China. Abordarea descrisă se bazează pe identificarea și prevenirea interogărilor în masă care pot „cartografia” comportamentul intern al modelelor. OpenAI nu a răspuns solicitării de comentariu privind declarația lui Musk, la momentul publicării articolului. Context din proces: poziționarea xAI în cursa globală În aceeași mărturie, Musk a fost întrebat despre o afirmație făcută vara trecută, potrivit căreia xAI ar urma să depășească în curând orice companie, cu excepția Google. El a clasat furnizorii de top astfel: Anthropic pe primul loc, urmată de OpenAI, Google și modele chinezești cu cod deschis, caracterizând xAI drept o companie mult mai mică, cu „câteva sute” de angajați. [...]

Procesul dintre Elon Musk și Sam Altman riscă să complice traseul OpenAI către o listare și să amplifice presiunea juridică asupra modelului său hibrid (nonprofit–profit), într-un moment în care compania este descrisă ca fiind „pregătită” pentru un IPO, potrivit Al Jazeera . Într-un proces federal din California , Musk – cofondator OpenAI – a depus mărturie pentru a doua zi, susținând că Altman a „trădat” promisiunile inițiale de a păstra organizația ca nonprofit „dedicată beneficiului umanității”. Litigiul pornește de la înființarea OpenAI în 2015 ca nonprofit și transformarea ulterioară într-o structură orientată spre profit. Musk a declarat în fața juraților că și-a pierdut încrederea că Altman va menține misiunea nonprofit și a spus că, spre finalul lui 2022, se temea că Altman încerca să „fure caritatea”, afirmând că „s-a dovedit a fi adevărat”. Altman a fost prezent în sală, dar nu a depus mărturie, conform relatării. Miza economică: IPO și modelul de finanțare Avocații OpenAI au respins acuzațiile și au susținut că nu a existat niciodată un angajament de a rămâne nonprofit. Compania afirmă că a creat o componentă cu scop lucrativ pentru a finanța nevoile mari de putere de calcul și pentru a atrage talente. În același timp, OpenAI ar fi „pregătită” pentru o ofertă publică inițială care ar putea evalua compania la 1.000 de miliarde de dolari, potrivit Reuters, citată de Al Jazeera. În acest context, disputa privind guvernanța și misiunea inițială poate deveni un factor de risc reputațional și juridic, cu potențiale efecte asupra investitorilor și structurii de control. Ce cere Musk în instanță Musk a investit aproximativ 38 de milioane de dolari (aprox. 174 milioane lei) în OpenAI între 2015 și 2017 și a părăsit organizația în 2018. În proces, el solicită: 150 de miliarde de dolari (aprox. 690 miliarde lei) despăgubiri de la OpenAI și Microsoft , cu orice sumă acordată direcționată către brațul caritabil al OpenAI; obligarea OpenAI să revină la statutul de nonprofit; înlăturarea lui Sam Altman și a cofondatorului Greg Brockman din conducere. Musk a mai susținut că organizația a fost „capturată” și a descris o ofertă de a investi, venită din partea lui Altman, ca părând „ca o mită”. Apărarea OpenAI: competiția cu xAI Echipa juridică a OpenAI afirmă că acțiunea lui Musk urmărește să submineze compania în favoarea propriei sale inițiative, xAI. OpenAI, organizată acum ca „public benefit corporation” (o formă corporativă care combină obiective comerciale cu o misiune de interes public), susține că demersul este alimentat de competiție și notează că xAI este în urma OpenAI la adopția de către utilizatori. Context suplimentar despre proces apare într-un material anterior al publicației, „stand for a second day”, disponibil aici: Al Jazeera . [...]

Google Photos va introduce vara aceasta o funcție care îți cataloghează automat hainele din fotografii și le transformă într-un „dulap digital” , cu opțiuni de filtrare, combinare în ținute și previzualizare „virtual try-on”, potrivit Google . Lansarea începe pe Android , urmând să ajungă ulterior și pe iOS, ceea ce mută aplicația din zona de stocare și organizare a imaginilor spre un instrument practic de planificare a ținutelor, bazat pe inteligență artificială . Ce face concret noua funcție și de ce contează operațional Funcția creează automat o colecție dedicată „wardrobe” (dulap) pe baza pieselor vestimentare care apar în biblioteca ta de fotografii. Practic, aplicația scanează imaginile și extrage articolele de îmbrăcăminte pe care le-ai purtat, apoi le organizează într-o structură ușor de parcurs. Din perspectiva utilizării de zi cu zi, noutatea este că utilizatorul nu mai pornește de la fotografii disparate, ci de la o „inventariere” a garderobei, generată automat, care poate reduce timpul de căutare și de planificare a ținutelor. Cum se folosește: filtrare, ținute și „probă” virtuală Google descrie trei utilizări principale: Filtrare pe categorii : poți vedea toate articolele la un loc sau poți intra pe o categorie (de exemplu bijuterii, topuri sau pantaloni) pentru a redescoperi piese „uitate” în dulap. Crearea de ținute : poți combina articolele pentru a construi outfituri, pe care le poți distribui prietenilor sau salva într-un „moodboard” (panou de inspirație) digital. Pot exista moodboard-uri separate pentru ocazii diferite, precum nunți de vară, o călătorie în Italia sau ținute de lucru. „Try it on” (probă virtuală) : selectezi piese individuale și folosești opțiunea „Try it on” pentru a vedea cum ar arăta o combinație înainte să te îmbraci. Când ajunge la utilizatori Funcția „wardrobe” va începe să fie disponibilă în această vară , mai întâi în Google Photos pe Android , apoi pe iOS , conform anunțului. Google nu oferă în material un calendar mai detaliat (date exacte) și nici informații despre disponibilitatea pe piețe sau condiții de acces. [...]