Știri

Știri din categoria Inteligență artificială

Nvidia a lansat DLSS 5 și un cip AI pentru centre de date spațiale, potrivit CNBC, marcând o dublă direcție strategică: grafică avansată pentru jocuri și extinderea inteligenței artificiale în orbită. Anunțul a fost făcut de CEO-ul Jensen Huang în cadrul conferinței GTC 2026 din San Jose.

Noua versiune DLSS 5 schimbă abordarea clasică a randării, introducând un model neuronal capabil să reconstruiască în timp real lumina, materialele și detaliile scenelor la rezoluții de până la 4K. Spre deosebire de versiunile anterioare, care îmbunătățeau performanța prin upscaling, această tehnologie „înțelege” scena și adaugă detalii fotorealiste direct la nivel de pixeli.

Printre elementele cheie:

DLSS 5 este programat pentru lansare în toamna lui 2026, însă demonstrațiile actuale arată cerințe hardware ridicate, fiind necesare două plăci video RTX 5090 pentru rulare optimă.

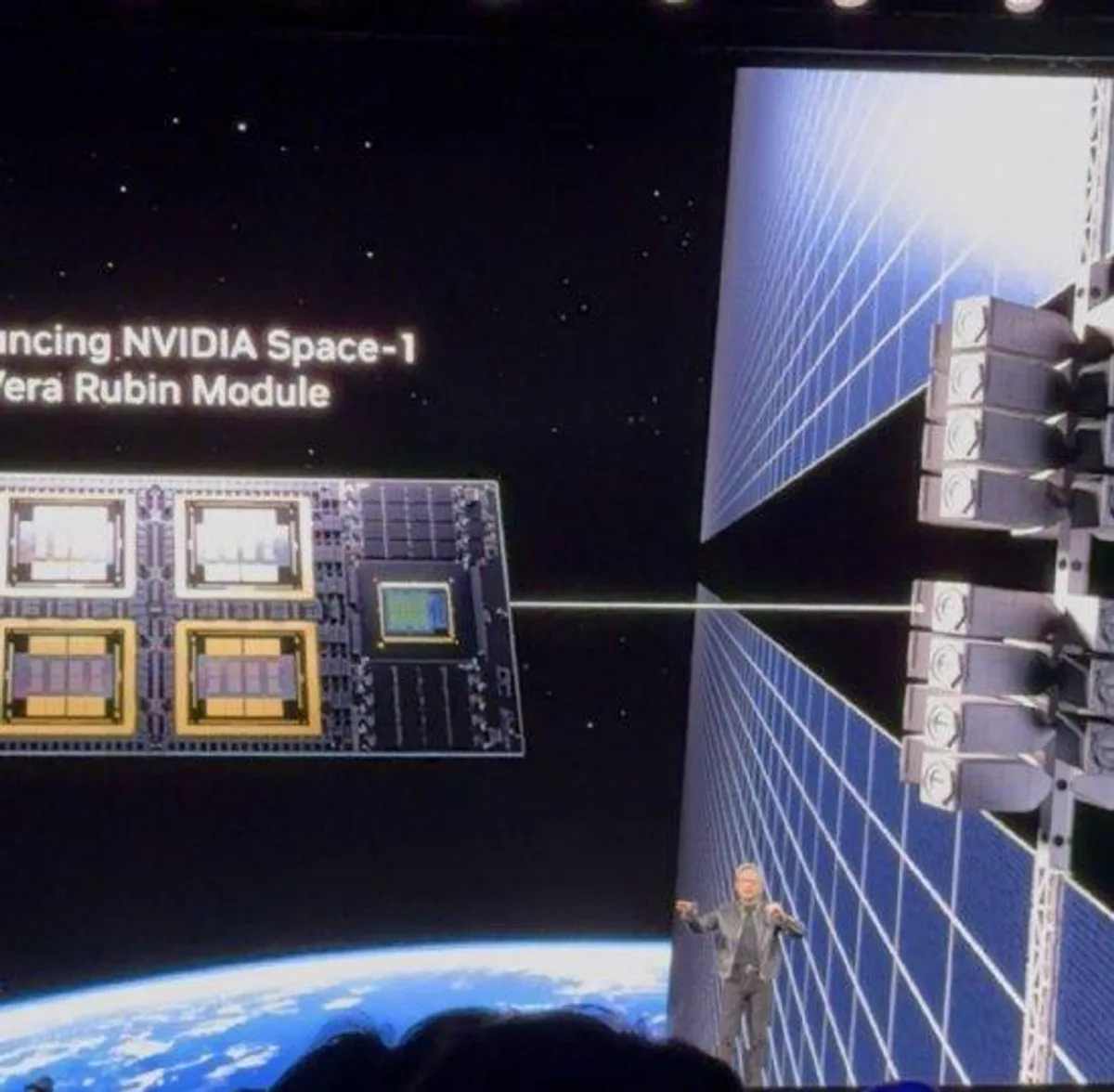

Nvidia a prezentat și Vera Rubin Space-1, un modul de calcul proiectat pentru funcționare în orbită, destinat centrelor de date spațiale. Acesta ar oferi de până la 25 de ori mai multă putere de procesare AI comparativ cu GPU-ul H100.

Caracteristici principale:

Compania colaborează deja cu parteneri precum Axiom Space și Planet Labs, iar primul test ar putea avea loc în noiembrie 2026, prin lansarea unui satelit echipat cu acest modul.

Deși ambițiile sunt mari, Nvidia recunoaște dificultățile tehnice, în special legate de răcirea sistemelor în spațiu. Totuși, interesul pentru centre de date orbitale crește, pe fondul accesului la energie solară continuă și al cererii uriașe pentru putere de calcul AI.

Prin aceste anunțuri, Nvidia încearcă să își consolideze poziția atât în industria jocurilor, cât și în infrastructura globală de inteligență artificială, extinzând competiția dincolo de Pământ.

Recomandate

Blocajele de reglementare care țin pe loc livrările Nvidia H200 către China pot accelera transferul de cotă de piață către Huawei , într-o piață locală de cipuri pentru inteligență artificială estimată să ajungă la 67 miliarde dolari (aprox. 308 miliarde lei) până în 2030, potrivit unei analize Tom's Hardware , care citează un reportaj Financial Times și estimări Morgan Stanley. Potrivit Financial Times (link în sursă), Huawei este „pe drumul” de a capta cea mai mare cotă din piața chineză de cipuri AI chiar din acest an, pe fondul cererii în creștere din partea companiilor chineze pentru alternative interne la Nvidia. Contextul: operațiunile Nvidia din China, care ar fi reprezentat anterior până la 25% din veniturile diviziei de centre de date, sunt afectate de restricții la export și bariere de reglementare impuse atât de SUA, cât și de China, pe fondul tensiunilor comerciale și tehnologice. De ce s-au blocat livrările H200: cerințe contradictorii SUA–China Tom’s Hardware notează că Jensen Huang, CEO-ul Nvidia, a confirmat în martie 2026 că firma a primit licențe din SUA pentru a vinde cipuri AI H200 către China și că a repornit producția pentru a acoperi cererea. Totuși, deși compania ar fi obținut aprobarea SUA și comenzi de la clienți chinezi, livrările au întâmpinat obstacole, cu posibile întârzieri legate de reglementările chineze de import. Financial Times susține că Beijingul ar fi instruit companiile chineze de tehnologie să limiteze utilizarea cipurilor Nvidia la operațiunile lor din afara țării, în timp ce sprijină producția internă. În paralel, autoritățile americane cer ca toate cipurile Nvidia comandate de clienți chinezi să fie folosite doar în China. Rezultatul, potrivit materialului: un blocaj la nivelul procedurilor vamale pentru H200, pe fondul acestor cerințe care se bat cap în cap. Pariul Huawei: „inference” și clustere, nu performanță brută Deși cipurile Nvidia rămân mai avansate, Huawei ar urmări o strategie diferită: țintește segmentul de „inference” (calculul folosit de modelele AI pentru a genera răspunsuri și a executa sarcini după finalizarea antrenării), descris ca fiind în creștere rapidă. Conform Financial Times, Huawei și-a poziționat procesoarele 950PR drept opțiunea preferată pentru companiile locale care rulează sarcini de inference. Argumentul Huawei, redat în articol: pe măsură ce asistenții AI și agenții autonomi devin mai răspândiți, inference ar urma să devină cea mai mare sursă de cerere pentru putere de calcul AI. Pentru că aceste sarcini sunt, în general, mai puțin solicitante decât antrenarea modelelor foarte mari, Huawei poate rămâne competitivă chiar dacă performanța brută a cipurilor este mai slabă. Pentru a compensa, compania ar lega un număr mare de cipuri folosind tehnologie proprie de rețelistică, construind clustere (grupuri de servere/cipuri care lucrează împreună) pentru a crește performanța la nivel de sistem. Un exemplu invocat: DeepSeek ar fi folosit cipul Huawei 950PR pentru inference, deși cel mai recent model v4 ar fi fost antrenat pe cipuri Nvidia, potrivit confirmării companiei menționate în articol. Miza economică: o piață de 67 mld. dolari și o pondere tot mai mare pentru furnizorii locali Estimările Morgan Stanley citate indică o schimbare structurală: piața de cipuri AI din China ar putea ajunge la circa 67 miliarde dolari (aprox. 308 miliarde lei) până în 2030, iar companiile locale ar urma să acopere aproximativ 86% din cerere. Tot Morgan Stanley estimează că furnizorii chinezi ar putea reprezenta, singuri, circa 21 miliarde dolari (aprox. 97 miliarde lei) din piață chiar în acest an. În paralel, Huawei își sprijină planurile de creștere pe capacitatea de producție internă: majoritatea cipurilor sale AI sunt fabricate de SMIC , iar compania ar plănui să adauge încă două fabrici dedicate în acest an. Dacă își crește producția cu succes, prognoza inițială de venituri ar putea fi depășită, potrivit articolului. Ce rămâne în avantajul Nvidia Chiar și cu presiunea de reglementare, Nvidia păstrează avantaje importante, în special ecosistemul software. Tom’s Hardware arată că, deși Huawei dezvoltă platforma Cann ca alternativă internă la CUDA (platforma software Nvidia folosită pe scară largă), dezvoltatorii spun că aceasta rămâne în urmă la capitolele ușurință de utilizare și maturitate. Costurile operaționale și complexitatea de dezvoltare pot crește pentru clienți, ceea ce ajută Nvidia să își mențină influența globală. În China, însă, „prinderea” Nvidia s-a slăbit după ce Washingtonul a blocat anul trecut vânzările H20 (un procesor modificat pentru piața chineză, conform cerințelor de export), iar compania ar avea dificultăți în a găsi un produs care să respecte simultan regulile americane și cerințele de reglementare chineze. „Ziua în care DeepSeek apare mai întâi pe Huawei este un rezultat groaznic pentru națiunea noastră – ar putea duce la un scenariu în care modelele AI din întreaga lume sunt dezvoltate și rulează cel mai bine pe hardware non-american”, a spus Jensen Huang, într-un interviu recent citat de articol. În lipsa unei deblocări rapide a livrărilor H200 și a unei soluții stabile de conformare pe ambele maluri, riscul operațional pentru Nvidia este ca piața chineză să se reorienteze accelerat către furnizori locali, cu efect direct asupra veniturilor și a influenței ecosistemului său în a doua cea mai mare economie a lumii. [...]

Google Photos va introduce vara aceasta o funcție care îți cataloghează automat hainele din fotografii și le transformă într-un „dulap digital” , cu opțiuni de filtrare, combinare în ținute și previzualizare „virtual try-on”, potrivit Google . Lansarea începe pe Android , urmând să ajungă ulterior și pe iOS, ceea ce mută aplicația din zona de stocare și organizare a imaginilor spre un instrument practic de planificare a ținutelor, bazat pe inteligență artificială . Ce face concret noua funcție și de ce contează operațional Funcția creează automat o colecție dedicată „wardrobe” (dulap) pe baza pieselor vestimentare care apar în biblioteca ta de fotografii. Practic, aplicația scanează imaginile și extrage articolele de îmbrăcăminte pe care le-ai purtat, apoi le organizează într-o structură ușor de parcurs. Din perspectiva utilizării de zi cu zi, noutatea este că utilizatorul nu mai pornește de la fotografii disparate, ci de la o „inventariere” a garderobei, generată automat, care poate reduce timpul de căutare și de planificare a ținutelor. Cum se folosește: filtrare, ținute și „probă” virtuală Google descrie trei utilizări principale: Filtrare pe categorii : poți vedea toate articolele la un loc sau poți intra pe o categorie (de exemplu bijuterii, topuri sau pantaloni) pentru a redescoperi piese „uitate” în dulap. Crearea de ținute : poți combina articolele pentru a construi outfituri, pe care le poți distribui prietenilor sau salva într-un „moodboard” (panou de inspirație) digital. Pot exista moodboard-uri separate pentru ocazii diferite, precum nunți de vară, o călătorie în Italia sau ținute de lucru. „Try it on” (probă virtuală) : selectezi piese individuale și folosești opțiunea „Try it on” pentru a vedea cum ar arăta o combinație înainte să te îmbraci. Când ajunge la utilizatori Funcția „wardrobe” va începe să fie disponibilă în această vară , mai întâi în Google Photos pe Android , apoi pe iOS , conform anunțului. Google nu oferă în material un calendar mai detaliat (date exacte) și nici informații despre disponibilitatea pe piețe sau condiții de acces. [...]

LG Electronics discută cu Nvidia o posibilă cooperare pe centre de date AI, robotică și mobilitate , o combinație care ar putea împinge compania sud-coreeană mai adânc în lanțul de furnizori pentru infrastructura AI și ar extinde prezența Nvidia dincolo de zona industrială, potrivit The Next Web . LG a confirmat miercuri că poartă discuții cu Nvidia pentru colaborare în trei direcții: robotică, centre de date pentru inteligență artificială și mobilitate. Întâlnirea a avut loc după o vizită la sediul LG din Yeouido (Seul) a lui Madison Huang, director senior Nvidia pentru platforme de „AI fizic” (inteligență artificială integrată în roboți și sisteme autonome), alături de reprezentanți ai altor companii tehnologice sud-coreene; la discuții a participat și CEO-ul LG, Ryu Jae-cheol. Nu există, deocamdată, un acord formal. Discuțiile sunt descrise ca fiind exploratorii, fără produse, sume de investiții sau calendare confirmate. De ce contează: miza comercială imediată pare să fie centrele de date Deși componenta de robotică este cea mai vizibilă public, materialul indică faptul că discuțiile despre centre de date și mobilitate ar putea avea o relevanță comercială mai rapidă. În zona centrelor de date, LG și-a poziționat deja oferta ca furnizor de soluții de răcire și management termic (HVAC) pentru centre de date AI, pe fondul creșterii densității de putere a clusterelor de GPU, care face răcirea convențională tot mai dificilă. O eventuală colaborare cu Nvidia ar plasa LG ca furnizor hardware în ecosistemul Nvidia la nivel de infrastructură, completând stratul de calcul (compute) cu cel de răcire, fără a concura direct cu acesta. Robotică: LG are platformă proprie, Nvidia are „stack”-ul de dezvoltare La CES 2026, LG a prezentat CLOiD, un robot pentru acasă cu două brațe articulate (șapte grade de libertate pe braț) și câte cinci degete acționate individual la fiecare mână, parte din viziunea „Zero Labor Home”, în care roboții și electrocasnicele conectate preiau sarcini casnice. Robotul rulează pe platforma proprie LG, „Affectionate Intelligence”, orientată spre conștientizare contextuală, interacțiune naturală și învățare continuă din mediul de acasă. În schimb, Nvidia vine cu Isaac (platforma sa pentru robotică), care include simulare, modele pre-antrenate pentru manipulare, infrastructură de „geamăn digital” (digital twin) bazată pe Omniverse și calcul pe GPU optimizat pentru inferență în timp real. Integrarea ar putea scurta drumul de la prototip la producție, printr-un flux de dezvoltare–implementare deja validat în industrie. Pentru Nvidia, un partener precum LG ar însemna acces la scară de consum: distribuție de masă, o bază instalată globală de electrocasnice conectate prin ecosistemul ThinQ și un plan explicit de a aduce roboți în locuințe — un mediu bogat în date pentru antrenare (sarcini reale, variabilitate mare). Mobilitate: integrare posibilă între „experiența din cabină” și platforma de calcul Pe mobilitate, discuțiile ar putea lega platforma Nvidia DRIVE (folosită pe scară largă pentru calcul AI în vehicule autonome și semi-autonome) de activitatea LG din componente auto. Divizia LG produce sisteme de infotainment, camere, componente pentru vehicule electrice și soluții AI în mașină (inclusiv urmărirea privirii, afișaje adaptive și platforme generative multimodale). O colaborare ar putea integra stratul de experiență AI din cabină al LG cu platforma de calcul DRIVE a Nvidia. Context: „AI-ul fizic” trece de la teste controlate la parteneriate comerciale Materialul plasează discuțiile în tendința mai largă de accelerare a „AI-ului fizic”, adică trecerea de la modele rulate în cloud la sisteme care operează în lumea reală (roboți, vehicule, logistică). Sunt menționate, ca repere, un trial Siemens–Nvidia într-o fabrică din Erlangen și o rundă de finanțare de 110 milioane de dolari (aprox. 506 milioane lei) atrasă de Sereact pentru scalarea AI-ului care face roboții adaptabili. În acest moment, singura certitudine este existența discuțiilor și ariile vizate; dacă și când se va ajunge la un acord, precum și forma concretă (produse, investiții, termene), rămân neconfirmate. [...]

Meta își consolidează strategia de „platformă” în robotica umanoidă prin achiziția startupului Assured Robot Intelligence (ARI) , într-o mișcare care sugerează că grupul vrea să devină furnizorul „stratului de inteligență” pentru roboți, nu neapărat un producător de hardware, potrivit The Next Web . Tranzacția a fost închisă în aceeași zi în care a fost anunțată, iar termenii financiari nu au fost făcuți publici. Cei doi cofondatori ARI — Lerrel Pinto (fost cofondator Fauna Robotics) și Xiaolong Wang (fost cercetător Nvidia și profesor asociat la UC San Diego) — au intrat în Meta Superintelligence Labs. De ce contează: Meta pariază pe „Android-ul” roboților umanoizi Miza nu este doar o achiziție de talent, ci întărirea unei strategii explicite: Meta vrea să reproducă în robotica umanoidă modelul prin care Android și cipurile Qualcomm au devenit fundația industriei smartphone-urilor. În această logică, Meta ar furniza senzori, software și modele de inteligență artificială (IA) pe care să le poată folosi și producători pe care compania nu îi deține și nu îi controlează. Publicația notează că Meta a lansat anul trecut Meta Robotics Studio , l-a recrutat pe fostul CEO Cruise Marc Whitten pentru a conduce efortul și a început să atragă aproximativ 100 de ingineri pentru a dezvolta atât hardware umanoid intern, cât și modelele IA care îl susțin. CTO-ul Andrew Bosworth a comparat pariul pe roboți umanoizi ca amploare cu cel pe realitate augmentată, domeniu în care Meta a cheltuit deja „zeci de miliarde” prin Reality Labs. Ce aduce ARI: control „whole-body” și senzori tactili Contribuția ARI este descrisă ca un set de capabilități pentru „inteligență robotică” menită să ajute roboții să înțeleagă, să anticipeze și să se adapteze comportamentului uman în medii neorganizate. Practic, este vorba despre: modele de control pentru întregul corp (coordonarea membrelor, echilibru, mișcare), pe baza inputului senzorial în timp real; e-Flesh , un senzor tactil care măsoară deformări în microstructuri imprimabile 3D folosind magneți și magnetometre, într-o zonă pe care sursa o descrie drept una dintre problemele încă nerezolvate ale roboticii umanoide: „simțul tactil”; cercetare relevantă pentru optimizarea și comprimarea modelelor IA , astfel încât să ruleze eficient pe resursele limitate de calcul dintr-un robot, fără a depinde de conexiuni permanente la centre de date. Context: piața se aglomerează, iar Meta alege „al doilea eșalon” The Next Web descrie o piață care a trecut rapid „de la speculativ la competitiv” și enumeră mai mulți jucători și ținte de producție, de la Tesla (Optimus) la 1X, Apptronik, Amazon și Unitree. În acest peisaj, analiza împarte competiția în trei categorii: producători integrați vertical (care proiectează și vând robotul complet), furnizori de platformă (stratul de inteligență/sistemul de operare/componente-cheie), furnizori de componente (cipuri, senzori). Meta se poziționează în categoria a doua, iar sursa notează că o strategie similară este urmărită și de Google, prin programul Gemini Robotics al DeepMind și parteneriatul cu Apptronik. Ce urmează: pariul depinde de cum se structurează industria Diferența față de pariurile anterioare pe hardware este că Meta nu încearcă, în această etapă, să producă hardware la scară mare, ci să ofere „creierul” — modelele, senzorii și stiva software — pentru ca alții să construiască „corpul”. Publicația subliniază însă că modelul „Android” funcționează doar dacă piața ajunge să aibă mulți producători care au nevoie de o platformă comună; dacă industria se consolidează în jurul câtorva jucători integrați vertical, cu IA proprietară, spațiul pentru o platformă neutră se îngustează. În acest cadru, achiziția ARI este prezentată ca o investiție pentru ca, atunci când vor apărea „echivalenții Samsung/Xiaomi” ai roboticii umanoide, să aibă deja la îndemână tehnologia Meta ca opțiune implicită. [...]

Google începe să înlocuiască Google Assistant cu Gemini în mașinile cu „Google built-in”, o schimbare care poate redesena rapid piața interfețelor vocale din auto. Potrivit TechCrunch , compania va începe implementarea asistentului Gemini în vehiculele compatibile, mizând pe interacțiuni mai „conversaționale” și pe integrarea mai profundă a serviciilor sale în experiența de condus. Implementarea vine la scurt timp după ce General Motors a anunțat că Gemini va ajunge la aproximativ 4 milioane de vehicule din anul de model 2022 și mai noi, din mărcile Cadillac, Chevrolet, Buick și GMC. Totuși, anunțul Google nu numește producători auto, ceea ce sugerează că extinderea nu se limitează la flota GM. Cum se face implementarea și cine primește actualizarea Lansarea începe în SUA, cu suport inițial pentru limba engleză, iar disponibilitatea ar urma să se extindă „în lunile următoare”. Un element important operațional: Gemini nu este rezervat doar mașinilor noi, ci va ajunge și pe unele vehicule existente, prin actualizări software, dacă sunt compatibile. Mașinile cu „Google built-in” au fost lansate în 2020, iar Google susține că actualizarea la Gemini schimbă modul în care șoferii interacționează cu mașina, făcând dialogul mai natural. Ce poate face Gemini în mașină Din informațiile prezentate, Gemini va putea acoperi atât funcții de infotainment, cât și comenzi legate de vehicul și comunicare, inclusiv: căutări și recomandări pe traseu (de exemplu, opriri pentru prânz), folosind date din Google Maps, cu întrebări de tip „follow-up” (parcare, meniu, preferințe alimentare); comenzi precum pornirea căldurii; direcții și recomandări de muzică; acces la informații despre vehicul; rezumarea mesajelor primite și ajutor pentru răspuns „hands-free” (fără mâini). Separat, Google introduce și „Gemini Live”, o funcție aflată în beta, pentru conversații mai deschise, în timp real. Aceasta poate fi activată din interfață sau prin comanda vocală „Hey Google, let’s talk”. Ce urmează: limbi, regiuni și integrare mai adâncă în ecosistemul Google Șoferii autentificați în contul Google, în vehicule compatibile, vor primi o opțiune de upgrade; după activare, Gemini poate fi accesat prin comenzi vocale, microfonul de pe ecran sau comenzile de pe volan. Google mai spune că vrea să extindă suportul către mai multe limbi și regiuni și că actualizări viitoare ar urma să aprofundeze integrarea cu servicii precum Gmail, Google Calendar și Google Home. În acest punct, compania nu oferă un calendar detaliat pentru aceste extinderi. [...]

Pentagonul își diversifică furnizorii de AI pentru rețele secrete , semnând acorduri cu șapte companii tehnologice și lăsând în afara listei Anthropic , pe fondul unei dispute legate de mecanismele de siguranță pentru utilizarea militară a inteligenței artificiale, potrivit Agerpres . Decizia are o miză operațională și de gestionare a riscului: integrarea unor „capacități avansate” de AI în rețele clasificate, în timp ce Pentagonul încearcă să evite blocaje de aprovizionare și o dependență prea mare de un singur furnizor, conform comunicatului citat de Reuters. Cine sunt furnizorii selectați și ce urmează să livreze Cele șapte companii cu care Departamentul american al Apărării a ajuns la acorduri sunt: SpaceX, OpenAI, Google, Nvidia, Reflection, Microsoft și Amazon. Unele dintre ele colaborau deja cu Pentagonul. Aceste soluții urmează să fie integrate în rețele cu „niveluri de impact 6 și 7”, o clasificare care se referă la efectele pe care compromiterea confidențialității, integrității sau disponibilității sistemelor informatice le-ar avea asupra securității naționale. De ce lipsește Anthropic din listă Comunicatul exclude Anthropic, companie aflată într-o dispută cu Pentagonul privind mecanismele de siguranță pentru utilizarea militară a AI. În același timp, sursa citată arată că există rezerve interne față de renunțarea la Anthropic: unii angajați ai departamentului, foști oficiali și furnizori de tehnologie care lucrează îndeaproape cu armata americană au declarat pentru Reuters că instrumentele firmei ar fi „mai bune decât alternativele”, deși s-a ordonat eliminarea lor în următoarele șase luni. Directorul pentru tehnologie al Departamentului Apărării, Emil Michael, a declarat pentru CNBC că Anthropic reprezintă în continuare un risc pentru lanțul de aprovizionare. Unde va fi folosită AI în armată Extinderea serviciilor de AI vizează utilizări precum: planificare; logistică; selectarea țintelor; alte activități operaționale, cu obiectivul de a simplifica și accelera operațiunile, potrivit comunicatului preluat de Reuters. [...]