Știri

Știri din categoria Inteligență artificială

Gigabyte a transformat standul de la MWC Barcelona 2026 într-o veritabilă „fabrică de inteligență artificială”, punând la dispoziția operatorilor telecom soluții hardware care promit să revoluționeze modul în care datele de rețea sunt monetizate.

Sub conceptul „AI Factories”, gigantul taiwanez a demonstrat cum infrastructura modernă poate transforma rețelele din simpli transportatori de date în platforme digitale inteligente, capabile de automatizare și analiză predictivă în timp real.

Vedeta incontestabilă a expoziției este sistemul GB300 NVL72, o soluție de tip rack scalabilă, răcită complet cu lichid (DLC), care integrează nu mai puțin de 72 de GPU-uri NVIDIA Blackwell Ultra și 36 de procesoare NVIDIA Grace. Această „bestie” tehnologică este optimizată pentru antrenarea modelelor de limbaj de miliarde de parametri și oferă o lățime de bandă uriașă prin tehnologiile NVIDIA Quantum-X800 InfiniBand, fiind gândită special pentru centrele de date care au nevoie de densitate maximă de calcul într-un spațiu redus.

Pentru segmentul de „edge computing” și uz personal, Gigabyte a adus la Barcelona modelul AI TOP ATOM, supranumit „supercomputerul de buzunar”. Echipat cu super-cipul NVIDIA GB10 Grace Blackwell, acest dispozitiv compact livrează o putere de calcul de 1 petaFLOP direct pe birou, permițând dezvoltatorilor să realizeze prototipuri și fine-tuning pentru modele AI complexe fără a depinde de resursele din cloud.

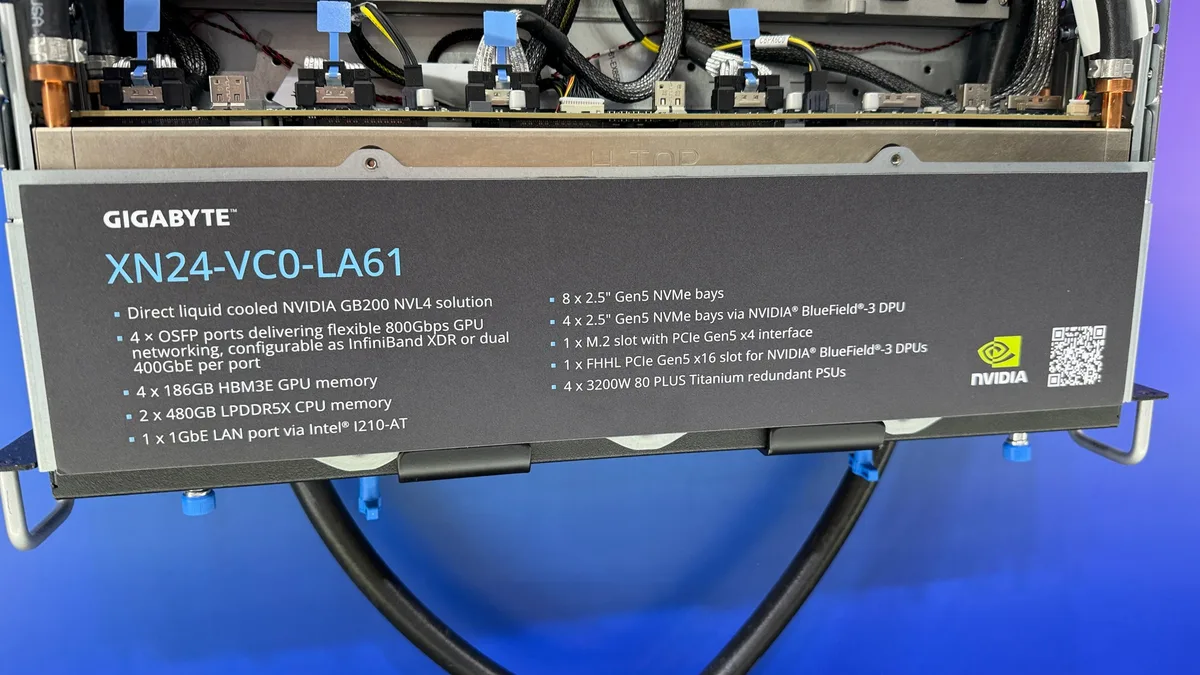

Pe lângă forța brută, Gigabyte a pus un accent major pe sustenabilitate și eficiență termică. Au fost prezentate servere precum B683-Z80-LAS1, care utilizează răcirea lichidă directă pentru a elimina până la 91% din căldura sistemului, și platforma densă XN24-VC0-LA61, care înghesuie arhitectura NVIDIA GB200 NVL4 într-un șasiu compact de 2U. Aceste inovații sunt vitale pentru operatorii telecom care doresc să își extindă capacitățile AI respectând în același timp standardele stricte de consum energetic „green computing”.

Iată cum funcționează răcirea:

Am remarcat și că exista un mecanism de detectare a pierderilor de lichid, pentru că răcirea cu lichid e la mare căutare.

Recomandate

Inteligența artificială mută presiunea de pe „numărul de joburi” pe „conținutul joburilor” , iar companiile care o adoptă ajung să automatizeze sarcini, nu să elimine profesii întregi, susține CEO-ul Nvidia, Jensen Huang , într-o intervenție citată de Economedia . Mesajul are relevanță economică directă: dacă AI crește productivitatea, cererea se poate muta către competențe noi, nu neapărat către mai puțini angajați. Huang a făcut declarațiile la Stanford Graduate School of Business, în contextul unei discuții mai largi despre temerile legate de impactul AI asupra pieței muncii, potrivit Fortune (sursă citată de Economedia). În opinia lui, „narațiunea” conform căreia AI distruge locuri de muncă este greșită și contraproductivă, pentru că tehnologia schimbă activitățile zilnice, dar nu „elimină pur și simplu” joburile. Exemplul radiologilor: automatizare a sarcinilor, creștere a cererii Pentru a-și susține argumentul, CEO-ul Nvidia a invocat radiologia. În 2016, informaticianul Geoffrey Hinton estima că radiologii vor fi înlocuiți de AI, pe fondul progreselor în analiza imaginilor medicale. Huang spune că, la aproape un deceniu distanță, predicția s-a confirmat doar parțial: AI a ajuns să asiste practic fiecare investigație, însă numărul radiologilor a crescut. Cheia, în explicația lui, este diferența dintre „sarcinile” unui job și „scopul” lui. În radiologie, rolul nu se reduce la interpretarea imaginilor, ci include diagnosticarea și colaborarea cu pacienții și cu alți medici. Cu AI, radiologii pot procesa mai multe cazuri și trata mai mulți pacienți, ceea ce poate alimenta cererea pentru specialiști. Potrivit estimărilor citate, domeniul radiologiei ar urma să crească cu aproximativ 25% până în 2055. România: adopție încă limitată, dar presiune pe competențe În România, impactul AI asupra locurilor de muncă este descris ca moderat, pe fondul unei implementări încă limitate în companii. Un sondaj eJobs menționat de Economedia arată că 8 din 10 angajatori nu se așteaptă ca AI să reducă volumul de recrutare în următorii doi ani, însă anticipează schimbări în competențele cerute candidaților. În același timp, articolul notează că, deși AI începe să automatizeze sarcini repetitive și să crească productivitatea, majoritatea companiilor nu au integrat încă tehnologia la nivel strategic. Concedieri în tech: eficientizare și finanțarea investițiilor în AI În contrast cu mesajul că profesiile nu dispar, Economedia amintește că mari companii tech au început concedieri. Meta Platforms ar urma să reducă 10% din personal (aproximativ 8.000 de angajați) în luna mai, în încercarea de a-și eficientiza operațiunile și de a finanța investiții masive în inteligența artificială. Pentru piața muncii, concluzia practică din aceste exemple este că AI tinde să redistribuie munca: automatizează activități, ridică așteptările de productivitate și mută competiția către calificări, chiar dacă, în unele sectoare, poate coexista cu creșterea cererii de specialiști. [...]

Nvidia își extinde utilizarea internă a OpenAI Codex , iar peste 10.000 de angajați folosesc deja varianta bazată pe GPT-5.5 , într-o mișcare care indică o accelerare a automatizării muncii de programare și a fluxurilor conexe la scară de companie, potrivit IT之家 . Conform informațiilor, Nvidia a transmis printr-un comunicat oficial că Codex este alimentat de cel mai nou model „de frontieră” al OpenAI, GPT-5.5, și rulează pe sistemul de tip rack GB200 NVL72 al Nvidia. În interiorul companiei, utilizarea Codex s-a extins dincolo de echipele de inginerie, acoperind și produs, juridic, marketing, financiar, vânzări, resurse umane, operațiuni și programe pentru dezvoltatori. De ce contează: costul și eficiența fac posibilă rularea la scară „enterprise” Articolul indică faptul că inginerii Nvidia folosesc Codex cu GPT-5.5 de câteva săptămâni, iar creșterea de eficiență „poate fi cuantificată”. Nvidia leagă această scalare de infrastructura GB200 NVL72, despre care afirmă că, față de generația anterioară: reduce costul pe un milion de tokeni (unități de text procesate de modele) de 35 de ori ; crește „outputul” de tokeni pe megawatt pe secundă cu 50 de ori . În logica prezentată, avantajul combinat de cost și eficiență energetică ar fi elementul care face fezabilă inferența (rularea modelului pentru a genera rezultate) la nivel de companie, nu doar în proiecte punctuale. Impact operațional: timpi mai scurți de depanare și livrare de funcționalități În exemplele oferite, sarcini care anterior necesitau zile pentru depanare ar putea fi închise în câteva ore, iar experimente în baze de cod complexe, care durau săptămâni, ar putea produce rezultate „peste noapte”. Textul mai susține că echipele pot livra funcționalități „cap-coadă” prin instrucțiuni în limbaj natural, cu o fiabilitate mai bună decât la modelele mai vechi și cu mai puțin „timp mort” și refaceri. Mesaj intern: Jensen Huang cere adoptare generalizată IT之家 notează că Jensen Huang, fondator și CEO al Nvidia, le-a cerut angajaților într-un e-mail intern să folosească Codex. „Să trecem la viteza luminii, bine ați venit în era AI.” [...]

Tehnologia cu inteligență artificială intră în deminarea din Ucraina prin drone și roboți folosiți pentru detectarea și cartografierea dispozitivelor explozive, într-un context în care contaminarea cu muniții neexplodate rămâne o problemă operațională majoră. Potrivit Agerpres , prințul Harry a participat vineri, la Bucea, la o sesiune de instruire în tehnici de deminare care includ utilizarea dronelor și a roboților, în cadrul unei vizite în Ucraina. În a doua zi a vizitei sale, ducele de Sussex a pilotat o dronă echipată cu inteligență artificială, descrisă de organizația caritabilă Halo Trust ca având rolul de a detecta și cartografia dispozitive explozive. În paralel, el a manevrat și un robot – inclusiv un „câine robotizat”, conform fotografiilor publicate – construit pentru recuperarea obiectelor periculoase de la sol. Ce se schimbă în teren: de la căutare manuală la cartografiere asistată de AI Prințul Harry a spus că a fost „impresionat” de contribuția tehnologiei la o deminare „mai inteligentă, mai rapidă și mai sigură”, comparând metodele actuale cu cele de acum aproape 30 de ani, când, potrivit declarației sale, geniștii lucrau „în genunchi” pentru a găsi explozibilii ascunși. „Astăzi, ei utilizează drone, inteligența artificială și roboți pentru mai multă precizie și siguranță.” În aceeași declarație, el a adăugat că această evoluție „salvează și vieți”. Contextul vizitei: Bucea și mesajul politic de la Kiev Vizita la Bucea a inclus și un omagiu adus victimelor masacrelor atribuite armatei Moscovei la începutul invaziei ruse, orașul fiind situat la aproximativ 30 de kilometri nord-vest de Kiev. Agerpres amintește că zeci de civili au fost găsiți decedați în localitate după eliberarea ei de către armata ucraineană, la sfârșitul lunii martie 2022. Cu o zi înainte, la Kiev, prințul Harry i-a cerut public președintelui rus Vladimir Putin să pună capăt războiului și a îndemnat Statele Unite să se implice în negocierile de pace, conflictul fiind descris ca intrat în al cincilea an. [...]

Un nou mod de a antrena roboți să învețe singuri din demonstrații umane ar putea accelera folosirea lor în gospodării și la locul de muncă, dar mută discuția spre reguli de siguranță și responsabilitate. Într-un material publicat de NPR , o echipă de cercetători din Elveția descrie un progres care permite roboților să execute sarcini mai complexe după ce „privesc” oameni, fără a fi programați pas cu pas pentru fiecare situație. Cercetarea este realizată la École Polytechnique Fédérale de Lausanne (EPFL) și a fost publicată în revista Science Robotics . Ideea centrală: roboții pot folosi „învățarea automată” (o ramură a inteligenței artificiale) împreună cu ceea ce autorii numesc „inteligență cinematică” – adică o „înțelegere” internă a modului în care propriul corp se poate mișca în siguranță în spațiu – pentru a adapta o acțiune văzută la un om la propriile constrângeri fizice. Ce s-a demonstrat și de ce contează operațional Într-o demonstrație video descrisă în material, roboți cu un singur braț, fixați pe o bază, urmăresc un instructor uman care aruncă o minge într-un recipient. Apoi, roboții repetă sarcina, ajustându-se la poziția lor și la faptul că nu au „corp” uman. Mai mult, abilitățile învățate pot fi transferate către alți roboți. Miza practică este depășirea unei limite vechi în robotică: multe sisteme pot repeta impecabil o mișcare în condiții identice, dar eșuează când se schimbă contextul (poziția obiectelor, lumina, mediul). Cercetătorul Sthithpragya Gupta explică problema printr-un exemplu din tenis: robotul poate învăța un backhand, dar dacă se schimbă condițiile, performanța „se prăbușește”. „Conștienți de sine” sau doar mai buni la auto-corectare? Materialul folosește termenul „self-aware” („conștient de sine”) într-un sens tehnic, legat de capacitatea robotului de a se auto-corecta și de a-și folosi modelul intern al mișcării pentru a învăța. Susan Schneider, cercetătoare în inteligență artificială la Florida Atlantic University, atrage însă atenția că asta nu înseamnă conștiință în sens uman. Diferența, spune ea, este „simțirea” – experiența subiectivă. Cu alte cuvinte, un robot poate învăța și ajusta comportamente fără să aibă trăiri interioare. Implicația-cheie: nevoia de „garduri” și reguli pentru operare Tocmai această capacitate de învățare mai autonomă ridică întrebări de siguranță. Schneider spune că astfel de evoluții „ridică imediat semnale de alarmă” pentru cercetătorii din zona de siguranță a AI, inclusiv prin posibilitatea ca versiuni viitoare să fie folosite ca arme împotriva oamenilor. Cercetătorii afirmă că au inclus protocoale de siguranță pentru a se asigura că roboții nu pot răni oameni, dar recunosc că dezvoltarea ulterioară va avea nevoie de „garduri de protecție”. Gupta indică explicit necesitatea unor cadre de reglementare privind cine operează un robot și în ce condiții. Cât de repede ajung astfel de roboți în case și companii Robert Platt, profesor care studiază ingineria și robotica la Northeastern University, numește rezultatul un posibil „punct de cotitură” și un „progres major”, dar evită să avanseze un calendar pentru adoptarea pe scară largă a roboților în gospodării. Argumentul lui: ritmul schimbării este foarte rapid, iar exemplul modelelor lingvistice mari (chatboți de tip ChatGPT sau Claude) arată cât de repede se poate comprima distanța dintre „suntem departe” și „deja se întâmplă”. În esență, progresul descris sugerează o accelerare a capabilităților operaționale ale roboților în medii variabile – iar asta mută presiunea spre standarde de siguranță, reguli de utilizare și responsabilitate pentru cei care îi pun în funcțiune. [...]

Nothing mută dictarea cu AI la nivel de sistem pe telefoanele sale , o abordare care poate schimba modul în care utilizatorii folosesc transcrierea în aplicații, printr-o integrare directă în software-ul dispozitivului, nu doar ca aplicație separată, potrivit TechCrunch . Compania a lansat Essential Voice , un instrument care transformă vorbirea în text „formatat” în orice aplicație și elimină automat interjecții precum „um” și „ah”. Essential Voice este disponibil acum pe Nothing Phone (3), iar compania spune că urmează să fie extins pe Phone (4a) Pro mai târziu în această lună și pe Phone (4a) luna viitoare. Ce aduce Essential Voice, concret Instrumentul funcționează la nivel de sistem (adică poate fi folosit în diverse aplicații, fără a depinde de o aplicație dedicată) și include câteva funcții orientate spre productivitate: transcrierea vorbirii în text, cu editare automată pentru a elimina „cuvintele de umplutură”; „scurtături” vocale personalizate pentru cuvinte, linkuri, șabloane și expresii repetate (de exemplu, o comandă precum „adresa mea” poate insera adresa completă); traducere directă dintr-o limbă în alta; la lansare, Nothing afirmă că sunt suportate peste 100 de limbi. Accesul se face fie prin apăsarea tastei „Essential” (acolo unde există pe dispozitiv), fie prin activarea din tastatură. De ce contează: integrarea la nivel de sistem poate deveni noul standard TechCrunch notează că Nothing este printre primele companii care oferă o integrare de dictare la nivel de sistem. În același timp, publicația indică faptul că, după lansarea recentă de către Google a unei aplicații de dictare offline, este posibil ca mai multe companii să vină cu instrumente similare. Pe termen scurt, Nothing spune că va introduce și „stilizare” personalizată în funcție de aplicație, astfel încât utilizatorii să poată ajusta tonul editării AI în categorii precum „muncă” și „mesagerie” (funcție anunțată pentru viitor, fără un calendar detaliat în material). [...]

Cipurile TPU ale Google au ajuns la 121 exaflopși, o miză directă pentru costul și viteza rulării modelelor AI : potrivit Google Cloud , cea mai nouă generație de Tensor Processing Units (TPU) poate procesa 121 exaflopși putere de calcul și vine cu o lățime de bandă dublă față de generațiile anterioare, într-un moment în care sarcinile de lucru pentru inteligență artificială devin tot mai „grele”. TPU-urile sunt cipuri specializate, proiectate „pentru un singur job”: efectuarea de calcule matematice la scară foarte mare, necesare pentru antrenarea și rularea modelelor AI. Google spune că le-a proiectat „de la zero” în urmă cu mai bine de un deceniu, tocmai pentru a rula astfel de modele. De ce contează pentru companii: performanță mai mare pe infrastructură dedicată AI În practică, creșterea de putere de calcul și de lățime de bandă are impact operațional: poate reduce timpii de procesare pentru sarcini AI și poate susține modele mai mari sau mai multe cereri simultane, în funcție de modul în care sunt folosite aceste resurse în infrastructură. Google își poziționează TPU-urile ca infrastructură din spatele produselor sale de zi cu zi, subliniind că aceste cipuri sunt construite pentru a accelera calculele care stau la baza funcționării modelelor AI. Ce a comunicat concret Google Din informațiile publicate, elementele tehnice punctuale sunt: TPU = „Tensor Processing Unit”, cip personalizat pentru calcule matematice la scară mare; proiectate de Google de peste un deceniu pentru rularea modelelor AI; cea mai nouă generație: 121 exaflopși și lățime de bandă dublă față de generațiile anterioare. Materialul include și un video explicativ despre modul în care funcționează TPU-urile, fără alte detalii financiare sau de disponibilitate comercială în textul extras. [...]