Știri

Știri din categoria Inteligență artificială

Jensen Huang spune că AI declanșează „cea mai mare construcție de infrastructură tehnologică” și împinge economia spre reindustrializare. Într-un discurs la ceremonia de absolvire a Carnegie Mellon University, CEO-ul NVIDIA a descris, potrivit NVIDIA, inteligența artificială drept motorul unei transformări care va schimba „fiecare industrie”, cu efecte directe asupra investițiilor în infrastructură și asupra modului în care se organizează munca.

Huang a tras o paralelă între începutul carierei sale în perioada „revoluției PC” și momentul actual, pe care îl numește începutul „revoluției AI”. Mesajul central: schimbarea de platformă tehnologică este mai amplă decât cele anterioare (PC, internet, mobil, cloud) deoarece „inteligența” este „fundamentală” pentru toate domeniile economiei.

În discurs, Huang a susținut că AI alimentează „cea mai mare extindere a infrastructurii tehnologice din istoria omenirii” și o „oportunitate o dată pe generație” de a „reindustrializa America” și de a reconstrui capacitatea țării „de a produce/ a construi”.

El a extins impactul dincolo de sectorul tehnologic, indicând că beneficiile și cererea de competențe vor apărea într-o plajă largă de ocupații, inclusiv în meserii și roluri operaționale precum electricieni, instalatori, muncitori în construcții metalice, tehnicieni și „toate tipurile de constructori”.

Huang a argumentat că AI „automatizează sarcini, dar ridică nivelul lucrătorilor”, insistând asupra diferenței dintre „sarcină” și „scopul” unei profesii. Exemplul folosit a fost radiologia: AI poate automatiza citirea imaginilor (sarcina), dar rolul medicului rămâne îngrijirea pacientului (scopul), ceea ce ar muta accentul spre activități cu valoare mai mare.

O parte importantă a mesajului a vizat riscurile și guvernanța (setul de reguli și mecanisme de control) pentru AI. Huang a spus că „responsabilitatea generației noastre” este să avanseze AI „înțelept” și a cerut ca dezvoltarea capabilităților să meargă împreună cu „siguranța AI”.

În același timp, a atribuit un rol explicit decidenților publici, care ar trebui să creeze „balize/limite” („guardrails”) pentru protecția societății, fără a bloca inovația. Recomandarea lui pentru a „răspunde momentului” a fost un set de patru direcții urmărite simultan:

Discursul a fost ținut duminică, la ceremonia de absolvire (a 128-a) a Carnegie Mellon University, în Pittsburgh, Pennsylvania. Huang a amintit rolul universității în istoria AI și roboticii și a primit titlul onorific de Doctor în Știință și Tehnologie, una dintre distincțiile majore ale instituției.

În final, el a îndemnat absolvenții să se implice activ în modelarea direcției tehnologiei, avertizând că retragerea societății din fața tehnologiei nu oprește progresul, ci reduce capacitatea de a-i influența efectele.

Recomandate

NVIDIA spune că a început deja să obțină câștiguri măsurabile de productivitate după ce a pus la dispoziția angajaților aplicația Codex de la OpenAI , alimentată de noul model GPT‑5.5 și rulată pe sisteme NVIDIA GB200 NVL72 , potrivit NVIDIA Blog . Miza, dincolo de „lansare”, este una operațională: compania descrie scurtarea ciclurilor de depanare și accelerarea livrării de funcționalități în proiecte complexe, pe fondul unor costuri și performanțe de inferență (rulare a modelului) pe care le consideră viabile la scară de întreprindere. În material, NVIDIA afirmă că peste 10.000 de angajați din arii precum inginerie, produs, juridic, marketing, finanțe, vânzări, HR, operațiuni și programe pentru dezvoltatori folosesc deja Codex cu GPT‑5.5. Inginerii ar fi avut acces „de câteva săptămâni”, iar compania susține că efectele se văd în timpii de lucru: cicluri de debugging care „se întindeau pe zile” s-ar închide acum „în ore”, iar experimente care necesitau „săptămâni” ar ajunge la progres „peste noapte” în baze de cod complexe, cu mai multe fișiere. De ce contează: productivitate internă, susținută de infrastructură și costuri de inferență NVIDIA leagă aceste rezultate de rularea pe GB200 NVL72, despre care spune că poate livra „de 35 de ori” cost mai mic per milion de tokeni și „de 50 de ori” mai mult output de tokeni pe secundă per megawatt față de generația anterioară. În interpretarea companiei, această „economie” ar face inferența pentru modele de vârf fezabilă la scară enterprise, adică suficient de ieftină și eficientă energetic pentru utilizare pe scară largă în organizații. Compania mai susține că echipele pot livra funcționalități „end-to-end” pornind de la prompturi în limbaj natural, cu fiabilitate mai bună și mai puține cicluri irosite decât la modele anterioare, fără a detalia însă indicatori cantitativi interni (de tip ore economisite, costuri sau rate de defecte). Cum a fost „împachetat” pentru medii corporate: VM-uri, audit și acces limitat Un element central al implementării descrise este controlul asupra datelor și al accesului. Codex ar suporta conexiuni SSH (Secure Shell) la mașini virtuale (VM) aprobate în cloud, astfel încât agenții să lucreze cu date reale ale companiei fără expunere externă, potrivit NVIDIA. Pentru „securitate și auditabilitate”, NVIDIA IT ar fi livrat câte o mașină virtuală în cloud pentru fiecare angajat, ca „sandbox” dedicat. Implementarea ar include: politică de „zero data retention” (fără păstrarea datelor), acces la sisteme de producție în regim „read-only” (doar citire) prin interfețe de linie de comandă și „Skills” (un set de unelte pentru agenți, folosite și în automatizările interne ale companiei). Context: colaborarea NVIDIA–OpenAI și dimensiunea infrastructurii NVIDIA plasează rollout-ul GPT‑5.5/Codex într-un parteneriat cu OpenAI început în 2016, când Jensen Huang ar fi livrat personal primul supercomputer NVIDIA DGX‑1 la sediul OpenAI din San Francisco. Compania mai afirmă că OpenAI s-a angajat să implementeze „peste 10 gigawați” de sisteme NVIDIA pentru infrastructura sa de generație următoare, o extindere care „va pune milioane de GPU-uri NVIDIA” la baza antrenării și inferenței pentru anii următori. În același context, NVIDIA menționează un „milestone” comun: aducerea în funcțiune a „primului cluster GB200 NVL72 cu 100.000 de GPU-uri”, despre care spune că a rulat antrenări la scară mare și a stabilit un nou reper de fiabilitate la nivel de sistem. Într-un e-mail intern citat de companie, CEO-ul Jensen Huang le-ar fi cerut angajaților să folosească Codex: „Să trecem la viteza luminii. Bine ați venit în era AI.” Pentru detalii despre model, NVIDIA trimite la anunțul OpenAI: OpenAI . [...]

NVIDIA și partenerii săi au deschis ca standard MRC, un protocol care crește reziliența rețelelor pentru antrenarea AI la scară foarte mare , după ce a fost folosit în producție pe infrastructura Spectrum‑X, potrivit NVIDIA . Miza este una operațională: în clustere cu mii de GPU-uri, întreruperile sau congestia de rețea pot încetini ori opri antrenări lungi și costisitoare, iar MRC este proiectat să reducă aceste blocaje prin rutare pe mai multe căi și recuperare rapidă la pierderi de pachete. Ce este MRC și de ce contează pentru „fabricile” de AI MRC (Multipath Reliable Connection) este descris ca un protocol de transport RDMA (Remote Direct Memory Access – tehnologie care permite transferuri de date cu latență mică, ocolind o parte din procesarea clasică a sistemului de operare). Concret, MRC permite ca o singură conexiune RDMA să distribuie traficul pe mai multe rute din rețea, cu efecte urmărite direct în exploatare: creșterea debitului (throughput) prin folosirea simultană a mai multor căi; echilibrarea încărcării (load balancing) pentru a evita „punctele fierbinți”; disponibilitate mai bună, prin ocolirea automată a segmentelor cu probleme. NVIDIA susține că MRC ajută la menținerea unui nivel ridicat de utilizare a GPU-urilor, tocmai prin faptul că „ține” lățimea de bandă necesară pe durata antrenării și reduce timpii morți generați de problemele de rețea. Cum funcționează reziliența: rerutare în microsecunde și retransmisie „inteligentă” În arhitectura descrisă, MRC folosește mecanisme care vizează două tipuri de incidente frecvente la scară mare: congestia și pierderile de date. Pe congestie, protocolul ar evita dinamic rutele supraîncărcate „în timp real”, pentru a susține lățime de bandă ridicată chiar și când rețeaua este aglomerată. La pierderi de date, NVIDIA indică o retransmisie „rapidă și precisă”, menită să limiteze efectul întreruperilor scurte asupra joburilor de lungă durată. Un element cheie este „failure bypass”: tehnologia ar detecta o cădere de rută și ar reruta traficul automat, în hardware, „în doar microsecunde” — un detaliu relevant pentru antrenarea distribuită, unde sincronizarea între mii de GPU-uri este sensibilă la întreruperi. Cine îl folosește și cum ajunge un standard deschis NVIDIA indică drept utilizatori ai Spectrum‑X Ethernet (în acest context) OpenAI, Microsoft și Oracle. În plus, compania afirmă că centrele de date Microsoft Fairwater și Oracle Cloud Infrastructure (OCI) Abilene se bazează pe MRC pentru cerințe de performanță, scalare și eficiență. Un punct cu impact de industrie este că MRC, după utilizarea în producție cu performanță optimizată pe hardware Spectrum‑X, a fost „lansat ca specificație deschisă” prin Open Compute Project (OCP) — o mișcare care, în mod tipic, facilitează adoptarea mai largă și interoperabilitatea între furnizori. NVIDIA mai precizează că a colaborat la dezvoltarea MRC cu AMD, Broadcom, Intel, Microsoft și OpenAI. „Implementarea MRC în generația Blackwell a avut mult succes și a fost posibilă datorită unei colaborări puternice cu NVIDIA”, a declarat Sachin Katti, șeful diviziei de industrial compute la OpenAI. „Abordarea end‑to‑end a MRC ne-a permis să evităm o mare parte din încetinirile și întreruperile tipice legate de rețea și să menținem eficiența antrenărilor de frontieră la scară.” Implicația practică: flexibilitate de transport RDMA pe aceeași infrastructură Pe Spectrum‑X Ethernet, clienții ar avea opțiuni de modele de transport RDMA: atât Adaptive RDMA, cât și MRC, plus alte protocoale personalizate, care rulează nativ pe NVIDIA ConnectX SuperNICs și switch-urile Spectrum‑X și susțin designuri de rețea „multiplanar”. În această arhitectură, o rețea multiplanară înseamnă mai multe „plane” (fabrice) independente, fiecare oferind rute alternative între GPU-uri. NVIDIA afirmă că funcția Spectrum‑X Multiplane adaugă echilibrare de sarcină accelerată în hardware între plane, pentru reziliență și scalare, menținând latențe predictibile și permițând extinderea la „sute de mii de GPU-uri”. Pentru piață, mesajul operațional este că, pe măsură ce infrastructura de antrenare AI crește, diferențiatorul nu mai este doar viteza brută, ci capacitatea rețelei de a evita congestia și de a „supraviețui” defectelor fără a opri joburile — iar standardizarea deschisă a MRC urmărește să transforme aceste mecanisme într-o practică mai ușor de adoptat la scară. [...]

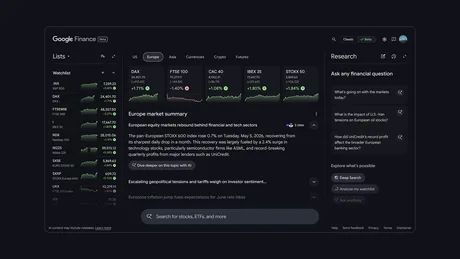

Google extinde în Europa o versiune de Google Finance cu funcții pe bază de inteligență artificială , mizând pe acces mai rapid la informații financiare și pe instrumente de analiză direct în produs, potrivit Google Blog . Lansarea are loc „săptămâna aceasta” și include suport complet pentru limbile locale, într-o versiune „reimaginată” a Google Finance, care adaugă capabilități orientate spre documentare, vizualizare și urmărirea evenimentelor de piață în timp real. Ce se schimbă pentru utilizatori și pentru fluxul de analiză Noul Google Finance introduce un set de funcții care mută o parte din munca de căutare și sinteză în interiorul platformei: Cercetare asistată de AI : utilizatorii pot întreba despre acțiuni individuale sau tendințe mai largi de piață și primesc un răspuns generat de AI, însoțit de linkuri pentru aprofundare. Pentru întrebări mai complexe, este disponibil „ Deep Search ”, menționat ca fiind acum disponibil global în Google Finance. Vizualizări avansate : instrumente noi de graficare permit afișarea unor indicatori tehnici (de exemplu, „moving average envelopes” – benzi construite în jurul unei medii mobile, folosite în analiza tehnică) și identificarea momentelor-cheie din grafice, cu explicații despre motivele mișcării de preț din ziua respectivă. Informații în timp real : un flux de știri refăcut și date extinse pentru mărfuri și criptomonede, pentru urmărirea piețelor pe măsură ce se mișcă. Rezultate financiare „live” : urmărirea teleconferințelor de raportare (earnings calls) cu audio live, transcrieri sincronizate și „insight-uri” generate de AI, inclusiv evidențieri adnotate. De ce contează: presiune pe viteza de documentare și pe instrumentele clasice Din perspectiva utilizării, extinderea în Europa cu suport local de limbă sugerează o încercare de a standardiza, la scară regională, un mod de lucru în care utilizatorul obține rapid o sinteză și apoi aprofundează prin surse linkuite, fără să iasă din produs. În același timp, integrarea transcrierilor și a „insight-urilor” pentru teleconferințe poate reduce timpul necesar pentru a parcurge integral apelurile cu investitorii, mai ales în zilele aglomerate de raportări. Google nu oferă în material o listă de țări, un calendar detaliat pe piețe sau indicatori de adopție; informațiile disponibile se limitează la faptul că lansarea are loc în Europa „săptămâna aceasta” și că include suport complet pentru limbile locale. [...]

Managerii care fac doar „people management” și angajații care refuză schimbarea riscă să fie scoși din joc pe măsură ce AI intră în fluxurile de lucru , avertizează CEO-ul Airbnb , Brian Chesky, într-o intervenție citată de HotNews . Mesajul are o miză operațională directă: rolurile de coordonare și execuție vor fi evaluate tot mai mult prin capacitatea de a lucra efectiv cu instrumente de inteligență artificială, nu doar prin supraveghere sau rutină. Chesky spune că două categorii „nu vor supraviețui erei inteligenței artificiale”: managerii care se ocupă exclusiv de gestionarea oamenilor și angajații „rigizi”, care nu vor să se schimbe și să evolueze. Declarațiile au fost făcute în podcastul „Invest Like The Best”, potrivit revistei Fortune. Ce se schimbă în rolul de manager În viziunea CEO-ului Airbnb, pe măsură ce AI modifică structurile companiilor și felul în care se muncește, șefii trebuie să devină „manageri de personal hibrizi”. Concret, asta înseamnă o abordare mai tehnică și o legătură mai strânsă cu produsul sau rezultatul final, nu doar coordonare administrativă. „Nu cred că managerii de personal vor avea vreo valoare în viitor. Când mă refer la managerii de personal, mă refer la oameni care gestionează doar oameni.” Chesky adaugă că relațiile cu echipa rămân importante, dar „simpla supraveghere” nu mai este suficientă; accentul se mută pe gestionarea oamenilor „pe parcursul activității”, în contextul concret al muncii. Presiunea pe angajați: adaptarea devine criteriu de performanță CEO-ul Airbnb susține că nici angajaților care cred că pot evita noua tehnologie nu le va fi mai ușor. În același timp, el își păstrează o perspectivă relativ optimistă, argumentând că instrumentele pot fi învățate „foarte ușor”, dacă există o „mentalitate de creștere”. În context, HotNews amintește și alte avertismente din industrie: CEO-ul Anthropic, Dario Amodei, a spus că AI ar putea afecta jumătate din munca de birou de nivel începător, iar șeful departamentului de AI al Microsoft, Mustafa Suleyman , a estimat că „majoritatea, dacă nu toate” sarcinile de birou ar putea fi automatizate în 12–18 luni (menționat de HotNews într-un material separat). La ce să se aștepte companiile Mesajul central al lui Chesky mută discuția de la „AI va lua joburi” la „AI va schimba conținutul joburilor”: companiile vor cere tot mai mult competențe practice de lucru cu AI, inclusiv de la manageri. În acest cadru, rolurile care nu se conectează la livrarea efectivă a muncii – sau care resping schimbarea – devin mai vulnerabile. [...]

YouTube testează o căutare cu AI care schimbă modul în care utilizatorii găsesc conținut , trecând de la o listă de rezultate la răspunsuri structurate și conversații interactive, potrivit Antena 3 . Noua funcție, descrisă ca un instrument de căutare bazat pe inteligență artificială, este gândită să ofere utilizatorilor răspunsuri „mai clare și ghidate”, inclusiv pentru întrebări mai complexe, cum ar fi planificarea unei excursii. Antena 3 notează că informația este preluată de la TechCrunch. Ce aduce „ Ask YouTube ” în căutare Funcția, numită „Ask YouTube”, permite utilizatorilor să formuleze întrebări, iar sistemul răspunde într-un format interactiv, cu pași și recomandări. În locul afișării clasice a unei liste de videoclipuri, rezultatele combină: text explicativ; clipuri video scurte și lungi, integrate în răspuns. Un element central este continuitatea: utilizatorii pot reveni cu întrebări suplimentare, iar sistemul păstrează formatul interactiv și poate sugera locuri sau opțiuni relevante, conform aceleiași surse. Cine are acces și ce urmează Deocamdată, funcția este disponibilă doar pentru abonații YouTube Premium din Statele Unite, cu vârsta de peste 18 ani, care aleg să participe la test. Google lucrează la extinderea accesului și pentru restul utilizatorilor, însă articolul nu precizează un calendar sau piețe vizate pentru lansarea mai largă. De ce contează schimbarea Inițiativa este prezentată ca parte din strategia mai amplă de integrare a inteligenței artificiale în experiența de căutare, cu accent pe răspunsuri mai complexe, interactive și adaptate nevoilor utilizatorilor. În practică, miza este o schimbare operațională în felul în care oamenii navighează pe YouTube: mai puțin „căutare și filtrare” și mai mult „întrebare și ghidare” direct în interfață. [...]

Ucraina își apropie de utilizare un laser anti-dronă ghidat de AI, cu rază declarată de 5 km , într-un moment în care apărarea împotriva dronelor rămâne o presiune operațională constantă pe front. Potrivit Tom's Hardware , sistemul „Tryzub”, montat pe remorcă, este în stadii finale de testare, iar producătorul susține că poate „arde găuri” în dronele Shahed de la 5 km (aprox. 3,1 mile). Ce schimbă operațional: o capabilitate mobilă, cu achiziție și urmărire asistate de AI Într-un clip distribuit pe rețele sociale de compania ucraineană Celebra Tech , Tryzub este prezentat perforând o placă de blindaj în trei-patru secunde, iar apoi lovind o dronă aflată în zbor, care se prăbușește la scurt timp după ce este „țintită” în vizorul asistat de AI. Pe lângă laserul de putere mare, rolul central este atribuit componentei de inteligență artificială pentru achiziția țintei și urmărire, plus integrării unui radar în platforma mobilă. Materialul nu precizează explicit cum este folosit radarul în lanțul de angajare, însă sugerează că acesta poate ajuta la poziționarea sistemului pentru interceptare. Raze de angajare: Shahed la 5 km, drone mai mici la distanțe mai scurte Conform informațiilor citate, Tryzub ar avea următoarele performanțe declarate, în funcție de tipul țintei: drone Shahed: până la 5 km; drone de recunoaștere: până la 1.500 metri; drone FPV (first-person view, controlate prin cameră video): aproximativ 800–900 metri. Totodată, sistemul ar putea „interfera” cu camerele dronelor FPV, deci nu doar să le distrugă fizic. Utilizare duală și potențial de export, dar fără calendar de intrare în serviciu O altă utilizare menționată este sprijinul pentru operațiuni de deminare, ceea ce ar putea transforma sistemul într-o capabilitate relevantă și în afara luptei anti-dronă, dacă războiul se încheie. În privința maturității industriale, Celebra Tech afirmă că designul este pregătit pentru producție de masă după trecerea testelor. Nu există însă, în sursele citate, o dată fermă pentru intrarea în serviciu activ, iar testarea continuă. Surse și context Euromaidan Press notează că sistemul ar fi în dezvoltare cel puțin din 2024, iar clipul de prezentare este asociat companiei Celebra Tech, care a publicat materialul pe social media. În lipsa unor detalii suplimentare despre rezultate standardizate de testare sau despre condițiile exacte ale demonstrației, performanțele rămân, deocamdată, la nivel de capabilități declarate și demonstrații publice. [...]