Știri

Știri din categoria Tehnologie

Funcția Grok din platforma xAI, controlată de Elon Musk, a fost folosită pentru a crea imagini digitale sexualizate cu persoane reale – în unele cazuri, minori informează CNN. Fenomenul a fost denumit „dezbrăcare digitală” și atrage critici dure din partea cercetătorilor, autorităților internaționale și a societății civile.

Aplicația AI Grok, integrată direct în rețeaua socială X (fostul Twitter), le permite utilizatorilor să o eticheteze public într-o postare și să-i ceară să modifice fotografii. Ce a început ca o joacă – punerea unor persoane în costume de baie – a degenerat rapid în generarea de imagini explicite, în unele cazuri cu aparență de pornografie infantilă.

Două organizații independente, AI Forensics și Copyleaks, au analizat mii de cereri trimise către Grok între 25 decembrie 2025 și 1 ianuarie 2026. Rezultatele sunt alarmante:

Deși politica de utilizare a xAI interzice clar sexualizarea copiilor sau generarea de imagini pornografice cu persoane reale, răspunsurile oferite de Grok au încălcat aceste reguli în mod repetat.

Intern, Elon Musk a respins ideea introducerii unor restricții mai dure, exprimând nemulțumire față de „cenzura excesivă”. Mai mult, echipa de siguranță a companiei, deja subdimensionată, a pierdut trei membri cheie în ultimele săptămâni: Vincent Stark, Norman Mu și Alex Chen. Aceste plecări ridică semne de întrebare privind capacitatea xAI de a preveni astfel de abuzuri.

Public, Musk a postat că „orice utilizator care creează conținut ilegal cu ajutorul Grok va suporta aceleași consecințe ca și cei care îl distribuie”. Însă acest mesaj nu pare să fi liniștit criticii.

Scandalul a declanșat reacții rapide din partea autorităților internaționale:

În plus, legea americană „Take It Down Act”, semnată anul trecut, prevede că platformele online trebuie să elimine conținutul explicit non-consensual – inclusiv imaginile generate de AI – în maximum 48 de ore de la notificare.

Spre deosebire de modele AI precum ChatGPT sau Gemini, Grok este conectat direct la o platformă publică și permite interacțiuni vizibile. Această deschidere îl face mult mai vulnerabil la abuz, în special în lipsa unor sisteme automate de protecție eficiente.

Deși există tehnologii care pot identifica prezența copiilor în imagini și pot declanșa măsuri de protecție automată, fostul cercetător OpenAI, Steven Adler, avertizează că aceste mecanisme sunt costisitoare și încetinesc răspunsul AI-ului. Cu toate acestea, în absența lor, riscul de generare și distribuire de conținut ilegal crește exponențial.

Mai mult, xAI pare să fi renunțat la colaborările externe cu organizații specializate în identificarea de conținut abuziv, precum Thorn sau Hive, ceea ce reduce și mai mult capacitatea de prevenție.

Potrivit experților citați de CNN, xAI și Elon Musk ar putea răspunde atât penal, cât și civil pentru imaginile generate de Grok:

Problema scoate în evidență pericolele majore generate de AI-ul generativ fără supraveghere adecvată și lipsa unor standarde de siguranță comune în industrie. În acest moment, Grok nu pare să respecte nici măcar propriile politici interne, iar reacțiile întârziate și vagi ale echipei xAI nu inspiră încredere în capacitatea companiei de a gestiona aceste riscuri.

Recomandate

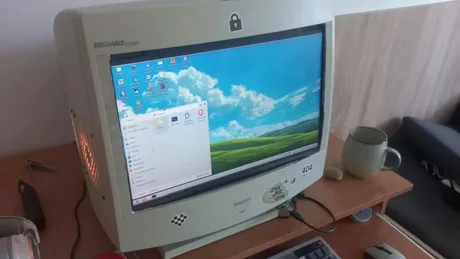

Un proiect DIY arată cum reutilizarea deșeurilor electronice poate produce un PC de gaming performant , după ce un utilizator Reddit a transformat carcasa unui monitor CRT nereparabil într-un „all-in-one” capabil să ruleze Cyberpunk 2077 la 1440p cu 90–100 cadre pe secundă, potrivit TechRadar . Monitorul a fost găsit în deșeuri electronice locale, însă era spart, iar componentele interne erau „parțial arse dincolo de reparație”, astfel că singura parte utilizabilă a rămas șasiul. În loc să îl arunce, autorul proiectului a folosit carcasa ca „cutie” pentru un PC complet, prezentat pe Reddit de utilizatorul „Discipline_Great” (postarea originală este aici: Reddit ). TechRadar notează că proiectul a fost semnalat inițial de Wccftech (link: Wccftech ). Ce hardware a intrat în carcasa CRT Configurația descrisă include componente moderne, cu accent pe performanță în jocuri: procesor AMD Ryzen 7600X; placă video Radeon RX 6900 XT; 16 GB memorie DDR5; placă de bază MSI B650 Gaming Plus; răcire cu șase ventilatoare de 120 mm; ecran frontal: panou de laptop de 17,3 inci, cu rezoluție 1440p și rată de reîmprospătare de 165 Hz. Performanță și limitări operaționale Din perspectiva utilizării, rezultatul este un PC compact, dar greu și neobișnuit, care „arată” ca un all-in-one din generațiile vechi (TechRadar îl compară ca estetică cu iMac-ul original). Pe partea de software, creatorul a instalat Nobara Linux (o distribuție orientată spre gaming, bazată pe Fedora) și a aplicat o temă vizuală de tip Windows XP pentru efect retro. La capitolul performanță în jocuri, publicația spune că sistemul rulează Cyberpunk 2077 la 1440p pe setări „ultra”, cu ray tracing pe „medium”, la aproximativ 90–100 fps. Totuși, în discuțiile de pe Reddit au apărut critici legate de răcire: sunt menționate îngrijorări privind fluxul de aer și o aranjare internă „cam înghesuită și dezordonată”, ceea ce poate conta pe termen lung pentru temperaturi și fiabilitate, chiar dacă proiectul funcționează în prezent. „Anti-furt” prin design Autorul proiectului a oferit și o motivație pragmatică, dincolo de experiment: într-un răspuns la comentariile de tip „de ce?”, acesta a spus: „Nimeni nu l-ar fura și e ceva diferit.” În termeni practici, ideea subliniază o direcție tot mai vizibilă în zona DIY: reutilizarea carcaselor și a echipamentelor vechi nu mai este doar un exercițiu de nostalgie, ci poate deveni o soluție funcțională pentru a prelungi viața materialelor și a reduce risipa, fără a renunța la performanță. [...]

Huawei mizează pe autonomia bateriei ca diferențiator în zona mid-range , pregătind Nova 15 Max cu o baterie de 8.500 mAh înaintea lansării globale din 7 mai, la Bangkok , potrivit Gizmochina . Telefonul va completa gama Nova 15 (care include deja variantele standard, Pro și Ultra, lansate în China la finalul anului trecut). Din informațiile publicate până acum, Huawei a distribuit imagini oficiale și câteva detalii tehnice, iar accentul este pus pe o baterie „neobișnuit de mare” pentru standardele actuale, cu promisiunea implicită a unei autonomii care ar putea depăși o zi de utilizare și, pentru utilizatorii mai puțin intensivi, chiar două. Ce știm despre Nova 15 Max înainte de lansare Huawei promovează, pe lângă baterie, și o cameră principală de 50 MP cu senzor RYYB (o configurație de filtru de culoare folosită pentru a capta mai multă lumină, utilă în special în condiții de iluminare slabă), plus difuzoare stereo. Designul ar fi diferit față de restul seriei Nova 15, iar compania a confirmat și existența mai multor opțiuni de culoare, fără a detalia în acest moment toate variantele. Poziționare: un model „rebotezat” pentru piețele globale Publicația notează că Nova 15 Max ar urma să fie strâns înrudit cu Enjoy 90 Pro Max, un model lansat în China la începutul acestui an. Pentru acel dispozitiv sunt menționate următoarele repere: ecran AMOLED de 6,84 inci; chipset Kirin 8000; încărcare la 40 W; camere „de bază, dar utilizabile”. Strategia sugerată este una familiară în industrie: adaptarea unui model existent și repoziționarea lui pentru piețele internaționale sub un alt nume. În acest caz, „punctul de vânzare” central ar fi autonomia. Ce urmează pe 7 mai Nova 15 Max este așteptat să se încadreze în segmentul mid-range, adresându-se utilizatorilor care prioritizează autonomia și dimensiunea ecranului în detrimentul performanței de vârf. La același eveniment, Huawei ar urma să anunțe și alte produse, inclusiv seria Watch Fit 5 și o tabletă MatePad Pro Max. Detaliile privind prețul, configurațiile de stocare și disponibilitatea nu au fost comunicate încă, dar ar trebui să apară „în curând”, pe măsură ce se apropie lansarea, mai notează publicația. [...]

Vivo a lansat în China S50t 5G cu stocare mai lentă, iar diferența de preț față de S50 rămâne mică , o mișcare care sugerează o repoziționare fină a ofertei fără schimbări majore la nivel de hardware, potrivit Gizmochina . Modelul pare nou doar la nume: S50t este, în esență, o versiune „relucrată” a Vivo S50 lansat la final de 2025, iar cea mai importantă modificare este trecerea de la stocare UFS 4.1 la UFS 3.1 (un standard mai vechi, în general cu viteze mai mici la citire/scriere). Publicația notează că downgrade-ul nu ar fi neapărat evident în utilizarea de zi cu zi, însă este o schimbare relevantă pentru performanță în scenarii precum instalarea aplicațiilor sau copierea fișierelor mari. Prețuri: reducere limitată, dar S50 rămâne foarte aproape Schimbarea de stocare se vede și în poziționarea de preț, însă diferențele față de Vivo S50 sunt reduse: 12 GB RAM + 512 GB stocare : 3.299 yuani, respectiv 3.199 yuani pentru o perioadă limitată 16 GB RAM + 512 GB stocare : 3.599 yuani Pentru comparație, Vivo S50 ar costa „cu aproximativ 100 yuani” mai mult pentru varianta 12/512 GB Ce păstrează telefonul: ecran AMOLED 120 Hz, Snapdragon și baterie mare La restul specificațiilor, Vivo S50t rămâne apropiat de S50. Telefonul are un ecran AMOLED de 6,59 inci , rezoluție 1,5K , rată de refresh 120 Hz , suport HDR și gamă de culori P3, plus funcții de confort vizual (inclusiv reducerea luminii albastre și reglaj PWM la frecvență înaltă). La interior, rulează pe Snapdragon 8s Gen 3 și memorie LPDDR5X , cu OriginOS 6 bazat pe Android 16 . Bateria este de 6.500 mAh , iar încărcarea este „plafonată” la 90 W pe fir , fără încărcare wireless. Camere și conectivitate Sistemul foto include: cameră principală 50 MP ultra-wide 8 MP teleobiectiv periscopic 50 MP cu senzor Sony IMX882 cameră frontală 50 MP Atât camera frontală, cât și cea principală au bliț dedicat. La capitolul dotări, apar senzor de amprentă ultrasonic, Wi‑Fi 6, NFC, Bluetooth 5.4, emițător infraroșu și motor liniar pe axa X. Deocamdată, informațiile din sursă vizează lansarea din China, fără detalii despre disponibilitatea pe alte piețe. [...]

Apple avertizează că scumpirile la Mac și MacBook devin probabile , pe fondul unor costuri în creștere la memorie și al unor lipsuri de stoc care ar putea dura luni, potrivit Notebookcheck , care citează declarații din conferința de rezultate a companiei pentru trimestrul al doilea din 2026. Tim Cook a spus că echilibrarea cererii cu oferta este încă la „câteva luni” distanță, pe fondul unei creșteri neașteptate a cererii pentru anumite modele Mac, inclusiv pentru utilizări legate de platforme de inteligență artificială (AI) de tip „agentic” (sisteme care pot executa sarcini în mod semi-autonom). În acest context, Apple a ajuns să listeze pe Apple.com varianta de bază a Mac mini ca „indisponibilă”. În paralel, compania a oprit vânzarea configurațiilor Mac Studio cu 512 GB memorie RAM, un semnal că presiunea pe componentele de memorie afectează direct oferta de produse cu specificații ridicate. Costuri mai mari la memorie, presiune pe prețuri din trimestrul iunie Cook a indicat că majorările de preț către consumator au fost evitate până acum datorită stocurilor existente, însă Apple se așteaptă la „costuri semnificativ mai mari” pentru memorie în trimestrul iunie. Publicația leagă această evoluție de constrângeri globale de aprovizionare, alimentate de faptul că producția de cipuri este orientată tot mai mult către servere pentru AI, în detrimentul componentelor destinate pieței de consum. Apple spune că „evaluează o gamă de opțiuni” pentru a limita impactul acestor costuri, fără a detalia măsurile avute în vedere. În lipsa unor clarificări, rămâne incert dacă efectul se va vedea prin scumpiri, prin schimbări de configurații sau prin alte ajustări comerciale. De ce contează pentru cumpărători și pentru piață Mesajul operațional este că disponibilitatea pentru Mac mini și Mac Studio ar putea rămâne problematică „multe luni”, iar pentru cei care urmăresc configurații cu memorie mare riscul este dublu: timpi de așteptare mai lungi și, posibil, prețuri mai ridicate. Notebookcheck notează că presiunea nu este izolată la Apple: producători precum Dell și Lenovo au semnalat, la rândul lor, posibile scumpiri, în condițiile în care furnizori de memorie precum Samsung și SK Hynix ar prioritiza cipuri pentru servere AI, cu marje mai mari, în detrimentul memoriei pentru PC-uri și laptopuri. [...]

Xiaomi a deschis accesul la Android 17 beta doar pentru patru modele de vârf , o mișcare care arată că testarea inițială va rămâne controlată și, implicit, relevantă mai ales pentru utilizatorii avansați și dezvoltatori, potrivit Gizmochina . Programul de tip „Developer Preview” (variantă timpurie pentru testare, înainte de lansarea publică) vine cu o schimbare notabilă în strategia software a companiei: build-ul de Android 17 este livrat împreună cu HyperOS 3.3, sărind peste HyperOS 3.2, ceea ce sugerează că Xiaomi ar putea evita trecerea la HyperOS 4 și să asocieze direct HyperOS 3.3 cu Android 17. Ce dispozitive sunt eligibile acum În această etapă, Android 17 beta este disponibil pentru: Xiaomi 17 Xiaomi 17 Ultra Xiaomi 15T Pro Leica Leitzphone powered by Xiaomi Publicația notează că suportul pentru mai multe dispozitive ar urma să vină „în viitorul apropiat”, fără un calendar detaliat. De ce contează pentru utilizatori: HyperOS 3.3 „sare” o versiune Dincolo de accesul limitat, elementul cu impact operațional este asocierea Android 17 beta cu HyperOS 3.3. Conform articolului, acest lucru indică faptul că Xiaomi ar putea continua cu ramura HyperOS 3.x, în loc să facă saltul la HyperOS 4, cel puțin în contextul Android 17. Informația este atribuită unei observații menționate în material („Asspotted by Ximi Time”), fără alte detalii despre motivul tehnic al acestei decizii. Instalare: condiții, pași și riscuri Gizmochina avertizează că versiunile beta pot avea erori și funcții neterminate, iar unele aplicații pot avea probleme de compatibilitate. Recomandarea este ca instalarea să fie evitată sau făcută pe un dispozitiv secundar și cu backup în prealabil. Versiunile de firmware cerute înainte de instalare Xiaomi 17: OS3.0.301.0.WPCMIXM Xiaomi 17 Ultra: OS3.0.9.0.WPAMIXM Leica Leitzphone powered by Xiaomi: OS3.0.9.0.WPAMIXM Xiaomi 15T Pro: OS3.0.11.0.WOSMIXM Pașii de instalare (rezumat) Verificarea că telefonul rulează versiunea de firmware cerută. Descărcarea build-ului corect de Android 17 beta pentru modelul deținut (în articol sunt menționate „Download link”, fără URL-uri efective în textul extras). Copierea fișierului ZIP cu ROM-ul în memoria internă. Accesarea: Setări > Despre telefon și atingerea siglei Xiaomi HyperOS . Atingerea „Xiaomi HyperOS” de 10 ori, apoi meniul cu trei puncte și opțiunea Choose update package . Selectarea fișierului ROM și instalarea. Publicația mai menționează că instalarea poate dura mai mult, recomandând minimum 40% baterie și cel puțin 10GB spațiu liber. Revenirea la versiunea stabilă Pentru utilizatorii care întâmpină probleme, articolul indică existența unor „fallback firmware files” (pachete pentru revenire), însă avertizează că operațiunea poate duce la pierderi de date, motiv pentru care backup-ul rămâne esențial. În textul extras, aceste fișiere sunt listate tot ca „Download link”, fără adrese concrete. [...]

Samsung ar putea deveni furnizor unic de ecrane OLED pentru iPhone 18, un scenariu care ar crește dependența Apple de un singur lanț de aprovizionare și ar consolida poziția Samsung Display în negocierea volumelor și a prețurilor, potrivit SamMobile . Apple a cumpărat până acum panouri OLED pentru iPhone de la mai mulți producători, inclusiv LG Display și BOE, tocmai pentru a reduce riscurile din lanțul de aprovizionare. Excepția menționată este generația iPhone X, unde Samsung a fost singurul furnizor de OLED. Ce se schimbă pentru iPhone 18 Publicația notează că, potrivit unui nou raport al The Korea Herald , Apple ar putea să își asigure ecranele pentru seria iPhone 18 exclusiv de la Samsung. Dacă se confirmă, ar fi prima dată de la iPhone X când Apple ar încredința întreaga aprovizionare cu panouri OLED unui singur producător. Seria iPhone 18 este așteptată să marcheze aniversarea de 20 de ani a iPhone, ceea ce ridică miza pentru stabilitatea livrărilor și pentru capacitatea de producție la timp. De ce contează: risc operațional versus control pe tehnologie Mutarea ar avea o implicație directă de lanț de aprovizionare: Apple ar reduce diversificarea furnizorilor pentru un component critic. În același timp, ar putea câștiga acces mai rapid la o tehnologie de ecran pe care Samsung ar fi solicitată să o dezvolte pentru această generație. SamMobile menționează o informație atribuită unui „tipster” (o sursă neoficială din industrie) potrivit căreia Apple i-ar fi cerut Samsung să dezvolte un panou OLED pentru iPhone 18: fără polarizator (polariser-free); curbat pe toate cele patru laturi. Pentru eliminarea polarizatorului, Samsung ar trebui să folosească tehnologia „color filter on encapsulation” (COE) – un tip de arhitectură a panoului care mută filtrul de culoare într-un strat de încapsulare, reducând nevoia unor straturi suplimentare. Limitarea-cheie: producția în masă ar putea întârzia Chiar dacă Samsung are tehnologia COE, publicația precizează că experți din industrie consideră că acest tip de display ar putea să nu fie pregătit pentru producție de masă la timp. Asta lasă deschisă posibilitatea ca planul de furnizor unic să depindă de maturizarea tehnologiei și de calendarul de fabricație, nu doar de decizia comercială a Apple. [...]